의인성은 웹 사이트에서 Biden AI 정책을 조용히 제거합니다

Anthropic, AI 개발에 초점을 맞춘 회사,는 2023년 바이든 행정부와 협력하여 만든 몇 가지 자발적 AI 안전 약속을 최근 웹사이트에서 삭제했습니다. 안전하고 신뢰할 수 있는 AI를 촉진하기 위한 이러한 약속에는 AI 위험 관리에 대한 정보 공유와 AI 편견 및 차별에 대한 연구 수행이 포함되었습니다. AI 감시 단체인 The Midas Project는 이러한 약속이 지난주 Anthropic의 투명성 허브에서 삭제되었다고 지적했습니다. 그러나 AI 생성 이미지 기반 성적 학대 감소와 관련된 약속은 여전히 유지되고 있습니다.

Anthropic은 이 변화에 대해 아무런 발표를 하지 않았으며, 논평 요청에 즉시 응답하지 않았습니다. 이 회사는 OpenAI, Google, Microsoft, Meta, Inflection과 같은 다른 회사들과 함께 2023년 7월 바이든 행정부가 제안한 특정 자발적 AI 안전 조치를 따르기로 동의했습니다. 이러한 조치에는 AI 시스템의 출시 전 내부 및 외부 보안 테스트, 민감한 AI 데이터를 보호하기 위한 사이버 보안 투자, AI 생성 콘텐츠에 워터마크를 개발하는 방법 등이 포함되었습니다.

Anthropic은 이미 이러한 관행을 많이 시행하고 있었으며, 이 합의는 법적 구속력이 없었습니다. 바이든 행정부의 목표는 몇 달 후 더 포괄적인 AI 행정 명령이 시행되기 전에 AI 정책 우선순위를 강조하는 것이었습니다.

반면, 트럼프 행정부는 AI 거버넌스에 대해 다른 접근 방식을 나타냈습니다. 1월에 트럼프 대통령은 AI 행정 명령을 철회했으며, 이 명령은 국립표준기술연구소(National Institute of Standards and Technology)에 기업들이 AI 모델의 결함, 포함된 편견을 식별하고 수정하기 위한 지침을 만들도록 지시했습니다. 트럼프의 동맹자들은 이 명령이 기업들에게 무거운 보고 요구사항을 부과하여 무역 비밀을 드러내도록 강요했다고 비판했습니다.

AI 행정 명령 철회 직후, 트럼프는 연방 기관들에게 "이념적 편견이 없는" AI 개발을 지원하여 "인간의 번영, 경제 경쟁력, 국가 안보"를 촉진하라는 새로운 지침을 발표했습니다. 바이든의 이니셔티브와 달리, 트럼프의 명령은 AI 차별 대응을 다루지 않았습니다.

The Midas Project는 X에서 바이든 시대의 약속들이 일시적이거나 정당에 따라 달라진다는 표시를 하지 않았다고 강조했습니다. 11월 선거 이후, 여러 AI 회사들이 그들의 약속을 재확인했습니다.

Anthropic은 트럼프가 취임한 이후 공개 정책을 조정한 유일한 회사가 아닙니다. OpenAI는 최근 "어떤 주제가 도전적이거나 논란의 여지가 있더라도 지적 자유를 옹호할 것"이며, AI가 특정 관점을 검열하지 않도록 보장하겠다고 선언했습니다. OpenAI는 또한 이전에 다양성, 형평성, 포용성(DEI)에 대한 헌신을 보여주던 웹사이트 페이지를 삭제했습니다. 이러한 프로그램들은 트럼프 행정부로부터 비판을 받아 많은 회사들이 DEI 이니셔티브를 폐기하거나 크게 수정했습니다.

트럼프의 실리콘 밸리 AI 고문들, Marc Andreessen, David Sacks, Elon Musk를 포함한 일부는 Google과 OpenAI 같은 회사들이 챗봇의 응답을 제한함으로써 AI를 검열한다고 비난했습니다. 그러나 OpenAI와 같은 연구소들은 정책 조정이 정치적 압력 때문이 아니라고 부인했습니다.

OpenAI와 Anthropic은 현재 정부 계약을 보유하고 있거나 적극적으로 찾고 있습니다.

이 기사가 게시된 몇 시간 후, Anthropic은 TechCrunch에 다음과 같은 성명을 제공했습니다:

"우리는 바이든 행정부 Ascertain호의 자발적 AI 약속에 계속해서 전념하고 있습니다. 이러한 진행 상황과 구체적인 조치는 [우리의] 투명성 센터 내 콘텐츠에 계속 반영됩니다. 추가 혼란을 방지하기 위해, 우리의 진행 상황이 일치하는 부분을 직접 인용하는 섹션을 추가할 것입니다."

태평양 표준시 오전 11:25 업데이트: Anthropic의 성명이 추가되었습니다.

관련 기사

바이두 헬스, 단기적으로 학술 자료 검색 및 사무 보조 기능을 위한 AI 의사 보조 시스템 ‘닥터클로(DoctorClaw)’ 내부 테스트 진행

바이두 헬스(Baidu Health)가 의사를 위해 설계된 전문 AI 스마트 어시스턴트의 내부 테스트를 시작한 것으로 알려졌다. 내부적으로 ‘닥터클로(DoctorClaw, 랍스터 닥터 버전)’라고 불리는 이 제품은 바이두가 의료 분야에 대규모 언어 모델을 도입하는 데 있어 중요한 진전을 의미한다.내부 소식통에 따르면 이 프로젝트는 여전히 비공개 개발 단계에

바이두 헬스, 단기적으로 학술 자료 검색 및 사무 보조 기능을 위한 AI 의사 보조 시스템 ‘닥터클로(DoctorClaw)’ 내부 테스트 진행

바이두 헬스(Baidu Health)가 의사를 위해 설계된 전문 AI 스마트 어시스턴트의 내부 테스트를 시작한 것으로 알려졌다. 내부적으로 ‘닥터클로(DoctorClaw, 랍스터 닥터 버전)’라고 불리는 이 제품은 바이두가 의료 분야에 대규모 언어 모델을 도입하는 데 있어 중요한 진전을 의미한다.내부 소식통에 따르면 이 프로젝트는 여전히 비공개 개발 단계에

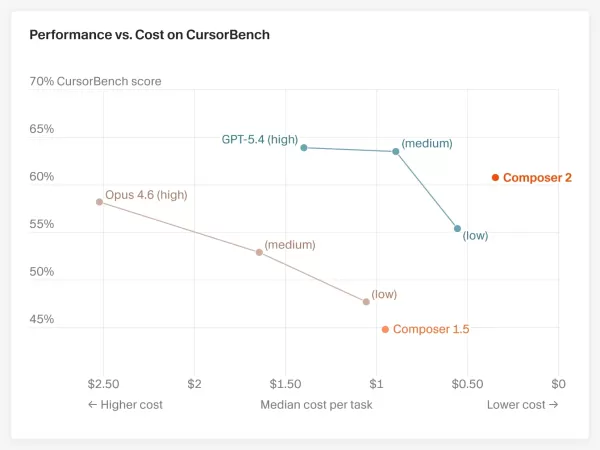

커서 컴포저 2 대 클로드 오푸스 4.6: 벤치마크 테스트로 불붙은 AI 코딩 논쟁

3월 19일, 커서(Cursor)는 자체 개발한 코딩 모델인 ‘컴포저 2(Composer 2)’를 공식 출시했다. 이 발표는 개발자 커뮤니티에서 즉각적인 논의를 불러일으켰다. 커서 측에 따르면, 컴포저 2는 터미널 벤치 2.0에서 61.7%의 점수를 기록했으며, 이는 동일한 테스트 조건에서 클로드 오푸스 4.6의 58.0%를 현저히 상회하는 수치다.Anth

커서 컴포저 2 대 클로드 오푸스 4.6: 벤치마크 테스트로 불붙은 AI 코딩 논쟁

3월 19일, 커서(Cursor)는 자체 개발한 코딩 모델인 ‘컴포저 2(Composer 2)’를 공식 출시했다. 이 발표는 개발자 커뮤니티에서 즉각적인 논의를 불러일으켰다. 커서 측에 따르면, 컴포저 2는 터미널 벤치 2.0에서 61.7%의 점수를 기록했으며, 이는 동일한 테스트 조건에서 클로드 오푸스 4.6의 58.0%를 현저히 상회하는 수치다.Anth

StrictlyVC 샌프란시스코 행사, TDK 벤처스, 리플릿 등 주요 기업 리더들 한자리에

올해 첫 StrictlyVC 행사가 생각보다 빨리 샌프란시스코에서 열립니다. 4월 30일 센트로 필리피노 문화 센터(Sentro Filipino Cultural Center)에서 열리는 이번 행사에는 인상적인 연사진이 참여하며, 아직 티켓을 구매하실 수 있습니다. StrictlyVC가 자랑하는 네트워킹과 커뮤니티 교류는 물론, 이번 샌프란시스코 행사는 자금

관련 특별 주제 추천

의견 (84)

0/500

StrictlyVC 샌프란시스코 행사, TDK 벤처스, 리플릿 등 주요 기업 리더들 한자리에

올해 첫 StrictlyVC 행사가 생각보다 빨리 샌프란시스코에서 열립니다. 4월 30일 센트로 필리피노 문화 센터(Sentro Filipino Cultural Center)에서 열리는 이번 행사에는 인상적인 연사진이 참여하며, 아직 티켓을 구매하실 수 있습니다. StrictlyVC가 자랑하는 네트워킹과 커뮤니티 교류는 물론, 이번 샌프란시스코 행사는 자금

관련 특별 주제 추천

의견 (84)

0/500

![GeorgeScott]()

Interesting move by Anthropic, quietly dropping Biden's AI safety commitments. Makes me wonder if they're dodging accountability or just rethinking their approach. 🤔 Anyone know what's really going on here?

![GaryHill]()

It's wild that Anthropic just scrubbed those AI safety promises off their site! 🤔 Makes you wonder if they're dodging accountability or just shifting priorities. What do you guys think—shady move or no big deal?

![GaryJones]()

It's wild that Anthropic just quietly pulled those AI safety commitments! 🤔 Makes you wonder what's going on behind the scenes—new priorities or just dodging accountability?

![JimmyWhite]()

Interesting move by Anthropic! 🤔 Wonder why they quietly dropped those Biden AI safety promises. Maybe they’re rethinking their strategy or just avoiding political heat?

![WillieHernández]()

アントロピックがバイデン政権とのAI安全協定を静かに削除したのはちょっと怪しいですよね?🤔 安全なAIに対する約束を守らないみたいです。何が裏で起きているのか気になります。もっと透明性が必要ですね、さもないと信用できません!😒

Anthropic, AI 개발에 초점을 맞춘 회사,는 2023년 바이든 행정부와 협력하여 만든 몇 가지 자발적 AI 안전 약속을 최근 웹사이트에서 삭제했습니다. 안전하고 신뢰할 수 있는 AI를 촉진하기 위한 이러한 약속에는 AI 위험 관리에 대한 정보 공유와 AI 편견 및 차별에 대한 연구 수행이 포함되었습니다. AI 감시 단체인 The Midas Project는 이러한 약속이 지난주 Anthropic의 투명성 허브에서 삭제되었다고 지적했습니다. 그러나 AI 생성 이미지 기반 성적 학대 감소와 관련된 약속은 여전히 유지되고 있습니다.

Anthropic은 이 변화에 대해 아무런 발표를 하지 않았으며, 논평 요청에 즉시 응답하지 않았습니다. 이 회사는 OpenAI, Google, Microsoft, Meta, Inflection과 같은 다른 회사들과 함께 2023년 7월 바이든 행정부가 제안한 특정 자발적 AI 안전 조치를 따르기로 동의했습니다. 이러한 조치에는 AI 시스템의 출시 전 내부 및 외부 보안 테스트, 민감한 AI 데이터를 보호하기 위한 사이버 보안 투자, AI 생성 콘텐츠에 워터마크를 개발하는 방법 등이 포함되었습니다.

Anthropic은 이미 이러한 관행을 많이 시행하고 있었으며, 이 합의는 법적 구속력이 없었습니다. 바이든 행정부의 목표는 몇 달 후 더 포괄적인 AI 행정 명령이 시행되기 전에 AI 정책 우선순위를 강조하는 것이었습니다.

반면, 트럼프 행정부는 AI 거버넌스에 대해 다른 접근 방식을 나타냈습니다. 1월에 트럼프 대통령은 AI 행정 명령을 철회했으며, 이 명령은 국립표준기술연구소(National Institute of Standards and Technology)에 기업들이 AI 모델의 결함, 포함된 편견을 식별하고 수정하기 위한 지침을 만들도록 지시했습니다. 트럼프의 동맹자들은 이 명령이 기업들에게 무거운 보고 요구사항을 부과하여 무역 비밀을 드러내도록 강요했다고 비판했습니다.

AI 행정 명령 철회 직후, 트럼프는 연방 기관들에게 "이념적 편견이 없는" AI 개발을 지원하여 "인간의 번영, 경제 경쟁력, 국가 안보"를 촉진하라는 새로운 지침을 발표했습니다. 바이든의 이니셔티브와 달리, 트럼프의 명령은 AI 차별 대응을 다루지 않았습니다.

The Midas Project는 X에서 바이든 시대의 약속들이 일시적이거나 정당에 따라 달라진다는 표시를 하지 않았다고 강조했습니다. 11월 선거 이후, 여러 AI 회사들이 그들의 약속을 재확인했습니다.

Anthropic은 트럼프가 취임한 이후 공개 정책을 조정한 유일한 회사가 아닙니다. OpenAI는 최근 "어떤 주제가 도전적이거나 논란의 여지가 있더라도 지적 자유를 옹호할 것"이며, AI가 특정 관점을 검열하지 않도록 보장하겠다고 선언했습니다. OpenAI는 또한 이전에 다양성, 형평성, 포용성(DEI)에 대한 헌신을 보여주던 웹사이트 페이지를 삭제했습니다. 이러한 프로그램들은 트럼프 행정부로부터 비판을 받아 많은 회사들이 DEI 이니셔티브를 폐기하거나 크게 수정했습니다.

트럼프의 실리콘 밸리 AI 고문들, Marc Andreessen, David Sacks, Elon Musk를 포함한 일부는 Google과 OpenAI 같은 회사들이 챗봇의 응답을 제한함으로써 AI를 검열한다고 비난했습니다. 그러나 OpenAI와 같은 연구소들은 정책 조정이 정치적 압력 때문이 아니라고 부인했습니다.

OpenAI와 Anthropic은 현재 정부 계약을 보유하고 있거나 적극적으로 찾고 있습니다.

이 기사가 게시된 몇 시간 후, Anthropic은 TechCrunch에 다음과 같은 성명을 제공했습니다:

"우리는 바이든 행정부 Ascertain호의 자발적 AI 약속에 계속해서 전념하고 있습니다. 이러한 진행 상황과 구체적인 조치는 [우리의] 투명성 센터 내 콘텐츠에 계속 반영됩니다. 추가 혼란을 방지하기 위해, 우리의 진행 상황이 일치하는 부분을 직접 인용하는 섹션을 추가할 것입니다."

태평양 표준시 오전 11:25 업데이트: Anthropic의 성명이 추가되었습니다.

바이두 헬스, 단기적으로 학술 자료 검색 및 사무 보조 기능을 위한 AI 의사 보조 시스템 ‘닥터클로(DoctorClaw)’ 내부 테스트 진행

바이두 헬스(Baidu Health)가 의사를 위해 설계된 전문 AI 스마트 어시스턴트의 내부 테스트를 시작한 것으로 알려졌다. 내부적으로 ‘닥터클로(DoctorClaw, 랍스터 닥터 버전)’라고 불리는 이 제품은 바이두가 의료 분야에 대규모 언어 모델을 도입하는 데 있어 중요한 진전을 의미한다.내부 소식통에 따르면 이 프로젝트는 여전히 비공개 개발 단계에

바이두 헬스, 단기적으로 학술 자료 검색 및 사무 보조 기능을 위한 AI 의사 보조 시스템 ‘닥터클로(DoctorClaw)’ 내부 테스트 진행

바이두 헬스(Baidu Health)가 의사를 위해 설계된 전문 AI 스마트 어시스턴트의 내부 테스트를 시작한 것으로 알려졌다. 내부적으로 ‘닥터클로(DoctorClaw, 랍스터 닥터 버전)’라고 불리는 이 제품은 바이두가 의료 분야에 대규모 언어 모델을 도입하는 데 있어 중요한 진전을 의미한다.내부 소식통에 따르면 이 프로젝트는 여전히 비공개 개발 단계에

커서 컴포저 2 대 클로드 오푸스 4.6: 벤치마크 테스트로 불붙은 AI 코딩 논쟁

3월 19일, 커서(Cursor)는 자체 개발한 코딩 모델인 ‘컴포저 2(Composer 2)’를 공식 출시했다. 이 발표는 개발자 커뮤니티에서 즉각적인 논의를 불러일으켰다. 커서 측에 따르면, 컴포저 2는 터미널 벤치 2.0에서 61.7%의 점수를 기록했으며, 이는 동일한 테스트 조건에서 클로드 오푸스 4.6의 58.0%를 현저히 상회하는 수치다.Anth

커서 컴포저 2 대 클로드 오푸스 4.6: 벤치마크 테스트로 불붙은 AI 코딩 논쟁

3월 19일, 커서(Cursor)는 자체 개발한 코딩 모델인 ‘컴포저 2(Composer 2)’를 공식 출시했다. 이 발표는 개발자 커뮤니티에서 즉각적인 논의를 불러일으켰다. 커서 측에 따르면, 컴포저 2는 터미널 벤치 2.0에서 61.7%의 점수를 기록했으며, 이는 동일한 테스트 조건에서 클로드 오푸스 4.6의 58.0%를 현저히 상회하는 수치다.Anth

StrictlyVC 샌프란시스코 행사, TDK 벤처스, 리플릿 등 주요 기업 리더들 한자리에

올해 첫 StrictlyVC 행사가 생각보다 빨리 샌프란시스코에서 열립니다. 4월 30일 센트로 필리피노 문화 센터(Sentro Filipino Cultural Center)에서 열리는 이번 행사에는 인상적인 연사진이 참여하며, 아직 티켓을 구매하실 수 있습니다. StrictlyVC가 자랑하는 네트워킹과 커뮤니티 교류는 물론, 이번 샌프란시스코 행사는 자금

StrictlyVC 샌프란시스코 행사, TDK 벤처스, 리플릿 등 주요 기업 리더들 한자리에

올해 첫 StrictlyVC 행사가 생각보다 빨리 샌프란시스코에서 열립니다. 4월 30일 센트로 필리피노 문화 센터(Sentro Filipino Cultural Center)에서 열리는 이번 행사에는 인상적인 연사진이 참여하며, 아직 티켓을 구매하실 수 있습니다. StrictlyVC가 자랑하는 네트워킹과 커뮤니티 교류는 물론, 이번 샌프란시스코 행사는 자금

Interesting move by Anthropic, quietly dropping Biden's AI safety commitments. Makes me wonder if they're dodging accountability or just rethinking their approach. 🤔 Anyone know what's really going on here?

It's wild that Anthropic just scrubbed those AI safety promises off their site! 🤔 Makes you wonder if they're dodging accountability or just shifting priorities. What do you guys think—shady move or no big deal?

It's wild that Anthropic just quietly pulled those AI safety commitments! 🤔 Makes you wonder what's going on behind the scenes—new priorities or just dodging accountability?

Interesting move by Anthropic! 🤔 Wonder why they quietly dropped those Biden AI safety promises. Maybe they’re rethinking their strategy or just avoiding political heat?

アントロピックがバイデン政権とのAI安全協定を静かに削除したのはちょっと怪しいですよね?🤔 安全なAIに対する約束を守らないみたいです。何が裏で起きているのか気になります。もっと透明性が必要ですね、さもないと信用できません!😒

집

집