Hogar

Hogar

EleutherAI presenta un conjunto de datos de texto licenciado masivo para entrenamiento de IA

EleutherAI, un grupo líder en investigación de IA, ha lanzado una de las colecciones más grandes de texto licenciado y de dominio público para el entrenamiento de modelos de IA.

Llamado Common Pile v0.1, este conjunto de datos de 8 terabytes fue desarrollado durante dos años con startups de IA como Poolside, Hugging Face y varias instituciones académicas. Fue utilizado para entrenar dos nuevos modelos de EleutherAI, Comma v0.1-1T y Comma v0.1-2T, que la organización afirma que igualan el rendimiento de modelos entrenados con datos protegidos por derechos de autor sin licencia.

Empresas de IA, incluyendo OpenAI, enfrentan desafíos legales por el uso de datos obtenidos de la web, incluyendo libros y revistas protegidos por derechos de autor, para el entrenamiento de modelos. Aunque algunas tienen acuerdos de licencia con proveedores de contenido, muchas dependen de la doctrina de uso justo de EE. UU. para justificar el entrenamiento con material protegido sin permiso.

EleutherAI argumenta que estas demandas han reducido significativamente la transparencia en la industria de la IA, limitando la comprensión sobre el funcionamiento y las debilidades de los modelos, lo que perjudica a la comunidad de investigación en general.

“Los desafíos legales no han alterado significativamente las prácticas de obtención de datos para el entrenamiento de modelos, pero han reducido drásticamente la apertura de las empresas de IA,” dijo Stella Biderman, directora ejecutiva de EleutherAI, en una publicación de blog en Hugging Face el viernes. “Investigadores de algunas empresas con las que hemos hablado citan las demandas como la razón por la que no pueden compartir su investigación centrada en datos.”

El Common Pile v0.1, disponible en la plataforma de IA de Hugging Face y GitHub, fue desarrollado con consulta legal e incluye fuentes como 300,000 libros de dominio público digitalizados por la Biblioteca del Congreso y el Internet Archive. EleutherAI también utilizó el modelo Whisper de OpenAI para transcribir contenido de audio.

EleutherAI afirma que Comma v0.1-1T y Comma v0.1-2T demuestran la calidad del Common Pile v0.1, permitiendo a los desarrolladores crear modelos competitivos con sistemas propietarios. Ambos modelos, con 7 mil millones de parámetros y entrenados en una porción del conjunto de datos, rivalizan con el modelo Llama original de Meta en pruebas de codificación, comprensión de imágenes y matemáticas.

Ahorra más de $200 en tu pase TechCrunch All Stage

Innova de manera más inteligente. Crece más rápido. Conecta más profundamente. Conecta con visionarios de Precursor Ventures, NEA, Index Ventures, Underscore VC y más para un día de conocimientos, talleres y conexiones valiosas.

Ahorra más de $200 en tu pase TechCrunch All Stage

Innova de manera más inteligente. Crece más rápido. Conecta más profundamente. Conecta con visionarios de Precursor Ventures, NEA, Index Ventures, Underscore VC y más para un día de conocimientos, talleres y conexiones valiosas.

Boston, MA | 15 de julio REGÍSTRATE AHORALos parámetros, a menudo llamados pesos, son los elementos internos de un modelo de IA que dan forma a su comportamiento y respuestas.

“La creencia de que el texto sin licencia es esencial para un alto rendimiento no tiene fundamento,” afirmó Biderman en su publicación. “A medida que los datos de dominio público y con licencia abierta se vuelven más accesibles, anticipamos mejoras significativas en los modelos entrenados con dicho contenido.”

El Common Pile v0.1 aborda parcialmente las controversias pasadas de EleutherAI. Hace años, el grupo lanzó The Pile, un conjunto de datos abierto que contenía material protegido por derechos de autor, lo que atrajo críticas y escrutinio legal por su uso en el entrenamiento de IA.

EleutherAI se compromete a lanzar conjuntos de datos abiertos con mayor regularidad, colaborando con socios de investigación e infraestructura.

Actualizado a las 9:48 a.m. Pacífico: Biderman señaló en X que EleutherAI contribuyó al lanzamiento del conjunto de datos y el modelo, con una participación significativa de socios como la Universidad de Toronto, que co-lideró la investigación.

Artículo relacionado

Baidu Health prueba internamente el asistente médico basado en IA «DoctorClaw» para la búsqueda de información académica y la asistencia administrativa a corto plazo

Según se ha informado, Baidu Health ha iniciado las pruebas internas de un asistente inteligente con IA profesional diseñado para médicos. Conocido internamente como «DoctorClaw» (la versión «Lobster

Baidu Health prueba internamente el asistente médico basado en IA «DoctorClaw» para la búsqueda de información académica y la asistencia administrativa a corto plazo

Según se ha informado, Baidu Health ha iniciado las pruebas internas de un asistente inteligente con IA profesional diseñado para médicos. Conocido internamente como «DoctorClaw» (la versión «Lobster

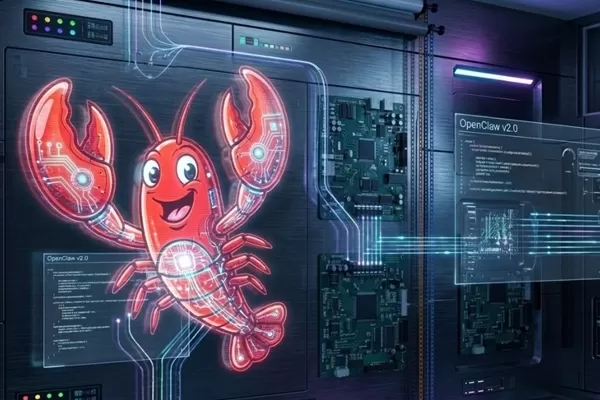

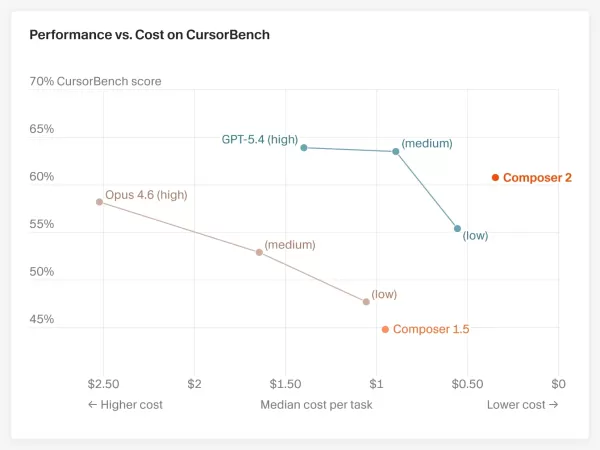

Cursor Composer 2 frente a Claude Opus 4.6: una prueba de rendimiento reaviva el debate sobre la programación con IA

El 19 de marzo, Cursor lanzó oficialmente su modelo de programación propio, Composer 2. El anuncio desató un debate inmediato en la comunidad de desarrolladores: según Cursor, Composer 2 obtuvo una pu

Cursor Composer 2 frente a Claude Opus 4.6: una prueba de rendimiento reaviva el debate sobre la programación con IA

El 19 de marzo, Cursor lanzó oficialmente su modelo de programación propio, Composer 2. El anuncio desató un debate inmediato en la comunidad de desarrolladores: según Cursor, Composer 2 obtuvo una pu

StrictlyVC San Francisco reunirá a líderes de TDK Ventures, Replit y otras empresas

El primer evento de StrictlyVC del año llega a San Francisco antes de lo que imaginas. Aún quedan entradas disponibles para nuestro encuentro del 30 de abril en el Centro Cultural Filipino Sentro, que

Recomendaciones de temas especiales relacionados

comentario (2)

0/500

StrictlyVC San Francisco reunirá a líderes de TDK Ventures, Replit y otras empresas

El primer evento de StrictlyVC del año llega a San Francisco antes de lo que imaginas. Aún quedan entradas disponibles para nuestro encuentro del 30 de abril en el Centro Cultural Filipino Sentro, que

Recomendaciones de temas especiales relacionados

comentario (2)

0/500

![NicholasLewis]()

Наконец-то качественные данные для обучения ИИ! 😄 Но интересно, как это повлияет на конкуренцию между OpenAI и другими компаниями. Может, скоро увидим более умные модели?

![RyanLopez]()

Wow, 8 terabytes of legally licensed text is a game-changer! It's fantastic to see more high-quality, transparent data becoming available. This should really help push open-source AI models forward and maybe even challenge some of the big players who rely on murkier data sources. Hopefully, it leads to more reliable and ethically-sound systems. Can't wait to see what gets built on this! 🚀

EleutherAI, un grupo líder en investigación de IA, ha lanzado una de las colecciones más grandes de texto licenciado y de dominio público para el entrenamiento de modelos de IA.

Llamado Common Pile v0.1, este conjunto de datos de 8 terabytes fue desarrollado durante dos años con startups de IA como Poolside, Hugging Face y varias instituciones académicas. Fue utilizado para entrenar dos nuevos modelos de EleutherAI, Comma v0.1-1T y Comma v0.1-2T, que la organización afirma que igualan el rendimiento de modelos entrenados con datos protegidos por derechos de autor sin licencia.

Empresas de IA, incluyendo OpenAI, enfrentan desafíos legales por el uso de datos obtenidos de la web, incluyendo libros y revistas protegidos por derechos de autor, para el entrenamiento de modelos. Aunque algunas tienen acuerdos de licencia con proveedores de contenido, muchas dependen de la doctrina de uso justo de EE. UU. para justificar el entrenamiento con material protegido sin permiso.

EleutherAI argumenta que estas demandas han reducido significativamente la transparencia en la industria de la IA, limitando la comprensión sobre el funcionamiento y las debilidades de los modelos, lo que perjudica a la comunidad de investigación en general.

“Los desafíos legales no han alterado significativamente las prácticas de obtención de datos para el entrenamiento de modelos, pero han reducido drásticamente la apertura de las empresas de IA,” dijo Stella Biderman, directora ejecutiva de EleutherAI, en una publicación de blog en Hugging Face el viernes. “Investigadores de algunas empresas con las que hemos hablado citan las demandas como la razón por la que no pueden compartir su investigación centrada en datos.”

El Common Pile v0.1, disponible en la plataforma de IA de Hugging Face y GitHub, fue desarrollado con consulta legal e incluye fuentes como 300,000 libros de dominio público digitalizados por la Biblioteca del Congreso y el Internet Archive. EleutherAI también utilizó el modelo Whisper de OpenAI para transcribir contenido de audio.

EleutherAI afirma que Comma v0.1-1T y Comma v0.1-2T demuestran la calidad del Common Pile v0.1, permitiendo a los desarrolladores crear modelos competitivos con sistemas propietarios. Ambos modelos, con 7 mil millones de parámetros y entrenados en una porción del conjunto de datos, rivalizan con el modelo Llama original de Meta en pruebas de codificación, comprensión de imágenes y matemáticas.

Ahorra más de $200 en tu pase TechCrunch All Stage

Innova de manera más inteligente. Crece más rápido. Conecta más profundamente. Conecta con visionarios de Precursor Ventures, NEA, Index Ventures, Underscore VC y más para un día de conocimientos, talleres y conexiones valiosas.

Ahorra más de $200 en tu pase TechCrunch All Stage

Innova de manera más inteligente. Crece más rápido. Conecta más profundamente. Conecta con visionarios de Precursor Ventures, NEA, Index Ventures, Underscore VC y más para un día de conocimientos, talleres y conexiones valiosas.

Boston, MA | 15 de julio REGÍSTRATE AHORALos parámetros, a menudo llamados pesos, son los elementos internos de un modelo de IA que dan forma a su comportamiento y respuestas.

“La creencia de que el texto sin licencia es esencial para un alto rendimiento no tiene fundamento,” afirmó Biderman en su publicación. “A medida que los datos de dominio público y con licencia abierta se vuelven más accesibles, anticipamos mejoras significativas en los modelos entrenados con dicho contenido.”

El Common Pile v0.1 aborda parcialmente las controversias pasadas de EleutherAI. Hace años, el grupo lanzó The Pile, un conjunto de datos abierto que contenía material protegido por derechos de autor, lo que atrajo críticas y escrutinio legal por su uso en el entrenamiento de IA.

EleutherAI se compromete a lanzar conjuntos de datos abiertos con mayor regularidad, colaborando con socios de investigación e infraestructura.

Actualizado a las 9:48 a.m. Pacífico: Biderman señaló en X que EleutherAI contribuyó al lanzamiento del conjunto de datos y el modelo, con una participación significativa de socios como la Universidad de Toronto, que co-lideró la investigación.

Baidu Health prueba internamente el asistente médico basado en IA «DoctorClaw» para la búsqueda de información académica y la asistencia administrativa a corto plazo

Según se ha informado, Baidu Health ha iniciado las pruebas internas de un asistente inteligente con IA profesional diseñado para médicos. Conocido internamente como «DoctorClaw» (la versión «Lobster

Baidu Health prueba internamente el asistente médico basado en IA «DoctorClaw» para la búsqueda de información académica y la asistencia administrativa a corto plazo

Según se ha informado, Baidu Health ha iniciado las pruebas internas de un asistente inteligente con IA profesional diseñado para médicos. Conocido internamente como «DoctorClaw» (la versión «Lobster

Cursor Composer 2 frente a Claude Opus 4.6: una prueba de rendimiento reaviva el debate sobre la programación con IA

El 19 de marzo, Cursor lanzó oficialmente su modelo de programación propio, Composer 2. El anuncio desató un debate inmediato en la comunidad de desarrolladores: según Cursor, Composer 2 obtuvo una pu

Cursor Composer 2 frente a Claude Opus 4.6: una prueba de rendimiento reaviva el debate sobre la programación con IA

El 19 de marzo, Cursor lanzó oficialmente su modelo de programación propio, Composer 2. El anuncio desató un debate inmediato en la comunidad de desarrolladores: según Cursor, Composer 2 obtuvo una pu

StrictlyVC San Francisco reunirá a líderes de TDK Ventures, Replit y otras empresas

El primer evento de StrictlyVC del año llega a San Francisco antes de lo que imaginas. Aún quedan entradas disponibles para nuestro encuentro del 30 de abril en el Centro Cultural Filipino Sentro, que

StrictlyVC San Francisco reunirá a líderes de TDK Ventures, Replit y otras empresas

El primer evento de StrictlyVC del año llega a San Francisco antes de lo que imaginas. Aún quedan entradas disponibles para nuestro encuentro del 30 de abril en el Centro Cultural Filipino Sentro, que

Наконец-то качественные данные для обучения ИИ! 😄 Но интересно, как это повлияет на конкуренцию между OpenAI и другими компаниями. Может, скоро увидим более умные модели?

Wow, 8 terabytes of legally licensed text is a game-changer! It's fantastic to see more high-quality, transparent data becoming available. This should really help push open-source AI models forward and maybe even challenge some of the big players who rely on murkier data sources. Hopefully, it leads to more reliable and ethically-sound systems. Can't wait to see what gets built on this! 🚀