EleutherAI Revela Conjunto de Dados de Texto Licenciado Massivo para Treinamento de IA

EleutherAI, um grupo líder em pesquisa de IA, lançou uma das maiores coleções de texto licenciado e de domínio aberto para treinamento de modelos de IA.

Chamado de Common Pile v0.1, este conjunto de dados de 8 terabytes foi desenvolvido ao longo de dois anos com startups de IA Poolside, Hugging Face e várias instituições acadêmicas. Ele foi usado para treinar dois novos modelos da EleutherAI, Comma v0.1-1T e Comma v0.1-2T, que a organização afirma igualarem o desempenho de modelos treinados com dados protegidos por direitos autorais não licenciados.

Empresas de IA, incluindo OpenAI, enfrentam desafios legais pelo uso de dados extraídos da web, incluindo livros e periódicos protegidos por direitos autorais, para treinamento de modelos. Embora algumas tenham acordos de licenciamento com provedores de conteúdo, muitas dependem da doutrina de uso justo dos EUA para justificar o treinamento com material protegido sem permissão.

A EleutherAI argumenta que esses processos reduziram significativamente a transparência na indústria de IA, limitando a compreensão sobre o funcionamento e as fraquezas dos modelos, o que prejudica a comunidade de pesquisa em geral.

“Os desafios legais não alteraram significativamente as práticas de obtenção de dados para treinamento de modelos, mas reduziram drasticamente a abertura das empresas de IA,” disse Stella Biderman, diretora executiva da EleutherAI, em um post no blog da Hugging Face na sexta-feira. “Pesquisadores de algumas empresas com as quais conversamos citam processos como a razão pela qual não podem compartilhar suas pesquisas centradas em dados.”

O Common Pile v0.1, disponível na plataforma de IA da Hugging Face e no GitHub, foi desenvolvido com consultoria jurídica e inclui fontes como 300.000 livros de domínio público digitalizados pela Biblioteca do Congresso e pelo Internet Archive. A EleutherAI também utilizou o modelo Whisper da OpenAI para transcrever conteúdo de áudio.

A EleutherAI afirma que o Comma v0.1-1T e o Comma v0.1-2T demonstram a qualidade do Common Pile v0.1, permitindo que desenvolvedores criem modelos competitivos com sistemas proprietários. Ambos os modelos, com 7 bilhões de parâmetros e treinados em uma parte do conjunto de dados, rivalizam com o modelo Llama original da Meta em benchmarks de codificação, compreensão de imagens e matemática.

Economize Mais de $200 no Seu Passe de Todas as Etapas do TechCrunch

Inove de forma mais inteligente. Cresça mais rápido. Conecte-se mais profundamente. Conecte-se com visionários da Precursor Ventures, NEA, Index Ventures, Underscore VC e mais para um dia de insights, workshops e conexões valiosas.

Economize Mais de $200 no Seu Passe de Todas as Etapas do TechCrunch

Inove de forma mais inteligente. Cresça mais rápido. Conecte-se mais profundamente. Conecte-se com visionários da Precursor Ventures, NEA, Index Ventures, Underscore VC e mais para um dia de insights, workshops e conexões valiosas.

Boston, MA | 15 de julho REGISTRE-SE AGORAParâmetros, frequentemente chamados de pesos, são os elementos internos de um modelo de IA que moldam seu comportamento e respostas.

“A crença de que texto não licenciado é essencial para alto desempenho é infundada,” afirmou Biderman em seu post. “À medida que dados licenciados abertamente e de domínio público se tornam mais acessíveis, esperamos melhorias significativas em modelos treinados com esse conteúdo.”

O Common Pile v0.1 aborda parcialmente as controvérsias passadas da EleutherAI. Anos atrás, o grupo lançou o The Pile, um conjunto de dados aberto contendo material protegido por direitos autorais, que atraiu críticas e escrutínio legal por seu uso em treinamento de IA.

A EleutherAI promete lançar conjuntos de dados abertos com mais regularidade, colaborando com parceiros de pesquisa e infraestrutura.

Atualizado às 9:48 da manhã, horário do Pacífico: Biderman observou no X que a EleutherAI contribuiu para o lançamento do conjunto de dados e do modelo, com envolvimento significativo de parceiros como a Universidade de Toronto, que co-liderou a pesquisa.

Artigo relacionado

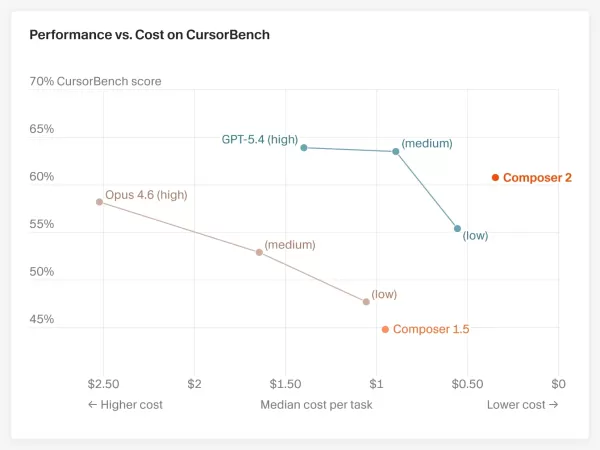

Cursor Composer 2 x Claude Opus 4.6: Teste de desempenho reacende o debate sobre programação com IA

Em 19 de março, a Cursor lançou oficialmente seu modelo de programação desenvolvido internamente, o Composer 2. O anúncio gerou discussão imediata na comunidade de desenvolvedores – segundo a Cursor,

Cursor Composer 2 x Claude Opus 4.6: Teste de desempenho reacende o debate sobre programação com IA

Em 19 de março, a Cursor lançou oficialmente seu modelo de programação desenvolvido internamente, o Composer 2. O anúncio gerou discussão imediata na comunidade de desenvolvedores – segundo a Cursor,

O StrictlyVC de São Francisco reunirá líderes da TDK Ventures, da Replit e de outras empresas

O primeiro evento StrictlyVC do ano está chegando a São Francisco mais cedo do que você imagina. Ainda há ingressos disponíveis para nosso encontro de 30 de abril no Sentro Filipino Cultural Center, c

O StrictlyVC de São Francisco reunirá líderes da TDK Ventures, da Replit e de outras empresas

O primeiro evento StrictlyVC do ano está chegando a São Francisco mais cedo do que você imagina. Ainda há ingressos disponíveis para nosso encontro de 30 de abril no Sentro Filipino Cultural Center, c

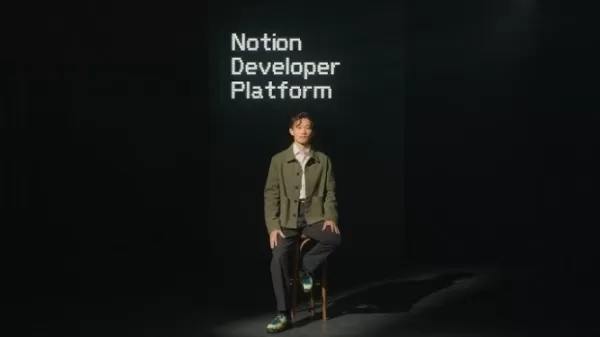

A Notion transforma seu espaço de trabalho em um centro para agentes de IA

A Notion, empresa de software de produtividade, está entrando na era dos agentes.Durante um anúncio de produto transmitido ao vivo na quarta-feira, a Notion — mais conhecida por seu aplicativo colabor

Recomendações de tópicos especiais relacionados

Comentários (2)

A Notion transforma seu espaço de trabalho em um centro para agentes de IA

A Notion, empresa de software de produtividade, está entrando na era dos agentes.Durante um anúncio de produto transmitido ao vivo na quarta-feira, a Notion — mais conhecida por seu aplicativo colabor

Recomendações de tópicos especiais relacionados

Comentários (2)

![NicholasLewis]()

Наконец-то качественные данные для обучения ИИ! 😄 Но интересно, как это повлияет на конкуренцию между OpenAI и другими компаниями. Может, скоро увидим более умные модели?

![RyanLopez]()

Wow, 8 terabytes of legally licensed text is a game-changer! It's fantastic to see more high-quality, transparent data becoming available. This should really help push open-source AI models forward and maybe even challenge some of the big players who rely on murkier data sources. Hopefully, it leads to more reliable and ethically-sound systems. Can't wait to see what gets built on this! 🚀

EleutherAI, um grupo líder em pesquisa de IA, lançou uma das maiores coleções de texto licenciado e de domínio aberto para treinamento de modelos de IA.

Chamado de Common Pile v0.1, este conjunto de dados de 8 terabytes foi desenvolvido ao longo de dois anos com startups de IA Poolside, Hugging Face e várias instituições acadêmicas. Ele foi usado para treinar dois novos modelos da EleutherAI, Comma v0.1-1T e Comma v0.1-2T, que a organização afirma igualarem o desempenho de modelos treinados com dados protegidos por direitos autorais não licenciados.

Empresas de IA, incluindo OpenAI, enfrentam desafios legais pelo uso de dados extraídos da web, incluindo livros e periódicos protegidos por direitos autorais, para treinamento de modelos. Embora algumas tenham acordos de licenciamento com provedores de conteúdo, muitas dependem da doutrina de uso justo dos EUA para justificar o treinamento com material protegido sem permissão.

A EleutherAI argumenta que esses processos reduziram significativamente a transparência na indústria de IA, limitando a compreensão sobre o funcionamento e as fraquezas dos modelos, o que prejudica a comunidade de pesquisa em geral.

“Os desafios legais não alteraram significativamente as práticas de obtenção de dados para treinamento de modelos, mas reduziram drasticamente a abertura das empresas de IA,” disse Stella Biderman, diretora executiva da EleutherAI, em um post no blog da Hugging Face na sexta-feira. “Pesquisadores de algumas empresas com as quais conversamos citam processos como a razão pela qual não podem compartilhar suas pesquisas centradas em dados.”

O Common Pile v0.1, disponível na plataforma de IA da Hugging Face e no GitHub, foi desenvolvido com consultoria jurídica e inclui fontes como 300.000 livros de domínio público digitalizados pela Biblioteca do Congresso e pelo Internet Archive. A EleutherAI também utilizou o modelo Whisper da OpenAI para transcrever conteúdo de áudio.

A EleutherAI afirma que o Comma v0.1-1T e o Comma v0.1-2T demonstram a qualidade do Common Pile v0.1, permitindo que desenvolvedores criem modelos competitivos com sistemas proprietários. Ambos os modelos, com 7 bilhões de parâmetros e treinados em uma parte do conjunto de dados, rivalizam com o modelo Llama original da Meta em benchmarks de codificação, compreensão de imagens e matemática.

Economize Mais de $200 no Seu Passe de Todas as Etapas do TechCrunch

Inove de forma mais inteligente. Cresça mais rápido. Conecte-se mais profundamente. Conecte-se com visionários da Precursor Ventures, NEA, Index Ventures, Underscore VC e mais para um dia de insights, workshops e conexões valiosas.

Economize Mais de $200 no Seu Passe de Todas as Etapas do TechCrunch

Inove de forma mais inteligente. Cresça mais rápido. Conecte-se mais profundamente. Conecte-se com visionários da Precursor Ventures, NEA, Index Ventures, Underscore VC e mais para um dia de insights, workshops e conexões valiosas.

Boston, MA | 15 de julho REGISTRE-SE AGORAParâmetros, frequentemente chamados de pesos, são os elementos internos de um modelo de IA que moldam seu comportamento e respostas.

“A crença de que texto não licenciado é essencial para alto desempenho é infundada,” afirmou Biderman em seu post. “À medida que dados licenciados abertamente e de domínio público se tornam mais acessíveis, esperamos melhorias significativas em modelos treinados com esse conteúdo.”

O Common Pile v0.1 aborda parcialmente as controvérsias passadas da EleutherAI. Anos atrás, o grupo lançou o The Pile, um conjunto de dados aberto contendo material protegido por direitos autorais, que atraiu críticas e escrutínio legal por seu uso em treinamento de IA.

A EleutherAI promete lançar conjuntos de dados abertos com mais regularidade, colaborando com parceiros de pesquisa e infraestrutura.

Atualizado às 9:48 da manhã, horário do Pacífico: Biderman observou no X que a EleutherAI contribuiu para o lançamento do conjunto de dados e do modelo, com envolvimento significativo de parceiros como a Universidade de Toronto, que co-liderou a pesquisa.

Cursor Composer 2 x Claude Opus 4.6: Teste de desempenho reacende o debate sobre programação com IA

Em 19 de março, a Cursor lançou oficialmente seu modelo de programação desenvolvido internamente, o Composer 2. O anúncio gerou discussão imediata na comunidade de desenvolvedores – segundo a Cursor,

Cursor Composer 2 x Claude Opus 4.6: Teste de desempenho reacende o debate sobre programação com IA

Em 19 de março, a Cursor lançou oficialmente seu modelo de programação desenvolvido internamente, o Composer 2. O anúncio gerou discussão imediata na comunidade de desenvolvedores – segundo a Cursor,

O StrictlyVC de São Francisco reunirá líderes da TDK Ventures, da Replit e de outras empresas

O primeiro evento StrictlyVC do ano está chegando a São Francisco mais cedo do que você imagina. Ainda há ingressos disponíveis para nosso encontro de 30 de abril no Sentro Filipino Cultural Center, c

O StrictlyVC de São Francisco reunirá líderes da TDK Ventures, da Replit e de outras empresas

O primeiro evento StrictlyVC do ano está chegando a São Francisco mais cedo do que você imagina. Ainda há ingressos disponíveis para nosso encontro de 30 de abril no Sentro Filipino Cultural Center, c

A Notion transforma seu espaço de trabalho em um centro para agentes de IA

A Notion, empresa de software de produtividade, está entrando na era dos agentes.Durante um anúncio de produto transmitido ao vivo na quarta-feira, a Notion — mais conhecida por seu aplicativo colabor

A Notion transforma seu espaço de trabalho em um centro para agentes de IA

A Notion, empresa de software de produtividade, está entrando na era dos agentes.Durante um anúncio de produto transmitido ao vivo na quarta-feira, a Notion — mais conhecida por seu aplicativo colabor

Наконец-то качественные данные для обучения ИИ! 😄 Но интересно, как это повлияет на конкуренцию между OpenAI и другими компаниями. Может, скоро увидим более умные модели?

Wow, 8 terabytes of legally licensed text is a game-changer! It's fantastic to see more high-quality, transparent data becoming available. This should really help push open-source AI models forward and maybe even challenge some of the big players who rely on murkier data sources. Hopefully, it leads to more reliable and ethically-sound systems. Can't wait to see what gets built on this! 🚀

Lar

Lar