Los debates sobre la evaluación comparativa de IA han llegado a Pokémon

Incluso el amado mundo de Pokémon no es inmune al drama que rodea los puntos de referencia de IA. Una reciente publicación viral en X generó bastante revuelo, afirmando que el último modelo Gemini de Google había superado al modelo líder Claude de Anthropic en la clásica trilogía de videojuegos de Pokémon. Según la publicación, Gemini había llegado impresionantemente a Pueblo Lavanda en una transmisión de Twitch de un desarrollador, mientras que Claude se quedaba atrás en Monte Luna a finales de febrero.

Gemini está literalmente por delante de Claude en este momento en Pokémon tras llegar a Pueblo Lavanda

Solo 119 espectadores en vivo, por cierto, una transmisión increíblemente subestimada pic.twitter.com/8AvSovAI4x

— Jush (@Jush21e8) 10 de abril de 2025

Sin embargo, lo que esta publicación omitió convenientemente fue el hecho de que Gemini tenía una ventaja algo injusta. Usuarios astutos en Reddit señalaron rápidamente que el desarrollador detrás de la transmisión de Gemini había creado un minimapa personalizado. Esta ingeniosa herramienta ayuda al modelo a reconocer "tiles" en el juego, como árboles cortables, lo que reduce significativamente el tiempo que Gemini necesita para analizar capturas de pantalla antes de decidir su próximo movimiento.

Ahora, aunque Pokémon no sea el punto de referencia de IA más serio que existe, sirve como un ejemplo divertido pero revelador de cómo diferentes configuraciones pueden sesgar los resultados de estas pruebas. Tomemos, por ejemplo, el reciente modelo de Anthropic, Anthropic 3.7 Sonnet. En el punto de referencia SWE-bench Verified, que está destinado a probar la destreza en codificación, obtuvo una precisión del 62.3%. Pero, con un "andamiaje personalizado" que Anthropic diseñó, esa puntuación saltó al 70.3%.

Y no termina ahí. Meta tomó uno de sus modelos más nuevos, Llama 4 Maverick, y lo ajustó específicamente para el punto de referencia LM Arena. La versión básica del modelo no tuvo un desempeño tan bueno en la misma prueba.

Dado que los puntos de referencia de IA, incluyendo nuestro amigable ejemplo de Pokémon, ya son algo impredecibles, estos ajustes personalizados y enfoques no estándar solo hacen que sea aún más complicado realizar comparaciones significativas entre modelos a medida que llegan al mercado. Parece que comparar manzanas con manzanas se está volviendo más difícil cada día.

Artículo relacionado

"Dot AI Companion App anuncia su cierre y suspende el servicio personalizado"

Dot, una aplicación de inteligencia artificial diseñada para funcionar como amigo personal y confidente, dejará de funcionar, según anunciaron el viernes sus desarrolladores. New Computer, la empresa

"Dot AI Companion App anuncia su cierre y suspende el servicio personalizado"

Dot, una aplicación de inteligencia artificial diseñada para funcionar como amigo personal y confidente, dejará de funcionar, según anunciaron el viernes sus desarrolladores. New Computer, la empresa

Anthropic resuelve un caso de piratería de libros generados por inteligencia artificial

Anthropic ha llegado a una resolución en un importante litigio sobre derechos de autor con autores estadounidenses, aceptando una propuesta de acuerdo de demanda colectiva que evita un juicio potencia

Anthropic resuelve un caso de piratería de libros generados por inteligencia artificial

Anthropic ha llegado a una resolución en un importante litigio sobre derechos de autor con autores estadounidenses, aceptando una propuesta de acuerdo de demanda colectiva que evita un juicio potencia

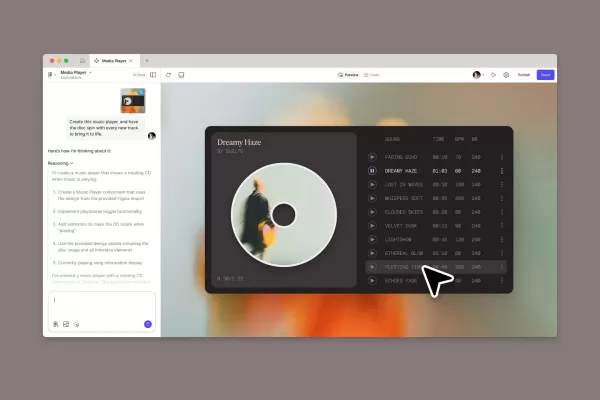

Figma pone a disposición de todos los usuarios su herramienta de creación de aplicaciones basada en inteligencia artificial

Figma Make, la innovadora plataforma de desarrollo "prompt-to-app" presentada a principios de este año, ha salido oficialmente de la fase beta y se ha puesto a disposición de todos los usuarios. Esta

comentario (6)

0/200

Figma pone a disposición de todos los usuarios su herramienta de creación de aplicaciones basada en inteligencia artificial

Figma Make, la innovadora plataforma de desarrollo "prompt-to-app" presentada a principios de este año, ha salido oficialmente de la fase beta y se ha puesto a disposición de todos los usuarios. Esta

comentario (6)

0/200

![DouglasMartínez]() DouglasMartínez

DouglasMartínez

6 de agosto de 2025 19:01:00 GMT+02:00

6 de agosto de 2025 19:01:00 GMT+02:00

Whoa, AI playing Pokémon? That's wild! I wonder if Gemini's got a secret Pikachu strategy or just brute-forced its way through. Gotta catch 'em all, I guess! ⚡️

0

0

![JasonKing]() JasonKing

JasonKing

5 de mayo de 2025 13:38:52 GMT+02:00

5 de mayo de 2025 13:38:52 GMT+02:00

Debates over AI benchmarking in Pokémon? That's wild! I never thought I'd see the day when AI models are compared using Pokémon games. It's fun but kinda confusing. Can someone explain how Gemini outpaced Claude? 🤯

0

0

![NicholasAdams]() NicholasAdams

NicholasAdams

5 de mayo de 2025 01:11:33 GMT+02:00

5 de mayo de 2025 01:11:33 GMT+02:00

ポケモンでAIのベンチマークを議論するなんて、信じられない!AIモデルがポケモンのゲームで比較される日が来るなんて思わなかった。面白いけど、ちょっと混乱する。ジェミニがクロードをどうやって追い越したのか、誰か説明してくれない?🤯

0

0

![WalterThomas]() WalterThomas

WalterThomas

4 de mayo de 2025 17:05:10 GMT+02:00

4 de mayo de 2025 17:05:10 GMT+02:00

पोकेमॉन में AI बेंचमार्किंग पर बहस? यह तो पागलपन है! मुझे कभी नहीं लगा था कि मैं AI मॉडल्स को पोकेमॉन गेम्स का उपयोग करके तुलना करते हुए देखूंगा। यह मजेदार है लेकिन थोड़ा भ्रमित करने वाला है। कोई बता सकता है कि जेमिनी ने क्लॉड को कैसे पछाड़ा? 🤯

0

0

![AlbertThomas]() AlbertThomas

AlbertThomas

4 de mayo de 2025 08:38:28 GMT+02:00

4 de mayo de 2025 08:38:28 GMT+02:00

포켓몬에서 AI 벤치마킹 논쟁이라니, 이건 정말 놀랍네요! AI 모델이 포켓몬 게임으로 비교될 날이 올 줄은 몰랐어요. 재미있지만 조금 헷갈려요. 제미니가 클로드를 어떻게 앞질렀는지 설명해줄 수 있는 분? 🤯

0

0

![CharlesRoberts]() CharlesRoberts

CharlesRoberts

3 de mayo de 2025 21:01:44 GMT+02:00

3 de mayo de 2025 21:01:44 GMT+02:00

Debates sobre benchmarking de IA em Pokémon? Isso é loucura! Nunca pensei que veria o dia em que modelos de IA seriam comparados usando jogos de Pokémon. É divertido, mas um pouco confuso. Alguém pode explicar como o Gemini superou o Claude? 🤯

0

0

Incluso el amado mundo de Pokémon no es inmune al drama que rodea los puntos de referencia de IA. Una reciente publicación viral en X generó bastante revuelo, afirmando que el último modelo Gemini de Google había superado al modelo líder Claude de Anthropic en la clásica trilogía de videojuegos de Pokémon. Según la publicación, Gemini había llegado impresionantemente a Pueblo Lavanda en una transmisión de Twitch de un desarrollador, mientras que Claude se quedaba atrás en Monte Luna a finales de febrero.

Gemini está literalmente por delante de Claude en este momento en Pokémon tras llegar a Pueblo Lavanda

Solo 119 espectadores en vivo, por cierto, una transmisión increíblemente subestimada pic.twitter.com/8AvSovAI4x

— Jush (@Jush21e8) 10 de abril de 2025

Sin embargo, lo que esta publicación omitió convenientemente fue el hecho de que Gemini tenía una ventaja algo injusta. Usuarios astutos en Reddit señalaron rápidamente que el desarrollador detrás de la transmisión de Gemini había creado un minimapa personalizado. Esta ingeniosa herramienta ayuda al modelo a reconocer "tiles" en el juego, como árboles cortables, lo que reduce significativamente el tiempo que Gemini necesita para analizar capturas de pantalla antes de decidir su próximo movimiento.

Ahora, aunque Pokémon no sea el punto de referencia de IA más serio que existe, sirve como un ejemplo divertido pero revelador de cómo diferentes configuraciones pueden sesgar los resultados de estas pruebas. Tomemos, por ejemplo, el reciente modelo de Anthropic, Anthropic 3.7 Sonnet. En el punto de referencia SWE-bench Verified, que está destinado a probar la destreza en codificación, obtuvo una precisión del 62.3%. Pero, con un "andamiaje personalizado" que Anthropic diseñó, esa puntuación saltó al 70.3%.

Y no termina ahí. Meta tomó uno de sus modelos más nuevos, Llama 4 Maverick, y lo ajustó específicamente para el punto de referencia LM Arena. La versión básica del modelo no tuvo un desempeño tan bueno en la misma prueba.

Dado que los puntos de referencia de IA, incluyendo nuestro amigable ejemplo de Pokémon, ya son algo impredecibles, estos ajustes personalizados y enfoques no estándar solo hacen que sea aún más complicado realizar comparaciones significativas entre modelos a medida que llegan al mercado. Parece que comparar manzanas con manzanas se está volviendo más difícil cada día.

Anthropic resuelve un caso de piratería de libros generados por inteligencia artificial

Anthropic ha llegado a una resolución en un importante litigio sobre derechos de autor con autores estadounidenses, aceptando una propuesta de acuerdo de demanda colectiva que evita un juicio potencia

Anthropic resuelve un caso de piratería de libros generados por inteligencia artificial

Anthropic ha llegado a una resolución en un importante litigio sobre derechos de autor con autores estadounidenses, aceptando una propuesta de acuerdo de demanda colectiva que evita un juicio potencia

Figma pone a disposición de todos los usuarios su herramienta de creación de aplicaciones basada en inteligencia artificial

Figma Make, la innovadora plataforma de desarrollo "prompt-to-app" presentada a principios de este año, ha salido oficialmente de la fase beta y se ha puesto a disposición de todos los usuarios. Esta

Figma pone a disposición de todos los usuarios su herramienta de creación de aplicaciones basada en inteligencia artificial

Figma Make, la innovadora plataforma de desarrollo "prompt-to-app" presentada a principios de este año, ha salido oficialmente de la fase beta y se ha puesto a disposición de todos los usuarios. Esta

6 de agosto de 2025 19:01:00 GMT+02:00

6 de agosto de 2025 19:01:00 GMT+02:00

Whoa, AI playing Pokémon? That's wild! I wonder if Gemini's got a secret Pikachu strategy or just brute-forced its way through. Gotta catch 'em all, I guess! ⚡️

0

0

5 de mayo de 2025 13:38:52 GMT+02:00

5 de mayo de 2025 13:38:52 GMT+02:00

Debates over AI benchmarking in Pokémon? That's wild! I never thought I'd see the day when AI models are compared using Pokémon games. It's fun but kinda confusing. Can someone explain how Gemini outpaced Claude? 🤯

0

0

5 de mayo de 2025 01:11:33 GMT+02:00

5 de mayo de 2025 01:11:33 GMT+02:00

ポケモンでAIのベンチマークを議論するなんて、信じられない!AIモデルがポケモンのゲームで比較される日が来るなんて思わなかった。面白いけど、ちょっと混乱する。ジェミニがクロードをどうやって追い越したのか、誰か説明してくれない?🤯

0

0

4 de mayo de 2025 17:05:10 GMT+02:00

4 de mayo de 2025 17:05:10 GMT+02:00

पोकेमॉन में AI बेंचमार्किंग पर बहस? यह तो पागलपन है! मुझे कभी नहीं लगा था कि मैं AI मॉडल्स को पोकेमॉन गेम्स का उपयोग करके तुलना करते हुए देखूंगा। यह मजेदार है लेकिन थोड़ा भ्रमित करने वाला है। कोई बता सकता है कि जेमिनी ने क्लॉड को कैसे पछाड़ा? 🤯

0

0

4 de mayo de 2025 08:38:28 GMT+02:00

4 de mayo de 2025 08:38:28 GMT+02:00

포켓몬에서 AI 벤치마킹 논쟁이라니, 이건 정말 놀랍네요! AI 모델이 포켓몬 게임으로 비교될 날이 올 줄은 몰랐어요. 재미있지만 조금 헷갈려요. 제미니가 클로드를 어떻게 앞질렀는지 설명해줄 수 있는 분? 🤯

0

0

3 de mayo de 2025 21:01:44 GMT+02:00

3 de mayo de 2025 21:01:44 GMT+02:00

Debates sobre benchmarking de IA em Pokémon? Isso é loucura! Nunca pensei que veria o dia em que modelos de IA seriam comparados usando jogos de Pokémon. É divertido, mas um pouco confuso. Alguém pode explicar como o Gemini superou o Claude? 🤯

0

0