TechSpert erklärt: CPU vs. GPU vs. TPU -Unterschiede

Bereits im Mai bei I/O haben wir Trillium vorgestellt, die sechste Generation unseres speziell entwickelten Chips namens Tensor Processing Unit, oder TPU. Heute freuen wir uns, mitteilen zu können, dass es nun in der Vorschau für Google Cloud-Kunden verfügbar ist. TPUs sind die Magie hinter der KI, die Ihre Google-Geräte und -Apps so hilfreich macht, und Trillium ist der leistungsstärkste und umweltfreundlichste TPU, den wir je gebaut haben.

Also, was ist ein TPU, und was macht Trillium einzigartig? Um das Gesamtbild zu verstehen, ist es hilfreich, etwas über andere Arten von Rechenprozessoren wie CPUs und GPUs zu wissen und was sie unterscheidet. Chelsie Czop, eine Produktmanagerin, die bei Google Cloud an der KI-Infrastruktur arbeitet, kann alles erklären. „Ich arbeite mit verschiedenen Teams zusammen, um sicherzustellen, dass unsere Plattformen so effizient wie möglich für unsere Kunden sind, die KI-Produkte entwickeln“, sagt sie. Und laut Chelsie sind Googles TPUs ein großer Grund, warum unsere KI-Produkte so effektiv sind.

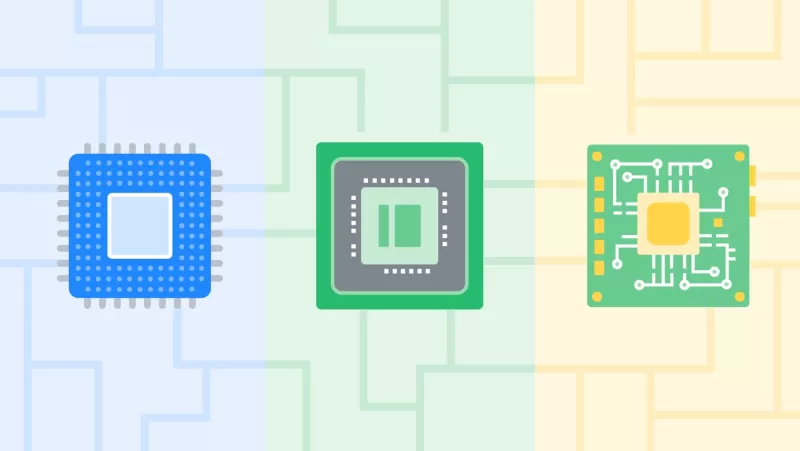

Lassen Sie uns in die Grundlagen eintauchen! Was sind CPUs, GPUs und TPUs?

Das sind alles Chips, die als Prozessoren für Rechenaufgaben fungieren. Stellen Sie sich Ihr Gehirn als einen Computer vor, der Dinge wie Lesen oder das Lösen von Mathematikproblemen erledigt. Jede dieser Aktivitäten ist wie eine Rechenaufgabe. Wenn Sie also Ihr Telefon benutzen, um ein Foto zu machen, eine Nachricht zu senden oder eine App zu öffnen, übernimmt das Gehirn Ihres Telefons, oder der Prozessor, diese Aufgaben.

Was bedeuten diese Abkürzungen?

Obwohl CPUs, GPUs und TPUs alle Prozessoren sind, werden sie immer spezialisierter. CPU steht für Central Processing Unit. Das sind vielseitige Chips, die eine Vielzahl von Aufgaben bewältigen können. Ähnlich wie Ihr Gehirn können einige Aufgaben länger dauern, wenn die CPU nicht darauf spezialisiert ist.

Als Nächstes kommt die GPU, oder Graphics Processing Unit. GPUs sind die Kraftwerke für beschleunigte Rechenaufgaben, von der Darstellung von Grafiken bis hin zur Ausführung von KI-Workloads. Sie sind eine Art ASIC, oder anwendungsspezifischer integrierter Schaltkreis. Integrierte Schaltkreise bestehen meist aus Silizium, weshalb Sie Chips manchmal als „Silizium“ bezeichnet hören – das ist dasselbe (und ja, daher kommt der Name „Silicon Valley“!). Kurz gesagt, ASICs sind für einen spezifischen Zweck entwickelt.

Die TPU, oder Tensor Processing Unit, ist Googles eigener ASIC. Wir haben TPUs von Grund auf entwickelt, um KI-basierte Rechenaufgaben zu bewältigen, was sie noch spezialisierter macht als CPUs und GPUs. TPUs stehen im Kern einiger der beliebtesten KI-Dienste von Google, einschließlich Search, YouTube und den großen Sprachmodellen von DeepMind.

Verstanden, also sind diese Chips das, was unsere Geräte antreibt. Wo finde ich CPUs, GPUs und TPUs?

CPUs und GPUs findet man in alltäglichen Gegenständen: CPUs sind in fast jedem Smartphone und Laptop, während GPUs in High-End-Gaming-Systemen und einigen Desktop-Computern üblich sind. TPUs hingegen findet man nur in Google-Rechenzentren – riesigen Gebäuden voller TPU-Racks, die rund um die Uhr arbeiten, um Googles und die KI-Dienste unserer Cloud-Kunden weltweit am Laufen zu halten.

Was hat Google dazu veranlasst, mit der Entwicklung von TPUs zu beginnen?

CPUs wurden in den späten 1950er Jahren erfunden, und GPUs kamen in den späten 90ern auf. Bei Google begannen wir vor etwa einem Jahrzehnt über TPUs nachzudenken. Unsere Spracherkennungsdienste verbesserten sich rasant, und uns wurde klar, dass wir unsere Rechenzentrumscomputer verdoppeln müssten, wenn jeder Nutzer nur drei Minuten am Tag mit Google sprechen würde. Wir wussten, dass wir etwas weitaus Effizienteres als die damals verfügbare Standard-Hardware brauchten – und wir brauchten viel mehr Rechenleistung von jedem Chip. Also beschlossen wir, unsere eigenen zu bauen!

Und dieses „T“ steht für Tensor, richtig? Warum?

Ja – ein „Tensor“ ist der allgemeine Begriff für die Datenstrukturen, die im maschinellen Lernen verwendet werden. Es gibt eine Menge Mathematik, die im Hintergrund abläuft, um KI-Aufgaben zu ermöglichen. Mit unserem neuesten TPU, Trillium, haben wir die Anzahl der Berechnungen erhöht, die er durchführen kann: Trillium hat eine 4,7-fache Spitzenrechenleistung pro Chip im Vergleich zur vorherigen Generation, TPU v5e.

Was bedeutet das genau?

Das bedeutet, dass Trillium alle Berechnungen, die für komplexe Mathematik benötigt werden, 4,7-mal schneller bewältigen kann als die letzte Version. Trillium ist nicht nur schneller, sondern kann auch größere, komplexere Workloads verwalten.

Gibt es noch etwas, das es im Vergleich zu unserem TPU der letzten Generation verbessert?

Eine weitere große Verbesserung bei Trillium ist, dass es unser bisher nachhaltigster TPU ist – er ist 67 % energieeffizienter als unser vorheriger TPU. Da die Nachfrage nach KI weiter wächst, muss die Industrie die Infrastruktur nachhaltig skalieren. Trillium verbraucht weniger Energie für die gleiche Arbeit.

Jetzt, da Kunden beginnen, ihn zu nutzen, welche Auswirkungen wird Trillium Ihrer Meinung nach haben?

Wir sehen bereits einige erstaunliche Dinge, die von Trillium angetrieben werden! Kunden nutzen ihn für Technologien, die RNA für verschiedene Krankheiten analysieren, Text in Video mit Blitzgeschwindigkeit umwandeln und mehr. Und das sind nur unsere ersten Nutzer – jetzt, da Trillium in der Vorschau ist, sind wir gespannt, was die Leute damit machen werden.

Verwandter Artikel

Kakao Mobility stellt einen Fahrplan für autonomes Fahren der Stufe 4 im Bereich der physischen KI vor

Kakao Mobility plant, im Rahmen seiner Strategie für physische KI Technologien für autonomes Fahren der Stufe 4 intern zu entwickeln.Auf der Konferenz „World IT Show 2026“ im COEX in Seoul stellte Ki

Kakao Mobility stellt einen Fahrplan für autonomes Fahren der Stufe 4 im Bereich der physischen KI vor

Kakao Mobility plant, im Rahmen seiner Strategie für physische KI Technologien für autonomes Fahren der Stufe 4 intern zu entwickeln.Auf der Konferenz „World IT Show 2026“ im COEX in Seoul stellte Ki

Barry Diller: Das Vertrauen in Sam Altman spielt keine Rolle, da die allgemeine künstliche Intelligenz (AGI) immer näher rückt

Barry Diller, der milliardenschwere Medienmogul, hält OpenAI-CEO Sam Altman nicht für unglaubwürdig, obwohl jüngste Berichte das Gegenteil nahelegen. Bei seiner Rede auf der „Future of Everything“-Kon

Barry Diller: Das Vertrauen in Sam Altman spielt keine Rolle, da die allgemeine künstliche Intelligenz (AGI) immer näher rückt

Barry Diller, der milliardenschwere Medienmogul, hält OpenAI-CEO Sam Altman nicht für unglaubwürdig, obwohl jüngste Berichte das Gegenteil nahelegen. Bei seiner Rede auf der „Future of Everything“-Kon

YouTube weitet die KI-basierte Deepfake-Erkennung auf Politiker, Regierungsvertreter und Journalisten aus

Am Dienstag gab YouTube bekannt, dass es seine Deepfake-Erkennungstechnologie auf eine ausgewählte Gruppe von Regierungsbeamten, politischen Kandidaten und Journalisten ausweiten wird. Das Tool identi

Empfehlungen zu verwandten Spezialthemen

Kommentare (31)

YouTube weitet die KI-basierte Deepfake-Erkennung auf Politiker, Regierungsvertreter und Journalisten aus

Am Dienstag gab YouTube bekannt, dass es seine Deepfake-Erkennungstechnologie auf eine ausgewählte Gruppe von Regierungsbeamten, politischen Kandidaten und Journalisten ausweiten wird. Das Tool identi

Empfehlungen zu verwandten Spezialthemen

Kommentare (31)

![JackWilson]()

Techspert Explains really helped me understand the differences between CPU, GPU, and TPU! The way it breaks down the tech is super clear and engaging. Only wish it had more examples for TPUs, but still a solid tool for tech newbies like me! 🤓

![KennethJohnson]()

Techspert's breakdown of CPU vs. GPU vs. TPU was super helpful! I finally get why my Google stuff runs so smoothly. Trillium sounds like the next big thing, but I wish it was easier to get my hands on it. 🤓💻

![RyanGonzalez]()

Techspert's explanation on CPU vs. GPU vs. TPU was super clear! I finally understand the differences and how TPUs power Google's AI. The only downside was it was a bit too technical for my taste. Still, a must-watch for tech enthusiasts! 💻

![DonaldEvans]()

टेक्स्पर्ट की CPU vs. GPU vs. TPU पर समझाइश बहुत स्पष्ट थी! मैंने अंत में अंतरों को समझा और यह भी जाना कि टीपीयू गूगल की एआई को कैसे शक्ति देते हैं। एकमात्र नकारात्मक पक्ष यह था कि यह मेरे स्वाद के लिए थोड़ा बहुत तकनीकी था। फिर भी, टेक एंथुजियास्ट्स के लिए देखना जरूरी है! 💻

Bereits im Mai bei I/O haben wir Trillium vorgestellt, die sechste Generation unseres speziell entwickelten Chips namens Tensor Processing Unit, oder TPU. Heute freuen wir uns, mitteilen zu können, dass es nun in der Vorschau für Google Cloud-Kunden verfügbar ist. TPUs sind die Magie hinter der KI, die Ihre Google-Geräte und -Apps so hilfreich macht, und Trillium ist der leistungsstärkste und umweltfreundlichste TPU, den wir je gebaut haben.

Also, was ist ein TPU, und was macht Trillium einzigartig? Um das Gesamtbild zu verstehen, ist es hilfreich, etwas über andere Arten von Rechenprozessoren wie CPUs und GPUs zu wissen und was sie unterscheidet. Chelsie Czop, eine Produktmanagerin, die bei Google Cloud an der KI-Infrastruktur arbeitet, kann alles erklären. „Ich arbeite mit verschiedenen Teams zusammen, um sicherzustellen, dass unsere Plattformen so effizient wie möglich für unsere Kunden sind, die KI-Produkte entwickeln“, sagt sie. Und laut Chelsie sind Googles TPUs ein großer Grund, warum unsere KI-Produkte so effektiv sind.

Lassen Sie uns in die Grundlagen eintauchen! Was sind CPUs, GPUs und TPUs?

Das sind alles Chips, die als Prozessoren für Rechenaufgaben fungieren. Stellen Sie sich Ihr Gehirn als einen Computer vor, der Dinge wie Lesen oder das Lösen von Mathematikproblemen erledigt. Jede dieser Aktivitäten ist wie eine Rechenaufgabe. Wenn Sie also Ihr Telefon benutzen, um ein Foto zu machen, eine Nachricht zu senden oder eine App zu öffnen, übernimmt das Gehirn Ihres Telefons, oder der Prozessor, diese Aufgaben.

Was bedeuten diese Abkürzungen?

Obwohl CPUs, GPUs und TPUs alle Prozessoren sind, werden sie immer spezialisierter. CPU steht für Central Processing Unit. Das sind vielseitige Chips, die eine Vielzahl von Aufgaben bewältigen können. Ähnlich wie Ihr Gehirn können einige Aufgaben länger dauern, wenn die CPU nicht darauf spezialisiert ist.

Als Nächstes kommt die GPU, oder Graphics Processing Unit. GPUs sind die Kraftwerke für beschleunigte Rechenaufgaben, von der Darstellung von Grafiken bis hin zur Ausführung von KI-Workloads. Sie sind eine Art ASIC, oder anwendungsspezifischer integrierter Schaltkreis. Integrierte Schaltkreise bestehen meist aus Silizium, weshalb Sie Chips manchmal als „Silizium“ bezeichnet hören – das ist dasselbe (und ja, daher kommt der Name „Silicon Valley“!). Kurz gesagt, ASICs sind für einen spezifischen Zweck entwickelt.

Die TPU, oder Tensor Processing Unit, ist Googles eigener ASIC. Wir haben TPUs von Grund auf entwickelt, um KI-basierte Rechenaufgaben zu bewältigen, was sie noch spezialisierter macht als CPUs und GPUs. TPUs stehen im Kern einiger der beliebtesten KI-Dienste von Google, einschließlich Search, YouTube und den großen Sprachmodellen von DeepMind.

Verstanden, also sind diese Chips das, was unsere Geräte antreibt. Wo finde ich CPUs, GPUs und TPUs?

CPUs und GPUs findet man in alltäglichen Gegenständen: CPUs sind in fast jedem Smartphone und Laptop, während GPUs in High-End-Gaming-Systemen und einigen Desktop-Computern üblich sind. TPUs hingegen findet man nur in Google-Rechenzentren – riesigen Gebäuden voller TPU-Racks, die rund um die Uhr arbeiten, um Googles und die KI-Dienste unserer Cloud-Kunden weltweit am Laufen zu halten.

Was hat Google dazu veranlasst, mit der Entwicklung von TPUs zu beginnen?

CPUs wurden in den späten 1950er Jahren erfunden, und GPUs kamen in den späten 90ern auf. Bei Google begannen wir vor etwa einem Jahrzehnt über TPUs nachzudenken. Unsere Spracherkennungsdienste verbesserten sich rasant, und uns wurde klar, dass wir unsere Rechenzentrumscomputer verdoppeln müssten, wenn jeder Nutzer nur drei Minuten am Tag mit Google sprechen würde. Wir wussten, dass wir etwas weitaus Effizienteres als die damals verfügbare Standard-Hardware brauchten – und wir brauchten viel mehr Rechenleistung von jedem Chip. Also beschlossen wir, unsere eigenen zu bauen!

Und dieses „T“ steht für Tensor, richtig? Warum?

Ja – ein „Tensor“ ist der allgemeine Begriff für die Datenstrukturen, die im maschinellen Lernen verwendet werden. Es gibt eine Menge Mathematik, die im Hintergrund abläuft, um KI-Aufgaben zu ermöglichen. Mit unserem neuesten TPU, Trillium, haben wir die Anzahl der Berechnungen erhöht, die er durchführen kann: Trillium hat eine 4,7-fache Spitzenrechenleistung pro Chip im Vergleich zur vorherigen Generation, TPU v5e.

Was bedeutet das genau?

Das bedeutet, dass Trillium alle Berechnungen, die für komplexe Mathematik benötigt werden, 4,7-mal schneller bewältigen kann als die letzte Version. Trillium ist nicht nur schneller, sondern kann auch größere, komplexere Workloads verwalten.

Gibt es noch etwas, das es im Vergleich zu unserem TPU der letzten Generation verbessert?

Eine weitere große Verbesserung bei Trillium ist, dass es unser bisher nachhaltigster TPU ist – er ist 67 % energieeffizienter als unser vorheriger TPU. Da die Nachfrage nach KI weiter wächst, muss die Industrie die Infrastruktur nachhaltig skalieren. Trillium verbraucht weniger Energie für die gleiche Arbeit.

Jetzt, da Kunden beginnen, ihn zu nutzen, welche Auswirkungen wird Trillium Ihrer Meinung nach haben?

Wir sehen bereits einige erstaunliche Dinge, die von Trillium angetrieben werden! Kunden nutzen ihn für Technologien, die RNA für verschiedene Krankheiten analysieren, Text in Video mit Blitzgeschwindigkeit umwandeln und mehr. Und das sind nur unsere ersten Nutzer – jetzt, da Trillium in der Vorschau ist, sind wir gespannt, was die Leute damit machen werden.

Barry Diller: Das Vertrauen in Sam Altman spielt keine Rolle, da die allgemeine künstliche Intelligenz (AGI) immer näher rückt

Barry Diller, der milliardenschwere Medienmogul, hält OpenAI-CEO Sam Altman nicht für unglaubwürdig, obwohl jüngste Berichte das Gegenteil nahelegen. Bei seiner Rede auf der „Future of Everything“-Kon

Barry Diller: Das Vertrauen in Sam Altman spielt keine Rolle, da die allgemeine künstliche Intelligenz (AGI) immer näher rückt

Barry Diller, der milliardenschwere Medienmogul, hält OpenAI-CEO Sam Altman nicht für unglaubwürdig, obwohl jüngste Berichte das Gegenteil nahelegen. Bei seiner Rede auf der „Future of Everything“-Kon

YouTube weitet die KI-basierte Deepfake-Erkennung auf Politiker, Regierungsvertreter und Journalisten aus

Am Dienstag gab YouTube bekannt, dass es seine Deepfake-Erkennungstechnologie auf eine ausgewählte Gruppe von Regierungsbeamten, politischen Kandidaten und Journalisten ausweiten wird. Das Tool identi

YouTube weitet die KI-basierte Deepfake-Erkennung auf Politiker, Regierungsvertreter und Journalisten aus

Am Dienstag gab YouTube bekannt, dass es seine Deepfake-Erkennungstechnologie auf eine ausgewählte Gruppe von Regierungsbeamten, politischen Kandidaten und Journalisten ausweiten wird. Das Tool identi

Techspert Explains really helped me understand the differences between CPU, GPU, and TPU! The way it breaks down the tech is super clear and engaging. Only wish it had more examples for TPUs, but still a solid tool for tech newbies like me! 🤓

Techspert's breakdown of CPU vs. GPU vs. TPU was super helpful! I finally get why my Google stuff runs so smoothly. Trillium sounds like the next big thing, but I wish it was easier to get my hands on it. 🤓💻

Techspert's explanation on CPU vs. GPU vs. TPU was super clear! I finally understand the differences and how TPUs power Google's AI. The only downside was it was a bit too technical for my taste. Still, a must-watch for tech enthusiasts! 💻

टेक्स्पर्ट की CPU vs. GPU vs. TPU पर समझाइश बहुत स्पष्ट थी! मैंने अंत में अंतरों को समझा और यह भी जाना कि टीपीयू गूगल की एआई को कैसे शक्ति देते हैं। एकमात्र नकारात्मक पक्ष यह था कि यह मेरे स्वाद के लिए थोड़ा बहुत तकनीकी था। फिर भी, टेक एंथुजियास्ट्स के लिए देखना जरूरी है! 💻

Heim

Heim