Debatten über AI -Benchmarking haben Pokémon erreicht

Selbst die geliebte Welt von Pokémon ist nicht immun gegen das Drama rund um KI-Benchmarks. Ein kürzlich viral gegangener Beitrag auf X sorgte für ziemlichen Aufruhr und behauptete, dass Googles neuestes Gemini-Modell das führende Claude-Modell von Anthropic in der klassischen Pokémon-Videospiel-Trilogie überholt habe. Laut dem Beitrag hatte Gemini beeindruckend Lavendelstadt in einem Entwickler-Twitch-Stream erreicht, während Claude Ende Februar noch am Mondberg hinterherhinkte.

Gemini ist derzeit in Pokémon vor Claude, nachdem es Lavendelstadt erreicht hat

Nur 119 Live-Zuschauer übrigens, unglaublich unterschätzter Stream pic.twitter.com/8AvSovAI4x

— Jush (@Jush21e8) 10. April 2025

Was dieser Beitrag jedoch bequem ausließ, war die Tatsache, dass Gemini einen kleinen unfairen Vorteil hatte. Schlaue Nutzer auf Reddit wiesen schnell darauf hin, dass der Entwickler hinter dem Gemini-Stream eine benutzerdefinierte Minikarte erstellt hatte. Dieses praktische Werkzeug hilft dem Modell, „Kacheln“ im Spiel, wie z. B. schneidbare Bäume, zu erkennen, was die Zeit, die Gemini für die Analyse von Screenshots benötigt, bevor es den nächsten Zug entscheidet, erheblich verkürzt.

Nun, Pokémon mag nicht der ernsthafteste KI-Benchmark sein, aber es dient als unterhaltsames und dennoch aufschlussreiches Beispiel dafür, wie unterschiedliche Setups die Ergebnisse dieser Tests verzerren können. Nehmen wir zum Beispiel das neueste Modell von Anthropic, Anthropic 3.7 Sonnet. Auf dem SWE-bench Verified Benchmark, der Programmierfähigkeiten testen soll, erzielte es eine Genauigkeit von 62,3 %. Mit einem „benutzerdefinierten Gerüst“, das Anthropic entwickelt hat, sprang dieser Wert auf 70,3 %.

Und damit nicht genug. Meta nahm eines seiner neueren Modelle, Llama 4 Maverick, und optimierte es speziell für den LM Arena Benchmark. Die Standardversion des Modells schnitt bei demselben Test bei weitem nicht so gut ab.

Angesichts der Tatsache, dass KI-Benchmarks, einschließlich unseres freundlichen Pokémon-Beispiels, bereits etwas unzuverlässig sind, machen diese benutzerdefinierten Anpassungen und nicht standardisierten Ansätze den Vergleich zwischen Modellen, die auf den Markt kommen, noch schwieriger. Es scheint, als würde es immer schwieriger, Äpfel mit Äpfeln zu vergleichen.

Verwandter Artikel

"Dot AI Companion App kündigt Schließung an, stellt personalisierten Service ein"

Dot, eine KI-Begleitanwendung, die als persönlicher Freund und Vertrauter fungieren soll, wird laut einer Ankündigung seiner Entwickler vom Freitag seinen Betrieb einstellen. New Computer, das Startup

"Dot AI Companion App kündigt Schließung an, stellt personalisierten Service ein"

Dot, eine KI-Begleitanwendung, die als persönlicher Freund und Vertrauter fungieren soll, wird laut einer Ankündigung seiner Entwickler vom Freitag seinen Betrieb einstellen. New Computer, das Startup

Anthropic löst Rechtsstreit über AI-generierte Buchpiraterie

Anthropic hat einen bedeutenden Urheberrechtsstreit mit US-Autoren beigelegt. Das Unternehmen hat einer vorgeschlagenen Sammelklage zugestimmt, mit der ein potenziell kostspieliger Prozess vermieden w

Anthropic löst Rechtsstreit über AI-generierte Buchpiraterie

Anthropic hat einen bedeutenden Urheberrechtsstreit mit US-Autoren beigelegt. Das Unternehmen hat einer vorgeschlagenen Sammelklage zugestimmt, mit der ein potenziell kostspieliger Prozess vermieden w

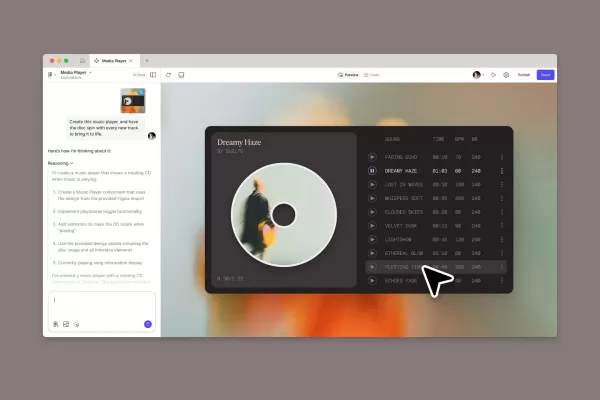

Figma veröffentlicht AI-gestütztes App Builder Tool für alle Benutzer

Figma Make, die innovative Prompt-to-App-Entwicklungsplattform, die Anfang des Jahres vorgestellt wurde, hat offiziell die Beta-Phase verlassen und ist für alle Nutzer verfügbar. Dieses bahnbrechende

Kommentare (6)

0/200

Figma veröffentlicht AI-gestütztes App Builder Tool für alle Benutzer

Figma Make, die innovative Prompt-to-App-Entwicklungsplattform, die Anfang des Jahres vorgestellt wurde, hat offiziell die Beta-Phase verlassen und ist für alle Nutzer verfügbar. Dieses bahnbrechende

Kommentare (6)

0/200

![DouglasMartínez]() DouglasMartínez

DouglasMartínez

6. August 2025 19:01:00 MESZ

6. August 2025 19:01:00 MESZ

Whoa, AI playing Pokémon? That's wild! I wonder if Gemini's got a secret Pikachu strategy or just brute-forced its way through. Gotta catch 'em all, I guess! ⚡️

0

0

![JasonKing]() JasonKing

JasonKing

5. Mai 2025 13:38:52 MESZ

5. Mai 2025 13:38:52 MESZ

Debates over AI benchmarking in Pokémon? That's wild! I never thought I'd see the day when AI models are compared using Pokémon games. It's fun but kinda confusing. Can someone explain how Gemini outpaced Claude? 🤯

0

0

![NicholasAdams]() NicholasAdams

NicholasAdams

5. Mai 2025 01:11:33 MESZ

5. Mai 2025 01:11:33 MESZ

ポケモンでAIのベンチマークを議論するなんて、信じられない!AIモデルがポケモンのゲームで比較される日が来るなんて思わなかった。面白いけど、ちょっと混乱する。ジェミニがクロードをどうやって追い越したのか、誰か説明してくれない?🤯

0

0

![WalterThomas]() WalterThomas

WalterThomas

4. Mai 2025 17:05:10 MESZ

4. Mai 2025 17:05:10 MESZ

पोकेमॉन में AI बेंचमार्किंग पर बहस? यह तो पागलपन है! मुझे कभी नहीं लगा था कि मैं AI मॉडल्स को पोकेमॉन गेम्स का उपयोग करके तुलना करते हुए देखूंगा। यह मजेदार है लेकिन थोड़ा भ्रमित करने वाला है। कोई बता सकता है कि जेमिनी ने क्लॉड को कैसे पछाड़ा? 🤯

0

0

![AlbertThomas]() AlbertThomas

AlbertThomas

4. Mai 2025 08:38:28 MESZ

4. Mai 2025 08:38:28 MESZ

포켓몬에서 AI 벤치마킹 논쟁이라니, 이건 정말 놀랍네요! AI 모델이 포켓몬 게임으로 비교될 날이 올 줄은 몰랐어요. 재미있지만 조금 헷갈려요. 제미니가 클로드를 어떻게 앞질렀는지 설명해줄 수 있는 분? 🤯

0

0

![CharlesRoberts]() CharlesRoberts

CharlesRoberts

3. Mai 2025 21:01:44 MESZ

3. Mai 2025 21:01:44 MESZ

Debates sobre benchmarking de IA em Pokémon? Isso é loucura! Nunca pensei que veria o dia em que modelos de IA seriam comparados usando jogos de Pokémon. É divertido, mas um pouco confuso. Alguém pode explicar como o Gemini superou o Claude? 🤯

0

0

Selbst die geliebte Welt von Pokémon ist nicht immun gegen das Drama rund um KI-Benchmarks. Ein kürzlich viral gegangener Beitrag auf X sorgte für ziemlichen Aufruhr und behauptete, dass Googles neuestes Gemini-Modell das führende Claude-Modell von Anthropic in der klassischen Pokémon-Videospiel-Trilogie überholt habe. Laut dem Beitrag hatte Gemini beeindruckend Lavendelstadt in einem Entwickler-Twitch-Stream erreicht, während Claude Ende Februar noch am Mondberg hinterherhinkte.

Gemini ist derzeit in Pokémon vor Claude, nachdem es Lavendelstadt erreicht hat

Nur 119 Live-Zuschauer übrigens, unglaublich unterschätzter Stream pic.twitter.com/8AvSovAI4x

— Jush (@Jush21e8) 10. April 2025

Was dieser Beitrag jedoch bequem ausließ, war die Tatsache, dass Gemini einen kleinen unfairen Vorteil hatte. Schlaue Nutzer auf Reddit wiesen schnell darauf hin, dass der Entwickler hinter dem Gemini-Stream eine benutzerdefinierte Minikarte erstellt hatte. Dieses praktische Werkzeug hilft dem Modell, „Kacheln“ im Spiel, wie z. B. schneidbare Bäume, zu erkennen, was die Zeit, die Gemini für die Analyse von Screenshots benötigt, bevor es den nächsten Zug entscheidet, erheblich verkürzt.

Nun, Pokémon mag nicht der ernsthafteste KI-Benchmark sein, aber es dient als unterhaltsames und dennoch aufschlussreiches Beispiel dafür, wie unterschiedliche Setups die Ergebnisse dieser Tests verzerren können. Nehmen wir zum Beispiel das neueste Modell von Anthropic, Anthropic 3.7 Sonnet. Auf dem SWE-bench Verified Benchmark, der Programmierfähigkeiten testen soll, erzielte es eine Genauigkeit von 62,3 %. Mit einem „benutzerdefinierten Gerüst“, das Anthropic entwickelt hat, sprang dieser Wert auf 70,3 %.

Und damit nicht genug. Meta nahm eines seiner neueren Modelle, Llama 4 Maverick, und optimierte es speziell für den LM Arena Benchmark. Die Standardversion des Modells schnitt bei demselben Test bei weitem nicht so gut ab.

Angesichts der Tatsache, dass KI-Benchmarks, einschließlich unseres freundlichen Pokémon-Beispiels, bereits etwas unzuverlässig sind, machen diese benutzerdefinierten Anpassungen und nicht standardisierten Ansätze den Vergleich zwischen Modellen, die auf den Markt kommen, noch schwieriger. Es scheint, als würde es immer schwieriger, Äpfel mit Äpfeln zu vergleichen.

Anthropic löst Rechtsstreit über AI-generierte Buchpiraterie

Anthropic hat einen bedeutenden Urheberrechtsstreit mit US-Autoren beigelegt. Das Unternehmen hat einer vorgeschlagenen Sammelklage zugestimmt, mit der ein potenziell kostspieliger Prozess vermieden w

Anthropic löst Rechtsstreit über AI-generierte Buchpiraterie

Anthropic hat einen bedeutenden Urheberrechtsstreit mit US-Autoren beigelegt. Das Unternehmen hat einer vorgeschlagenen Sammelklage zugestimmt, mit der ein potenziell kostspieliger Prozess vermieden w

Figma veröffentlicht AI-gestütztes App Builder Tool für alle Benutzer

Figma Make, die innovative Prompt-to-App-Entwicklungsplattform, die Anfang des Jahres vorgestellt wurde, hat offiziell die Beta-Phase verlassen und ist für alle Nutzer verfügbar. Dieses bahnbrechende

Figma veröffentlicht AI-gestütztes App Builder Tool für alle Benutzer

Figma Make, die innovative Prompt-to-App-Entwicklungsplattform, die Anfang des Jahres vorgestellt wurde, hat offiziell die Beta-Phase verlassen und ist für alle Nutzer verfügbar. Dieses bahnbrechende

6. August 2025 19:01:00 MESZ

6. August 2025 19:01:00 MESZ

Whoa, AI playing Pokémon? That's wild! I wonder if Gemini's got a secret Pikachu strategy or just brute-forced its way through. Gotta catch 'em all, I guess! ⚡️

0

0

5. Mai 2025 13:38:52 MESZ

5. Mai 2025 13:38:52 MESZ

Debates over AI benchmarking in Pokémon? That's wild! I never thought I'd see the day when AI models are compared using Pokémon games. It's fun but kinda confusing. Can someone explain how Gemini outpaced Claude? 🤯

0

0

5. Mai 2025 01:11:33 MESZ

5. Mai 2025 01:11:33 MESZ

ポケモンでAIのベンチマークを議論するなんて、信じられない!AIモデルがポケモンのゲームで比較される日が来るなんて思わなかった。面白いけど、ちょっと混乱する。ジェミニがクロードをどうやって追い越したのか、誰か説明してくれない?🤯

0

0

4. Mai 2025 17:05:10 MESZ

4. Mai 2025 17:05:10 MESZ

पोकेमॉन में AI बेंचमार्किंग पर बहस? यह तो पागलपन है! मुझे कभी नहीं लगा था कि मैं AI मॉडल्स को पोकेमॉन गेम्स का उपयोग करके तुलना करते हुए देखूंगा। यह मजेदार है लेकिन थोड़ा भ्रमित करने वाला है। कोई बता सकता है कि जेमिनी ने क्लॉड को कैसे पछाड़ा? 🤯

0

0

4. Mai 2025 08:38:28 MESZ

4. Mai 2025 08:38:28 MESZ

포켓몬에서 AI 벤치마킹 논쟁이라니, 이건 정말 놀랍네요! AI 모델이 포켓몬 게임으로 비교될 날이 올 줄은 몰랐어요. 재미있지만 조금 헷갈려요. 제미니가 클로드를 어떻게 앞질렀는지 설명해줄 수 있는 분? 🤯

0

0

3. Mai 2025 21:01:44 MESZ

3. Mai 2025 21:01:44 MESZ

Debates sobre benchmarking de IA em Pokémon? Isso é loucura! Nunca pensei que veria o dia em que modelos de IA seriam comparados usando jogos de Pokémon. É divertido, mas um pouco confuso. Alguém pode explicar como o Gemini superou o Claude? 🤯

0

0