AI在犯罪报告中的使用:探索了潜在的陷阱

一些美国警察部门使用AI聊天机器人生成犯罪报告是一把双刃剑,既能提高效率,又充满潜在风险。想象一下,将报告撰写时间缩短到几秒钟,正如俄克拉荷马城警察使用基于OpenAI的GPT-4模型的AI工具Draft One所体验的那样。这听起来很革命性,对吧?但正如任何技术飞跃一样,表面之下潜伏着风险。

让我们深入探讨这种技术驱动方法可能出现的问题。首先,像ChatGPT这样的AI系统已知会“产生幻觉”,意味着它们可能生成不完全真实的信息。虽然Draft One背后的公司Axon声称通过调整“创造力旋钮”已缓解这一问题,但我们真的能相信每份报告都准确无误吗?这是一场赌博,而在执法领域,准确性是不容商量的。

目前在俄克拉荷马城,Draft One仅用于处理“轻微”事件,不涉及重罪或暴力犯罪。但其他部门,如科罗拉多州福特柯林斯和印第安纳州拉斐特的警察局,则在大范围使用。这引发了一个警示:如果AI被用于所有案件,我们如何确保技术不会损害这些报告的完整性?

专家的担忧

法律学者安德鲁·弗格森表达了对自动化导致警察撰写报告不够谨慎的担忧。这是一个合理的观点——依赖技术可能让我们变得自满,而在警务工作中,每个细节都很重要。此外,还有一个更广泛的问题,即AI系统可能延续系统性偏见。研究表明,如果不谨慎管理,AI驱动的工具可能在包括招聘在内的各个领域加剧歧视。这种情况会在执法中发生吗?

Axon坚称,Draft One生成的所有报告都必须由人工警官审查和批准,这是防止错误和偏见的保障措施。但这仍然留下了人为错误的余地,而这在警务中已是已知问题。那么AI本身呢?语言学家发现,像GPT-4这样的大型语言模型可能蕴含隐性种族主义,并延续对边缘化语言(如非裔美国英语)的方言偏见。这在确保公平和无偏见的警务工作方面是一个严重问题。

测试与问责

Axon已采取措施解决这些担忧,通过内部研究测试Draft One报告中的种族偏见。他们发现AI生成的报告与原始记录之间没有显著差异。但这就足够了吗?该公司还在探索使用计算机视觉来总结视频片段,尽管首席执行官里克·史密斯承认围绕警务和种族的敏感性,表明对这项技术采取谨慎态度。

尽管有这些努力,AI在警务中的更广泛影响仍是一个问号。Axon的目标是将警察与平民之间的枪支相关死亡人数减少50%,但《华盛顿邮报》的警察枪击数据库显示,自2020年以来,警察杀人的数量有所增加,尽管广泛采用了随身摄像头。这表明技术本身并不能解决复杂的社会问题。

随着更多警察部门考虑采用像Draft One这样的工具,其潜在的好处与风险将继续引发争论。这是一个充满可能但也充满不确定性的迷人时代。关键在于平衡创新与问责,确保AI增强而不是损害执法的完整性。

相关文章

中国网络空间管理局要求对人工智能生成和虚构的短视频进行标注

中国国家互联网信息办公室出台了一项全面计划,旨在规范短视频内容标注,要求各平台提供六项必备标签——包括“AI生成内容”——这标志着短视频治理进入了一个强制透明化的新时代。为解决内容来源不明、难以区分真伪等问题,监管部门在此前与抖音、快手、腾讯、百度等主要平台开展试点的基础上,现已将内容标注作为短视频发布流程中的强制性环节。 发布者必须从六种选项中选择其一:“虚构演绎”、“AI生成”、“含营销信息”

中国网络空间管理局要求对人工智能生成和虚构的短视频进行标注

中国国家互联网信息办公室出台了一项全面计划,旨在规范短视频内容标注,要求各平台提供六项必备标签——包括“AI生成内容”——这标志着短视频治理进入了一个强制透明化的新时代。为解决内容来源不明、难以区分真伪等问题,监管部门在此前与抖音、快手、腾讯、百度等主要平台开展试点的基础上,现已将内容标注作为短视频发布流程中的强制性环节。 发布者必须从六种选项中选择其一:“虚构演绎”、“AI生成”、“含营销信息”

以文本翻译著称的DeepL,如今将目光投向了语音翻译

以文本翻译工具闻名的翻译公司DeepL今日推出了一套语音到语音翻译解决方案,通过定制应用程序,为一线工作人员在会议、移动端和网页对话以及小组讨论等场景中提供支持。 该公司还推出了一款API,允许外部开发者和企业基于DeepL的技术构建定制化解决方案,例如呼叫中心应用。“在专注于文本翻译多年后,语音翻译对我们来说是水到渠成的下一步,”DeepL首席执行官Jarek Kutylowski在接受Tech

以文本翻译著称的DeepL,如今将目光投向了语音翻译

以文本翻译工具闻名的翻译公司DeepL今日推出了一套语音到语音翻译解决方案,通过定制应用程序,为一线工作人员在会议、移动端和网页对话以及小组讨论等场景中提供支持。 该公司还推出了一款API,允许外部开发者和企业基于DeepL的技术构建定制化解决方案,例如呼叫中心应用。“在专注于文本翻译多年后,语音翻译对我们来说是水到渠成的下一步,”DeepL首席执行官Jarek Kutylowski在接受Tech

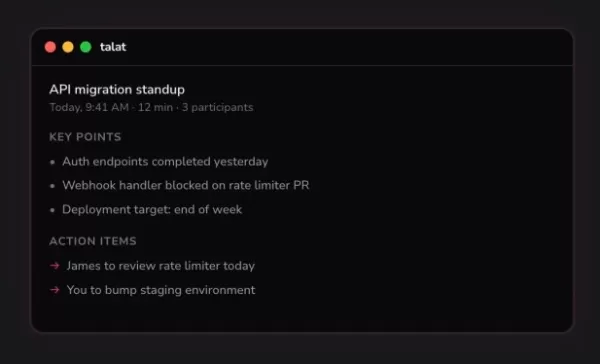

Talat 的 AI 会议记录存储在您的设备上,而非云端

估值达2.5亿美元的AI笔记应用Granola在科技创业者和风险投资家群体中备受追捧。但一位开发者认为,市场需要一款更注重隐私、完全本地化、只需一次性付费且无需订阅的替代方案。这一构想催生了一款名为Talat的新Mac应用。来自英国约克郡的尼克·佩恩(Nick Payne)自称是位计算机极客,他表示开发本地化AI笔记应用的灵感,很大程度上源于一系列幸运的偶然。“我认为Granola非常出色;它充分

相关专题推荐

评论 (33)

0/500

Talat 的 AI 会议记录存储在您的设备上,而非云端

估值达2.5亿美元的AI笔记应用Granola在科技创业者和风险投资家群体中备受追捧。但一位开发者认为,市场需要一款更注重隐私、完全本地化、只需一次性付费且无需订阅的替代方案。这一构想催生了一款名为Talat的新Mac应用。来自英国约克郡的尼克·佩恩(Nick Payne)自称是位计算机极客,他表示开发本地化AI笔记应用的灵感,很大程度上源于一系列幸运的偶然。“我认为Granola非常出色;它充分

相关专题推荐

评论 (33)

0/500

![HarryPerez]()

Полиция использует ИИ для отчетов о преступлениях? 🤔 Это звучит опасно – алгоритмы могут воспроизводить предвзятость и ошибки. Как обычный гражданин, я бы предпочел, чтобы живые офицеры документировали факты, а не доверяли это машинам. Технология – это хорошо, но не для таких важных вещей!

![CharlesWhite]()

¿Reportes policiales escritos por IA? Suena eficiente pero da bastante miedo que un chatbot decida qué detalles incluir o excluir en un caso legal. Un pequeño error o sesgo en los datos podría arruinar una investigación o incluso una vida. La tecnología debe ayudar, no reemplazar el criterio humano en asuntos tan delicados. 🧐 Esperemos que las regulaciones lleguen pronto.

![WalterBaker]()

This AI crime reporting stuff sounds like a game-changer, but I’m skeptical. Can a chatbot really capture the nuance of a crime scene without screwing up details? I mean, efficiency’s great, but if it’s spitting out generic reports, that’s a lawsuit waiting to happen. 😬 Curious to see how they handle the ethical side of this.

![HarryMartínez]()

Die Idee, dass AI Polizeiberichte schreibt, klingt cool, aber auch ein bisschen beängstigend. Was, wenn das AI die Fakten vermasselt? Die Polizei von Oklahoma City scheint dabei zu sein, aber ich bin mir noch nicht sicher, ob ich es vertraue. Braucht mehr Tests, denke ich! 🤔

![AnthonyRoberts]()

Using AI for crime reports sounds cool, but man, the potential for errors is scary! Imagine if the AI messes up and someone gets wrongly accused. Oklahoma City's police are using it, but I'm not sure I trust it yet. Maybe with more testing, it could be safer? 🤔👮♂️

一些美国警察部门使用AI聊天机器人生成犯罪报告是一把双刃剑,既能提高效率,又充满潜在风险。想象一下,将报告撰写时间缩短到几秒钟,正如俄克拉荷马城警察使用基于OpenAI的GPT-4模型的AI工具Draft One所体验的那样。这听起来很革命性,对吧?但正如任何技术飞跃一样,表面之下潜伏着风险。

让我们深入探讨这种技术驱动方法可能出现的问题。首先,像ChatGPT这样的AI系统已知会“产生幻觉”,意味着它们可能生成不完全真实的信息。虽然Draft One背后的公司Axon声称通过调整“创造力旋钮”已缓解这一问题,但我们真的能相信每份报告都准确无误吗?这是一场赌博,而在执法领域,准确性是不容商量的。

目前在俄克拉荷马城,Draft One仅用于处理“轻微”事件,不涉及重罪或暴力犯罪。但其他部门,如科罗拉多州福特柯林斯和印第安纳州拉斐特的警察局,则在大范围使用。这引发了一个警示:如果AI被用于所有案件,我们如何确保技术不会损害这些报告的完整性?

专家的担忧

法律学者安德鲁·弗格森表达了对自动化导致警察撰写报告不够谨慎的担忧。这是一个合理的观点——依赖技术可能让我们变得自满,而在警务工作中,每个细节都很重要。此外,还有一个更广泛的问题,即AI系统可能延续系统性偏见。研究表明,如果不谨慎管理,AI驱动的工具可能在包括招聘在内的各个领域加剧歧视。这种情况会在执法中发生吗?

Axon坚称,Draft One生成的所有报告都必须由人工警官审查和批准,这是防止错误和偏见的保障措施。但这仍然留下了人为错误的余地,而这在警务中已是已知问题。那么AI本身呢?语言学家发现,像GPT-4这样的大型语言模型可能蕴含隐性种族主义,并延续对边缘化语言(如非裔美国英语)的方言偏见。这在确保公平和无偏见的警务工作方面是一个严重问题。

测试与问责

Axon已采取措施解决这些担忧,通过内部研究测试Draft One报告中的种族偏见。他们发现AI生成的报告与原始记录之间没有显著差异。但这就足够了吗?该公司还在探索使用计算机视觉来总结视频片段,尽管首席执行官里克·史密斯承认围绕警务和种族的敏感性,表明对这项技术采取谨慎态度。

尽管有这些努力,AI在警务中的更广泛影响仍是一个问号。Axon的目标是将警察与平民之间的枪支相关死亡人数减少50%,但《华盛顿邮报》的警察枪击数据库显示,自2020年以来,警察杀人的数量有所增加,尽管广泛采用了随身摄像头。这表明技术本身并不能解决复杂的社会问题。

随着更多警察部门考虑采用像Draft One这样的工具,其潜在的好处与风险将继续引发争论。这是一个充满可能但也充满不确定性的迷人时代。关键在于平衡创新与问责,确保AI增强而不是损害执法的完整性。

中国网络空间管理局要求对人工智能生成和虚构的短视频进行标注

中国国家互联网信息办公室出台了一项全面计划,旨在规范短视频内容标注,要求各平台提供六项必备标签——包括“AI生成内容”——这标志着短视频治理进入了一个强制透明化的新时代。为解决内容来源不明、难以区分真伪等问题,监管部门在此前与抖音、快手、腾讯、百度等主要平台开展试点的基础上,现已将内容标注作为短视频发布流程中的强制性环节。 发布者必须从六种选项中选择其一:“虚构演绎”、“AI生成”、“含营销信息”

中国网络空间管理局要求对人工智能生成和虚构的短视频进行标注

中国国家互联网信息办公室出台了一项全面计划,旨在规范短视频内容标注,要求各平台提供六项必备标签——包括“AI生成内容”——这标志着短视频治理进入了一个强制透明化的新时代。为解决内容来源不明、难以区分真伪等问题,监管部门在此前与抖音、快手、腾讯、百度等主要平台开展试点的基础上,现已将内容标注作为短视频发布流程中的强制性环节。 发布者必须从六种选项中选择其一:“虚构演绎”、“AI生成”、“含营销信息”

以文本翻译著称的DeepL,如今将目光投向了语音翻译

以文本翻译工具闻名的翻译公司DeepL今日推出了一套语音到语音翻译解决方案,通过定制应用程序,为一线工作人员在会议、移动端和网页对话以及小组讨论等场景中提供支持。 该公司还推出了一款API,允许外部开发者和企业基于DeepL的技术构建定制化解决方案,例如呼叫中心应用。“在专注于文本翻译多年后,语音翻译对我们来说是水到渠成的下一步,”DeepL首席执行官Jarek Kutylowski在接受Tech

以文本翻译著称的DeepL,如今将目光投向了语音翻译

以文本翻译工具闻名的翻译公司DeepL今日推出了一套语音到语音翻译解决方案,通过定制应用程序,为一线工作人员在会议、移动端和网页对话以及小组讨论等场景中提供支持。 该公司还推出了一款API,允许外部开发者和企业基于DeepL的技术构建定制化解决方案,例如呼叫中心应用。“在专注于文本翻译多年后,语音翻译对我们来说是水到渠成的下一步,”DeepL首席执行官Jarek Kutylowski在接受Tech

Talat 的 AI 会议记录存储在您的设备上,而非云端

估值达2.5亿美元的AI笔记应用Granola在科技创业者和风险投资家群体中备受追捧。但一位开发者认为,市场需要一款更注重隐私、完全本地化、只需一次性付费且无需订阅的替代方案。这一构想催生了一款名为Talat的新Mac应用。来自英国约克郡的尼克·佩恩(Nick Payne)自称是位计算机极客,他表示开发本地化AI笔记应用的灵感,很大程度上源于一系列幸运的偶然。“我认为Granola非常出色;它充分

Talat 的 AI 会议记录存储在您的设备上,而非云端

估值达2.5亿美元的AI笔记应用Granola在科技创业者和风险投资家群体中备受追捧。但一位开发者认为,市场需要一款更注重隐私、完全本地化、只需一次性付费且无需订阅的替代方案。这一构想催生了一款名为Talat的新Mac应用。来自英国约克郡的尼克·佩恩(Nick Payne)自称是位计算机极客,他表示开发本地化AI笔记应用的灵感,很大程度上源于一系列幸运的偶然。“我认为Granola非常出色;它充分

Полиция использует ИИ для отчетов о преступлениях? 🤔 Это звучит опасно – алгоритмы могут воспроизводить предвзятость и ошибки. Как обычный гражданин, я бы предпочел, чтобы живые офицеры документировали факты, а не доверяли это машинам. Технология – это хорошо, но не для таких важных вещей!

¿Reportes policiales escritos por IA? Suena eficiente pero da bastante miedo que un chatbot decida qué detalles incluir o excluir en un caso legal. Un pequeño error o sesgo en los datos podría arruinar una investigación o incluso una vida. La tecnología debe ayudar, no reemplazar el criterio humano en asuntos tan delicados. 🧐 Esperemos que las regulaciones lleguen pronto.

This AI crime reporting stuff sounds like a game-changer, but I’m skeptical. Can a chatbot really capture the nuance of a crime scene without screwing up details? I mean, efficiency’s great, but if it’s spitting out generic reports, that’s a lawsuit waiting to happen. 😬 Curious to see how they handle the ethical side of this.

Die Idee, dass AI Polizeiberichte schreibt, klingt cool, aber auch ein bisschen beängstigend. Was, wenn das AI die Fakten vermasselt? Die Polizei von Oklahoma City scheint dabei zu sein, aber ich bin mir noch nicht sicher, ob ich es vertraue. Braucht mehr Tests, denke ich! 🤔

Using AI for crime reports sounds cool, but man, the potential for errors is scary! Imagine if the AI messes up and someone gets wrongly accused. Oklahoma City's police are using it, but I'm not sure I trust it yet. Maybe with more testing, it could be safer? 🤔👮♂️

首页

首页