Google tiết lộ các cải tiến mới của Kubernetes và GKE cho sự đổi mới của AI

Ngày 11 tháng 4 năm 2025

Ngày 11 tháng 4 năm 2025

JosephScott

JosephScott

58

58

Việc Google đẩy vào AI không có gì bí mật và với lý do chính đáng. Như CEO Sundar Pichai nhấn mạnh trong một cuộc họp nội bộ trước kỳ nghỉ năm ngoái, "vào năm 2025, chúng ta cần tập trung không ngừng vào việc mở khóa các lợi ích của công nghệ [AI] và giải quyết các vấn đề người dùng thực sự." Tầm nhìn này đang thúc đẩy Google tăng cường các dịch vụ của mình một cách đáng kể, đặc biệt là trong các dịch vụ đám mây và tích hợp AI.

Tại sự kiện Google Cloud 2025 tại Las Vegas, Google đã tiết lộ những tiến bộ đáng kể trong Kubernetes và Google Kubernetes Engine (GKE). Những cập nhật này nhằm mục đích trao quyền cho các nhóm nền tảng và các nhà phát triển khai thác AI trong khi tận dụng chuyên môn Kubernetes hiện có của họ. Gabe Monroy, phó chủ tịch đám mây của Google, nói một cách ngắn gọn: "Kỹ năng và đầu tư của Kubernetes của bạn không chỉ liên quan; chúng là siêu cường AI của bạn."

Vì vậy, chính xác những tiến bộ mới này là gì? Hãy đi sâu vào các chi tiết.

Quản lý cụm AI đơn giản hóa: GKE đang giới thiệu Quản lý cụm AI đơn giản hóa thông qua các công cụ như Giám đốc cụm cho GKE, trước đây được gọi là Cụm HyperCompute. Công cụ này cho phép người dùng triển khai và quản lý các cụm lớn của máy ảo (VM) với GPU NVIDIA đính kèm, giúp việc mở rộng khối lượng công việc AI dễ dàng hơn một cách hiệu quả.

Một dịch vụ sắp tới có liên quan là Giám đốc cụm cho Slurm. SLURM, một bộ lập lịch công việc nguồn mở và Trình quản lý khối lượng công việc cho Linux, sẽ dễ dàng cung cấp và vận hành dễ dàng hơn nhờ UI và API đơn giản hóa của Google. Chúng sẽ bao gồm các bản thiết kế cho khối lượng công việc điển hình với phần mềm được cấu hình sẵn, đảm bảo triển khai đáng tin cậy và có thể lặp lại.

Tối ưu hóa triển khai mô hình AI: Các tính năng mới của GKE cũng tập trung vào việc tối ưu hóa việc triển khai mô hình AI. GKE suy luận QuickStart và GKE suy luận Cổng đơn giản hóa việc lựa chọn và triển khai các mô hình AI, đảm bảo chúng hoạt động tốt với cân bằng tải thông minh.

Gabe Monroy nhấn mạnh xu hướng đổi mới AI giao nhau với điện toán truyền thống, đặc biệt là trong lĩnh vực suy luận. Ông lưu ý: "Chúng ta đang thấy một xu hướng rõ ràng trong thời đại của AI: sự đổi mới tuyệt vời đang diễn ra khi tính toán truyền thống tương tác với các mạng lưới thần kinh - còn được gọi là 'suy luận'. Các công ty hoạt động ở tiên tiến của Kubernetes và AI, như LiveX và Moloco, điều hành AI suy luận trên GKE. "

Suy luận hiệu quả về chi phí: GKE đang có những bước tiến trong suy luận hiệu quả về chi phí với cổng suy luận. Monroy tuyên bố phương pháp này có thể giảm tới 30%chi phí phục vụ, giảm tới 60%độ trễ và tăng thông lượng lên 40%so với các dịch vụ Kubernetes nguồn được quản lý và nguồn khác. Mặc dù đây là những con số đầy hứa hẹn, chúng ta sẽ cần phải xem chúng hành động để xác nhận tác động của chúng.

Cân bằng tải mô hình là một thành phần chính của chiến lược này. Với độ dài phản hồi thay đổi trong các mô hình AI, các phương pháp cân bằng tải truyền thống như vòng tròn có thể không hiệu quả. Tuy nhiên, Cổng suy luận cung cấp một cổng nhận biết mô hình được tối ưu hóa cho AI, với định tuyến nâng cao đến các phiên bản mô hình khác nhau.

Hiệu quả tài nguyên được cải thiện: GKE cũng đang tập trung vào việc cải thiện hiệu quả tài nguyên. GKE Autopilot hiện cung cấp lập kế hoạch pod nhanh hơn, thời gian phản ứng tỷ lệ nhanh hơn và kích thước đúng khả năng tốt hơn. Điều này có nghĩa là người dùng có thể xử lý nhiều lưu lượng truy cập hơn với cùng một tài nguyên hoặc duy trì lưu lượng truy cập hiện có với ít tài nguyên hơn. Google tuyên bố rằng với Autopilot được cải thiện, công suất cụm sẽ luôn có kích thước phù hợp.

Hiện tại, Autopilot bao gồm một công cụ cấu hình cụm thực hành tốt nhất và nền tảng tính toán được tối ưu hóa container tự động điều chỉnh công suất để phù hợp với khối lượng công việc. Tuy nhiên, nó không có kích thước phù hợp các cụm hiện có mà không có cấu hình cụ thể. Bắt đầu từ quý thứ ba, nền tảng tính toán được tối ưu hóa container của Autopilot cũng sẽ có sẵn cho các cụm GKE tiêu chuẩn mà không cần một cấu hình cụ thể, có thể là một người thay đổi trò chơi.

Hỗ trợ đám mây Song Tử hỗ trợ AI: Gỡ lỗi và chẩn đoán các vấn đề ứng dụng có thể làm chậm đáng kể sự đổi mới. Để giải quyết vấn đề này, Google đã giới thiệu Gemini Cloud Assist, cung cấp hỗ trợ do AI cung cấp trong suốt vòng đời ứng dụng. Bản xem trước riêng của các cuộc điều tra của Gemini Cloud hỗ trợ giúp người dùng nhanh chóng hiểu được nguyên nhân gốc và giải quyết các vấn đề.

Phần tốt nhất? Các cuộc điều tra hỗ trợ sẽ có thể truy cập trực tiếp từ bảng điều khiển GKE, giảm thời gian khắc phục sự cố và giải phóng nhiều thời gian hơn cho sự đổi mới. Nó sẽ cho phép bạn chẩn đoán các sự cố POD và cụm từ bảng điều khiển GKE trên các dịch vụ Google Cloud khác nhau, bao gồm các nút, IAM và bộ cân bằng tải. Bạn có thể xem nhật ký và lỗi trên nhiều dịch vụ GKE, bộ điều khiển, nhóm và các nút cơ bản. Đăng ký để xem trước riêng để trải nghiệm tính năng này tận mắt.

Là một phần của chiến lược công nghệ mới nổi rộng hơn của mình, Google đang định vị mình là người dẫn đầu trong các nền tảng được tối ưu hóa AI. Những phát triển này cho phép các doanh nghiệp trong các ngành công nghiệp sử dụng AI hiệu quả hơn, thúc đẩy sự đổi mới và hiệu quả trong hoạt động và trải nghiệm của khách hàng.

Chẳng hạn, Intuit tận dụng tài liệu AI và Gemini của Google Cloud để đơn giản hóa việc chuẩn bị thuế cho hàng triệu người dùng Turbotax. Reddit sử dụng Gemini thông qua Vertex AI, trình xây dựng AI của Google, để tăng cường câu trả lời của Reddit, một nền tảng hội thoại được hỗ trợ AI mới được thiết kế để cải thiện trải nghiệm trang chủ.

Google có thể thực hiện thành công các phép biến đổi AI-hỗ trợ này không? Chỉ có thời gian mới trả lời. Như Pichai đã tuyên bố vào tháng 12, "Trong lịch sử, bạn không cần phải là người đầu tiên, nhưng bạn phải thực hiện tốt và thực sự là người giỏi nhất trong lớp như một sản phẩm. Tôi nghĩ đó là tất cả những gì năm 2025."

Bài viết liên quan

Giải mã oshi no 'Idol': một phân tích lặn sâu

Chủ đề mở đầu của *Oshi No Ko *, có tựa đề "Thần tượng", vượt trội chỉ là một giai điệu J-Pop hấp dẫn; Đó là một kiệt tác kể chuyện đi sâu vào sự phức tạp của ngôi sao, bản sắc và các ranh giới thường bị mờ giữa hình ảnh công khai của một thần tượng và thực tế riêng tư. Bài hát này không chỉ đặt sân khấu cho

Giải mã oshi no 'Idol': một phân tích lặn sâu

Chủ đề mở đầu của *Oshi No Ko *, có tựa đề "Thần tượng", vượt trội chỉ là một giai điệu J-Pop hấp dẫn; Đó là một kiệt tác kể chuyện đi sâu vào sự phức tạp của ngôi sao, bản sắc và các ranh giới thường bị mờ giữa hình ảnh công khai của một thần tượng và thực tế riêng tư. Bài hát này không chỉ đặt sân khấu cho

Phản ứng fanfiction của Wattpad: Tay vui nhộn của Timi Saint

Nếu bạn đang có tâm trạng cho một chuyến đi hoang dã tràn ngập tiếng cười và những khoảnh khắc đáng giá đó, thì bạn phải kiểm tra cuộc trốn thoát trên YouTube mới nhất của Timi Saint. Ngôi sao đang lên này được biết đến với những phản ứng chưa được lọc và sở trường của cô vì mang sự hài hước đáng tin cậy lên màn hình. Trong video mới nhất của cô ấy, Timi di

Phản ứng fanfiction của Wattpad: Tay vui nhộn của Timi Saint

Nếu bạn đang có tâm trạng cho một chuyến đi hoang dã tràn ngập tiếng cười và những khoảnh khắc đáng giá đó, thì bạn phải kiểm tra cuộc trốn thoát trên YouTube mới nhất của Timi Saint. Ngôi sao đang lên này được biết đến với những phản ứng chưa được lọc và sở trường của cô vì mang sự hài hước đáng tin cậy lên màn hình. Trong video mới nhất của cô ấy, Timi di

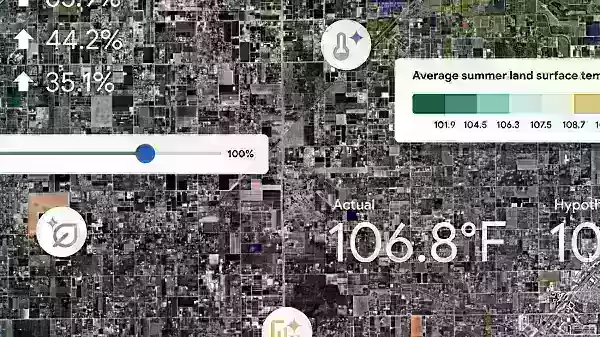

Cách chúng tôi sử dụng AI để giúp các thành phố giải quyết sức nóng cực đoan

Nó trông giống như năm 2024 có thể phá vỡ kỷ lục cho năm nóng nhất, vượt qua năm 2023. Xu hướng này đặc biệt khó khăn đối với những người sống ở các hòn đảo nhiệt đô thị, những điểm đó ở các thành phố nơi bê tông và nhựa đường hòa mình vào các tia nắng mặt trời và sau đó tỏa nhiệt ngay. Những khu vực này có thể ấm

Nhận xét (45)

0/200

Cách chúng tôi sử dụng AI để giúp các thành phố giải quyết sức nóng cực đoan

Nó trông giống như năm 2024 có thể phá vỡ kỷ lục cho năm nóng nhất, vượt qua năm 2023. Xu hướng này đặc biệt khó khăn đối với những người sống ở các hòn đảo nhiệt đô thị, những điểm đó ở các thành phố nơi bê tông và nhựa đường hòa mình vào các tia nắng mặt trời và sau đó tỏa nhiệt ngay. Những khu vực này có thể ấm

Nhận xét (45)

0/200

![BenRoberts]() BenRoberts

BenRoberts

12:27:35 GMT Ngày 12 tháng 4 năm 2025

12:27:35 GMT Ngày 12 tháng 4 năm 2025

The new Kubernetes and GKE enhancements are pretty cool for AI projects! It's made deploying and managing AI workloads a breeze. Though, it can be a bit overwhelming for beginners, so maybe Google could offer more tutorials?

0

0

![LucasWalker]() LucasWalker

LucasWalker

12:27:35 GMT Ngày 12 tháng 4 năm 2025

12:27:35 GMT Ngày 12 tháng 4 năm 2025

新しいKubernetesとGKEの強化は、AIプロジェクトに最適ですね!AIワークロードのデプロイと管理が簡単になりました。ただ、初心者には少し圧倒的かもしれないので、Googleがもっとチュートリアルを提供してくれると良いですね。

0

0

![DonaldSanchez]() DonaldSanchez

DonaldSanchez

12:27:35 GMT Ngày 12 tháng 4 năm 2025

12:27:35 GMT Ngày 12 tháng 4 năm 2025

새로운 Kubernetes와 GKE 개선은 AI 프로젝트에 정말 좋네요! AI 워크로드를 배포하고 관리하는 것이 훨씬 쉬워졌어요. 다만, 초보자에게는 조금 압도적일 수 있으니, 구글이 더 많은 튜토리얼을 제공하면 좋겠어요.

0

0

![KennethKing]() KennethKing

KennethKing

12:27:35 GMT Ngày 12 tháng 4 năm 2025

12:27:35 GMT Ngày 12 tháng 4 năm 2025

As novas melhorias do Kubernetes e GKE são ótimas para projetos de IA! Tornou o deploy e a gestão de cargas de trabalho de IA muito mais fáceis. No entanto, pode ser um pouco esmagador para iniciantes, então talvez o Google pudesse oferecer mais tutoriais?

0

0

![AnthonyPerez]() AnthonyPerez

AnthonyPerez

12:27:35 GMT Ngày 12 tháng 4 năm 2025

12:27:35 GMT Ngày 12 tháng 4 năm 2025

Las nuevas mejoras de Kubernetes y GKE son geniales para proyectos de IA. Ha facilitado mucho el despliegue y la gestión de cargas de trabajo de IA. Aunque puede ser un poco abrumador para principiantes, ¿quizás Google podría ofrecer más tutoriales?

0

0

![KevinScott]() KevinScott

KevinScott

07:56:26 GMT Ngày 12 tháng 4 năm 2025

07:56:26 GMT Ngày 12 tháng 4 năm 2025

Google's focus on AI with Kubernetes and GKE is impressive, but I'm still figuring out how to use it effectively. It's like they're speaking a different language sometimes. Can anyone give me a simple guide or something? I want to harness this power, but it's a bit overwhelming right now!

0

0

Ngày 11 tháng 4 năm 2025

Ngày 11 tháng 4 năm 2025

JosephScott

JosephScott

58

58

Việc Google đẩy vào AI không có gì bí mật và với lý do chính đáng. Như CEO Sundar Pichai nhấn mạnh trong một cuộc họp nội bộ trước kỳ nghỉ năm ngoái, "vào năm 2025, chúng ta cần tập trung không ngừng vào việc mở khóa các lợi ích của công nghệ [AI] và giải quyết các vấn đề người dùng thực sự." Tầm nhìn này đang thúc đẩy Google tăng cường các dịch vụ của mình một cách đáng kể, đặc biệt là trong các dịch vụ đám mây và tích hợp AI.

Tại sự kiện Google Cloud 2025 tại Las Vegas, Google đã tiết lộ những tiến bộ đáng kể trong Kubernetes và Google Kubernetes Engine (GKE). Những cập nhật này nhằm mục đích trao quyền cho các nhóm nền tảng và các nhà phát triển khai thác AI trong khi tận dụng chuyên môn Kubernetes hiện có của họ. Gabe Monroy, phó chủ tịch đám mây của Google, nói một cách ngắn gọn: "Kỹ năng và đầu tư của Kubernetes của bạn không chỉ liên quan; chúng là siêu cường AI của bạn."

Vì vậy, chính xác những tiến bộ mới này là gì? Hãy đi sâu vào các chi tiết.

Quản lý cụm AI đơn giản hóa: GKE đang giới thiệu Quản lý cụm AI đơn giản hóa thông qua các công cụ như Giám đốc cụm cho GKE, trước đây được gọi là Cụm HyperCompute. Công cụ này cho phép người dùng triển khai và quản lý các cụm lớn của máy ảo (VM) với GPU NVIDIA đính kèm, giúp việc mở rộng khối lượng công việc AI dễ dàng hơn một cách hiệu quả.

Một dịch vụ sắp tới có liên quan là Giám đốc cụm cho Slurm. SLURM, một bộ lập lịch công việc nguồn mở và Trình quản lý khối lượng công việc cho Linux, sẽ dễ dàng cung cấp và vận hành dễ dàng hơn nhờ UI và API đơn giản hóa của Google. Chúng sẽ bao gồm các bản thiết kế cho khối lượng công việc điển hình với phần mềm được cấu hình sẵn, đảm bảo triển khai đáng tin cậy và có thể lặp lại.

Tối ưu hóa triển khai mô hình AI: Các tính năng mới của GKE cũng tập trung vào việc tối ưu hóa việc triển khai mô hình AI. GKE suy luận QuickStart và GKE suy luận Cổng đơn giản hóa việc lựa chọn và triển khai các mô hình AI, đảm bảo chúng hoạt động tốt với cân bằng tải thông minh.

Gabe Monroy nhấn mạnh xu hướng đổi mới AI giao nhau với điện toán truyền thống, đặc biệt là trong lĩnh vực suy luận. Ông lưu ý: "Chúng ta đang thấy một xu hướng rõ ràng trong thời đại của AI: sự đổi mới tuyệt vời đang diễn ra khi tính toán truyền thống tương tác với các mạng lưới thần kinh - còn được gọi là 'suy luận'. Các công ty hoạt động ở tiên tiến của Kubernetes và AI, như LiveX và Moloco, điều hành AI suy luận trên GKE. "

Suy luận hiệu quả về chi phí: GKE đang có những bước tiến trong suy luận hiệu quả về chi phí với cổng suy luận. Monroy tuyên bố phương pháp này có thể giảm tới 30%chi phí phục vụ, giảm tới 60%độ trễ và tăng thông lượng lên 40%so với các dịch vụ Kubernetes nguồn được quản lý và nguồn khác. Mặc dù đây là những con số đầy hứa hẹn, chúng ta sẽ cần phải xem chúng hành động để xác nhận tác động của chúng.

Cân bằng tải mô hình là một thành phần chính của chiến lược này. Với độ dài phản hồi thay đổi trong các mô hình AI, các phương pháp cân bằng tải truyền thống như vòng tròn có thể không hiệu quả. Tuy nhiên, Cổng suy luận cung cấp một cổng nhận biết mô hình được tối ưu hóa cho AI, với định tuyến nâng cao đến các phiên bản mô hình khác nhau.

Hiệu quả tài nguyên được cải thiện: GKE cũng đang tập trung vào việc cải thiện hiệu quả tài nguyên. GKE Autopilot hiện cung cấp lập kế hoạch pod nhanh hơn, thời gian phản ứng tỷ lệ nhanh hơn và kích thước đúng khả năng tốt hơn. Điều này có nghĩa là người dùng có thể xử lý nhiều lưu lượng truy cập hơn với cùng một tài nguyên hoặc duy trì lưu lượng truy cập hiện có với ít tài nguyên hơn. Google tuyên bố rằng với Autopilot được cải thiện, công suất cụm sẽ luôn có kích thước phù hợp.

Hiện tại, Autopilot bao gồm một công cụ cấu hình cụm thực hành tốt nhất và nền tảng tính toán được tối ưu hóa container tự động điều chỉnh công suất để phù hợp với khối lượng công việc. Tuy nhiên, nó không có kích thước phù hợp các cụm hiện có mà không có cấu hình cụ thể. Bắt đầu từ quý thứ ba, nền tảng tính toán được tối ưu hóa container của Autopilot cũng sẽ có sẵn cho các cụm GKE tiêu chuẩn mà không cần một cấu hình cụ thể, có thể là một người thay đổi trò chơi.

Hỗ trợ đám mây Song Tử hỗ trợ AI: Gỡ lỗi và chẩn đoán các vấn đề ứng dụng có thể làm chậm đáng kể sự đổi mới. Để giải quyết vấn đề này, Google đã giới thiệu Gemini Cloud Assist, cung cấp hỗ trợ do AI cung cấp trong suốt vòng đời ứng dụng. Bản xem trước riêng của các cuộc điều tra của Gemini Cloud hỗ trợ giúp người dùng nhanh chóng hiểu được nguyên nhân gốc và giải quyết các vấn đề.

Phần tốt nhất? Các cuộc điều tra hỗ trợ sẽ có thể truy cập trực tiếp từ bảng điều khiển GKE, giảm thời gian khắc phục sự cố và giải phóng nhiều thời gian hơn cho sự đổi mới. Nó sẽ cho phép bạn chẩn đoán các sự cố POD và cụm từ bảng điều khiển GKE trên các dịch vụ Google Cloud khác nhau, bao gồm các nút, IAM và bộ cân bằng tải. Bạn có thể xem nhật ký và lỗi trên nhiều dịch vụ GKE, bộ điều khiển, nhóm và các nút cơ bản. Đăng ký để xem trước riêng để trải nghiệm tính năng này tận mắt.

Là một phần của chiến lược công nghệ mới nổi rộng hơn của mình, Google đang định vị mình là người dẫn đầu trong các nền tảng được tối ưu hóa AI. Những phát triển này cho phép các doanh nghiệp trong các ngành công nghiệp sử dụng AI hiệu quả hơn, thúc đẩy sự đổi mới và hiệu quả trong hoạt động và trải nghiệm của khách hàng.

Chẳng hạn, Intuit tận dụng tài liệu AI và Gemini của Google Cloud để đơn giản hóa việc chuẩn bị thuế cho hàng triệu người dùng Turbotax. Reddit sử dụng Gemini thông qua Vertex AI, trình xây dựng AI của Google, để tăng cường câu trả lời của Reddit, một nền tảng hội thoại được hỗ trợ AI mới được thiết kế để cải thiện trải nghiệm trang chủ.

Google có thể thực hiện thành công các phép biến đổi AI-hỗ trợ này không? Chỉ có thời gian mới trả lời. Như Pichai đã tuyên bố vào tháng 12, "Trong lịch sử, bạn không cần phải là người đầu tiên, nhưng bạn phải thực hiện tốt và thực sự là người giỏi nhất trong lớp như một sản phẩm. Tôi nghĩ đó là tất cả những gì năm 2025."

Giải mã oshi no 'Idol': một phân tích lặn sâu

Chủ đề mở đầu của *Oshi No Ko *, có tựa đề "Thần tượng", vượt trội chỉ là một giai điệu J-Pop hấp dẫn; Đó là một kiệt tác kể chuyện đi sâu vào sự phức tạp của ngôi sao, bản sắc và các ranh giới thường bị mờ giữa hình ảnh công khai của một thần tượng và thực tế riêng tư. Bài hát này không chỉ đặt sân khấu cho

Giải mã oshi no 'Idol': một phân tích lặn sâu

Chủ đề mở đầu của *Oshi No Ko *, có tựa đề "Thần tượng", vượt trội chỉ là một giai điệu J-Pop hấp dẫn; Đó là một kiệt tác kể chuyện đi sâu vào sự phức tạp của ngôi sao, bản sắc và các ranh giới thường bị mờ giữa hình ảnh công khai của một thần tượng và thực tế riêng tư. Bài hát này không chỉ đặt sân khấu cho

Phản ứng fanfiction của Wattpad: Tay vui nhộn của Timi Saint

Nếu bạn đang có tâm trạng cho một chuyến đi hoang dã tràn ngập tiếng cười và những khoảnh khắc đáng giá đó, thì bạn phải kiểm tra cuộc trốn thoát trên YouTube mới nhất của Timi Saint. Ngôi sao đang lên này được biết đến với những phản ứng chưa được lọc và sở trường của cô vì mang sự hài hước đáng tin cậy lên màn hình. Trong video mới nhất của cô ấy, Timi di

Phản ứng fanfiction của Wattpad: Tay vui nhộn của Timi Saint

Nếu bạn đang có tâm trạng cho một chuyến đi hoang dã tràn ngập tiếng cười và những khoảnh khắc đáng giá đó, thì bạn phải kiểm tra cuộc trốn thoát trên YouTube mới nhất của Timi Saint. Ngôi sao đang lên này được biết đến với những phản ứng chưa được lọc và sở trường của cô vì mang sự hài hước đáng tin cậy lên màn hình. Trong video mới nhất của cô ấy, Timi di

Cách chúng tôi sử dụng AI để giúp các thành phố giải quyết sức nóng cực đoan

Nó trông giống như năm 2024 có thể phá vỡ kỷ lục cho năm nóng nhất, vượt qua năm 2023. Xu hướng này đặc biệt khó khăn đối với những người sống ở các hòn đảo nhiệt đô thị, những điểm đó ở các thành phố nơi bê tông và nhựa đường hòa mình vào các tia nắng mặt trời và sau đó tỏa nhiệt ngay. Những khu vực này có thể ấm

Cách chúng tôi sử dụng AI để giúp các thành phố giải quyết sức nóng cực đoan

Nó trông giống như năm 2024 có thể phá vỡ kỷ lục cho năm nóng nhất, vượt qua năm 2023. Xu hướng này đặc biệt khó khăn đối với những người sống ở các hòn đảo nhiệt đô thị, những điểm đó ở các thành phố nơi bê tông và nhựa đường hòa mình vào các tia nắng mặt trời và sau đó tỏa nhiệt ngay. Những khu vực này có thể ấm

12:27:35 GMT Ngày 12 tháng 4 năm 2025

12:27:35 GMT Ngày 12 tháng 4 năm 2025

The new Kubernetes and GKE enhancements are pretty cool for AI projects! It's made deploying and managing AI workloads a breeze. Though, it can be a bit overwhelming for beginners, so maybe Google could offer more tutorials?

0

0

12:27:35 GMT Ngày 12 tháng 4 năm 2025

12:27:35 GMT Ngày 12 tháng 4 năm 2025

新しいKubernetesとGKEの強化は、AIプロジェクトに最適ですね!AIワークロードのデプロイと管理が簡単になりました。ただ、初心者には少し圧倒的かもしれないので、Googleがもっとチュートリアルを提供してくれると良いですね。

0

0

12:27:35 GMT Ngày 12 tháng 4 năm 2025

12:27:35 GMT Ngày 12 tháng 4 năm 2025

새로운 Kubernetes와 GKE 개선은 AI 프로젝트에 정말 좋네요! AI 워크로드를 배포하고 관리하는 것이 훨씬 쉬워졌어요. 다만, 초보자에게는 조금 압도적일 수 있으니, 구글이 더 많은 튜토리얼을 제공하면 좋겠어요.

0

0

12:27:35 GMT Ngày 12 tháng 4 năm 2025

12:27:35 GMT Ngày 12 tháng 4 năm 2025

As novas melhorias do Kubernetes e GKE são ótimas para projetos de IA! Tornou o deploy e a gestão de cargas de trabalho de IA muito mais fáceis. No entanto, pode ser um pouco esmagador para iniciantes, então talvez o Google pudesse oferecer mais tutoriais?

0

0

12:27:35 GMT Ngày 12 tháng 4 năm 2025

12:27:35 GMT Ngày 12 tháng 4 năm 2025

Las nuevas mejoras de Kubernetes y GKE son geniales para proyectos de IA. Ha facilitado mucho el despliegue y la gestión de cargas de trabajo de IA. Aunque puede ser un poco abrumador para principiantes, ¿quizás Google podría ofrecer más tutoriales?

0

0

07:56:26 GMT Ngày 12 tháng 4 năm 2025

07:56:26 GMT Ngày 12 tháng 4 năm 2025

Google's focus on AI with Kubernetes and GKE is impressive, but I'm still figuring out how to use it effectively. It's like they're speaking a different language sometimes. Can anyone give me a simple guide or something? I want to harness this power, but it's a bit overwhelming right now!

0

0