एरिक श्मिट ने एजीआई मैनहट्टन प्रोजेक्ट का विरोध किया

बुधवार को जारी एक नीति पत्र में, पूर्व गूगल सीईओ एरिक श्मिट, स्केल एआई के सीईओ अलेक्जेंडर वांग और सेंटर फॉर एआई सेफ्टी के निदेशक डैन हेंड्रिक्स ने अमेरिका को "सुपरह्यूमन" बुद्धिमत्ता वाले एआई सिस्टम, जिन्हें सामान्य रूप से एजीआई कहा जाता है, विकसित करने के लिए मैनहट्टन प्रोजेक्ट-शैली की पहल शुरू करने के खिलाफ सलाह दी।

"सुपरइंटेलिजेंस स्ट्रैटेजी" शीर्षक वाला यह पत्र चेतावनी देता है कि सुपरइंटेलिजेंट एआई पर अमेरिकी एकाधिकार का प्रयास चीन से तीव्र प्रतिक्रिया को भड़का सकता है, संभवतः साइबर हमले के रूप में, जो वैश्विक संबंधों को बाधित कर सकता है।

सह-लेखकों का तर्क है, "एजीआई के लिए मैनहट्टन प्रोजेक्ट यह मानता है कि प्रतिद्वंद्वी स्थायी असंतुलन या सर्वनाश को स्वीकार करेंगे, न कि इसे रोकने के लिए कदम उठाएंगे। जो एक सुपरहथियार और वैश्विक नियंत्रण के लिए धक्का शुरू होता है, वह शत्रुतापूर्ण जवाबी कार्रवाइयों और बढ़ते तनावों को प्रेरित करने का जोखिम उठाता है, जिससे वह स्थिरता कमजोर हो जाती है, जिसे यह रणनीति सुरक्षित करने का दावा करती है।"

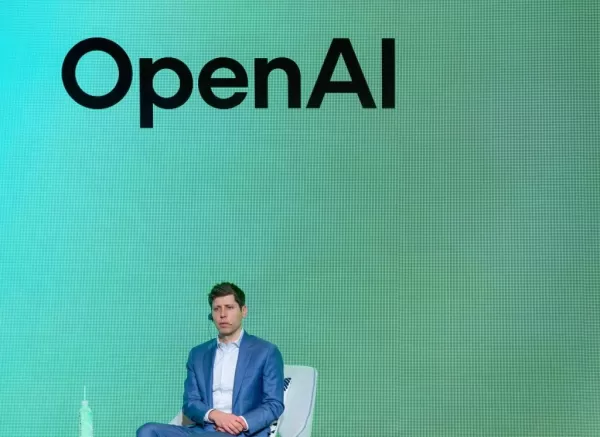

अमेरिकी एआई क्षेत्र के तीन प्रमुख व्यक्तियों द्वारा लिखित यह पत्र, अमेरिकी कांग्रेस के एक आयोग द्वारा एजीआई विकास को निधि देने के लिए "मैनहट्टन प्रोजेक्ट-शैली" की पहल का सुझाव देने के तुरंत बाद आया है, जो 1940 के दशक के अमेरिकी परमाणु बम परियोजना के समान है। अमेरिकी ऊर्जा सचिव क्रिस राइट ने हाल ही में ओपनएआई के सह-संस्थापक ग्रेग ब्रॉकमैन के साथ एक सुपरकंप्यूटर साइट पर बोलते हुए घोषणा की कि अमेरिका एआई पर "एक नए मैनहट्टन प्रोजेक्ट की शुरुआत में" है।

सुपरइंटेलिजेंस स्ट्रैटेजी पत्र कई अमेरिकी नीति और उद्योग नेताओं के हालिया दबाव को चुनौती देता है, जो मानते हैं कि सरकार समर्थित एजीआई कार्यक्रम चीन के साथ तालमेल रखने का सबसे अच्छा तरीका है।

श्मिट, वांग और हेंड्रिक्स अमेरिका को एजीआई को लेकर एक गतिरोध की स्थिति में देखते हैं, जो परस्पर सुनिश्चित विनाश की अवधारणा के समान है। जैसे राष्ट्र परमाणु हथियारों पर एकाधिकार से बचते हैं ताकि पहले से हमला न हो, लेखक सुझाव देते हैं कि अमेरिका को अत्यधिक उन्नत एआई सिस्टम पर हावी होने की जल्दबाजी से सावधान रहना चाहिए।

हालांकि एआई की तुलना परमाणु हथियारों से करना अतिशयोक्ति लग सकता है, वैश्विक नेता पहले से ही एआई को एक महत्वपूर्ण सैन्य संपत्ति के रूप में देखते हैं। पेंटागन ने उल्लेख किया है कि एआई सैन्य की हत्या श्रृंखला को तेज कर रहा है।

लेखक म्यूचुअल एश्योर्ड एआई मालफंक्शन (एमएआईएम) की अवधारणा पेश करते हैं, जहां सरकारें धमकी देने वाले एआई परियोजनाओं को अक्षम करने के लिए पहले से कार्रवाई कर सकती हैं, बजाय इसके कि विरोधी एजीआई को हथियार बनाएं।

श्मिट, वांग और हेंड्रिक्स सलाह देते हैं कि अमेरिका को "सुपरइंटेलिजेंस की दौड़ जीतने" से ध्यान हटाकर अन्य देशों को सुपरइंटेलिजेंट एआई बनाने से रोकने के तरीके विकसित करने पर ध्यान देना चाहिए। वे सुझाव देते हैं कि सरकार को "धमकी देने वाली एआई परियोजनाओं को अक्षम करने के लिए साइबर हमलों के अपने शस्त्रागार का विस्तार करना चाहिए" और विरोधियों की उन्नत एआई चिप्स और ओपन-सोर्स मॉडल तक पहुंच को प्रतिबंधित करना चाहिए।

पत्र एआई नीति समुदाय में विभाजन को उजागर करता है, जिसमें "डूमर्स" शामिल हैं, जो मानते हैं कि विनाशकारी एआई परिणाम अपरिहार्य हैं और एआई प्रगति को धीमा करने की वकालत करते हैं, और "ऑस्ट्रिचेस", जो एआई विकास को तेज करने और सर्वश्रेष्ठ की उम्मीद करते हैं।

लेखक एक तीसरा रास्ता प्रस्तावित करते हैं: एजीआई विकास के लिए एक सतर्क दृष्टिकोण जो रक्षात्मक रणनीतियों पर जोर देता है।

यह रुख विशेष रूप से श्मिट से उल्लेखनीय है, जिन्होंने पहले अमेरिका को चीन के साथ एआई विकास में आक्रामक रूप से प्रतिस्पर्धा करने की आवश्यकता पर जोर दिया था। कुछ महीने पहले ही, श्मिट ने एक लेख लिखा था जिसमें कहा गया था कि डीपसीक ने अमेरिका-चीन एआई दौड़ में एक महत्वपूर्ण क्षण को चिह्नित किया।

ट्रम्प प्रशासन के अमेरिका के एआई विकास को आगे बढ़ाने के दृढ़ संकल्प के बावजूद, सह-लेखक हमें याद दिलाते हैं कि एजीआई पर अमेरिकी निर्णयों के वैश्विक निहितार्थ हैं।

जैसा कि दुनिया अमेरिका के एआई में धक्का को देखती है, श्मिट और उनके सह-लेखक सुझाव देते हैं कि अधिक रक्षात्मक रणनीति बुद्धिमानी भरा विकल्प हो सकता है।

संबंधित लेख

पूर्व OpenAI इंजीनियर ने कंपनी संस्कृति और तेजी से विकास पर अंतर्दृष्टि साझा की

तीन सप्ताह पहले, कैल्विन फ्रेंच-ओवेन, एक इंजीनियर जिन्होंने OpenAI के एक प्रमुख उत्पाद में योगदान दिया, ने कंपनी छोड़ दी।उन्होंने हाल ही में एक आकर्षक ब्लॉग पोस्ट साझा किया जिसमें OpenAI में उनके एक स

पूर्व OpenAI इंजीनियर ने कंपनी संस्कृति और तेजी से विकास पर अंतर्दृष्टि साझा की

तीन सप्ताह पहले, कैल्विन फ्रेंच-ओवेन, एक इंजीनियर जिन्होंने OpenAI के एक प्रमुख उत्पाद में योगदान दिया, ने कंपनी छोड़ दी।उन्होंने हाल ही में एक आकर्षक ब्लॉग पोस्ट साझा किया जिसमें OpenAI में उनके एक स

Google ने उद्यम बाजार में OpenAI के साथ प्रतिस्पर्धा करने के लिए उत्पादन-तैयार Gemini 2.5 AI मॉडल्स का अनावरण किया

Google ने सोमवार को अपनी AI रणनीति को और मजबूत किया, उद्यम उपयोग के लिए अपने उन्नत Gemini 2.5 मॉडल्स को लॉन्च किया और कीमत व प्रदर्शन पर प्रतिस्पर्धा करने के लिए एक लागत-कुशल संस्करण पेश किया।Alphabet

Google ने उद्यम बाजार में OpenAI के साथ प्रतिस्पर्धा करने के लिए उत्पादन-तैयार Gemini 2.5 AI मॉडल्स का अनावरण किया

Google ने सोमवार को अपनी AI रणनीति को और मजबूत किया, उद्यम उपयोग के लिए अपने उन्नत Gemini 2.5 मॉडल्स को लॉन्च किया और कीमत व प्रदर्शन पर प्रतिस्पर्धा करने के लिए एक लागत-कुशल संस्करण पेश किया।Alphabet

मेटा AI प्रतिभा के लिए उच्च वेतन प्रदान करता है, 100 मिलियन डॉलर के साइनिंग बोनस से इनकार

मेटा अपने नए सुपरइंटेलिजेंस लैब में AI शोधकर्ताओं को आकर्षित करने के लिए लाखों डॉलर के मुआवजे पैकेज प्रदान कर रहा है। हालांकि, एक भर्ती किए गए शोधकर्ता और लीक हुई आंतरिक बैठक की टिप्पणियों के अनुसार,

सूचना (27)

0/200

मेटा AI प्रतिभा के लिए उच्च वेतन प्रदान करता है, 100 मिलियन डॉलर के साइनिंग बोनस से इनकार

मेटा अपने नए सुपरइंटेलिजेंस लैब में AI शोधकर्ताओं को आकर्षित करने के लिए लाखों डॉलर के मुआवजे पैकेज प्रदान कर रहा है। हालांकि, एक भर्ती किए गए शोधकर्ता और लीक हुई आंतरिक बैठक की टिप्पणियों के अनुसार,

सूचना (27)

0/200

![PaulLewis]() PaulLewis

PaulLewis

28 जुलाई 2025 6:49:30 पूर्वाह्न IST

28 जुलाई 2025 6:49:30 पूर्वाह्न IST

Eric Schmidt's take on AGI is refreshing! No need for a rushed, mega-project vibe—slow and steady wins the race, right? Curious how this will play out with AI ethics debates. 🤔

0

0

![PeterRodriguez]() PeterRodriguez

PeterRodriguez

23 जुलाई 2025 10:29:47 पूर्वाह्न IST

23 जुलाई 2025 10:29:47 पूर्वाह्न IST

Eric Schmidt's take on pausing the AGI race is refreshing! It's like saying, 'Hey, let's not sprint toward a sci-fi apocalypse.' Superhuman AI sounds cool, but I’d rather we take our time to avoid any Skynet vibes. 😅 What’s next, a global AI ethics council?

0

0

![BruceSmith]() BruceSmith

BruceSmith

20 अप्रैल 2025 11:02:22 अपराह्न IST

20 अप्रैल 2025 11:02:22 अपराह्न IST

La postura de Eric Schmidt de no apresurarse en un Proyecto Manhattan para AGI es bastante inteligente. No necesitamos otra carrera hacia el fondo con IA superhumana. Vamos a tomarnos nuestro tiempo y hacerlo bien, o podríamos terminar con más problemas que soluciones. 🤔

0

0

![MichaelDavis]() MichaelDavis

MichaelDavis

18 अप्रैल 2025 11:59:08 अपराह्न IST

18 अप्रैल 2025 11:59:08 अपराह्न IST

A visão de Eric Schmidt sobre AGI está certa! Não precisamos de um projeto Manhattan para desenvolver IA super-humana. Devemos ser cautelosos e pensar nas implicações. Seu artigo com Wang e Hendrycks é leitura obrigatória! 👀📚

0

0

![MiaDavis]() MiaDavis

MiaDavis

18 अप्रैल 2025 9:54:42 अपराह्न IST

18 अप्रैल 2025 9:54:42 अपराह्न IST

에릭 슈미트의 AGI에 대한 의견이 맞아요! 초인공지능 AI를 서두를 필요가 없어요. 신중하게 생각해야 합니다. 그의 논문은 꼭 읽어봐야 해요! 👀📚

0

0

![TerryPerez]() TerryPerez

TerryPerez

18 अप्रैल 2025 6:50:43 अपराह्न IST

18 अप्रैल 2025 6:50:43 अपराह्न IST

एरिक श्मिट का AGI पर नज़रिया सही है! हमें सुपरह्यूमन AI के लिए मैनहट्टन प्रोजेक्ट जैसी जल्दबाजी की ज़रूरत नहीं है। हमें सावधान रहना चाहिए और प्रभावों के बारे में सोचना चाहिए। उनका पेपर वांग और हेंड्रिक्स के साथ ज़रूर पढ़ना चाहिए! 👀📚

0

0

बुधवार को जारी एक नीति पत्र में, पूर्व गूगल सीईओ एरिक श्मिट, स्केल एआई के सीईओ अलेक्जेंडर वांग और सेंटर फॉर एआई सेफ्टी के निदेशक डैन हेंड्रिक्स ने अमेरिका को "सुपरह्यूमन" बुद्धिमत्ता वाले एआई सिस्टम, जिन्हें सामान्य रूप से एजीआई कहा जाता है, विकसित करने के लिए मैनहट्टन प्रोजेक्ट-शैली की पहल शुरू करने के खिलाफ सलाह दी।

"सुपरइंटेलिजेंस स्ट्रैटेजी" शीर्षक वाला यह पत्र चेतावनी देता है कि सुपरइंटेलिजेंट एआई पर अमेरिकी एकाधिकार का प्रयास चीन से तीव्र प्रतिक्रिया को भड़का सकता है, संभवतः साइबर हमले के रूप में, जो वैश्विक संबंधों को बाधित कर सकता है।

सह-लेखकों का तर्क है, "एजीआई के लिए मैनहट्टन प्रोजेक्ट यह मानता है कि प्रतिद्वंद्वी स्थायी असंतुलन या सर्वनाश को स्वीकार करेंगे, न कि इसे रोकने के लिए कदम उठाएंगे। जो एक सुपरहथियार और वैश्विक नियंत्रण के लिए धक्का शुरू होता है, वह शत्रुतापूर्ण जवाबी कार्रवाइयों और बढ़ते तनावों को प्रेरित करने का जोखिम उठाता है, जिससे वह स्थिरता कमजोर हो जाती है, जिसे यह रणनीति सुरक्षित करने का दावा करती है।"

अमेरिकी एआई क्षेत्र के तीन प्रमुख व्यक्तियों द्वारा लिखित यह पत्र, अमेरिकी कांग्रेस के एक आयोग द्वारा एजीआई विकास को निधि देने के लिए "मैनहट्टन प्रोजेक्ट-शैली" की पहल का सुझाव देने के तुरंत बाद आया है, जो 1940 के दशक के अमेरिकी परमाणु बम परियोजना के समान है। अमेरिकी ऊर्जा सचिव क्रिस राइट ने हाल ही में ओपनएआई के सह-संस्थापक ग्रेग ब्रॉकमैन के साथ एक सुपरकंप्यूटर साइट पर बोलते हुए घोषणा की कि अमेरिका एआई पर "एक नए मैनहट्टन प्रोजेक्ट की शुरुआत में" है।

सुपरइंटेलिजेंस स्ट्रैटेजी पत्र कई अमेरिकी नीति और उद्योग नेताओं के हालिया दबाव को चुनौती देता है, जो मानते हैं कि सरकार समर्थित एजीआई कार्यक्रम चीन के साथ तालमेल रखने का सबसे अच्छा तरीका है।

श्मिट, वांग और हेंड्रिक्स अमेरिका को एजीआई को लेकर एक गतिरोध की स्थिति में देखते हैं, जो परस्पर सुनिश्चित विनाश की अवधारणा के समान है। जैसे राष्ट्र परमाणु हथियारों पर एकाधिकार से बचते हैं ताकि पहले से हमला न हो, लेखक सुझाव देते हैं कि अमेरिका को अत्यधिक उन्नत एआई सिस्टम पर हावी होने की जल्दबाजी से सावधान रहना चाहिए।

हालांकि एआई की तुलना परमाणु हथियारों से करना अतिशयोक्ति लग सकता है, वैश्विक नेता पहले से ही एआई को एक महत्वपूर्ण सैन्य संपत्ति के रूप में देखते हैं। पेंटागन ने उल्लेख किया है कि एआई सैन्य की हत्या श्रृंखला को तेज कर रहा है।

लेखक म्यूचुअल एश्योर्ड एआई मालफंक्शन (एमएआईएम) की अवधारणा पेश करते हैं, जहां सरकारें धमकी देने वाले एआई परियोजनाओं को अक्षम करने के लिए पहले से कार्रवाई कर सकती हैं, बजाय इसके कि विरोधी एजीआई को हथियार बनाएं।

श्मिट, वांग और हेंड्रिक्स सलाह देते हैं कि अमेरिका को "सुपरइंटेलिजेंस की दौड़ जीतने" से ध्यान हटाकर अन्य देशों को सुपरइंटेलिजेंट एआई बनाने से रोकने के तरीके विकसित करने पर ध्यान देना चाहिए। वे सुझाव देते हैं कि सरकार को "धमकी देने वाली एआई परियोजनाओं को अक्षम करने के लिए साइबर हमलों के अपने शस्त्रागार का विस्तार करना चाहिए" और विरोधियों की उन्नत एआई चिप्स और ओपन-सोर्स मॉडल तक पहुंच को प्रतिबंधित करना चाहिए।

पत्र एआई नीति समुदाय में विभाजन को उजागर करता है, जिसमें "डूमर्स" शामिल हैं, जो मानते हैं कि विनाशकारी एआई परिणाम अपरिहार्य हैं और एआई प्रगति को धीमा करने की वकालत करते हैं, और "ऑस्ट्रिचेस", जो एआई विकास को तेज करने और सर्वश्रेष्ठ की उम्मीद करते हैं।

लेखक एक तीसरा रास्ता प्रस्तावित करते हैं: एजीआई विकास के लिए एक सतर्क दृष्टिकोण जो रक्षात्मक रणनीतियों पर जोर देता है।

यह रुख विशेष रूप से श्मिट से उल्लेखनीय है, जिन्होंने पहले अमेरिका को चीन के साथ एआई विकास में आक्रामक रूप से प्रतिस्पर्धा करने की आवश्यकता पर जोर दिया था। कुछ महीने पहले ही, श्मिट ने एक लेख लिखा था जिसमें कहा गया था कि डीपसीक ने अमेरिका-चीन एआई दौड़ में एक महत्वपूर्ण क्षण को चिह्नित किया।

ट्रम्प प्रशासन के अमेरिका के एआई विकास को आगे बढ़ाने के दृढ़ संकल्प के बावजूद, सह-लेखक हमें याद दिलाते हैं कि एजीआई पर अमेरिकी निर्णयों के वैश्विक निहितार्थ हैं।

जैसा कि दुनिया अमेरिका के एआई में धक्का को देखती है, श्मिट और उनके सह-लेखक सुझाव देते हैं कि अधिक रक्षात्मक रणनीति बुद्धिमानी भरा विकल्प हो सकता है।

पूर्व OpenAI इंजीनियर ने कंपनी संस्कृति और तेजी से विकास पर अंतर्दृष्टि साझा की

तीन सप्ताह पहले, कैल्विन फ्रेंच-ओवेन, एक इंजीनियर जिन्होंने OpenAI के एक प्रमुख उत्पाद में योगदान दिया, ने कंपनी छोड़ दी।उन्होंने हाल ही में एक आकर्षक ब्लॉग पोस्ट साझा किया जिसमें OpenAI में उनके एक स

पूर्व OpenAI इंजीनियर ने कंपनी संस्कृति और तेजी से विकास पर अंतर्दृष्टि साझा की

तीन सप्ताह पहले, कैल्विन फ्रेंच-ओवेन, एक इंजीनियर जिन्होंने OpenAI के एक प्रमुख उत्पाद में योगदान दिया, ने कंपनी छोड़ दी।उन्होंने हाल ही में एक आकर्षक ब्लॉग पोस्ट साझा किया जिसमें OpenAI में उनके एक स

Google ने उद्यम बाजार में OpenAI के साथ प्रतिस्पर्धा करने के लिए उत्पादन-तैयार Gemini 2.5 AI मॉडल्स का अनावरण किया

Google ने सोमवार को अपनी AI रणनीति को और मजबूत किया, उद्यम उपयोग के लिए अपने उन्नत Gemini 2.5 मॉडल्स को लॉन्च किया और कीमत व प्रदर्शन पर प्रतिस्पर्धा करने के लिए एक लागत-कुशल संस्करण पेश किया।Alphabet

Google ने उद्यम बाजार में OpenAI के साथ प्रतिस्पर्धा करने के लिए उत्पादन-तैयार Gemini 2.5 AI मॉडल्स का अनावरण किया

Google ने सोमवार को अपनी AI रणनीति को और मजबूत किया, उद्यम उपयोग के लिए अपने उन्नत Gemini 2.5 मॉडल्स को लॉन्च किया और कीमत व प्रदर्शन पर प्रतिस्पर्धा करने के लिए एक लागत-कुशल संस्करण पेश किया।Alphabet

मेटा AI प्रतिभा के लिए उच्च वेतन प्रदान करता है, 100 मिलियन डॉलर के साइनिंग बोनस से इनकार

मेटा अपने नए सुपरइंटेलिजेंस लैब में AI शोधकर्ताओं को आकर्षित करने के लिए लाखों डॉलर के मुआवजे पैकेज प्रदान कर रहा है। हालांकि, एक भर्ती किए गए शोधकर्ता और लीक हुई आंतरिक बैठक की टिप्पणियों के अनुसार,

मेटा AI प्रतिभा के लिए उच्च वेतन प्रदान करता है, 100 मिलियन डॉलर के साइनिंग बोनस से इनकार

मेटा अपने नए सुपरइंटेलिजेंस लैब में AI शोधकर्ताओं को आकर्षित करने के लिए लाखों डॉलर के मुआवजे पैकेज प्रदान कर रहा है। हालांकि, एक भर्ती किए गए शोधकर्ता और लीक हुई आंतरिक बैठक की टिप्पणियों के अनुसार,

28 जुलाई 2025 6:49:30 पूर्वाह्न IST

28 जुलाई 2025 6:49:30 पूर्वाह्न IST

Eric Schmidt's take on AGI is refreshing! No need for a rushed, mega-project vibe—slow and steady wins the race, right? Curious how this will play out with AI ethics debates. 🤔

0

0

23 जुलाई 2025 10:29:47 पूर्वाह्न IST

23 जुलाई 2025 10:29:47 पूर्वाह्न IST

Eric Schmidt's take on pausing the AGI race is refreshing! It's like saying, 'Hey, let's not sprint toward a sci-fi apocalypse.' Superhuman AI sounds cool, but I’d rather we take our time to avoid any Skynet vibes. 😅 What’s next, a global AI ethics council?

0

0

20 अप्रैल 2025 11:02:22 अपराह्न IST

20 अप्रैल 2025 11:02:22 अपराह्न IST

La postura de Eric Schmidt de no apresurarse en un Proyecto Manhattan para AGI es bastante inteligente. No necesitamos otra carrera hacia el fondo con IA superhumana. Vamos a tomarnos nuestro tiempo y hacerlo bien, o podríamos terminar con más problemas que soluciones. 🤔

0

0

18 अप्रैल 2025 11:59:08 अपराह्न IST

18 अप्रैल 2025 11:59:08 अपराह्न IST

A visão de Eric Schmidt sobre AGI está certa! Não precisamos de um projeto Manhattan para desenvolver IA super-humana. Devemos ser cautelosos e pensar nas implicações. Seu artigo com Wang e Hendrycks é leitura obrigatória! 👀📚

0

0

18 अप्रैल 2025 9:54:42 अपराह्न IST

18 अप्रैल 2025 9:54:42 अपराह्न IST

에릭 슈미트의 AGI에 대한 의견이 맞아요! 초인공지능 AI를 서두를 필요가 없어요. 신중하게 생각해야 합니다. 그의 논문은 꼭 읽어봐야 해요! 👀📚

0

0

18 अप्रैल 2025 6:50:43 अपराह्न IST

18 अप्रैल 2025 6:50:43 अपराह्न IST

एरिक श्मिट का AGI पर नज़रिया सही है! हमें सुपरह्यूमन AI के लिए मैनहट्टन प्रोजेक्ट जैसी जल्दबाजी की ज़रूरत नहीं है। हमें सावधान रहना चाहिए और प्रभावों के बारे में सोचना चाहिए। उनका पेपर वांग और हेंड्रिक्स के साथ ज़रूर पढ़ना चाहिए! 👀📚

0

0