दीपमाइंड के सीईओ डेमिस हसाबिस ने Google के मिथुन और वीओ एआई मॉडल के भविष्य के एकीकरण की घोषणा की

पॉडकास्ट Possible के हालिया एपिसोड में, जिसे लिंक्डइन के सह-संस्थापक रीड हॉफमैन ने सह-होस्ट किया, Google DeepMind के सीईओ डेमिस हस्साबिस ने Google की योजनाओं के बारे में कुछ रोमांचक खबरें साझा कीं। उन्होंने खुलासा किया कि Google अपने Gemini AI मॉडल्स को Veo वीडियो-जनरेटिंग मॉडल्स के साथ मिलाने की योजना बना रहा है। इस एकीकरण का उद्देश्य Gemini की भौतिक दुनिया की समझ को बढ़ाना है, जिससे यह वास्तविक जीवन की गतिशीलता को बेहतर ढंग से समझने में सक्षम हो।

हस्साबिस ने जोर देकर कहा कि शुरुआत से ही Gemini को मल्टीमॉडल होने के लिए डिज़ाइन किया गया था। "हमने हमेशा अपने फाउंडेशन मॉडल Gemini को शुरू से ही मल्टीमॉडल बनाया है," उन्होंने समझाया। इस दृष्टिकोण के पीछे की प्रेरणा? एक यूनिवर्सल डिजिटल असिस्टेंट का दृष्टिकोण जो वास्तव में रोज़मर्रा के जीवन में सहायता कर सके। "एक असिस्टेंट जो … वास्तव में वास्तविक दुनिया में आपकी मदद करता है," हस्साबिस ने विस्तार से बताया।

AI उद्योग धीरे-धीरे उन मॉडल्स की ओर बढ़ रहा है जिन्हें आप "ओम्नी" मॉडल्स कह सकते हैं—वे जो विभिन्न प्रकार के मीडिया को संभालने और संश्लेषित करने में सक्षम हैं। उदाहरण के लिए, Google के नवीनतम Gemini संस्करण न केवल टेक्स्ट बल्कि ऑडियो और छवियां भी उत्पन्न कर सकते हैं। इस बीच, OpenAI का ChatGPT डिफ़ॉल्ट मॉडल तुरंत छवियां बना सकता है, जिसमें स्टूडियो घिबली-शैली की रमणीय कला भी शामिल है। Amazon भी पीछे नहीं है, इस साल के अंत में "एनी-टू-एनी" मॉडल लॉन्च करने की योजना के साथ।

इन ओम्नी मॉडल्स को भारी मात्रा में प्रशिक्षण डेटा की आवश्यकता होती है—छवियां, वीडियो, ऑडियो और टेक्स्ट। हस्साबिस ने संकेत दिया कि Veo का वीडियो डेटा मुख्य रूप से YouTube से आता है, जो Google के स्वामित्व वाला एक खजाना है। "मूल रूप से, YouTube वीडियो देखकर — बहुत सारे YouTube वीडियो — [Veo 2] दुनिया के भौतिकी को समझ सकता है," उन्होंने उल्लेख किया।

Google ने पहले TechCrunch को बताया था कि इसके मॉडल्स को "कुछ" YouTube सामग्री पर प्रशिक्षित "किया जा सकता है", जो YouTube क्रिएटर्स के साथ किए गए समझौतों के अनुरूप है। यह ध्यान देने योग्य है कि पिछले साल, Google ने अपनी सेवा की शर्तों का विस्तार किया, आंशिक रूप से अपने AI मॉडल्स को प्रशिक्षित करने के लिए अधिक डेटा तक पहुंचने के लिए।

संबंधित लेख

Google ने AI मोड और Veo 3 का अनावरण किया ताकि खोज और वीडियो निर्माण में क्रांति लाई जा सके

Google ने हाल ही में AI मोड और Veo 3 लॉन्च किया, दो नवाचारपूर्ण तकनीकें जो वेब खोज और डिजिटल सामग्री निर्माण को नया रूप देने के लिए तैयार हैं। AI मोड एक अनुकूलित, AI-संवर्धित खोज अनुभव प्रदान करता है

Google ने AI मोड और Veo 3 का अनावरण किया ताकि खोज और वीडियो निर्माण में क्रांति लाई जा सके

Google ने हाल ही में AI मोड और Veo 3 लॉन्च किया, दो नवाचारपूर्ण तकनीकें जो वेब खोज और डिजिटल सामग्री निर्माण को नया रूप देने के लिए तैयार हैं। AI मोड एक अनुकूलित, AI-संवर्धित खोज अनुभव प्रदान करता है

जेमिनी चैटबॉट छवि संपादन क्षमताओं को बढ़ाता है

गूगल का जेमिनी चैटबॉट ऐप अब उपयोगकर्ताओं को फोन या कंप्यूटर से AI-जनरेटेड और अपलोड की गई छवियों को संपादित करने की अनुमति देता है, कंपनी ने बुधवार को एक ब्लॉग पोस्ट में घोषणा की।जेमिनी की अंतर्निहित छ

जेमिनी चैटबॉट छवि संपादन क्षमताओं को बढ़ाता है

गूगल का जेमिनी चैटबॉट ऐप अब उपयोगकर्ताओं को फोन या कंप्यूटर से AI-जनरेटेड और अपलोड की गई छवियों को संपादित करने की अनुमति देता है, कंपनी ने बुधवार को एक ब्लॉग पोस्ट में घोषणा की।जेमिनी की अंतर्निहित छ

Google ने Gemini AI प्रदर्शन को बढ़ाने के लिए Deep Think का अनावरण किया

Google अपने शीर्ष स्तरीय Gemini AI मॉडलों को आगे बढ़ा रहा है।मंगलवार को Google I/O 2025 में, कंपनी ने अपने प्रमुख Gemini 2.5 Pro मॉडल के लिए एक उन्नत तर्क मोड, Deep Think, पेश किया। Deep Think मॉडल को

सूचना (1)

0/200

Google ने Gemini AI प्रदर्शन को बढ़ाने के लिए Deep Think का अनावरण किया

Google अपने शीर्ष स्तरीय Gemini AI मॉडलों को आगे बढ़ा रहा है।मंगलवार को Google I/O 2025 में, कंपनी ने अपने प्रमुख Gemini 2.5 Pro मॉडल के लिए एक उन्नत तर्क मोड, Deep Think, पेश किया। Deep Think मॉडल को

सूचना (1)

0/200

![RalphSanchez]() RalphSanchez

RalphSanchez

1 अगस्त 2025 8:18:18 पूर्वाह्न IST

1 अगस्त 2025 8:18:18 पूर्वाह्न IST

Wow, merging Gemini with Veo sounds like a game-changer! Can't wait to see how this powers up video creation. But, like, is Google trying to dominate every AI corner now? 😅

0

0

पॉडकास्ट Possible के हालिया एपिसोड में, जिसे लिंक्डइन के सह-संस्थापक रीड हॉफमैन ने सह-होस्ट किया, Google DeepMind के सीईओ डेमिस हस्साबिस ने Google की योजनाओं के बारे में कुछ रोमांचक खबरें साझा कीं। उन्होंने खुलासा किया कि Google अपने Gemini AI मॉडल्स को Veo वीडियो-जनरेटिंग मॉडल्स के साथ मिलाने की योजना बना रहा है। इस एकीकरण का उद्देश्य Gemini की भौतिक दुनिया की समझ को बढ़ाना है, जिससे यह वास्तविक जीवन की गतिशीलता को बेहतर ढंग से समझने में सक्षम हो।

हस्साबिस ने जोर देकर कहा कि शुरुआत से ही Gemini को मल्टीमॉडल होने के लिए डिज़ाइन किया गया था। "हमने हमेशा अपने फाउंडेशन मॉडल Gemini को शुरू से ही मल्टीमॉडल बनाया है," उन्होंने समझाया। इस दृष्टिकोण के पीछे की प्रेरणा? एक यूनिवर्सल डिजिटल असिस्टेंट का दृष्टिकोण जो वास्तव में रोज़मर्रा के जीवन में सहायता कर सके। "एक असिस्टेंट जो … वास्तव में वास्तविक दुनिया में आपकी मदद करता है," हस्साबिस ने विस्तार से बताया।

AI उद्योग धीरे-धीरे उन मॉडल्स की ओर बढ़ रहा है जिन्हें आप "ओम्नी" मॉडल्स कह सकते हैं—वे जो विभिन्न प्रकार के मीडिया को संभालने और संश्लेषित करने में सक्षम हैं। उदाहरण के लिए, Google के नवीनतम Gemini संस्करण न केवल टेक्स्ट बल्कि ऑडियो और छवियां भी उत्पन्न कर सकते हैं। इस बीच, OpenAI का ChatGPT डिफ़ॉल्ट मॉडल तुरंत छवियां बना सकता है, जिसमें स्टूडियो घिबली-शैली की रमणीय कला भी शामिल है। Amazon भी पीछे नहीं है, इस साल के अंत में "एनी-टू-एनी" मॉडल लॉन्च करने की योजना के साथ।

इन ओम्नी मॉडल्स को भारी मात्रा में प्रशिक्षण डेटा की आवश्यकता होती है—छवियां, वीडियो, ऑडियो और टेक्स्ट। हस्साबिस ने संकेत दिया कि Veo का वीडियो डेटा मुख्य रूप से YouTube से आता है, जो Google के स्वामित्व वाला एक खजाना है। "मूल रूप से, YouTube वीडियो देखकर — बहुत सारे YouTube वीडियो — [Veo 2] दुनिया के भौतिकी को समझ सकता है," उन्होंने उल्लेख किया।

Google ने पहले TechCrunch को बताया था कि इसके मॉडल्स को "कुछ" YouTube सामग्री पर प्रशिक्षित "किया जा सकता है", जो YouTube क्रिएटर्स के साथ किए गए समझौतों के अनुरूप है। यह ध्यान देने योग्य है कि पिछले साल, Google ने अपनी सेवा की शर्तों का विस्तार किया, आंशिक रूप से अपने AI मॉडल्स को प्रशिक्षित करने के लिए अधिक डेटा तक पहुंचने के लिए।

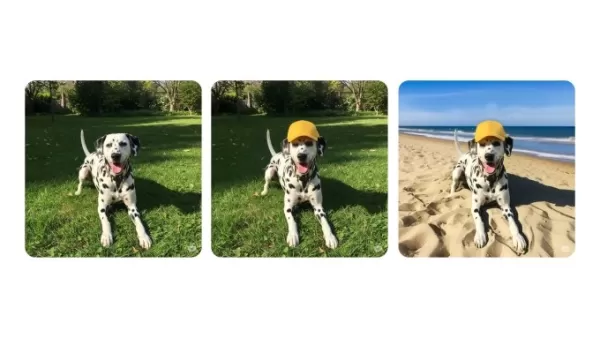

जेमिनी चैटबॉट छवि संपादन क्षमताओं को बढ़ाता है

गूगल का जेमिनी चैटबॉट ऐप अब उपयोगकर्ताओं को फोन या कंप्यूटर से AI-जनरेटेड और अपलोड की गई छवियों को संपादित करने की अनुमति देता है, कंपनी ने बुधवार को एक ब्लॉग पोस्ट में घोषणा की।जेमिनी की अंतर्निहित छ

जेमिनी चैटबॉट छवि संपादन क्षमताओं को बढ़ाता है

गूगल का जेमिनी चैटबॉट ऐप अब उपयोगकर्ताओं को फोन या कंप्यूटर से AI-जनरेटेड और अपलोड की गई छवियों को संपादित करने की अनुमति देता है, कंपनी ने बुधवार को एक ब्लॉग पोस्ट में घोषणा की।जेमिनी की अंतर्निहित छ

Google ने Gemini AI प्रदर्शन को बढ़ाने के लिए Deep Think का अनावरण किया

Google अपने शीर्ष स्तरीय Gemini AI मॉडलों को आगे बढ़ा रहा है।मंगलवार को Google I/O 2025 में, कंपनी ने अपने प्रमुख Gemini 2.5 Pro मॉडल के लिए एक उन्नत तर्क मोड, Deep Think, पेश किया। Deep Think मॉडल को

Google ने Gemini AI प्रदर्शन को बढ़ाने के लिए Deep Think का अनावरण किया

Google अपने शीर्ष स्तरीय Gemini AI मॉडलों को आगे बढ़ा रहा है।मंगलवार को Google I/O 2025 में, कंपनी ने अपने प्रमुख Gemini 2.5 Pro मॉडल के लिए एक उन्नत तर्क मोड, Deep Think, पेश किया। Deep Think मॉडल को

1 अगस्त 2025 8:18:18 पूर्वाह्न IST

1 अगस्त 2025 8:18:18 पूर्वाह्न IST

Wow, merging Gemini with Veo sounds like a game-changer! Can't wait to see how this powers up video creation. But, like, is Google trying to dominate every AI corner now? 😅

0

0