कोहेरे ने टॉप-रेटेड अया विज़न एआई मॉडल का अनावरण किया

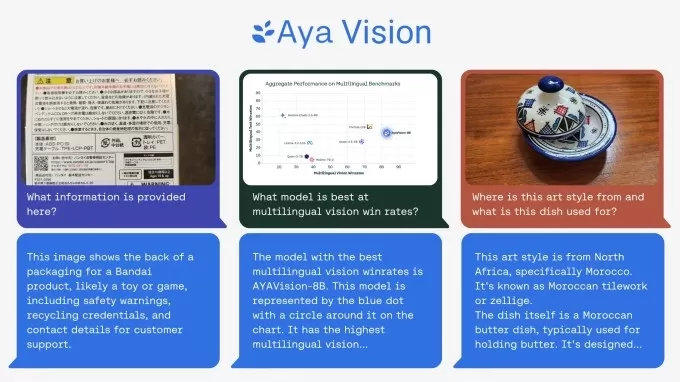

कोहेयर की गैर-लाभकारी अनुसंधान प्रयोगशाला ने अभी-अभी एक नया मल्टीमॉडल AI मॉडल लॉन्च किया है जिसका नाम है आया विज़न, और वे इसे अपनी श्रेणी में सर्वश्रेष्ठ बता रहे हैं। यह मॉडल काफी शानदार है—यह छवियों के लिए कैप्शन बना सकता है, तस्वीरों के बारे में सवालों के जवाब दे सकता है, टेक्स्ट का अनुवाद कर सकता है, और यहां तक कि 23 प्रमुख भाषाओं में सामग्री का सारांश भी बना सकता है। इसके अलावा, कोहेयर आया विज़न को व्हाट्सएप पर मुफ्त में उपलब्ध करा रहा है, और कह रहा है कि यह तकनीकी प्रगति को दुनिया भर के शोधकर्ताओं के हाथों तक पहुंचाने की दिशा में एक बड़ा कदम है।

अपने ब्लॉग पोस्ट में, कोहेयर ने बताया कि हालांकि AI ने काफी प्रगति की है, फिर भी विभिन्न भाषाओं को संभालने में मॉडलों की क्षमता में एक बड़ा अंतर है, खासकर जब इसमें टेक्स्ट और छवियां दोनों शामिल हों। यहीं पर आया विज़न आता है, जो इस अंतर को पाटने का लक्ष्य रखता है।

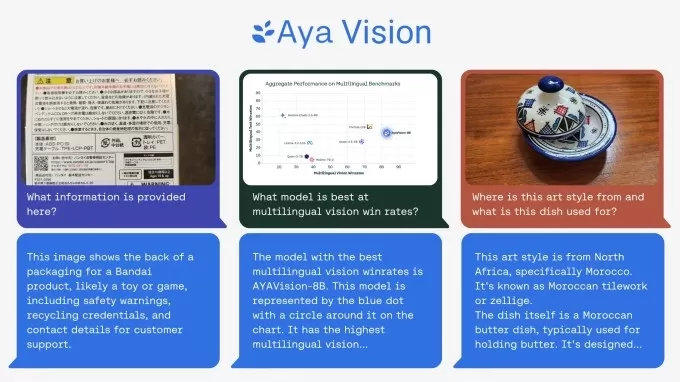

आया विज़न दो संस्करणों में आता है: अधिक शक्तिशाली आया विज़न 32B और हल्का आया विज़न 8B। कोहेयर के अनुसार, 32B संस्करण एक "नया मानक" स्थापित कर रहा है, जो कुछ दृश्य समझ के परीक्षणों में मेटा के लामा-3.2 90B विज़न जैसे दोगुने आकार के मॉडलों को भी मात दे रहा है। और 8B संस्करण? यह उन मॉडलों के खिलाफ अपनी जगह बना रहा है जो इससे 10 गुना बड़े हैं।

आप दोनों मॉडलों को हगिंग फेस से क्रिएटिव कॉमन्स 4.0 लाइसेंस के तहत प्राप्त कर सकते हैं, लेकिन एक शर्त है—इनका व्यावसायिक उपयोग नहीं किया जा सकता।

कोहेयर ने आया विज़न को अंग्रेजी डेटासेट के मिश्रण का उपयोग करके प्रशिक्षित किया, जिनका अनुवाद किया गया और उन्हें सिंथेटिक एनोटेशन में बदला गया। ये एनोटेशन, या टैग, मॉडल को प्रशिक्षण के दौरान डेटा को समझने में मदद करते हैं। उदाहरण के लिए, यदि आप एक छवि पहचान मॉडल को प्रशिक्षित कर रहे हैं, तो आप एनोटेशन का उपयोग करके वस्तुओं को चिह्नित कर सकते हैं या तस्वीर में मौजूद चीजों के बारे में कैप्शन जोड़ सकते हैं।

कोहेयर का आया विज़न मॉडल दृश्य समझ से संबंधित कई कार्य कर सकता है। छवि साभार: कोहेयर सिंथेटिक एनोटेशन का उपयोग आजकल बहुत लोकप्रिय है, भले ही इसके कुछ नुकसान हों। OpenAI जैसे बड़े खिलाड़ी भी सिंथेटिक डेटा की दौड़ में शामिल हो रहे हैं क्योंकि वास्तविक दुनिया का डेटा मिलना कठिन होता जा रहा है। गार्टनर का अनुमान है कि पिछले साल, AI और एनालिटिक्स परियोजनाओं के लिए उपयोग किए गए 60% डेटा सिंथेटिक था।कोहेयर का कहना है कि आया विज़न को सिंथेटिक एनोटेशन पर प्रशिक्षित करने से उन्हें कम संसाधनों का उपयोग करते हुए भी शानदार परिणाम प्राप्त करने में मदद मिली। उनका कहना है कि यह सब दक्षता के बारे में है और कम संसाधनों के साथ अधिक काम करने के बारे में है, जो उन शोधकर्ताओं के लिए अच्छी खबर है जिनके पास हमेशा बड़े कंप्यूटिंग संसाधनों तक पहुंच नहीं होती।

आया विज़न के साथ-साथ, कोहेयर ने एक नया बेंचमार्क सूट भी जारी किया है जिसका नाम है आया विज़न बेंच। यह मॉडल की क्षमताओं को उन कार्यों में परखने के लिए डिज़ाइन किया गया है जैसे कि छवियों के बीच अंतर पहचानना और स्क्रीनशॉट को कोड में बदलना।

AI की दुनिया कुछ लोगों द्वारा "मूल्यांकन संकट" कहे जाने वाले मुद्दे से जूझ रही है। सामान्य बेंचमार्क आपको एक समग्र स्कोर देते हैं जो वास्तव में यह नहीं दर्शाता कि मॉडल उन कार्यों में कितना अच्छा प्रदर्शन करता है जो अधिकांश उपयोगकर्ताओं के लिए महत्वपूर्ण हैं। कोहेयर का मानना है कि आया विज़न बेंच इस समस्या को ठीक करने में मदद कर सकता है, जो मॉडल की बहुभाषी और मल्टीमॉडल क्षमताओं को जांचने का एक कठिन और व्यापक तरीका प्रदान करता है।

उम्मीद है कि वे सही हैं। कोहेयर के शोधकर्ताओं का कहना है कि यह डेटासेट बहुभाषी और वास्तविक दुनिया के परिदृश्यों में विज़न-लैंग्वेज मॉडलों के परीक्षण के लिए एक ठोस बेंचमार्क है। उन्होंने इसे शोध समुदाय के लिए उपलब्ध कराया है ताकि बहुभाषी मल्टीमॉडल मूल्यांकन को आगे बढ़ाने में मदद मिल सके।

संबंधित लेख

हगिंग फेस ओपनई के अनुसंधान उपकरण के लिए खुला विकल्प विकसित करता है

सह-संस्थापक और मुख्य वैज्ञानिक थॉमस वुल्फ सहित हगिंग फेस में डेवलपर्स की एक टीम ने ओपनईआई के डीप रिसर्च टूल का "ओपन" संस्करण कहा है। Openai ने हाल ही में एक घटना में गहन शोध शुरू किया, जहां यह पता चला कि उपकरण अनुसंधान रिपोर्ट उत्पन्न करने के लिए वेब को स्कोर करता है

हगिंग फेस ओपनई के अनुसंधान उपकरण के लिए खुला विकल्प विकसित करता है

सह-संस्थापक और मुख्य वैज्ञानिक थॉमस वुल्फ सहित हगिंग फेस में डेवलपर्स की एक टीम ने ओपनईआई के डीप रिसर्च टूल का "ओपन" संस्करण कहा है। Openai ने हाल ही में एक घटना में गहन शोध शुरू किया, जहां यह पता चला कि उपकरण अनुसंधान रिपोर्ट उत्पन्न करने के लिए वेब को स्कोर करता है

सर्वश्रेष्ठ AI कोडिंग टूल का चयन आपके प्रोजेक्ट के लिए

सॉफ्टवेयर डेवलपमेंट का परिदृश्य तेजी से बदल रहा है, जिसमें कृत्रिम बुद्धिमत्ता (AI) एक प्रमुख प्रेरक शक्ति बन रही है। AI कोडिंग टूल डेवलपर्स को कोड तेजी से, अधिक सटीकता के साथ और अधिक दक्षता के साथ लि

सर्वश्रेष्ठ AI कोडिंग टूल का चयन आपके प्रोजेक्ट के लिए

सॉफ्टवेयर डेवलपमेंट का परिदृश्य तेजी से बदल रहा है, जिसमें कृत्रिम बुद्धिमत्ता (AI) एक प्रमुख प्रेरक शक्ति बन रही है। AI कोडिंग टूल डेवलपर्स को कोड तेजी से, अधिक सटीकता के साथ और अधिक दक्षता के साथ लि

AI-चालित पॉडकास्ट उपकरण सरलीकृत सामग्री निर्माण के लिए

पॉडकास्ट का निर्माण और परिष्करण करना एक साथ चुनौतीपूर्ण और संतुष्टिदायक हो सकता है। कई पॉडकास्टरों को समय लेने वाले कार्यों जैसे कि फिलर शब्दों को हटाने, आकर्षक शो नोट्स तैयार करने, और सामग्री को प्रभ

सूचना (42)

0/200

AI-चालित पॉडकास्ट उपकरण सरलीकृत सामग्री निर्माण के लिए

पॉडकास्ट का निर्माण और परिष्करण करना एक साथ चुनौतीपूर्ण और संतुष्टिदायक हो सकता है। कई पॉडकास्टरों को समय लेने वाले कार्यों जैसे कि फिलर शब्दों को हटाने, आकर्षक शो नोट्स तैयार करने, और सामग्री को प्रभ

सूचना (42)

0/200

![KennethMartin]() KennethMartin

KennethMartin

10 अगस्त 2025 10:30:59 पूर्वाह्न IST

10 अगस्त 2025 10:30:59 पूर्वाह्न IST

This Aya Vision model sounds like a game-changer! Captioning images and translating in 23 languages? That’s some next-level tech. Can’t wait to see how it stacks up against the big players like OpenAI. 😎

0

0

![PaulKing]() PaulKing

PaulKing

31 जुलाई 2025 5:05:39 अपराह्न IST

31 जुलाई 2025 5:05:39 अपराह्न IST

This Aya Vision model sounds like a game-changer! Being able to handle images and 23 languages is wild—imagine using it to instantly caption my travel photos or summarize foreign articles. Curious how it stacks up against other AI models in real-world tasks. 😎

0

0

![JackMartinez]() JackMartinez

JackMartinez

21 अप्रैल 2025 7:02:08 पूर्वाह्न IST

21 अप्रैल 2025 7:02:08 पूर्वाह्न IST

Aya Vision es increíblemente útil. Lo utilizo para mis proyectos de diseño y me encanta cómo genera descripciones de imágenes. Aunque a veces se equivoca con los detalles, en general es muy preciso. ¡Lo recomiendo totalmente! 🌟

0

0

![WilliamYoung]() WilliamYoung

WilliamYoung

20 अप्रैल 2025 6:28:05 पूर्वाह्न IST

20 अप्रैल 2025 6:28:05 पूर्वाह्न IST

Aya Vision ist echt cool, aber es hat manchmal Schwierigkeiten mit der Übersetzung. Trotzdem ist es eine tolle Hilfe für meine Arbeit. Es könnte etwas schneller sein, aber insgesamt bin ich zufrieden. 👍

0

0

![StevenGonzalez]() StevenGonzalez

StevenGonzalez

20 अप्रैल 2025 12:23:55 पूर्वाह्न IST

20 अप्रैल 2025 12:23:55 पूर्वाह्न IST

아야 비전은 멋지지만 완벽하지는 않아요. 이미지 캡션은 정확하지만 번역이 때때로 틀릴 때가 있어요. 그래도 빠른 요약을 위한 좋은 도구예요! 👍

0

0

![FredBrown]() FredBrown

FredBrown

18 अप्रैल 2025 6:52:30 पूर्वाह्न IST

18 अप्रैल 2025 6:52:30 पूर्वाह्न IST

J'adore Aya Vision, c'est super pratique pour résumer des textes en plusieurs langues. Par contre, il a du mal avec les images complexes. Mais pour le reste, c'est top ! Essayez-le, vous ne serez pas déçus. 😊

0

0

कोहेयर की गैर-लाभकारी अनुसंधान प्रयोगशाला ने अभी-अभी एक नया मल्टीमॉडल AI मॉडल लॉन्च किया है जिसका नाम है आया विज़न, और वे इसे अपनी श्रेणी में सर्वश्रेष्ठ बता रहे हैं। यह मॉडल काफी शानदार है—यह छवियों के लिए कैप्शन बना सकता है, तस्वीरों के बारे में सवालों के जवाब दे सकता है, टेक्स्ट का अनुवाद कर सकता है, और यहां तक कि 23 प्रमुख भाषाओं में सामग्री का सारांश भी बना सकता है। इसके अलावा, कोहेयर आया विज़न को व्हाट्सएप पर मुफ्त में उपलब्ध करा रहा है, और कह रहा है कि यह तकनीकी प्रगति को दुनिया भर के शोधकर्ताओं के हाथों तक पहुंचाने की दिशा में एक बड़ा कदम है।

अपने ब्लॉग पोस्ट में, कोहेयर ने बताया कि हालांकि AI ने काफी प्रगति की है, फिर भी विभिन्न भाषाओं को संभालने में मॉडलों की क्षमता में एक बड़ा अंतर है, खासकर जब इसमें टेक्स्ट और छवियां दोनों शामिल हों। यहीं पर आया विज़न आता है, जो इस अंतर को पाटने का लक्ष्य रखता है।

आया विज़न दो संस्करणों में आता है: अधिक शक्तिशाली आया विज़न 32B और हल्का आया विज़न 8B। कोहेयर के अनुसार, 32B संस्करण एक "नया मानक" स्थापित कर रहा है, जो कुछ दृश्य समझ के परीक्षणों में मेटा के लामा-3.2 90B विज़न जैसे दोगुने आकार के मॉडलों को भी मात दे रहा है। और 8B संस्करण? यह उन मॉडलों के खिलाफ अपनी जगह बना रहा है जो इससे 10 गुना बड़े हैं।

आप दोनों मॉडलों को हगिंग फेस से क्रिएटिव कॉमन्स 4.0 लाइसेंस के तहत प्राप्त कर सकते हैं, लेकिन एक शर्त है—इनका व्यावसायिक उपयोग नहीं किया जा सकता।

कोहेयर ने आया विज़न को अंग्रेजी डेटासेट के मिश्रण का उपयोग करके प्रशिक्षित किया, जिनका अनुवाद किया गया और उन्हें सिंथेटिक एनोटेशन में बदला गया। ये एनोटेशन, या टैग, मॉडल को प्रशिक्षण के दौरान डेटा को समझने में मदद करते हैं। उदाहरण के लिए, यदि आप एक छवि पहचान मॉडल को प्रशिक्षित कर रहे हैं, तो आप एनोटेशन का उपयोग करके वस्तुओं को चिह्नित कर सकते हैं या तस्वीर में मौजूद चीजों के बारे में कैप्शन जोड़ सकते हैं।

कोहेयर का कहना है कि आया विज़न को सिंथेटिक एनोटेशन पर प्रशिक्षित करने से उन्हें कम संसाधनों का उपयोग करते हुए भी शानदार परिणाम प्राप्त करने में मदद मिली। उनका कहना है कि यह सब दक्षता के बारे में है और कम संसाधनों के साथ अधिक काम करने के बारे में है, जो उन शोधकर्ताओं के लिए अच्छी खबर है जिनके पास हमेशा बड़े कंप्यूटिंग संसाधनों तक पहुंच नहीं होती।

आया विज़न के साथ-साथ, कोहेयर ने एक नया बेंचमार्क सूट भी जारी किया है जिसका नाम है आया विज़न बेंच। यह मॉडल की क्षमताओं को उन कार्यों में परखने के लिए डिज़ाइन किया गया है जैसे कि छवियों के बीच अंतर पहचानना और स्क्रीनशॉट को कोड में बदलना।

AI की दुनिया कुछ लोगों द्वारा "मूल्यांकन संकट" कहे जाने वाले मुद्दे से जूझ रही है। सामान्य बेंचमार्क आपको एक समग्र स्कोर देते हैं जो वास्तव में यह नहीं दर्शाता कि मॉडल उन कार्यों में कितना अच्छा प्रदर्शन करता है जो अधिकांश उपयोगकर्ताओं के लिए महत्वपूर्ण हैं। कोहेयर का मानना है कि आया विज़न बेंच इस समस्या को ठीक करने में मदद कर सकता है, जो मॉडल की बहुभाषी और मल्टीमॉडल क्षमताओं को जांचने का एक कठिन और व्यापक तरीका प्रदान करता है।

उम्मीद है कि वे सही हैं। कोहेयर के शोधकर्ताओं का कहना है कि यह डेटासेट बहुभाषी और वास्तविक दुनिया के परिदृश्यों में विज़न-लैंग्वेज मॉडलों के परीक्षण के लिए एक ठोस बेंचमार्क है। उन्होंने इसे शोध समुदाय के लिए उपलब्ध कराया है ताकि बहुभाषी मल्टीमॉडल मूल्यांकन को आगे बढ़ाने में मदद मिल सके।

हगिंग फेस ओपनई के अनुसंधान उपकरण के लिए खुला विकल्प विकसित करता है

सह-संस्थापक और मुख्य वैज्ञानिक थॉमस वुल्फ सहित हगिंग फेस में डेवलपर्स की एक टीम ने ओपनईआई के डीप रिसर्च टूल का "ओपन" संस्करण कहा है। Openai ने हाल ही में एक घटना में गहन शोध शुरू किया, जहां यह पता चला कि उपकरण अनुसंधान रिपोर्ट उत्पन्न करने के लिए वेब को स्कोर करता है

हगिंग फेस ओपनई के अनुसंधान उपकरण के लिए खुला विकल्प विकसित करता है

सह-संस्थापक और मुख्य वैज्ञानिक थॉमस वुल्फ सहित हगिंग फेस में डेवलपर्स की एक टीम ने ओपनईआई के डीप रिसर्च टूल का "ओपन" संस्करण कहा है। Openai ने हाल ही में एक घटना में गहन शोध शुरू किया, जहां यह पता चला कि उपकरण अनुसंधान रिपोर्ट उत्पन्न करने के लिए वेब को स्कोर करता है

सर्वश्रेष्ठ AI कोडिंग टूल का चयन आपके प्रोजेक्ट के लिए

सॉफ्टवेयर डेवलपमेंट का परिदृश्य तेजी से बदल रहा है, जिसमें कृत्रिम बुद्धिमत्ता (AI) एक प्रमुख प्रेरक शक्ति बन रही है। AI कोडिंग टूल डेवलपर्स को कोड तेजी से, अधिक सटीकता के साथ और अधिक दक्षता के साथ लि

सर्वश्रेष्ठ AI कोडिंग टूल का चयन आपके प्रोजेक्ट के लिए

सॉफ्टवेयर डेवलपमेंट का परिदृश्य तेजी से बदल रहा है, जिसमें कृत्रिम बुद्धिमत्ता (AI) एक प्रमुख प्रेरक शक्ति बन रही है। AI कोडिंग टूल डेवलपर्स को कोड तेजी से, अधिक सटीकता के साथ और अधिक दक्षता के साथ लि

AI-चालित पॉडकास्ट उपकरण सरलीकृत सामग्री निर्माण के लिए

पॉडकास्ट का निर्माण और परिष्करण करना एक साथ चुनौतीपूर्ण और संतुष्टिदायक हो सकता है। कई पॉडकास्टरों को समय लेने वाले कार्यों जैसे कि फिलर शब्दों को हटाने, आकर्षक शो नोट्स तैयार करने, और सामग्री को प्रभ

AI-चालित पॉडकास्ट उपकरण सरलीकृत सामग्री निर्माण के लिए

पॉडकास्ट का निर्माण और परिष्करण करना एक साथ चुनौतीपूर्ण और संतुष्टिदायक हो सकता है। कई पॉडकास्टरों को समय लेने वाले कार्यों जैसे कि फिलर शब्दों को हटाने, आकर्षक शो नोट्स तैयार करने, और सामग्री को प्रभ

10 अगस्त 2025 10:30:59 पूर्वाह्न IST

10 अगस्त 2025 10:30:59 पूर्वाह्न IST

This Aya Vision model sounds like a game-changer! Captioning images and translating in 23 languages? That’s some next-level tech. Can’t wait to see how it stacks up against the big players like OpenAI. 😎

0

0

31 जुलाई 2025 5:05:39 अपराह्न IST

31 जुलाई 2025 5:05:39 अपराह्न IST

This Aya Vision model sounds like a game-changer! Being able to handle images and 23 languages is wild—imagine using it to instantly caption my travel photos or summarize foreign articles. Curious how it stacks up against other AI models in real-world tasks. 😎

0

0

21 अप्रैल 2025 7:02:08 पूर्वाह्न IST

21 अप्रैल 2025 7:02:08 पूर्वाह्न IST

Aya Vision es increíblemente útil. Lo utilizo para mis proyectos de diseño y me encanta cómo genera descripciones de imágenes. Aunque a veces se equivoca con los detalles, en general es muy preciso. ¡Lo recomiendo totalmente! 🌟

0

0

20 अप्रैल 2025 6:28:05 पूर्वाह्न IST

20 अप्रैल 2025 6:28:05 पूर्वाह्न IST

Aya Vision ist echt cool, aber es hat manchmal Schwierigkeiten mit der Übersetzung. Trotzdem ist es eine tolle Hilfe für meine Arbeit. Es könnte etwas schneller sein, aber insgesamt bin ich zufrieden. 👍

0

0

20 अप्रैल 2025 12:23:55 पूर्वाह्न IST

20 अप्रैल 2025 12:23:55 पूर्वाह्न IST

아야 비전은 멋지지만 완벽하지는 않아요. 이미지 캡션은 정확하지만 번역이 때때로 틀릴 때가 있어요. 그래도 빠른 요약을 위한 좋은 도구예요! 👍

0

0

18 अप्रैल 2025 6:52:30 पूर्वाह्न IST

18 अप्रैल 2025 6:52:30 पूर्वाह्न IST

J'adore Aya Vision, c'est super pratique pour résumer des textes en plusieurs langues. Par contre, il a du mal avec les images complexes. Mais pour le reste, c'est top ! Essayez-le, vous ne serez pas déçus. 😊

0

0