Google introduit le partage d'appareils photo en temps réel dans le moteur de recherche

Google étend les fonctionnalités de recherche "Live" alimentées par l'IA à l'ensemble des plates-formes

Lors de la conférence des développeurs I/O qui s'est tenue aujourd'hui, Google a dévoilé un accès élargi à sa fonction innovante "Live", qui permet aux utilisateurs d'explorer leur environnement par le biais d'une recherche visuelle alimentée par l'IA. Cette technologie sera bientôt intégrée au mode IA amélioré de Google Search et sera disponible sur l'application iOS Gemini, après avoir été lancée avec succès sur Android le mois dernier.

Du projet Astra à la recherche grand public

La fonctionnalité de partage d'appareils photo est apparue pour la première fois dans le cadre du projet expérimental Astra de Google lors de la conférence I/O de l'année dernière, avant de devenir Gemini Live pour les appareils Android. Cette technologie révolutionnaire transforme les caméras mobiles en assistants IA interactifs, permettant des conversations en temps réel sur des environnements physiques - qu'il s'agisse d'identifier des ingrédients pour préparer un repas ou d'expliquer des objets complexes.

Intégration directe avec le mode Search AI

Google révolutionne la recherche en intégrant cette intelligence visuelle directement dans l'expérience de recherche de base, aux côtés de Google Lens. Les utilisateurs qui activent la nouvelle icône "Live" peuvent instantanément diffuser le flux de leur appareil photo pour obtenir des informations contextuelles sur leur environnement par le biais de requêtes en langage naturel. Lancée en version bêta cet été sous le nom de Live Search, cette fonctionnalité s'ajoute à d'autres innovations du mode AI, notamment

- Recherche approfondie avancée pour une recherche complète

- Interaction automatisée avec le web grâce à des agents d'intelligence artificielle

- Outils de commerce électronique de nouvelle génération

Disponibilité multiplateforme

La version iOS de Gemini reflétera bientôt les capacités d'Android, en ajoutant des fonctionnalités de caméra et de partage d'écran. Après avoir initialement testé ces fonctionnalités sur des appareils haut de gamme comme le Pixel 9 et le Galaxy S25, Google a étendu la prise en charge à tous les utilisateurs d'Android. Dans une démarche favorable aux consommateurs, l'entreprise est revenue sur son projet initial de restreindre les fonctionnalités de base derrière le paywall de Gemini Advanced, garantissant ainsi un accès gratuit sur toutes les plateformes.

Article connexe

Google introduit le partage d'appareils photo en temps réel dans le moteur de recherche

Google étend les fonctionnalités de recherche "Live" alimentées par l'IA à l'ensemble des plates-formesLors de la conférence des développeurs I/O qui s'est tenue aujourd'hui, Google a dévoilé un accès

Google introduit le partage d'appareils photo en temps réel dans le moteur de recherche

Google étend les fonctionnalités de recherche "Live" alimentées par l'IA à l'ensemble des plates-formesLors de la conférence des développeurs I/O qui s'est tenue aujourd'hui, Google a dévoilé un accès

Le Chromecast est relancé avec de nouvelles fonctionnalités et des mises à jour passionnantes

Une alternative de streaming familière émerge pour les fans de ChromecastLorsque Google a progressivement abandonné ses dongles Chromecast compacts au profit d'un décodeur TV Streamer plus encombrant,

Le Chromecast est relancé avec de nouvelles fonctionnalités et des mises à jour passionnantes

Une alternative de streaming familière émerge pour les fans de ChromecastLorsque Google a progressivement abandonné ses dongles Chromecast compacts au profit d'un décodeur TV Streamer plus encombrant,

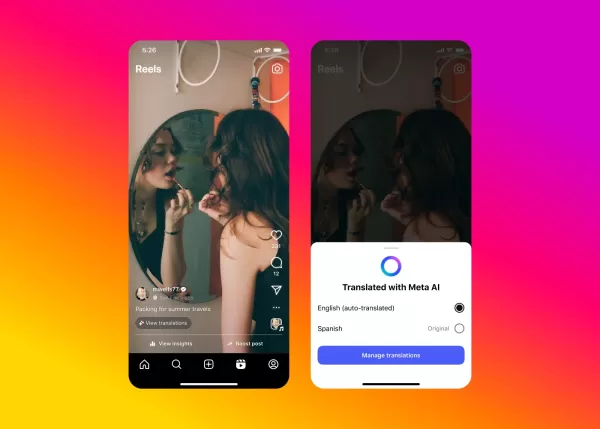

L'IA de Meta s'attaque au doublage vidéo pour les contenus Instagram

Meta élargit l'accès à sa technologie révolutionnaire de doublage alimentée par l'IA sur Facebook et Instagram, en introduisant des capacités de traduction vidéo transparentes qui conservent votre voi

commentaires (0)

0/200

L'IA de Meta s'attaque au doublage vidéo pour les contenus Instagram

Meta élargit l'accès à sa technologie révolutionnaire de doublage alimentée par l'IA sur Facebook et Instagram, en introduisant des capacités de traduction vidéo transparentes qui conservent votre voi

commentaires (0)

0/200

Google étend les fonctionnalités de recherche "Live" alimentées par l'IA à l'ensemble des plates-formes

Lors de la conférence des développeurs I/O qui s'est tenue aujourd'hui, Google a dévoilé un accès élargi à sa fonction innovante "Live", qui permet aux utilisateurs d'explorer leur environnement par le biais d'une recherche visuelle alimentée par l'IA. Cette technologie sera bientôt intégrée au mode IA amélioré de Google Search et sera disponible sur l'application iOS Gemini, après avoir été lancée avec succès sur Android le mois dernier.

Du projet Astra à la recherche grand public

La fonctionnalité de partage d'appareils photo est apparue pour la première fois dans le cadre du projet expérimental Astra de Google lors de la conférence I/O de l'année dernière, avant de devenir Gemini Live pour les appareils Android. Cette technologie révolutionnaire transforme les caméras mobiles en assistants IA interactifs, permettant des conversations en temps réel sur des environnements physiques - qu'il s'agisse d'identifier des ingrédients pour préparer un repas ou d'expliquer des objets complexes.

Intégration directe avec le mode Search AI

Google révolutionne la recherche en intégrant cette intelligence visuelle directement dans l'expérience de recherche de base, aux côtés de Google Lens. Les utilisateurs qui activent la nouvelle icône "Live" peuvent instantanément diffuser le flux de leur appareil photo pour obtenir des informations contextuelles sur leur environnement par le biais de requêtes en langage naturel. Lancée en version bêta cet été sous le nom de Live Search, cette fonctionnalité s'ajoute à d'autres innovations du mode AI, notamment

- Recherche approfondie avancée pour une recherche complète

- Interaction automatisée avec le web grâce à des agents d'intelligence artificielle

- Outils de commerce électronique de nouvelle génération

Disponibilité multiplateforme

La version iOS de Gemini reflétera bientôt les capacités d'Android, en ajoutant des fonctionnalités de caméra et de partage d'écran. Après avoir initialement testé ces fonctionnalités sur des appareils haut de gamme comme le Pixel 9 et le Galaxy S25, Google a étendu la prise en charge à tous les utilisateurs d'Android. Dans une démarche favorable aux consommateurs, l'entreprise est revenue sur son projet initial de restreindre les fonctionnalités de base derrière le paywall de Gemini Advanced, garantissant ainsi un accès gratuit sur toutes les plateformes.

Google introduit le partage d'appareils photo en temps réel dans le moteur de recherche

Google étend les fonctionnalités de recherche "Live" alimentées par l'IA à l'ensemble des plates-formesLors de la conférence des développeurs I/O qui s'est tenue aujourd'hui, Google a dévoilé un accès

Google introduit le partage d'appareils photo en temps réel dans le moteur de recherche

Google étend les fonctionnalités de recherche "Live" alimentées par l'IA à l'ensemble des plates-formesLors de la conférence des développeurs I/O qui s'est tenue aujourd'hui, Google a dévoilé un accès

Le Chromecast est relancé avec de nouvelles fonctionnalités et des mises à jour passionnantes

Une alternative de streaming familière émerge pour les fans de ChromecastLorsque Google a progressivement abandonné ses dongles Chromecast compacts au profit d'un décodeur TV Streamer plus encombrant,

Le Chromecast est relancé avec de nouvelles fonctionnalités et des mises à jour passionnantes

Une alternative de streaming familière émerge pour les fans de ChromecastLorsque Google a progressivement abandonné ses dongles Chromecast compacts au profit d'un décodeur TV Streamer plus encombrant,

L'IA de Meta s'attaque au doublage vidéo pour les contenus Instagram

Meta élargit l'accès à sa technologie révolutionnaire de doublage alimentée par l'IA sur Facebook et Instagram, en introduisant des capacités de traduction vidéo transparentes qui conservent votre voi

L'IA de Meta s'attaque au doublage vidéo pour les contenus Instagram

Meta élargit l'accès à sa technologie révolutionnaire de doublage alimentée par l'IA sur Facebook et Instagram, en introduisant des capacités de traduction vidéo transparentes qui conservent votre voi