As escroqueries d'appels vidéo: comment sauvegarder contre la tromperie numérique

Dans notre monde de plus en plus connecté, la technologie a révolutionné nos interactions et notre quotidien. Cependant, ces avancées s'accompagnent de nouveaux défis, notamment dans le domaine des fraudes et des escroqueries. L'intelligence artificielle (AI) est une arme à double tranchant : elle offre des avantages incroyables, mais est également exploitée par des escrocs pour créer des deep fakes convaincants et des arnaques sophistiquées. Cet article explore les spécificités des escroqueries par appels vidéo AI, vous fournissant les connaissances et outils nécessaires pour protéger vous-même et vos proches.

Comprendre la menace : les escroqueries par appels vidéo AI

Que sont les escroqueries par appels vidéo AI ?

Les escroqueries par appels vidéo AI représentent une menace croissante, utilisant l'AI pour fabriquer des imitations vidéo et audio hyperréalistes de personnes réelles. Ces escrocs exploitent la technologie des deep fakes pour imiter l'apparence et la voix de quelqu'un, rendant difficile la distinction entre une personne authentique et un imposteur généré par AI. Ils ciblent souvent les individus ayant une forte présence en ligne, en tirant parti des nombreuses photos et vidéos partagées sur les réseaux sociaux. L'essor des paiements numériques a exacerbé ces escroqueries, permettant aux escrocs de recevoir des fonds rapidement et anonymement. Contrairement aux escroqueries traditionnelles, qui peuvent impliquer des interactions physiques ou des méthodes traçables, les escroqueries par appels vidéo AI exploitent la confiance et la facilité de la communication numérique.

Les escrocs utilisent des deep fakes générés par AI pour créer une façade d'authenticité, incitant les victimes à divulguer des informations sensibles ou à transférer de l'argent. En combinant des tactiques d'ingénierie sociale avec une technologie avancée de deep fakes, les escrocs peuvent se faire passer de manière convaincante pour des personnes de confiance, comme des membres de la famille ou des amis. Cette tromperie rend les escroqueries par appels vidéo AI très efficaces et difficiles à détecter, entraînant souvent des pertes financières importantes et une détresse émotionnelle pour les victimes. Rester informé sur ces escroqueries AI est crucial pour protéger vous-même et votre famille.

Reconnaître les signes d'une escroquerie par appel vidéo AI est votre première ligne de défense. Méfiez-vous des appels vidéo non sollicités provenant de numéros inconnus, surtout si l'appelant demande de l'argent ou des informations personnelles. Vérifiez toujours l'identité de la personne via d'autres canaux, comme un numéro de téléphone ou une adresse e-mail connus. Les escrocs créent souvent un sentiment d'urgence pour presser les victimes, alors prenez votre temps et évaluez soigneusement toute demande avant d'agir. De plus, renforcer les paramètres de confidentialité sur les réseaux sociaux et minimiser les informations personnelles partagées en ligne peut réduire votre vulnérabilité à ces escroqueries.

L'impact des escroqueries par appels vidéo AI peut être dévastateur, tant sur le plan financier qu'émotionnel. Les pertes financières peuvent varier de mineures à substantielles, selon la sophistication de l'escroquerie et la réponse de la victime. Sur le plan émotionnel, les victimes ressentent souvent de la honte, de la culpabilité et de la colère, surtout lorsqu'un proche est imité. Ce poids émotionnel peut perdurer, entraînant anxiété et dépression. Sensibiliser et promouvoir la littératie numérique sont des étapes essentielles pour atténuer l'impact sur les victimes potentielles. Éduquer les gens sur les risques des fraudes alimentées par AI leur permet d'identifier et d'éviter ces escroqueries, protégeant leur bien-être financier et mental. Rester vigilant et informé est essentiel à l'ère numérique.

Tactiques courantes des escroqueries AI

Comment les escrocs utilisent l'AI

Les escrocs affinent constamment leurs méthodes pour exploiter les vulnérabilités de la communication numérique. Une tactique courante consiste à collecter des photos et vidéos publiquement disponibles sur les réseaux sociaux pour créer des deep fakes convaincants. Avec suffisamment de données, ils peuvent imiter de manière convaincante l'apparence et la voix de quelqu'un lors d'un appel vidéo, augmentant les chances de succès de l'escroquerie.

En plus de l'imitation vidéo, les escrocs utilisent l'AI pour produire des clips audio réalistes qui reproduisent la voix d'une personne. En analysant des enregistrements vocaux existants, l'AI peut synthétiser de nouvelles phrases qui semblent authentiques. Cette technologie de clonage vocal permet aux escrocs de concocter des scénarios plausibles, incitant les victimes à divulguer des informations sensibles ou à transférer des fonds. Par exemple, un escroc peut utiliser une voix clonée pour appeler une victime, se faisant passer pour un membre de la famille ayant un besoin urgent d'aide financière. La victime, croyant parler à un proche, est plus susceptible de se conformer aux demandes de l'escroc.

L'ingénierie sociale joue un rôle clé dans les escroqueries AI. Les escrocs instillent souvent un sentiment d'urgence ou de peur pour manipuler les victimes et les pousser à agir rapidement sans réfléchir. Ils peuvent prétendre qu'un proche est en danger ou qu'une urgence financière nécessite une action immédiate. Cette manipulation émotionnelle peut brouiller le jugement, rendant les victimes plus vulnérables aux tactiques des escrocs. Il est essentiel de rester calme et sceptique dans ces situations, en vérifiant toute revendication avant d'agir. Comprendre ces tactiques courantes vous permet de mieux vous protéger contre les fraudes alimentées par AI.

Tactique Description Exemple Appels vidéo deep fake Utilisation de vidéos générées par AI pour imiter des individus lors d'appels vidéo. Escroquer des parents âgés en simulant une urgence impliquant leur petit-enfant. Clonage vocal Génération de clips audio réalistes imitant la voix d'une personne pour tromper les victimes. Appeler une victime en se faisant passer pour un membre de la famille ayant un besoin urgent d'aide financière. Ingénierie sociale Création d'un sentiment d'urgence ou de peur pour manipuler les victimes afin qu'elles agissent rapidement. Prétendre qu'un proche est en danger ou qu'une urgence financière nécessite une attention immédiate.

Se protéger des escroqueries par appels vidéo AI

Techniques de vérification

Lorsque vous recevez un appel vidéo, surtout d'une source inconnue ou d'une personne avec qui vous ne communiquez pas régulièrement, vérifier l'identité de l'appelant est crucial. Commencez par poser des questions personnelles que seule la vraie personne connaîtrait, comme des détails sur des expériences partagées ou des événements familiaux. Si l'appelant a du mal à répondre précisément, cela peut être un signal d'alarme.

Une autre méthode efficace consiste à vérifier l'identité de l'appelant via d'autres canaux de communication. Si vous recevez un appel vidéo de quelqu'un prétendant être en situation d'urgence, contactez-le directement via un numéro de téléphone ou une adresse e-mail connus pour confirmer la situation. Si un contact direct n'est pas possible, contactez d'autres membres de la famille ou des amis communs pour vérifier l'histoire de l'appelant. Utiliser plusieurs sources pour confirmer l'identité de l'appelant réduit considérablement le risque de devenir victime d'une escroquerie.

Pendant l'appel vidéo, soyez attentif aux indices visuels et auditifs. Les deep fakes peuvent présenter des anomalies subtiles, comme des incohérences dans les expressions faciales, des mouvements non naturels ou des distorsions audio. Soyez prudent si la personne évite le contact visuel ou si sa voix semble robotique ou synthétisée. Ces signes d'alerte peuvent vous aider à identifier les escroqueries potentielles avant qu'il ne soit trop tard. Faites toujours preuve de prudence et vérifiez soigneusement l'identité de l'appelant avant de partager des informations personnelles ou d'envoyer de l'argent. Si quelque chose semble suspect pendant l'appel vidéo, ne poursuivez pas.

Pratiques de sécurité numérique

Adopter des habitudes de sécurité numérique robustes peut réduire considérablement votre risque de devenir victime d'escroqueries par appels vidéo AI. Commencez par limiter les informations personnelles que vous partagez en ligne. Soyez prudent avec ce que vous publiez sur les réseaux sociaux, car les escrocs peuvent utiliser ces données pour créer des imitations réalistes. Évitez de partager des détails sensibles comme votre adresse, numéro de téléphone ou informations financières sur des profils publics. Réglez vos comptes de réseaux sociaux sur privé, afin que seules les personnes de confiance puissent accéder à votre contenu.

Mettez régulièrement à jour vos paramètres de confidentialité sur les réseaux sociaux pour contrôler qui peut voir vos publications et informations. Examinez vos listes d'amis et supprimez les comptes suspects ou inconnus. Soyez prudent en acceptant des demandes d'amis de personnes que vous ne connaissez pas, car elles pourraient être des escrocs collectant des informations à des fins malveillantes. Utilisez des mots de passe forts et uniques pour chacun de vos comptes en ligne pour empêcher un accès non autorisé. Activez l'authentification à deux facteurs lorsque possible, ajoutant une couche de sécurité supplémentaire à vos comptes.

Restez informé des dernières techniques d'escroquerie en lisant régulièrement des articles et des rapports sur la fraude numérique. Plus vous en savez sur le fonctionnement des escrocs, mieux vous serez préparé à reconnaître et éviter leurs tactiques. Partagez ces connaissances avec vos amis et votre famille, les aidant à se protéger contre les escroqueries par appels vidéo AI. En sensibilisant collectivement et en promouvant la littératie numérique, nous pouvons créer un environnement en ligne plus sûr pour tous. Soyez diligent et tenez-vous à jour sur les informations de sécurité actuelles pour mieux vous protéger.

Que faire si vous suspectez une escroquerie

Si vous pensez être ciblé par une escroquerie par appel vidéo AI, agissez immédiatement pour minimiser les dommages potentiels. Mettez fin à l'appel et déconnectez-vous de l'escroc. Ne leur fournissez aucune information supplémentaire ni ne répondez à leurs demandes. Bloquez le numéro de téléphone et l'adresse e-mail de l'escroc pour éviter tout contact ultérieur.

Signalez l'incident aux autorités compétentes, comme la Federal Trade Commission (FTC) ou votre agence locale de maintien de l'ordre. Fournissez autant de détails que possible sur l'escroquerie, y compris le numéro de téléphone, l'adresse e-mail de l'escroc et toute autre information pertinente. Signaler l'escroquerie aide les autorités à traquer les coupables et à empêcher qu'ils ciblent d'autres personnes.

Contactez votre banque ou institution financière pour signaler toute transaction non autorisée ou activité suspecte. Ils pourront peut-être annuler les frais ou prendre d'autres mesures pour protéger votre compte. Changez vos mots de passe pour tous vos comptes en ligne, y compris e-mail, réseaux sociaux et comptes financiers. Surveillez votre rapport de crédit pour détecter des signes de vol d'identité et envisagez de placer une alerte de fraude sur votre compte pour empêcher les escrocs d'ouvrir de nouveaux comptes à votre nom. En prenant ces mesures proactives, vous pouvez vous protéger contre d'autres préjudices financiers.

Avantages et inconvénients des paiements numériques

Avantages

- Praticité : Les paiements numériques sont rapides et faciles à utiliser.

- Accessibilité : Ils permettent des transactions depuis n'importe où avec une connexion Internet.

- Efficacité : Les paiements numériques réduisent le besoin d'argent liquide.

- Automatisation : Les paiements peuvent être programmés et automatisés.

- Suivi : L'activité des paiements numériques peut être facilement suivie et examinée.

Inconvénients

- Risques de sécurité : Vulnérabilité au piratage et à la fraude.

- Problèmes de confidentialité : Risque de violations de données et de confidentialité.

- Problèmes techniques : La dépendance à la technologie peut entraîner des perturbations.

- Frais : Les frais de transaction peuvent s'accumuler avec le temps.

- Exclusion : Tout le monde n'a pas accès aux méthodes de paiement numériques.

Questions fréquemment posées (FAQ)

Comment savoir si un appel vidéo est un deep fake ?

Recherchez des incohérences dans les expressions faciales, des mouvements non naturels, des distorsions audio et si la personne évite le contact visuel. Vérifiez l'identité de la personne via d'autres canaux.

Que faire si je reçois un appel vidéo suspect ?

Mettez fin à l'appel immédiatement, bloquez le numéro, signalez l'incident aux autorités et contactez votre banque si vous avez partagé des informations financières. Alertez vos amis et votre famille du risque potentiel de cette escroquerie.

Les escroqueries par appels vidéo AI sont-elles courantes ?

Oui, avec les avancées de la technologie AI, ces escroqueries deviennent plus fréquentes et sophistiquées. Les escrocs les utilisent pour exploiter les vulnérabilités de la communication numérique. Restez informé et vigilant.

Qui est le plus susceptible d'être ciblé par les escroqueries par appels vidéo AI ?

Les individus ayant une forte présence en ligne, comme ceux qui publient fréquemment des photos et vidéos sur les réseaux sociaux, sont plus susceptibles d'être ciblés. Les personnes dans la quarantaine, cinquantaine et soixantaine sont également des cibles fréquentes.

Quelles ressources sont disponibles pour signaler et récupérer des escroqueries par appels vidéo AI ?

La Federal Trade Commission (FTC) et les agences locales de maintien de l'ordre peuvent aider à signaler les escroqueries. Pour les problèmes de vol d'identité, les bureaux de crédit peuvent aider. Si vous avez des questions, consultez les liens fournis par Technical Gurujito pour signaler les cas de cybercriminalité.

Questions connexes

Que sont les deep fakes et comment sont-ils utilisés dans les escroqueries ?

Les deep fakes sont des vidéos ou enregistrements audio générés par AI, manipulés pour imiter quelqu'un de manière convaincante. Les escrocs les utilisent pour créer des vidéos et audio réalistes d'individus à des fins de tromperie. Une arnaque deep fake notable impliquait des actualités et réseaux sociaux utilisés pour exploiter les gens. Ce problème mondial continue de croître à l'ère de l'AI. En sachant que les deep fakes existent, vous pouvez mieux détecter les situations possibles. Être conscient de la manière dont les fausses nouvelles deep fake sont générées peut vous épargner des centaines de dollars.

Comment les paiements numériques facilitent-ils ces escroqueries ?

Les paiements numériques permettent aux escrocs de recevoir de l'argent rapidement et anonymement, rendant difficile le traçage des fonds ou leur récupération. Cela est devenu un problème mondial. Utiliser des paiements en un clic permet aux escroqueries de générer des revenus sans même besoin d'une carte de crédit. Les escrocs demanderont de l'argent numériquement plutôt qu'en personne.

Quel est le rôle de l'ingénierie sociale dans les escroqueries AI ?

L'ingénierie sociale est utilisée pour créer un sentiment d'urgence ou de peur, manipulant les victimes pour qu'elles agissent rapidement sans réfléchir. Elle joue un rôle majeur dans la génération d'un résultat réussi pour l'escroc. L'ingénierie sociale implique de gagner la confiance de la victime et de créer un faux espoir autour de la solution. Lorsque vous ressentez une forte pression ou un risque extrême, ne prenez aucune décision.

Article connexe

Le mode adulte de ChatGPT est à nouveau reporté ; Ultraman : privilégier l'intelligence avant tout

OpenAI reporte une nouvelle fois le lancement d'une fonctionnalité controversée et se concentre sur la personnalisation et l'interaction proactiveLa question de savoir si un « contenu inapproprié » do

Le mode adulte de ChatGPT est à nouveau reporté ; Ultraman : privilégier l'intelligence avant tout

OpenAI reporte une nouvelle fois le lancement d'une fonctionnalité controversée et se concentre sur la personnalisation et l'interaction proactiveLa question de savoir si un « contenu inapproprié » do

Baidu Health teste en interne son assistant médical basé sur l'IA, DoctorClaw, pour la recherche documentaire et l'assistance administrative à court terme

Baidu Health aurait commencé à tester en interne un assistant intelligent basé sur l'IA, destiné aux médecins. Baptisé en interne « DoctorClaw » (la version « Lobster Doctor »), ce produit marque

Baidu Health teste en interne son assistant médical basé sur l'IA, DoctorClaw, pour la recherche documentaire et l'assistance administrative à court terme

Baidu Health aurait commencé à tester en interne un assistant intelligent basé sur l'IA, destiné aux médecins. Baptisé en interne « DoctorClaw » (la version « Lobster Doctor »), ce produit marque

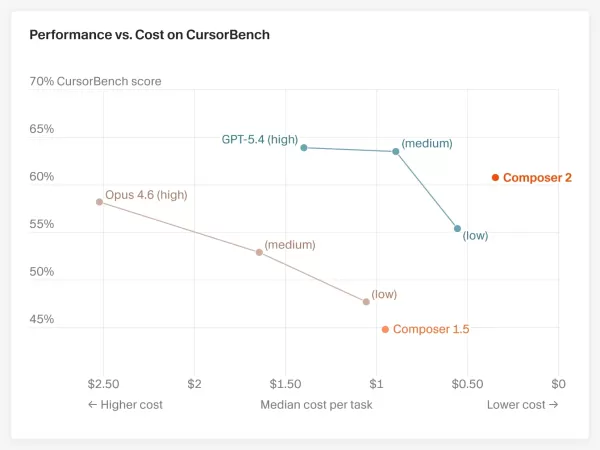

Cursor Composer 2 contre Claude Opus 4.6 : un test de performance relance le débat sur la programmation par IA

Le 19 mars, Cursor a officiellement lancé son modèle de codage développé en interne, Composer 2. Cette annonce a immédiatement suscité des discussions au sein de la communauté des développeurs : selon

Recommandations de sujets spéciaux liés

commentaires (3)

Cursor Composer 2 contre Claude Opus 4.6 : un test de performance relance le débat sur la programmation par IA

Le 19 mars, Cursor a officiellement lancé son modèle de codage développé en interne, Composer 2. Cette annonce a immédiatement suscité des discussions au sein de la communauté des développeurs : selon

Recommandations de sujets spéciaux liés

commentaires (3)

![DonaldGonzález]()

AIを使ったビデオ通話詐欺って本当に怖いですね。最近はAIで声や映像を偽造できる技術が進んでいて、知り合いになりすまして金銭を要求するケースも増えているみたい。対策として、緊急時だけに使う合言葉を家族と決めておくのも良さそう。技術の進歩は素晴らしいけど、悪用されるリスクも常に考えないと…😰

![AlbertMiller]()

This article really opened my eyes to how sneaky AI scams are getting! 😱 I had no idea video calls could be faked so convincingly. Gotta be extra careful now, especially with my grandma who loves video chatting. Any tips for spotting these fakes in real-time?

Dans notre monde de plus en plus connecté, la technologie a révolutionné nos interactions et notre quotidien. Cependant, ces avancées s'accompagnent de nouveaux défis, notamment dans le domaine des fraudes et des escroqueries. L'intelligence artificielle (AI) est une arme à double tranchant : elle offre des avantages incroyables, mais est également exploitée par des escrocs pour créer des deep fakes convaincants et des arnaques sophistiquées. Cet article explore les spécificités des escroqueries par appels vidéo AI, vous fournissant les connaissances et outils nécessaires pour protéger vous-même et vos proches.

Comprendre la menace : les escroqueries par appels vidéo AI

Que sont les escroqueries par appels vidéo AI ?

Les escroqueries par appels vidéo AI représentent une menace croissante, utilisant l'AI pour fabriquer des imitations vidéo et audio hyperréalistes de personnes réelles. Ces escrocs exploitent la technologie des deep fakes pour imiter l'apparence et la voix de quelqu'un, rendant difficile la distinction entre une personne authentique et un imposteur généré par AI. Ils ciblent souvent les individus ayant une forte présence en ligne, en tirant parti des nombreuses photos et vidéos partagées sur les réseaux sociaux. L'essor des paiements numériques a exacerbé ces escroqueries, permettant aux escrocs de recevoir des fonds rapidement et anonymement. Contrairement aux escroqueries traditionnelles, qui peuvent impliquer des interactions physiques ou des méthodes traçables, les escroqueries par appels vidéo AI exploitent la confiance et la facilité de la communication numérique.

Les escrocs utilisent des deep fakes générés par AI pour créer une façade d'authenticité, incitant les victimes à divulguer des informations sensibles ou à transférer de l'argent. En combinant des tactiques d'ingénierie sociale avec une technologie avancée de deep fakes, les escrocs peuvent se faire passer de manière convaincante pour des personnes de confiance, comme des membres de la famille ou des amis. Cette tromperie rend les escroqueries par appels vidéo AI très efficaces et difficiles à détecter, entraînant souvent des pertes financières importantes et une détresse émotionnelle pour les victimes. Rester informé sur ces escroqueries AI est crucial pour protéger vous-même et votre famille.

Reconnaître les signes d'une escroquerie par appel vidéo AI est votre première ligne de défense. Méfiez-vous des appels vidéo non sollicités provenant de numéros inconnus, surtout si l'appelant demande de l'argent ou des informations personnelles. Vérifiez toujours l'identité de la personne via d'autres canaux, comme un numéro de téléphone ou une adresse e-mail connus. Les escrocs créent souvent un sentiment d'urgence pour presser les victimes, alors prenez votre temps et évaluez soigneusement toute demande avant d'agir. De plus, renforcer les paramètres de confidentialité sur les réseaux sociaux et minimiser les informations personnelles partagées en ligne peut réduire votre vulnérabilité à ces escroqueries.

L'impact des escroqueries par appels vidéo AI peut être dévastateur, tant sur le plan financier qu'émotionnel. Les pertes financières peuvent varier de mineures à substantielles, selon la sophistication de l'escroquerie et la réponse de la victime. Sur le plan émotionnel, les victimes ressentent souvent de la honte, de la culpabilité et de la colère, surtout lorsqu'un proche est imité. Ce poids émotionnel peut perdurer, entraînant anxiété et dépression. Sensibiliser et promouvoir la littératie numérique sont des étapes essentielles pour atténuer l'impact sur les victimes potentielles. Éduquer les gens sur les risques des fraudes alimentées par AI leur permet d'identifier et d'éviter ces escroqueries, protégeant leur bien-être financier et mental. Rester vigilant et informé est essentiel à l'ère numérique.

Tactiques courantes des escroqueries AI

Comment les escrocs utilisent l'AI

Les escrocs affinent constamment leurs méthodes pour exploiter les vulnérabilités de la communication numérique. Une tactique courante consiste à collecter des photos et vidéos publiquement disponibles sur les réseaux sociaux pour créer des deep fakes convaincants. Avec suffisamment de données, ils peuvent imiter de manière convaincante l'apparence et la voix de quelqu'un lors d'un appel vidéo, augmentant les chances de succès de l'escroquerie.

En plus de l'imitation vidéo, les escrocs utilisent l'AI pour produire des clips audio réalistes qui reproduisent la voix d'une personne. En analysant des enregistrements vocaux existants, l'AI peut synthétiser de nouvelles phrases qui semblent authentiques. Cette technologie de clonage vocal permet aux escrocs de concocter des scénarios plausibles, incitant les victimes à divulguer des informations sensibles ou à transférer des fonds. Par exemple, un escroc peut utiliser une voix clonée pour appeler une victime, se faisant passer pour un membre de la famille ayant un besoin urgent d'aide financière. La victime, croyant parler à un proche, est plus susceptible de se conformer aux demandes de l'escroc.

L'ingénierie sociale joue un rôle clé dans les escroqueries AI. Les escrocs instillent souvent un sentiment d'urgence ou de peur pour manipuler les victimes et les pousser à agir rapidement sans réfléchir. Ils peuvent prétendre qu'un proche est en danger ou qu'une urgence financière nécessite une action immédiate. Cette manipulation émotionnelle peut brouiller le jugement, rendant les victimes plus vulnérables aux tactiques des escrocs. Il est essentiel de rester calme et sceptique dans ces situations, en vérifiant toute revendication avant d'agir. Comprendre ces tactiques courantes vous permet de mieux vous protéger contre les fraudes alimentées par AI.

| Tactique | Description | Exemple |

|---|---|---|

| Appels vidéo deep fake | Utilisation de vidéos générées par AI pour imiter des individus lors d'appels vidéo. | Escroquer des parents âgés en simulant une urgence impliquant leur petit-enfant. |

| Clonage vocal | Génération de clips audio réalistes imitant la voix d'une personne pour tromper les victimes. | Appeler une victime en se faisant passer pour un membre de la famille ayant un besoin urgent d'aide financière. |

| Ingénierie sociale | Création d'un sentiment d'urgence ou de peur pour manipuler les victimes afin qu'elles agissent rapidement. | Prétendre qu'un proche est en danger ou qu'une urgence financière nécessite une attention immédiate. |

Se protéger des escroqueries par appels vidéo AI

Techniques de vérification

Lorsque vous recevez un appel vidéo, surtout d'une source inconnue ou d'une personne avec qui vous ne communiquez pas régulièrement, vérifier l'identité de l'appelant est crucial. Commencez par poser des questions personnelles que seule la vraie personne connaîtrait, comme des détails sur des expériences partagées ou des événements familiaux. Si l'appelant a du mal à répondre précisément, cela peut être un signal d'alarme.

Une autre méthode efficace consiste à vérifier l'identité de l'appelant via d'autres canaux de communication. Si vous recevez un appel vidéo de quelqu'un prétendant être en situation d'urgence, contactez-le directement via un numéro de téléphone ou une adresse e-mail connus pour confirmer la situation. Si un contact direct n'est pas possible, contactez d'autres membres de la famille ou des amis communs pour vérifier l'histoire de l'appelant. Utiliser plusieurs sources pour confirmer l'identité de l'appelant réduit considérablement le risque de devenir victime d'une escroquerie.

Pendant l'appel vidéo, soyez attentif aux indices visuels et auditifs. Les deep fakes peuvent présenter des anomalies subtiles, comme des incohérences dans les expressions faciales, des mouvements non naturels ou des distorsions audio. Soyez prudent si la personne évite le contact visuel ou si sa voix semble robotique ou synthétisée. Ces signes d'alerte peuvent vous aider à identifier les escroqueries potentielles avant qu'il ne soit trop tard. Faites toujours preuve de prudence et vérifiez soigneusement l'identité de l'appelant avant de partager des informations personnelles ou d'envoyer de l'argent. Si quelque chose semble suspect pendant l'appel vidéo, ne poursuivez pas.

Pratiques de sécurité numérique

Adopter des habitudes de sécurité numérique robustes peut réduire considérablement votre risque de devenir victime d'escroqueries par appels vidéo AI. Commencez par limiter les informations personnelles que vous partagez en ligne. Soyez prudent avec ce que vous publiez sur les réseaux sociaux, car les escrocs peuvent utiliser ces données pour créer des imitations réalistes. Évitez de partager des détails sensibles comme votre adresse, numéro de téléphone ou informations financières sur des profils publics. Réglez vos comptes de réseaux sociaux sur privé, afin que seules les personnes de confiance puissent accéder à votre contenu.

Mettez régulièrement à jour vos paramètres de confidentialité sur les réseaux sociaux pour contrôler qui peut voir vos publications et informations. Examinez vos listes d'amis et supprimez les comptes suspects ou inconnus. Soyez prudent en acceptant des demandes d'amis de personnes que vous ne connaissez pas, car elles pourraient être des escrocs collectant des informations à des fins malveillantes. Utilisez des mots de passe forts et uniques pour chacun de vos comptes en ligne pour empêcher un accès non autorisé. Activez l'authentification à deux facteurs lorsque possible, ajoutant une couche de sécurité supplémentaire à vos comptes.

Restez informé des dernières techniques d'escroquerie en lisant régulièrement des articles et des rapports sur la fraude numérique. Plus vous en savez sur le fonctionnement des escrocs, mieux vous serez préparé à reconnaître et éviter leurs tactiques. Partagez ces connaissances avec vos amis et votre famille, les aidant à se protéger contre les escroqueries par appels vidéo AI. En sensibilisant collectivement et en promouvant la littératie numérique, nous pouvons créer un environnement en ligne plus sûr pour tous. Soyez diligent et tenez-vous à jour sur les informations de sécurité actuelles pour mieux vous protéger.

Que faire si vous suspectez une escroquerie

Si vous pensez être ciblé par une escroquerie par appel vidéo AI, agissez immédiatement pour minimiser les dommages potentiels. Mettez fin à l'appel et déconnectez-vous de l'escroc. Ne leur fournissez aucune information supplémentaire ni ne répondez à leurs demandes. Bloquez le numéro de téléphone et l'adresse e-mail de l'escroc pour éviter tout contact ultérieur.

Signalez l'incident aux autorités compétentes, comme la Federal Trade Commission (FTC) ou votre agence locale de maintien de l'ordre. Fournissez autant de détails que possible sur l'escroquerie, y compris le numéro de téléphone, l'adresse e-mail de l'escroc et toute autre information pertinente. Signaler l'escroquerie aide les autorités à traquer les coupables et à empêcher qu'ils ciblent d'autres personnes.

Contactez votre banque ou institution financière pour signaler toute transaction non autorisée ou activité suspecte. Ils pourront peut-être annuler les frais ou prendre d'autres mesures pour protéger votre compte. Changez vos mots de passe pour tous vos comptes en ligne, y compris e-mail, réseaux sociaux et comptes financiers. Surveillez votre rapport de crédit pour détecter des signes de vol d'identité et envisagez de placer une alerte de fraude sur votre compte pour empêcher les escrocs d'ouvrir de nouveaux comptes à votre nom. En prenant ces mesures proactives, vous pouvez vous protéger contre d'autres préjudices financiers.

Avantages et inconvénients des paiements numériques

Avantages

- Praticité : Les paiements numériques sont rapides et faciles à utiliser.

- Accessibilité : Ils permettent des transactions depuis n'importe où avec une connexion Internet.

- Efficacité : Les paiements numériques réduisent le besoin d'argent liquide.

- Automatisation : Les paiements peuvent être programmés et automatisés.

- Suivi : L'activité des paiements numériques peut être facilement suivie et examinée.

Inconvénients

- Risques de sécurité : Vulnérabilité au piratage et à la fraude.

- Problèmes de confidentialité : Risque de violations de données et de confidentialité.

- Problèmes techniques : La dépendance à la technologie peut entraîner des perturbations.

- Frais : Les frais de transaction peuvent s'accumuler avec le temps.

- Exclusion : Tout le monde n'a pas accès aux méthodes de paiement numériques.

Questions fréquemment posées (FAQ)

Comment savoir si un appel vidéo est un deep fake ?

Recherchez des incohérences dans les expressions faciales, des mouvements non naturels, des distorsions audio et si la personne évite le contact visuel. Vérifiez l'identité de la personne via d'autres canaux.

Que faire si je reçois un appel vidéo suspect ?

Mettez fin à l'appel immédiatement, bloquez le numéro, signalez l'incident aux autorités et contactez votre banque si vous avez partagé des informations financières. Alertez vos amis et votre famille du risque potentiel de cette escroquerie.

Les escroqueries par appels vidéo AI sont-elles courantes ?

Oui, avec les avancées de la technologie AI, ces escroqueries deviennent plus fréquentes et sophistiquées. Les escrocs les utilisent pour exploiter les vulnérabilités de la communication numérique. Restez informé et vigilant.

Qui est le plus susceptible d'être ciblé par les escroqueries par appels vidéo AI ?

Les individus ayant une forte présence en ligne, comme ceux qui publient fréquemment des photos et vidéos sur les réseaux sociaux, sont plus susceptibles d'être ciblés. Les personnes dans la quarantaine, cinquantaine et soixantaine sont également des cibles fréquentes.

Quelles ressources sont disponibles pour signaler et récupérer des escroqueries par appels vidéo AI ?

La Federal Trade Commission (FTC) et les agences locales de maintien de l'ordre peuvent aider à signaler les escroqueries. Pour les problèmes de vol d'identité, les bureaux de crédit peuvent aider. Si vous avez des questions, consultez les liens fournis par Technical Gurujito pour signaler les cas de cybercriminalité.

Questions connexes

Que sont les deep fakes et comment sont-ils utilisés dans les escroqueries ?

Les deep fakes sont des vidéos ou enregistrements audio générés par AI, manipulés pour imiter quelqu'un de manière convaincante. Les escrocs les utilisent pour créer des vidéos et audio réalistes d'individus à des fins de tromperie. Une arnaque deep fake notable impliquait des actualités et réseaux sociaux utilisés pour exploiter les gens. Ce problème mondial continue de croître à l'ère de l'AI. En sachant que les deep fakes existent, vous pouvez mieux détecter les situations possibles. Être conscient de la manière dont les fausses nouvelles deep fake sont générées peut vous épargner des centaines de dollars.

Comment les paiements numériques facilitent-ils ces escroqueries ?

Les paiements numériques permettent aux escrocs de recevoir de l'argent rapidement et anonymement, rendant difficile le traçage des fonds ou leur récupération. Cela est devenu un problème mondial. Utiliser des paiements en un clic permet aux escroqueries de générer des revenus sans même besoin d'une carte de crédit. Les escrocs demanderont de l'argent numériquement plutôt qu'en personne.

Quel est le rôle de l'ingénierie sociale dans les escroqueries AI ?

L'ingénierie sociale est utilisée pour créer un sentiment d'urgence ou de peur, manipulant les victimes pour qu'elles agissent rapidement sans réfléchir. Elle joue un rôle majeur dans la génération d'un résultat réussi pour l'escroc. L'ingénierie sociale implique de gagner la confiance de la victime et de créer un faux espoir autour de la solution. Lorsque vous ressentez une forte pression ou un risque extrême, ne prenez aucune décision.

Le mode adulte de ChatGPT est à nouveau reporté ; Ultraman : privilégier l'intelligence avant tout

OpenAI reporte une nouvelle fois le lancement d'une fonctionnalité controversée et se concentre sur la personnalisation et l'interaction proactiveLa question de savoir si un « contenu inapproprié » do

Le mode adulte de ChatGPT est à nouveau reporté ; Ultraman : privilégier l'intelligence avant tout

OpenAI reporte une nouvelle fois le lancement d'une fonctionnalité controversée et se concentre sur la personnalisation et l'interaction proactiveLa question de savoir si un « contenu inapproprié » do

Baidu Health teste en interne son assistant médical basé sur l'IA, DoctorClaw, pour la recherche documentaire et l'assistance administrative à court terme

Baidu Health aurait commencé à tester en interne un assistant intelligent basé sur l'IA, destiné aux médecins. Baptisé en interne « DoctorClaw » (la version « Lobster Doctor »), ce produit marque

Baidu Health teste en interne son assistant médical basé sur l'IA, DoctorClaw, pour la recherche documentaire et l'assistance administrative à court terme

Baidu Health aurait commencé à tester en interne un assistant intelligent basé sur l'IA, destiné aux médecins. Baptisé en interne « DoctorClaw » (la version « Lobster Doctor »), ce produit marque

Cursor Composer 2 contre Claude Opus 4.6 : un test de performance relance le débat sur la programmation par IA

Le 19 mars, Cursor a officiellement lancé son modèle de codage développé en interne, Composer 2. Cette annonce a immédiatement suscité des discussions au sein de la communauté des développeurs : selon

Cursor Composer 2 contre Claude Opus 4.6 : un test de performance relance le débat sur la programmation par IA

Le 19 mars, Cursor a officiellement lancé son modèle de codage développé en interne, Composer 2. Cette annonce a immédiatement suscité des discussions au sein de la communauté des développeurs : selon

AIを使ったビデオ通話詐欺って本当に怖いですね。最近はAIで声や映像を偽造できる技術が進んでいて、知り合いになりすまして金銭を要求するケースも増えているみたい。対策として、緊急時だけに使う合言葉を家族と決めておくのも良さそう。技術の進歩は素晴らしいけど、悪用されるリスクも常に考えないと…😰

This article really opened my eyes to how sneaky AI scams are getting! 😱 I had no idea video calls could be faked so convincingly. Gotta be extra careful now, especially with my grandma who loves video chatting. Any tips for spotting these fakes in real-time?

Maison

Maison