Ai Power Surge: Anthropic PDG met en garde contre la race pour comprendre

Juste après que le sommet de l'action de l'IA à Paris s'est terminé, le co-fondateur et PDG d'Anthropic, Dario Amodei, n'a pas retenu. Il a qualifié l'événement de "l'occasion manquée" et a souligné que nous devons augmenter l'orientation et l'urgence sur plusieurs questions clés, compte tenu de la vitesse à laquelle AI Tech évolue. Il a partagé ces réflexions dans une déclaration publiée mardi.

Anthropic s'est associé à la startup française Dust pour un événement axé sur les développeurs à Paris, où TechCrunch a pu discuter avec Amodei sur scène. Il a partagé son point de vue et a poussé à une approche équilibrée de l'innovation et de la gouvernance de l'IA, évitant à la fois l'optimisme extrême et les critiques sévères.

Amodei, qui était un neuroscientifique, a déclaré: "J'ai essentiellement regardé à l'intérieur du cerveau réel pour gagner ma vie. Et maintenant, nous regardons à l'intérieur des cerveaux artificiels pour vivre. Nous allons donc, au cours des prochains mois, des avancées passionnantes dans le domaine de l'interprétabilité - où nous commençons vraiment à comprendre comment les modèles fonctionnent." Mais il a également souligné que c'était une course. "C'est une course entre rendre les modèles plus puissants, ce qui est incroyablement rapide pour nous et incroyablement rapide pour les autres - vous ne pouvez pas vraiment ralentir, non? ... Notre compréhension doit suivre notre capacité à construire des choses. Je pense que c'est le seul moyen", a-t-il ajouté.

Depuis le premier sommet de l'IA à Bletchley, au Royaume-Uni, la conversation autour de la gouvernance de l'IA a beaucoup changé, influencé par le climat géopolitique actuel. Le vice-président américain JD Vance, s'exprimant lors du sommet de l'action de l'IA, a déclaré: "Je ne suis pas ici ce matin pour parler de la sécurité de l'IA, qui était le titre de la conférence il y a quelques années. Je suis ici pour parler de l'opportunité de l'IA."

Amodei, cependant, essaie de combler le fossé entre la sécurité et l'opportunité. Il pense que se concentrer davantage sur la sécurité peut être une opportunité. "Lors du sommet original, le Sommet britannique de Bletchley, il y a eu beaucoup de discussions sur les tests et la mesure pour divers risques. Et je ne pense pas que ces choses aient ralenti la technologie", a-t-il déclaré lors de l'événement anthropique. "Si quelque chose, faire ce type de mesure nous a aidés à mieux comprendre nos modèles, ce qui nous aide à produire de meilleurs modèles."

Même en mettant l'accent sur la sécurité, Amodei a clairement indiqué qu'Anthropic est toujours entièrement dans les modèles d'IA frontaliers de construction. "Je ne veux rien faire pour réduire la promesse. Nous fournissons des modèles chaque jour sur lesquels les gens peuvent s'appuyer et qui sont utilisés pour faire des choses incroyables. Et nous ne devrions certainement pas arrêter de le faire", a-t-il déclaré. Plus tard, il a ajouté: "Quand les gens parlent beaucoup des risques, je suis en quelque sorte ennuyé, et je dis:" Oh, mec, personne n'a vraiment fait du bon travail pour vraiment expliquer à quel point cette technologie pourrait être formidable. ""

Lorsque le sujet s'est tourné vers les récents modèles de Chinois LLM-Maker Deepseek, Amodei a minimisé ses réalisations, appelant la réaction du public "inorganique". Il a dit: "Honnêtement, ma réaction a été très peu. Nous avions vu V3, qui est le modèle de base de Deepseek R1, en décembre. Et c'était un modèle impressionnant. Le modèle qui a été publié en décembre était sur ce type de courbe de réduction des coûts très normale que nous avons vue dans nos modèles et autres modèles." Ce qui a attiré son attention, c'est que le modèle ne provenait pas des "trois ou quatre laboratoires frontaliers" habituels aux États-Unis, comme Google, Openai et Anthropic. Il a exprimé son inquiétude concernant les gouvernements autoritaires qui dominent la technologie. Quant aux frais de formation réclamés de Deepseek, il les a rejetés comme "tout simplement pas exacts et non basés sur des faits".

Bien qu'Amodei n'ait pas annoncé de nouveaux modèles lors de l'événement, il a fait allusion aux prochaines versions avec des capacités de raisonnement améliorées. "Nous nous concentrons généralement sur l'essayage de faire notre propre vision des modèles de raisonnement qui sont mieux différenciés. Nous nous soucions de nous assurer que nous avons suffisamment de capacité, que les modèles deviennent plus intelligents et que nous nous inquiétons des choses de sécurité", a-t-il déclaré.

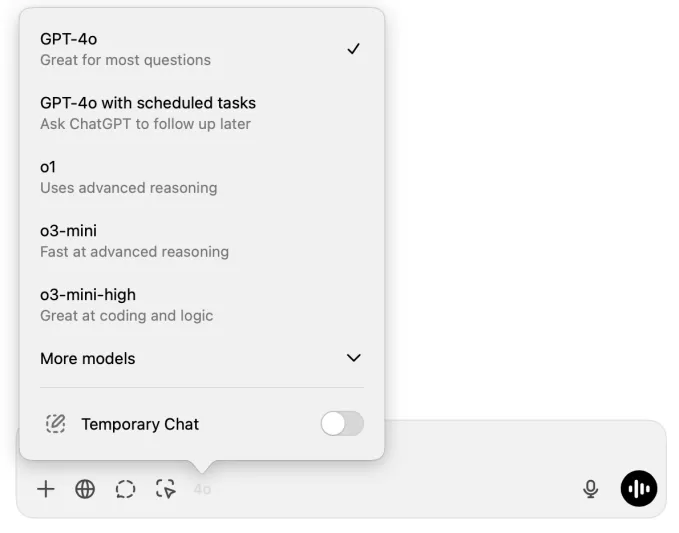

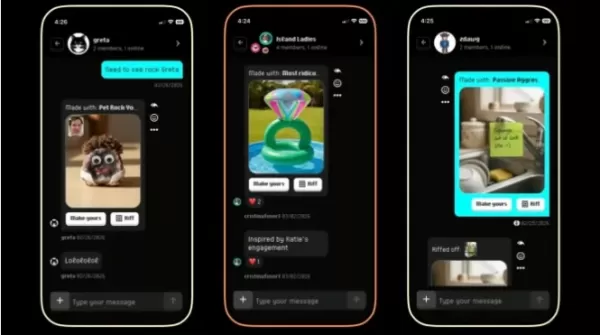

Anthropic aborde également le défi de sélection du modèle. Si vous êtes un utilisateur Chatgpt Plus, par exemple, il peut être difficile de décider quel modèle utiliser pour votre prochain message.

Crédits d'image: capture d'écran de Chatgpt Il en va de même pour les développeurs utilisant des API de modèle grand langage (LLM) dans leurs applications, qui doivent équilibrer la précision, la vitesse de réponse et les coûts.

Amodei a remis en question la distinction entre les modèles normaux et le raisonnement. "Nous avons été un peu perplexes par l'idée qu'il existe des modèles normaux et qu'il existe des modèles de raisonnement et qu'ils sont en quelque sorte différents les uns des autres", a-t-il déclaré. "Si je vous parle, vous n'avez pas deux cerveaux et que l'un d'eux répond tout de suite et comme, l'autre attend plus longtemps."

Il pense qu'il devrait y avoir une transition plus fluide entre les modèles pré-formés comme Claude 3.5 Sonnet ou GPT-4O et les modèles formés avec l'apprentissage du renforcement qui peut produire une chaîne de pensées (COT), comme O1 d'Openai ou R1 de Deepseek. "Nous pensons que ceux-ci devraient exister dans le cadre d'une seule entité continue. Et nous ne sommes peut-être pas encore là, mais Anthropic veut vraiment déplacer les choses dans cette direction", a déclaré Amodei. "Nous devrions avoir une transition plus fluide de cela aux modèles pré-formés - plutôt que" voici une chose et voici B. ""

Alors que les sociétés d'IA comme Anthropic continuent de sortir de meilleurs modèles, Amodei voit un énorme potentiel de perturbation dans les industries. "Nous travaillons avec certaines sociétés pharmaceutiques pour utiliser Claude pour rédiger des études cliniques, et ils ont été en mesure de réduire le temps nécessaire pour rédiger le rapport d'étude clinique de 12 semaines à trois jours", a-t-il déclaré.

Il envisage une «renaissance de l'innovation perturbatrice» dans les applications de l'IA dans des secteurs comme le juridique, la finance, l'assurance, la productivité, les logiciels et l'énergie. "Je pense qu'il y aura - en gros, une renaissance de l'innovation perturbatrice dans l'espace d'application de l'IA. Et nous voulons l'aider, nous voulons tout soutenir", a-t-il conclu.

Lisez notre couverture complète du sommet de l'action de l'intelligence artificielle à Paris.

TechCrunch a une newsletter axée sur l'IA! Inscrivez-vous ici pour l'obtenir dans votre boîte de réception tous les mercredis.

Article connexe

OpenAI met fin aux modèles o3 et GPT-4.5 Large

En tant que pionnier de l'intelligence artificielle, chaque initiative technique d'OpenAI a un impact considérable sur le secteur. Récemment, l'entreprise a fait une annonce majeure : e

OpenAI met fin aux modèles o3 et GPT-4.5 Large

En tant que pionnier de l'intelligence artificielle, chaque initiative technique d'OpenAI a un impact considérable sur le secteur. Récemment, l'entreprise a fait une annonce majeure : e

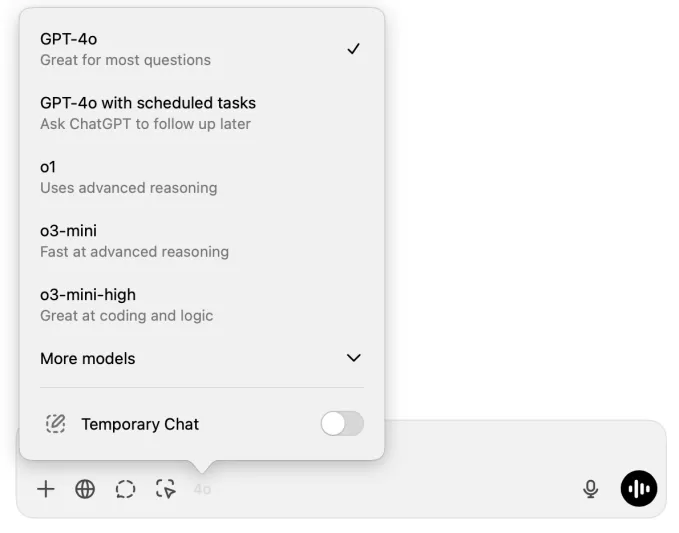

Mise à jour majeure d'AIGCPanel 2.0.0 : le moteur de workflow ouvre une nouvelle ère dans la création automatisée d'humanoïdes numériques

AIGCPanel, un outil puissant dédié à la création d'humains numériques au niveau local, vient de lancer sa version 2.0.0, présentée comme « la mise à jour la plus importante à ce jour ». Cette ref

Mise à jour majeure d'AIGCPanel 2.0.0 : le moteur de workflow ouvre une nouvelle ère dans la création automatisée d'humanoïdes numériques

AIGCPanel, un outil puissant dédié à la création d'humains numériques au niveau local, vient de lancer sa version 2.0.0, présentée comme « la mise à jour la plus importante à ce jour ». Cette ref

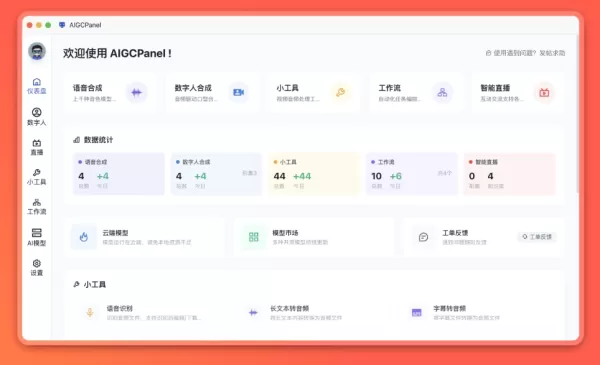

BuzzFeed lance une filiale spécialisée dans les applications inutiles basées sur l'IA

Alors qu’il traverse une grave crise, l’ancien géant des médias numériques BuzzFeed se lance dans une ambitieuse expérience d’auto-sauvetage reposant sur l’intelligence artificielle. Lors de la récent

Recommandations de sujets spéciaux liés

commentaires (53)

BuzzFeed lance une filiale spécialisée dans les applications inutiles basées sur l'IA

Alors qu’il traverse une grave crise, l’ancien géant des médias numériques BuzzFeed se lance dans une ambitieuse expérience d’auto-sauvetage reposant sur l’intelligence artificielle. Lors de la récent

Recommandations de sujets spéciaux liés

commentaires (53)

![ArthurLopez]()

Dario's got a point—AI's zooming ahead, and we're still playing catch-up. Feels like we're in a sci-fi flick, but nobody read the script! 😅 Curious if we'll ever get a grip on this tech race.

![StephenHernández]()

Dario's got a point—AI's moving way too fast for these summits to just be talkfests. We need real action, not just fancy speeches. 😤 Curious what Anthropic’s cooking up next to keep up with the race!

![JasonSanchez]()

Dario's got a point—AI's zooming ahead, and we’re barely keeping up! The Paris summit sounded like a snooze fest. Anyone else worried we’re not ready for what’s coming? 🤔

![DavidGonzalez]()

Anthropic's CEO really laid it out at the AI Summit. It's scary how fast AI is moving, and he's right—we need to take it more seriously. His warning about the race to understand AI hit home. We've gotta step up our game! 🚀

![EricRoberts]()

AI 정상회의에서 Anthropic의 CEO가 정말 솔직하게 말했어요. AI가 얼마나 빨리 발전하는지 무섭네요, 그의 말대로 더 진지하게 다뤄야 해요. AI를 이해하기 위한 경쟁에 대한 경고는 마음에 와닿았어요. 우리도 더 노력해야 해요! 🚀

Juste après que le sommet de l'action de l'IA à Paris s'est terminé, le co-fondateur et PDG d'Anthropic, Dario Amodei, n'a pas retenu. Il a qualifié l'événement de "l'occasion manquée" et a souligné que nous devons augmenter l'orientation et l'urgence sur plusieurs questions clés, compte tenu de la vitesse à laquelle AI Tech évolue. Il a partagé ces réflexions dans une déclaration publiée mardi.

Anthropic s'est associé à la startup française Dust pour un événement axé sur les développeurs à Paris, où TechCrunch a pu discuter avec Amodei sur scène. Il a partagé son point de vue et a poussé à une approche équilibrée de l'innovation et de la gouvernance de l'IA, évitant à la fois l'optimisme extrême et les critiques sévères.

Amodei, qui était un neuroscientifique, a déclaré: "J'ai essentiellement regardé à l'intérieur du cerveau réel pour gagner ma vie. Et maintenant, nous regardons à l'intérieur des cerveaux artificiels pour vivre. Nous allons donc, au cours des prochains mois, des avancées passionnantes dans le domaine de l'interprétabilité - où nous commençons vraiment à comprendre comment les modèles fonctionnent." Mais il a également souligné que c'était une course. "C'est une course entre rendre les modèles plus puissants, ce qui est incroyablement rapide pour nous et incroyablement rapide pour les autres - vous ne pouvez pas vraiment ralentir, non? ... Notre compréhension doit suivre notre capacité à construire des choses. Je pense que c'est le seul moyen", a-t-il ajouté.

Depuis le premier sommet de l'IA à Bletchley, au Royaume-Uni, la conversation autour de la gouvernance de l'IA a beaucoup changé, influencé par le climat géopolitique actuel. Le vice-président américain JD Vance, s'exprimant lors du sommet de l'action de l'IA, a déclaré: "Je ne suis pas ici ce matin pour parler de la sécurité de l'IA, qui était le titre de la conférence il y a quelques années. Je suis ici pour parler de l'opportunité de l'IA."

Amodei, cependant, essaie de combler le fossé entre la sécurité et l'opportunité. Il pense que se concentrer davantage sur la sécurité peut être une opportunité. "Lors du sommet original, le Sommet britannique de Bletchley, il y a eu beaucoup de discussions sur les tests et la mesure pour divers risques. Et je ne pense pas que ces choses aient ralenti la technologie", a-t-il déclaré lors de l'événement anthropique. "Si quelque chose, faire ce type de mesure nous a aidés à mieux comprendre nos modèles, ce qui nous aide à produire de meilleurs modèles."

Même en mettant l'accent sur la sécurité, Amodei a clairement indiqué qu'Anthropic est toujours entièrement dans les modèles d'IA frontaliers de construction. "Je ne veux rien faire pour réduire la promesse. Nous fournissons des modèles chaque jour sur lesquels les gens peuvent s'appuyer et qui sont utilisés pour faire des choses incroyables. Et nous ne devrions certainement pas arrêter de le faire", a-t-il déclaré. Plus tard, il a ajouté: "Quand les gens parlent beaucoup des risques, je suis en quelque sorte ennuyé, et je dis:" Oh, mec, personne n'a vraiment fait du bon travail pour vraiment expliquer à quel point cette technologie pourrait être formidable. ""

Lorsque le sujet s'est tourné vers les récents modèles de Chinois LLM-Maker Deepseek, Amodei a minimisé ses réalisations, appelant la réaction du public "inorganique". Il a dit: "Honnêtement, ma réaction a été très peu. Nous avions vu V3, qui est le modèle de base de Deepseek R1, en décembre. Et c'était un modèle impressionnant. Le modèle qui a été publié en décembre était sur ce type de courbe de réduction des coûts très normale que nous avons vue dans nos modèles et autres modèles." Ce qui a attiré son attention, c'est que le modèle ne provenait pas des "trois ou quatre laboratoires frontaliers" habituels aux États-Unis, comme Google, Openai et Anthropic. Il a exprimé son inquiétude concernant les gouvernements autoritaires qui dominent la technologie. Quant aux frais de formation réclamés de Deepseek, il les a rejetés comme "tout simplement pas exacts et non basés sur des faits".

Bien qu'Amodei n'ait pas annoncé de nouveaux modèles lors de l'événement, il a fait allusion aux prochaines versions avec des capacités de raisonnement améliorées. "Nous nous concentrons généralement sur l'essayage de faire notre propre vision des modèles de raisonnement qui sont mieux différenciés. Nous nous soucions de nous assurer que nous avons suffisamment de capacité, que les modèles deviennent plus intelligents et que nous nous inquiétons des choses de sécurité", a-t-il déclaré.

Anthropic aborde également le défi de sélection du modèle. Si vous êtes un utilisateur Chatgpt Plus, par exemple, il peut être difficile de décider quel modèle utiliser pour votre prochain message.

Amodei a remis en question la distinction entre les modèles normaux et le raisonnement. "Nous avons été un peu perplexes par l'idée qu'il existe des modèles normaux et qu'il existe des modèles de raisonnement et qu'ils sont en quelque sorte différents les uns des autres", a-t-il déclaré. "Si je vous parle, vous n'avez pas deux cerveaux et que l'un d'eux répond tout de suite et comme, l'autre attend plus longtemps."

Il pense qu'il devrait y avoir une transition plus fluide entre les modèles pré-formés comme Claude 3.5 Sonnet ou GPT-4O et les modèles formés avec l'apprentissage du renforcement qui peut produire une chaîne de pensées (COT), comme O1 d'Openai ou R1 de Deepseek. "Nous pensons que ceux-ci devraient exister dans le cadre d'une seule entité continue. Et nous ne sommes peut-être pas encore là, mais Anthropic veut vraiment déplacer les choses dans cette direction", a déclaré Amodei. "Nous devrions avoir une transition plus fluide de cela aux modèles pré-formés - plutôt que" voici une chose et voici B. ""

Alors que les sociétés d'IA comme Anthropic continuent de sortir de meilleurs modèles, Amodei voit un énorme potentiel de perturbation dans les industries. "Nous travaillons avec certaines sociétés pharmaceutiques pour utiliser Claude pour rédiger des études cliniques, et ils ont été en mesure de réduire le temps nécessaire pour rédiger le rapport d'étude clinique de 12 semaines à trois jours", a-t-il déclaré.

Il envisage une «renaissance de l'innovation perturbatrice» dans les applications de l'IA dans des secteurs comme le juridique, la finance, l'assurance, la productivité, les logiciels et l'énergie. "Je pense qu'il y aura - en gros, une renaissance de l'innovation perturbatrice dans l'espace d'application de l'IA. Et nous voulons l'aider, nous voulons tout soutenir", a-t-il conclu.

Lisez notre couverture complète du sommet de l'action de l'intelligence artificielle à Paris.

TechCrunch a une newsletter axée sur l'IA! Inscrivez-vous ici pour l'obtenir dans votre boîte de réception tous les mercredis.

OpenAI met fin aux modèles o3 et GPT-4.5 Large

En tant que pionnier de l'intelligence artificielle, chaque initiative technique d'OpenAI a un impact considérable sur le secteur. Récemment, l'entreprise a fait une annonce majeure : e

OpenAI met fin aux modèles o3 et GPT-4.5 Large

En tant que pionnier de l'intelligence artificielle, chaque initiative technique d'OpenAI a un impact considérable sur le secteur. Récemment, l'entreprise a fait une annonce majeure : e

Mise à jour majeure d'AIGCPanel 2.0.0 : le moteur de workflow ouvre une nouvelle ère dans la création automatisée d'humanoïdes numériques

AIGCPanel, un outil puissant dédié à la création d'humains numériques au niveau local, vient de lancer sa version 2.0.0, présentée comme « la mise à jour la plus importante à ce jour ». Cette ref

Mise à jour majeure d'AIGCPanel 2.0.0 : le moteur de workflow ouvre une nouvelle ère dans la création automatisée d'humanoïdes numériques

AIGCPanel, un outil puissant dédié à la création d'humains numériques au niveau local, vient de lancer sa version 2.0.0, présentée comme « la mise à jour la plus importante à ce jour ». Cette ref

BuzzFeed lance une filiale spécialisée dans les applications inutiles basées sur l'IA

Alors qu’il traverse une grave crise, l’ancien géant des médias numériques BuzzFeed se lance dans une ambitieuse expérience d’auto-sauvetage reposant sur l’intelligence artificielle. Lors de la récent

BuzzFeed lance une filiale spécialisée dans les applications inutiles basées sur l'IA

Alors qu’il traverse une grave crise, l’ancien géant des médias numériques BuzzFeed se lance dans une ambitieuse expérience d’auto-sauvetage reposant sur l’intelligence artificielle. Lors de la récent

Dario's got a point—AI's zooming ahead, and we're still playing catch-up. Feels like we're in a sci-fi flick, but nobody read the script! 😅 Curious if we'll ever get a grip on this tech race.

Dario's got a point—AI's moving way too fast for these summits to just be talkfests. We need real action, not just fancy speeches. 😤 Curious what Anthropic’s cooking up next to keep up with the race!

Dario's got a point—AI's zooming ahead, and we’re barely keeping up! The Paris summit sounded like a snooze fest. Anyone else worried we’re not ready for what’s coming? 🤔

Anthropic's CEO really laid it out at the AI Summit. It's scary how fast AI is moving, and he's right—we need to take it more seriously. His warning about the race to understand AI hit home. We've gotta step up our game! 🚀

AI 정상회의에서 Anthropic의 CEO가 정말 솔직하게 말했어요. AI가 얼마나 빨리 발전하는지 무섭네요, 그의 말대로 더 진지하게 다뤄야 해요. AI를 이해하기 위한 경쟁에 대한 경고는 마음에 와닿았어요. 우리도 더 노력해야 해요! 🚀

Maison

Maison