5 Wege von Googles Trillium könnte die KI- und Cloud -Computing revolutionieren - plus 2 Herausforderungen

Googles neueste Innovation, Trillium, stellt einen großen Sprung in den Bereichen künstliche Intelligenz (AI) und Cloud-Computing dar. Als Tensor Processing Unit (TPU) der sechsten Generation ist Trillium bereit, die Wirtschaftlichkeit und Leistung großer AI-Infrastrukturen zu revolutionieren. Zusammen mit Gemini 2.0, einem für das „agentische Zeitalter“ maßgeschneiderten AI-Modell, und Deep Research, das die Verwaltung komplexer maschineller Lernanfragen vereinfacht, zeigt Trillium Googles reifstes und ambitioniertestes Vorhaben, seine AI- und Cloud-Angebote zu transformieren.

Außerdem: Googles Gemini 2.0 AI verspricht durch agentische Fortschritte schneller und intelligenter zu sein

Fünf Gründe, warum Trillium ein Game-Changer für Googles AI- und Cloud-Strategie sein könnte

1. Überlegene Kosten- und Leistungseffizienz

Trillium besticht durch beeindruckende Kosten- und Leistungsmetriken. Google gibt an, dass Trillium bis zu 2,5-fach bessere Trainingsleistung pro Dollar und dreifach höheren Inferenzdurchsatz als seine Vorgänger bietet. Dies ist ein Game-Changer für Unternehmen, die Kosten beim Training großer Sprachmodelle (LLMs) wie Gemini 2.0 sowie bei Aufgaben wie Bildgenerierung und Empfehlungssystemen senken möchten.

Frühe Nutzer wie AI21 Labs haben bereits Vorteile gesehen. Als Teil des TPU-Ökosystems seit einiger Zeit erlebten sie mit Trillium deutliche Verbesserungen in Kosteneffizienz und Skalierbarkeit beim Training ihrer großen Sprachmodelle.

„Bei AI21 streben wir stets nach Verbesserung der Leistung und Effizienz unserer Mamba- und Jamba-Sprachmodelle. Seit der Nutzung von TPUs ab v4 sind wir von den Möglichkeiten des Google Cloud Trillium überwältigt. Die Fortschritte in Skalierung, Geschwindigkeit und Kosteneffizienz sind enorm. Wir sind überzeugt, dass Trillium die Entwicklung unserer nächsten Generation hochentwickelter Sprachmodelle beschleunigen wird, sodass wir unseren Kunden noch leistungsstärkere und zugänglichere AI-Lösungen bieten können.“ - Barak Lenz, CTO, AI21 Labs

Diese ersten Ergebnisse bestätigen nicht nur Googles Behauptungen über Trilliums Leistung und Kosten, sondern machen es auch zu einer attraktiven Wahl für Unternehmen, die bereits Googles Infrastruktur nutzen.

2. Außergewöhnliche Skalierbarkeit für große AI-Workloads

Trillium ist für massive AI-Workloads mit unglaublicher Skalierbarkeit ausgelegt. Google gibt eine Skalierungseffizienz von 99 % über 12 Pods (3.072 Chips) und 94 % über 24 Pods für große Open-Source-Modelle wie Gemini, Gemma 2 und Llama 3.2 an. Diese nahezu lineare Skalierung bedeutet, dass Trillium umfangreiche Trainingsaufgaben und groß angelegte Bereitstellungen mühelos bewältigen kann.

Außerdem: Die besten Open-Source-AI-Modelle: Alle Ihre kostenlos nutzbaren Optionen erklärt

Darüber hinaus ermöglicht Trilliums Integration in Googles Cloud AI Hypercomputer das nahtlose Hinzufügen von über 100.000 Chips in ein einziges Jupiter-Netzwerkgewebe mit 13 Petabits/Sek. Bandbreite. Diese Skalierbarkeit ist entscheidend für Unternehmen, die robuste und effiziente AI-Infrastruktur benötigen, um ihren wachsenden Rechenbedarf zu decken.

Außerdem: Ist dies das Ende von Google? Dieses neue AI-Tool konkurriert nicht nur, es gewinnt

Durch die Aufrechterhaltung hoher Skalierungseffizienz über Tausende von Chips positioniert sich Trillium als starker Kandidat für groß angelegte AI-Trainingsaufgaben. Diese Skalierbarkeit ermöglicht es Unternehmen, ihre AI-Operationen zu erweitern, ohne Leistungseinbußen oder prohibitive Kosten, was Trillium zu einer überzeugenden Wahl für diejenigen mit großen AI-Ambitionen macht.

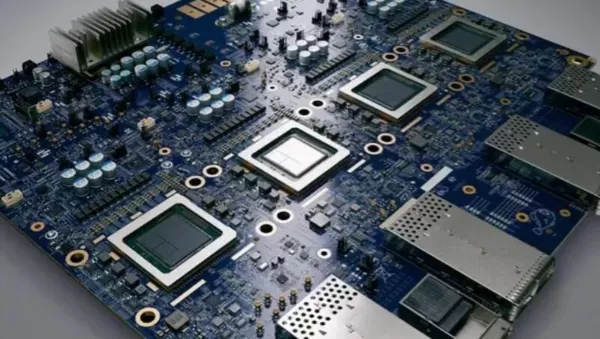

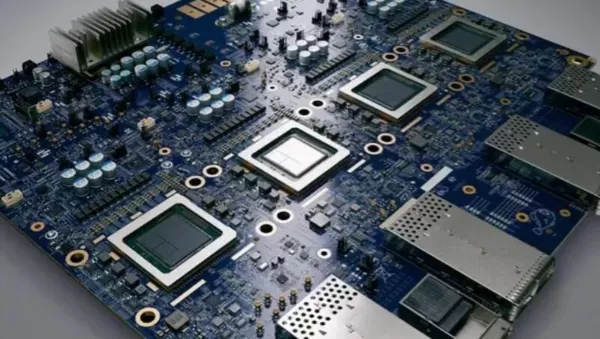

3. Fortschrittliche Hardware-Innovationen

Trillium ist vollgepackt mit fortschrittlichen Hardware-Innovationen, die seine Leistung und Kosteneffizienz steigern. Es verfügt über verdoppelten High Bandwidth Memory (HBM), der die Datenübertragungsraten erhöht und Engpässe reduziert. Seine TPU-Systemarchitektur umfasst auch eine SparseCore der dritten Generation, die die Recheneffizienz optimiert, indem Ressourcen auf kritische Datenpfade fokussiert werden.

Darüber hinaus bietet Trillium eine 4,7-fache Steigerung der Spitzenrechenleistung pro Chip, was seine Verarbeitungskapazität erheblich verbessert. Diese Fortschritte ermöglichen es Trillium, anspruchsvolle AI-Aufgaben zu bewältigen und eine solide Grundlage für zukünftige AI-Entwicklungen und -Anwendungen zu schaffen. Die Hardware-Verbesserungen steigern nicht nur die Leistung, sondern tragen auch zur Energieeffizienz bei, was Trillium zu einer nachhaltigen Option für groß angelegte AI-Operationen macht. Durch Investitionen in diese fortschrittlichen Hardware-Technologien stellt Google sicher, dass Trillium an der Spitze der AI-Verarbeitungsfähigkeiten bleibt und zunehmend komplexe und ressourcenintensive AI-Modelle unterstützt.

4. Nahtlose Integration in Googles Cloud-AI-Ökosystem

Trilliums tiefe Integration in Googles Cloud AI Hypercomputer ist ein großer Vorteil. Durch die Nutzung von Googles umfangreicher Cloud-Infrastruktur optimiert Trillium AI-Workloads und erleichtert die Bereitstellung und Verwaltung von AI-Modellen. Diese nahtlose Integration verbessert die Leistung und Zuverlässigkeit von AI-Anwendungen, die auf Google Cloud gehostet werden, und bietet Unternehmen eine einheitliche und optimierte Lösung für ihre AI-Bedürfnisse. Für Organisationen, die bereits in Googles Ökosystem investiert sind, bietet Trillium einen optimierten und hochintegrierten Weg, ihre AI-Initiativen effektiv zu skalieren.

Außerdem: Geminis neues Deep Research-Feature durchsucht das Web für Sie – wie ein Assistent

5. Zukunftsabsicherung der AI-Infrastruktur mit Gemini 2.0 und Deep Research

Trillium ist nicht nur ein leistungsstarker TPU; es ist Teil einer umfassenderen Strategie, die Gemini 2.0, entwickelt für das „agentische Zeitalter“, und Deep Research, das die Verwaltung komplexer maschineller Lernanfragen vereinfacht, umfasst. Dieser Ökosystemansatz stellt sicher, dass Trillium relevant bleibt und die nächste Welle von AI-Innovationen unterstützen kann. Durch die Ausrichtung von Trillium auf diese fortschrittlichen Tools und Modelle sichert Google seine AI-Infrastruktur zukunftssicher und macht sie anpassungsfähig an neue Trends und Technologien in der AI-Landschaft.

Außerdem: Der Fall von Intel: Wie generative AI einen Riesen stürzte und das Rechnen, wie wir es kennen, transformierte

Diese strategische Ausrichtung ermöglicht es Google, eine umfassende AI-Lösung anzubieten, die über reine Rechenleistung hinausgeht. Durch die Integration von Trillium mit modernsten AI-Modellen und Verwaltungstools stellt Google sicher, dass Unternehmen ihre AI-Investitionen voll ausschöpfen können und in einer sich schnell entwickelnden technologischen Landschaft die Nase vorn haben.

Wettbewerbslandschaft: Navigation im AI-Hardware-Markt

Trotz Trilliums Vorteilen sieht sich Google starker Konkurrenz von Branchenriesen wie NVIDIA und Amazon gegenüber. NVIDIAs GPUs, insbesondere die Modelle H100 und H200, sind bekannt für ihre hohe Leistung und Unterstützung führender generativer AI-Frameworks durch das ausgereifte CUDA-Ökosystem. NVIDIAs kommende Blackwell B100- und B200-GPUs werden voraussichtlich die Niedrigpräzisionsoperationen verbessern, die für kosteneffiziente Skalierung entscheidend sind, und damit NVIDIAs starke Position im AI-Hardware-Markt behaupten.

Außerdem: Wie ChatGPTs Datenanalysetool ohne Programmierung umsetzbare Geschäftseinblicke liefert

Trilliums enge Integration mit Google Cloud steigert die Effizienz, kann aber Herausforderungen bei Portabilität und Flexibilität mit sich bringen. Im Gegensatz zu AWS, das einen hybriden Ansatz bietet, der es Unternehmen ermöglicht, sowohl NVIDIA-GPUs als auch Trainium-Chips zu nutzen, oder NVIDIAs hochportablen GPUs, die reibungslos in verschiedenen Cloud- und On-Premises-Umgebungen laufen, könnte Trilliums Abhängigkeit von einer einzigen Cloud seinen Reiz für Organisationen einschränken, die Multi-Cloud- oder Hybrid-Lösungen suchen.

Amazons Trainium der zweiten Generation, jetzt weit verbreitet, bietet eine 30-40 %ige Preis-Leistungs-Verbesserung gegenüber NVIDIA-GPUs für das Training großer Sprachmodelle (LLMs), und das Unternehmen hat kürzlich seine dritte Generation zusammen mit „Project Rainier“, einem massiven neuen Trainingscluster, vorgestellt. AWS’ hybride Strategie minimiert Risiken und optimiert die Leistung, was mehr Flexibilität als Googles Trillium für vielfältige Bereitstellungsanforderungen bietet.

Außerdem: Amazon AWS stellt Trainium3-Chip, Project Rainier vor

Trilliums Erfolg wird davon abhängen, ob es beweisen kann, dass seine Leistungs- und Kostenvorteile die Reife und Portabilität des Ökosystems von NVIDIA und Amazon überwiegen. Google muss seine überlegenen Kosten- und Leistungsmetriken nutzen und Wege finden, die Kompatibilität von Trilliums Ökosystem über Google Cloud hinaus zu verbessern, um eine breitere Palette von Unternehmen anzuziehen, die vielseitige AI-Lösungen suchen.

Kann Trillium seinen Wert beweisen?

Googles Trillium markiert einen kühnen und ambitionierten Schritt, um die Infrastruktur für AI und Cloud-Computing voranzutreiben. Mit seiner überlegenen Kosten- und Leistungseffizienz, außergewöhnlichen Skalierbarkeit, fortschrittlichen Hardware-Innovationen, nahtlosen Integration mit Google Cloud und Ausrichtung auf zukünftige AI-Entwicklungen hat Trillium das Potenzial, Unternehmen anzuziehen, die optimierte AI-Lösungen suchen. Die frühen Erfolge mit Anwendern wie AI21 Labs unterstreichen Trilliums Fähigkeiten und seine Fähigkeit, Googles Versprechen einzulösen.

Außerdem: Sogar NVIDIAs CEO ist besessen von Googles NotebookLM AI-Tool

Die von NVIDIA und Amazon dominierte Wettbewerbslandschaft stellt jedoch erhebliche Hürden dar. Um seine Position zu festigen, muss Google die Flexibilität des Ökosystems angehen, unabhängige Leistungsvalidierungen demonstrieren und möglicherweise Multi-Cloud-Kompatibilität erkunden. Bei Erfolg könnte Trillium Googles Stellung in den Märkten für AI und Cloud-Computing erheblich stärken, eine robuste Alternative für groß angelegte AI-Operationen bieten und Unternehmen helfen, AI-Technologien effektiver und effizienter zu nutzen.

Verwandter Artikel

Google AI Ultra enthüllt: Premium-Abonnement für $249,99 pro Monat

Google stellt Premium AI Ultra-Abonnement vorAuf der Google I/O 2025 kündigte der Tech-Gigant seinen neuen umfassenden KI-Abonnementdienst an - Google AI Ultra. Zum Preis von 249,99 $ monatlich bietet

Google AI Ultra enthüllt: Premium-Abonnement für $249,99 pro Monat

Google stellt Premium AI Ultra-Abonnement vorAuf der Google I/O 2025 kündigte der Tech-Gigant seinen neuen umfassenden KI-Abonnementdienst an - Google AI Ultra. Zum Preis von 249,99 $ monatlich bietet

KI-generiertes Crossover vereint Arthur Morgan und Joshua Graham im Gaming-Multiversum

Wenn Spielwelten aufeinanderprallen: Arthur Morgan trifft auf den verbrannten MannStellen Sie sich eine Welt vor, in der legendäre Spielcharaktere über ihre eigenen Geschichten hinausgehen - was passi

KI-generiertes Crossover vereint Arthur Morgan und Joshua Graham im Gaming-Multiversum

Wenn Spielwelten aufeinanderprallen: Arthur Morgan trifft auf den verbrannten MannStellen Sie sich eine Welt vor, in der legendäre Spielcharaktere über ihre eigenen Geschichten hinausgehen - was passi

Microsoft hostet die fortschrittlichen Grok 3-Modelle von xAI in neuer KI-Kooperation

Anfang des Monats deckte mein *Notepad* investigativer Journalismus Microsofts Pläne zur Integration der Grok-KI-Modelle von Elon Musk auf - Enthüllungen, die nun offiziell bestätigt wurden. Auf Micro

Kommentare (8)

0/200

Microsoft hostet die fortschrittlichen Grok 3-Modelle von xAI in neuer KI-Kooperation

Anfang des Monats deckte mein *Notepad* investigativer Journalismus Microsofts Pläne zur Integration der Grok-KI-Modelle von Elon Musk auf - Enthüllungen, die nun offiziell bestätigt wurden. Auf Micro

Kommentare (8)

0/200

![HenryTurner]() HenryTurner

HenryTurner

25. September 2025 06:30:46 MESZ

25. September 2025 06:30:46 MESZ

Esse projeto do Google parece promissor, mas fico pensando se não vai criar ainda mais dependência das grandes tech. Será que empresas menores vão conseguir competir ou só vão ficar reféns dessas super plataformas? 🤨

0

0

![ScarlettWhite]() ScarlettWhite

ScarlettWhite

23. August 2025 07:01:15 MESZ

23. August 2025 07:01:15 MESZ

Trillium sounds like a game-changer for AI! I'm curious how its efficiency will impact smaller startups trying to compete in the cloud space. Could it level the playing field or just make Google untouchable? 🤔

0

0

![AlbertMartínez]() AlbertMartínez

AlbertMartínez

10. August 2025 09:00:59 MESZ

10. August 2025 09:00:59 MESZ

Trillium sounds like a beast for AI! 4.7x compute boost is wild—imagine training models in hours instead of days. But can Google keep up with NVIDIA’s grip on the market? 🤔 Curious to see how this plays out!

0

0

![LunaYoung]() LunaYoung

LunaYoung

25. April 2025 06:10:31 MESZ

25. April 2025 06:10:31 MESZ

O Trillium do Google parece ser uma revolução para a IA e a computação em nuvem! A TPU de sexta geração é impressionante, mas estou um pouco preocupado com os dois desafios mencionados. Ainda assim, mal posso esperar para ver como ele se comporta em cenários reais. 🚀

0

0

![GeorgeMiller]() GeorgeMiller

GeorgeMiller

24. April 2025 18:14:35 MESZ

24. April 2025 18:14:35 MESZ

El Trillium de Google parece un cambio de juego para la IA y la computación en la nube. ¡La TPU de sexta generación es impresionante, pero me preocupan un poco los dos desafíos mencionados! Aún así, no puedo esperar para ver cómo funciona en escenarios del mundo real. 🚀

0

0

![CarlHill]() CarlHill

CarlHill

24. April 2025 17:38:14 MESZ

24. April 2025 17:38:14 MESZ

GoogleのTrilliumはAIとクラウドコンピューティングを変える可能性があるように感じます!第6世代のTPUは素晴らしいですが、2つの課題が気になります。それでも、実際のシナリオでのパフォーマンスを見るのが待ち遠しいです。🚀

0

0

Googles neueste Innovation, Trillium, stellt einen großen Sprung in den Bereichen künstliche Intelligenz (AI) und Cloud-Computing dar. Als Tensor Processing Unit (TPU) der sechsten Generation ist Trillium bereit, die Wirtschaftlichkeit und Leistung großer AI-Infrastrukturen zu revolutionieren. Zusammen mit Gemini 2.0, einem für das „agentische Zeitalter“ maßgeschneiderten AI-Modell, und Deep Research, das die Verwaltung komplexer maschineller Lernanfragen vereinfacht, zeigt Trillium Googles reifstes und ambitioniertestes Vorhaben, seine AI- und Cloud-Angebote zu transformieren.

Außerdem: Googles Gemini 2.0 AI verspricht durch agentische Fortschritte schneller und intelligenter zu sein

Fünf Gründe, warum Trillium ein Game-Changer für Googles AI- und Cloud-Strategie sein könnte

1. Überlegene Kosten- und Leistungseffizienz

Trillium besticht durch beeindruckende Kosten- und Leistungsmetriken. Google gibt an, dass Trillium bis zu 2,5-fach bessere Trainingsleistung pro Dollar und dreifach höheren Inferenzdurchsatz als seine Vorgänger bietet. Dies ist ein Game-Changer für Unternehmen, die Kosten beim Training großer Sprachmodelle (LLMs) wie Gemini 2.0 sowie bei Aufgaben wie Bildgenerierung und Empfehlungssystemen senken möchten.

Frühe Nutzer wie AI21 Labs haben bereits Vorteile gesehen. Als Teil des TPU-Ökosystems seit einiger Zeit erlebten sie mit Trillium deutliche Verbesserungen in Kosteneffizienz und Skalierbarkeit beim Training ihrer großen Sprachmodelle.

„Bei AI21 streben wir stets nach Verbesserung der Leistung und Effizienz unserer Mamba- und Jamba-Sprachmodelle. Seit der Nutzung von TPUs ab v4 sind wir von den Möglichkeiten des Google Cloud Trillium überwältigt. Die Fortschritte in Skalierung, Geschwindigkeit und Kosteneffizienz sind enorm. Wir sind überzeugt, dass Trillium die Entwicklung unserer nächsten Generation hochentwickelter Sprachmodelle beschleunigen wird, sodass wir unseren Kunden noch leistungsstärkere und zugänglichere AI-Lösungen bieten können.“ - Barak Lenz, CTO, AI21 Labs

Diese ersten Ergebnisse bestätigen nicht nur Googles Behauptungen über Trilliums Leistung und Kosten, sondern machen es auch zu einer attraktiven Wahl für Unternehmen, die bereits Googles Infrastruktur nutzen.

2. Außergewöhnliche Skalierbarkeit für große AI-Workloads

Trillium ist für massive AI-Workloads mit unglaublicher Skalierbarkeit ausgelegt. Google gibt eine Skalierungseffizienz von 99 % über 12 Pods (3.072 Chips) und 94 % über 24 Pods für große Open-Source-Modelle wie Gemini, Gemma 2 und Llama 3.2 an. Diese nahezu lineare Skalierung bedeutet, dass Trillium umfangreiche Trainingsaufgaben und groß angelegte Bereitstellungen mühelos bewältigen kann.

Außerdem: Die besten Open-Source-AI-Modelle: Alle Ihre kostenlos nutzbaren Optionen erklärt

Darüber hinaus ermöglicht Trilliums Integration in Googles Cloud AI Hypercomputer das nahtlose Hinzufügen von über 100.000 Chips in ein einziges Jupiter-Netzwerkgewebe mit 13 Petabits/Sek. Bandbreite. Diese Skalierbarkeit ist entscheidend für Unternehmen, die robuste und effiziente AI-Infrastruktur benötigen, um ihren wachsenden Rechenbedarf zu decken.

Außerdem: Ist dies das Ende von Google? Dieses neue AI-Tool konkurriert nicht nur, es gewinnt

Durch die Aufrechterhaltung hoher Skalierungseffizienz über Tausende von Chips positioniert sich Trillium als starker Kandidat für groß angelegte AI-Trainingsaufgaben. Diese Skalierbarkeit ermöglicht es Unternehmen, ihre AI-Operationen zu erweitern, ohne Leistungseinbußen oder prohibitive Kosten, was Trillium zu einer überzeugenden Wahl für diejenigen mit großen AI-Ambitionen macht.

3. Fortschrittliche Hardware-Innovationen

Trillium ist vollgepackt mit fortschrittlichen Hardware-Innovationen, die seine Leistung und Kosteneffizienz steigern. Es verfügt über verdoppelten High Bandwidth Memory (HBM), der die Datenübertragungsraten erhöht und Engpässe reduziert. Seine TPU-Systemarchitektur umfasst auch eine SparseCore der dritten Generation, die die Recheneffizienz optimiert, indem Ressourcen auf kritische Datenpfade fokussiert werden.

Darüber hinaus bietet Trillium eine 4,7-fache Steigerung der Spitzenrechenleistung pro Chip, was seine Verarbeitungskapazität erheblich verbessert. Diese Fortschritte ermöglichen es Trillium, anspruchsvolle AI-Aufgaben zu bewältigen und eine solide Grundlage für zukünftige AI-Entwicklungen und -Anwendungen zu schaffen. Die Hardware-Verbesserungen steigern nicht nur die Leistung, sondern tragen auch zur Energieeffizienz bei, was Trillium zu einer nachhaltigen Option für groß angelegte AI-Operationen macht. Durch Investitionen in diese fortschrittlichen Hardware-Technologien stellt Google sicher, dass Trillium an der Spitze der AI-Verarbeitungsfähigkeiten bleibt und zunehmend komplexe und ressourcenintensive AI-Modelle unterstützt.

4. Nahtlose Integration in Googles Cloud-AI-Ökosystem

Trilliums tiefe Integration in Googles Cloud AI Hypercomputer ist ein großer Vorteil. Durch die Nutzung von Googles umfangreicher Cloud-Infrastruktur optimiert Trillium AI-Workloads und erleichtert die Bereitstellung und Verwaltung von AI-Modellen. Diese nahtlose Integration verbessert die Leistung und Zuverlässigkeit von AI-Anwendungen, die auf Google Cloud gehostet werden, und bietet Unternehmen eine einheitliche und optimierte Lösung für ihre AI-Bedürfnisse. Für Organisationen, die bereits in Googles Ökosystem investiert sind, bietet Trillium einen optimierten und hochintegrierten Weg, ihre AI-Initiativen effektiv zu skalieren.

Außerdem: Geminis neues Deep Research-Feature durchsucht das Web für Sie – wie ein Assistent

5. Zukunftsabsicherung der AI-Infrastruktur mit Gemini 2.0 und Deep Research

Trillium ist nicht nur ein leistungsstarker TPU; es ist Teil einer umfassenderen Strategie, die Gemini 2.0, entwickelt für das „agentische Zeitalter“, und Deep Research, das die Verwaltung komplexer maschineller Lernanfragen vereinfacht, umfasst. Dieser Ökosystemansatz stellt sicher, dass Trillium relevant bleibt und die nächste Welle von AI-Innovationen unterstützen kann. Durch die Ausrichtung von Trillium auf diese fortschrittlichen Tools und Modelle sichert Google seine AI-Infrastruktur zukunftssicher und macht sie anpassungsfähig an neue Trends und Technologien in der AI-Landschaft.

Außerdem: Der Fall von Intel: Wie generative AI einen Riesen stürzte und das Rechnen, wie wir es kennen, transformierte

Diese strategische Ausrichtung ermöglicht es Google, eine umfassende AI-Lösung anzubieten, die über reine Rechenleistung hinausgeht. Durch die Integration von Trillium mit modernsten AI-Modellen und Verwaltungstools stellt Google sicher, dass Unternehmen ihre AI-Investitionen voll ausschöpfen können und in einer sich schnell entwickelnden technologischen Landschaft die Nase vorn haben.

Wettbewerbslandschaft: Navigation im AI-Hardware-Markt

Trotz Trilliums Vorteilen sieht sich Google starker Konkurrenz von Branchenriesen wie NVIDIA und Amazon gegenüber. NVIDIAs GPUs, insbesondere die Modelle H100 und H200, sind bekannt für ihre hohe Leistung und Unterstützung führender generativer AI-Frameworks durch das ausgereifte CUDA-Ökosystem. NVIDIAs kommende Blackwell B100- und B200-GPUs werden voraussichtlich die Niedrigpräzisionsoperationen verbessern, die für kosteneffiziente Skalierung entscheidend sind, und damit NVIDIAs starke Position im AI-Hardware-Markt behaupten.

Außerdem: Wie ChatGPTs Datenanalysetool ohne Programmierung umsetzbare Geschäftseinblicke liefert

Trilliums enge Integration mit Google Cloud steigert die Effizienz, kann aber Herausforderungen bei Portabilität und Flexibilität mit sich bringen. Im Gegensatz zu AWS, das einen hybriden Ansatz bietet, der es Unternehmen ermöglicht, sowohl NVIDIA-GPUs als auch Trainium-Chips zu nutzen, oder NVIDIAs hochportablen GPUs, die reibungslos in verschiedenen Cloud- und On-Premises-Umgebungen laufen, könnte Trilliums Abhängigkeit von einer einzigen Cloud seinen Reiz für Organisationen einschränken, die Multi-Cloud- oder Hybrid-Lösungen suchen.

Amazons Trainium der zweiten Generation, jetzt weit verbreitet, bietet eine 30-40 %ige Preis-Leistungs-Verbesserung gegenüber NVIDIA-GPUs für das Training großer Sprachmodelle (LLMs), und das Unternehmen hat kürzlich seine dritte Generation zusammen mit „Project Rainier“, einem massiven neuen Trainingscluster, vorgestellt. AWS’ hybride Strategie minimiert Risiken und optimiert die Leistung, was mehr Flexibilität als Googles Trillium für vielfältige Bereitstellungsanforderungen bietet.

Außerdem: Amazon AWS stellt Trainium3-Chip, Project Rainier vor

Trilliums Erfolg wird davon abhängen, ob es beweisen kann, dass seine Leistungs- und Kostenvorteile die Reife und Portabilität des Ökosystems von NVIDIA und Amazon überwiegen. Google muss seine überlegenen Kosten- und Leistungsmetriken nutzen und Wege finden, die Kompatibilität von Trilliums Ökosystem über Google Cloud hinaus zu verbessern, um eine breitere Palette von Unternehmen anzuziehen, die vielseitige AI-Lösungen suchen.

Kann Trillium seinen Wert beweisen?

Googles Trillium markiert einen kühnen und ambitionierten Schritt, um die Infrastruktur für AI und Cloud-Computing voranzutreiben. Mit seiner überlegenen Kosten- und Leistungseffizienz, außergewöhnlichen Skalierbarkeit, fortschrittlichen Hardware-Innovationen, nahtlosen Integration mit Google Cloud und Ausrichtung auf zukünftige AI-Entwicklungen hat Trillium das Potenzial, Unternehmen anzuziehen, die optimierte AI-Lösungen suchen. Die frühen Erfolge mit Anwendern wie AI21 Labs unterstreichen Trilliums Fähigkeiten und seine Fähigkeit, Googles Versprechen einzulösen.

Außerdem: Sogar NVIDIAs CEO ist besessen von Googles NotebookLM AI-Tool

Die von NVIDIA und Amazon dominierte Wettbewerbslandschaft stellt jedoch erhebliche Hürden dar. Um seine Position zu festigen, muss Google die Flexibilität des Ökosystems angehen, unabhängige Leistungsvalidierungen demonstrieren und möglicherweise Multi-Cloud-Kompatibilität erkunden. Bei Erfolg könnte Trillium Googles Stellung in den Märkten für AI und Cloud-Computing erheblich stärken, eine robuste Alternative für groß angelegte AI-Operationen bieten und Unternehmen helfen, AI-Technologien effektiver und effizienter zu nutzen.

Google AI Ultra enthüllt: Premium-Abonnement für $249,99 pro Monat

Google stellt Premium AI Ultra-Abonnement vorAuf der Google I/O 2025 kündigte der Tech-Gigant seinen neuen umfassenden KI-Abonnementdienst an - Google AI Ultra. Zum Preis von 249,99 $ monatlich bietet

Google AI Ultra enthüllt: Premium-Abonnement für $249,99 pro Monat

Google stellt Premium AI Ultra-Abonnement vorAuf der Google I/O 2025 kündigte der Tech-Gigant seinen neuen umfassenden KI-Abonnementdienst an - Google AI Ultra. Zum Preis von 249,99 $ monatlich bietet

KI-generiertes Crossover vereint Arthur Morgan und Joshua Graham im Gaming-Multiversum

Wenn Spielwelten aufeinanderprallen: Arthur Morgan trifft auf den verbrannten MannStellen Sie sich eine Welt vor, in der legendäre Spielcharaktere über ihre eigenen Geschichten hinausgehen - was passi

KI-generiertes Crossover vereint Arthur Morgan und Joshua Graham im Gaming-Multiversum

Wenn Spielwelten aufeinanderprallen: Arthur Morgan trifft auf den verbrannten MannStellen Sie sich eine Welt vor, in der legendäre Spielcharaktere über ihre eigenen Geschichten hinausgehen - was passi

Microsoft hostet die fortschrittlichen Grok 3-Modelle von xAI in neuer KI-Kooperation

Anfang des Monats deckte mein *Notepad* investigativer Journalismus Microsofts Pläne zur Integration der Grok-KI-Modelle von Elon Musk auf - Enthüllungen, die nun offiziell bestätigt wurden. Auf Micro

Microsoft hostet die fortschrittlichen Grok 3-Modelle von xAI in neuer KI-Kooperation

Anfang des Monats deckte mein *Notepad* investigativer Journalismus Microsofts Pläne zur Integration der Grok-KI-Modelle von Elon Musk auf - Enthüllungen, die nun offiziell bestätigt wurden. Auf Micro

25. September 2025 06:30:46 MESZ

25. September 2025 06:30:46 MESZ

Esse projeto do Google parece promissor, mas fico pensando se não vai criar ainda mais dependência das grandes tech. Será que empresas menores vão conseguir competir ou só vão ficar reféns dessas super plataformas? 🤨

0

0

23. August 2025 07:01:15 MESZ

23. August 2025 07:01:15 MESZ

Trillium sounds like a game-changer for AI! I'm curious how its efficiency will impact smaller startups trying to compete in the cloud space. Could it level the playing field or just make Google untouchable? 🤔

0

0

10. August 2025 09:00:59 MESZ

10. August 2025 09:00:59 MESZ

Trillium sounds like a beast for AI! 4.7x compute boost is wild—imagine training models in hours instead of days. But can Google keep up with NVIDIA’s grip on the market? 🤔 Curious to see how this plays out!

0

0

25. April 2025 06:10:31 MESZ

25. April 2025 06:10:31 MESZ

O Trillium do Google parece ser uma revolução para a IA e a computação em nuvem! A TPU de sexta geração é impressionante, mas estou um pouco preocupado com os dois desafios mencionados. Ainda assim, mal posso esperar para ver como ele se comporta em cenários reais. 🚀

0

0

24. April 2025 18:14:35 MESZ

24. April 2025 18:14:35 MESZ

El Trillium de Google parece un cambio de juego para la IA y la computación en la nube. ¡La TPU de sexta generación es impresionante, pero me preocupan un poco los dos desafíos mencionados! Aún así, no puedo esperar para ver cómo funciona en escenarios del mundo real. 🚀

0

0

24. April 2025 17:38:14 MESZ

24. April 2025 17:38:14 MESZ

GoogleのTrilliumはAIとクラウドコンピューティングを変える可能性があるように感じます!第6世代のTPUは素晴らしいですが、2つの課題が気になります。それでも、実際のシナリオでのパフォーマンスを見るのが待ち遠しいです。🚀

0

0