AI语音克隆:选举威胁与自我保护

人工智能的崛起正在重塑我们的世界,影响从沟通到投票的方方面面。然而,它也对民主带来了严重挑战,尤其是AI语音克隆技术的出现。这项技术在模仿声音方面越来越逼真,不仅仅是派对上的有趣把戏——它被用来制造政治人物的虚假音频,传播可能影响选举的谎言。本文将探讨这项技术带来的危险,并介绍应对这一新兴威胁的努力,以维护公平投票。

AI语音克隆在选举中的日益威胁

了解AI语音克隆

AI语音克隆利用人工智能生成某人的数字语音版本。这项技术通过分析大量旧演讲,捕捉独特的嗓音特征——如音高、音调和节奏——然后生成听起来与本人无异的新音频。这对有声书或帮助失声者很有用。但问题在于,它也可能被用于不良目的,如伪造新闻或诈骗。由于其逼真性,难以辨别真假,这对选举来说是个大问题。

随着AI的进步,滥用潜力也在增加。每个人都需了解这项技术,保持警惕。在选举中,语音克隆可能被用来伪造背书、传播候选人谎言,甚至冒充候选人本人。这显然会迷惑选民,干扰选举结果。

制造虚假音频的便捷与速度

令人担忧的是制造这些虚假音频的速度和便捷。据州议员Penelope Serneglou称,有人不到五分钟就制造出拜登总统的语音克隆。这很可怕,因为这意味着不良行为者可以在选举前迅速制造误导性音频。追踪这些虚假音频的来源?就像大海捞针,因为技术模仿得太像了。

制造这些克隆的成本也在下降,意味着任何有网络连接的人都能参与。不需要高科技技能或雄厚财力。这种技术的普及使其对选举的威胁更大。我们需要规则来控制这种情况,保护投票系统。

AI生成的机器人电话:选民压制的工具

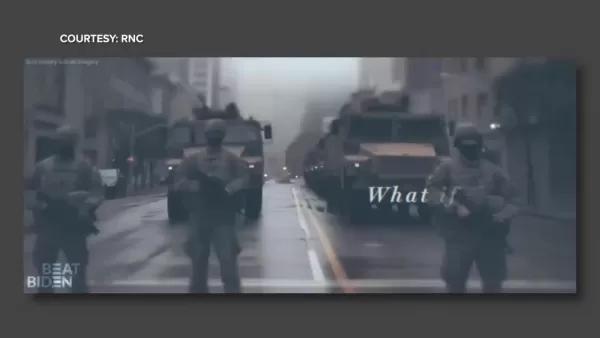

AI语音克隆不仅是可怕的想法——它已经在发生。FCC一直在调查冒充拜登总统的AI生成机器人电话,告诉人们将选票“留到”十一月,跳过初选。这些电话是阻止人们投票的隐秘方式,且传播很快。

虽然机器人电话有其用途,但它们也被用来传播谎言和恐吓选民。在许多地方,用它们进行选民压制是非法的,但用AI制造的电话很难抓到罪魁祸首。我们需要教育选民,开发识别这些电话的工具,并确保滥用者面临后果。

社交媒体在传播AI生成虚假信息中的角色

社交媒体是把双刃剑。它的信息传播很快,但也是AI生成谎言的温床。互联网伦理专家Irina Raicu表示,社交媒体平台在阻止深度伪造传播方面做得不够。人们不核查就分享,加剧了问题。

AI语音克隆与社交媒体的广泛覆盖相结合,令人头痛。虚假音频可能迅速走红,在被证明虚假前触及数百万人。它还被用来针对特定选民群体传播定制谎言,难以应对。我们需要教育用户,开发捕捉AI伪造的工具,并让社交媒体平台承担责任。

规范政治广告中AI的立法努力

密歇根的开创性立法

一些州正积极应对这一问题。例如,密歇根在州议员Penelope Serneglou的推动下通过了法律,要求政治广告说明是否使用了AI。这帮助选民识别AI内容,了解潜在的操控行为。

密歇根还在考虑规范机器人电话中的AI使用,特别是那些涉及投票地点的电话。这是维护选举公平的重要举措,但只是开始。如何识别AI内容、平衡言论自由与选民保护,仍有许多问题待解。

公民如何保护自己免受AI生成虚假信息的侵害?

保持警惕并核实信息

在AI能制造逼真伪造的当今世界,保持敏锐至关重要。始终核查事实,注意偏见,意识到听到的或看到的不一定是真的。使用Snopes或PolitiFact等工具验证信息,对任何看似过于完美或不符合常理的内容保持怀疑。

- 对音频和视频保持怀疑:如果听起来好得令人难以置信,可能就是假的。检查音频质量和视频中人物的行为。

- 寻找操控痕迹:AI伪造可能有奇怪的停顿、异常音频或不匹配的灯光。

- 核查事实:在分享前,确保信息通过可靠来源验证为真。

- 注意偏见:警惕片面报道或过于戏剧化的新闻。

- 教育他人:分享你对AI伪造的了解,帮助他人保持警惕。

识别深度伪造和合成媒体

深度伪造和其他合成媒体无处不在。它们用AI制造来欺骗我们,很难识别。注意不自然的的表情、扭曲的音频、不一致的光线或过于完美的面孔。如果看到这些迹象,谨慎对待,在相信或分享前进行研究。

规范选举中AI的利与弊

优点

- 通过阻止虚假信息传播,保护选举完整性。

- 提升选民对投票过程的信任和意识。

- 促进政治广告的透明度。

- 阻止不良行为者利用AI干扰选民参与。

- 为应对未来AI挑战提供计划。

缺点

- 可能限制创新和AI的正当用途。

- 可能难以执行,且易被不良行为者规避。

- 引发关于言论自由和政治表达权的担忧。

- 可能被用来压制或审查不同意见。

- 建立和运行可能成本高昂。

关于AI语音克隆的常见问题

什么是AI语音克隆,如何运作?

AI语音克隆是AI分析现有语音录音,提取音高、音调等独特特征,然后生成听起来与原发言者相同的新音频。它用于有声书到诈骗等各种场景,且越来越逼真,难以区分真假。

AI语音克隆的生成速度有多快?

快得吓人。不到五分钟就能生成一个逼真的语音克隆,这在选举期间是个大问题,因为虚假音频可能迅速传播。

什么是AI生成的机器人电话,如何用于选民压制?

AI生成的机器人电话是使用克隆语音冒充某人的自动电话,常用于传播虚假信息或阻止投票。它们是影响选举结果的隐秘方式,覆盖面广且迅速。

社交媒体平台如何无意中传播AI语音克隆生成的虚假信息?

社交媒体因快速分享信息而传播虚假信息,用户常不核查就分享。这使得阻止AI生成谎言的传播变得困难。

AI生成虚假信息有哪些例子?

例子包括政治候选人的虚假声明、名人伪造的背书、投票地点的虚假信息,以及冒充候选人的机器人电话。广告中的AI图像也是其应用方式。

密歇根如何应对政治广告中的AI虚假信息?

密歇根通过法律要求政治广告披露是否使用了AI,帮助选民识别AI内容。他们还在努力规范涉及投票地点的AI电话,以防虚假信息。

有哪些识别AI生成虚假信息的工具或资源?

是的,Snopes、PolitiFact和Google Image Search等工具可帮助验证声明和图像。识别AI伪造的能力对保护钱包和民主进程至关重要。

相关文章

百度健康近期内部测试了AI医生助手“DoctorClaw”,用于学术文献检索和日常办公辅助

据报道,百度健康已开始对一款专为医生设计的专业AI智能助手进行内部测试。该产品内部代号为“DoctorClaw”(龙虾医生版),标志着百度在医疗领域部署大型语言模型方面迈出了重要一步。知情人士透露,该项目仍处于封闭开发阶段,目前已进入内部测试。虽然具体的产品形态尚未完全披露,但已接近上线。 在功能方面,DoctorClaw初期将侧重于学术文献检索和常规诊疗辅助。但其长期战略旨在深度融入临床诊断、医

百度健康近期内部测试了AI医生助手“DoctorClaw”,用于学术文献检索和日常办公辅助

据报道,百度健康已开始对一款专为医生设计的专业AI智能助手进行内部测试。该产品内部代号为“DoctorClaw”(龙虾医生版),标志着百度在医疗领域部署大型语言模型方面迈出了重要一步。知情人士透露,该项目仍处于封闭开发阶段,目前已进入内部测试。虽然具体的产品形态尚未完全披露,但已接近上线。 在功能方面,DoctorClaw初期将侧重于学术文献检索和常规诊疗辅助。但其长期战略旨在深度融入临床诊断、医

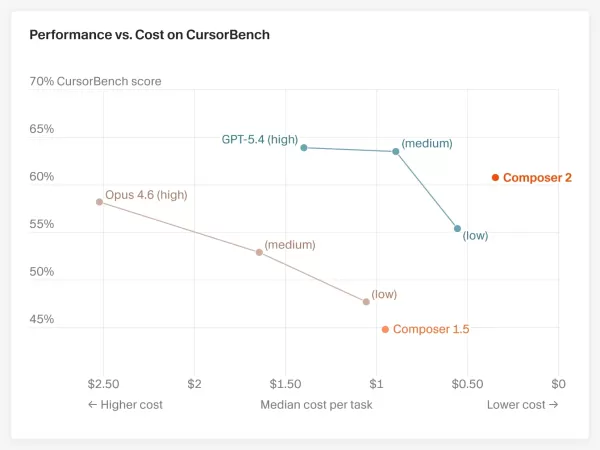

Cursor Composer 2 与 Claude Opus 4.6:基准测试引发新一轮人工智能编程争论

3月19日,Cursor正式发布了其自主研发的编程模型Composer 2。 这一消息在开发者社区中立即引发热议——据 Cursor 称,Composer 2 在 Terminal-Bench 2.0 测试中获得了 61.7% 的得分,在相同的测试条件下,这一成绩显著超过了 Claude Opus 4.6 的 58.0%。Anthropic的旗舰模型竟被自家IDE内置的模型超越?随着消息传开,相关

Cursor Composer 2 与 Claude Opus 4.6:基准测试引发新一轮人工智能编程争论

3月19日,Cursor正式发布了其自主研发的编程模型Composer 2。 这一消息在开发者社区中立即引发热议——据 Cursor 称,Composer 2 在 Terminal-Bench 2.0 测试中获得了 61.7% 的得分,在相同的测试条件下,这一成绩显著超过了 Claude Opus 4.6 的 58.0%。Anthropic的旗舰模型竟被自家IDE内置的模型超越?随着消息传开,相关

StrictlyVC旧金山站将汇聚TDK Ventures、Replit等企业的领军人物

今年首场StrictlyVC活动即将登陆旧金山,时间比你想象的要早。 4月30日,我们在菲律宾文化中心(Sentro Filipino Cultural Center)举办的聚会门票仍在热售中,届时将有阵容强大的演讲嘉宾阵容。除了StrictlyVC一贯以人脉拓展和社区互动著称外,本次旧金山活动对于寻求最新融资洞见的AI创新者和创始人而言,将具有特别重要的价值。谁将登台门票现已开售,但如果您此前未

相关专题推荐

评论 (3)

0/500

StrictlyVC旧金山站将汇聚TDK Ventures、Replit等企业的领军人物

今年首场StrictlyVC活动即将登陆旧金山,时间比你想象的要早。 4月30日,我们在菲律宾文化中心(Sentro Filipino Cultural Center)举办的聚会门票仍在热售中,届时将有阵容强大的演讲嘉宾阵容。除了StrictlyVC一贯以人脉拓展和社区互动著称外,本次旧金山活动对于寻求最新融资洞见的AI创新者和创始人而言,将具有特别重要的价值。谁将登台门票现已开售,但如果您此前未

相关专题推荐

评论 (3)

0/500

![MarkScott]()

Ого, клонирование голосов ИИ уже влияет на выборы? Это похоже на сценарий из научно-фантастического фильма, который становится реальностью. Технология развивается так быстро, что законодатели явно не поспевают. Как обычным людям, таким как я, защитить себя от такой тонкой формы дезинформации? Может, нам стоит начать использовать кодовые слова в телефонных разговорах с близкими? 😅 Это одновременно захватывающе и пугающе.

![JuanScott]()

This AI voice cloning stuff is wild! It’s like something out of a sci-fi movie, but it’s real and messing with elections? That’s scary. I wonder how we can even trust what we hear anymore. 🫣

人工智能的崛起正在重塑我们的世界,影响从沟通到投票的方方面面。然而,它也对民主带来了严重挑战,尤其是AI语音克隆技术的出现。这项技术在模仿声音方面越来越逼真,不仅仅是派对上的有趣把戏——它被用来制造政治人物的虚假音频,传播可能影响选举的谎言。本文将探讨这项技术带来的危险,并介绍应对这一新兴威胁的努力,以维护公平投票。

AI语音克隆在选举中的日益威胁

了解AI语音克隆

AI语音克隆利用人工智能生成某人的数字语音版本。这项技术通过分析大量旧演讲,捕捉独特的嗓音特征——如音高、音调和节奏——然后生成听起来与本人无异的新音频。这对有声书或帮助失声者很有用。但问题在于,它也可能被用于不良目的,如伪造新闻或诈骗。由于其逼真性,难以辨别真假,这对选举来说是个大问题。

随着AI的进步,滥用潜力也在增加。每个人都需了解这项技术,保持警惕。在选举中,语音克隆可能被用来伪造背书、传播候选人谎言,甚至冒充候选人本人。这显然会迷惑选民,干扰选举结果。

制造虚假音频的便捷与速度

令人担忧的是制造这些虚假音频的速度和便捷。据州议员Penelope Serneglou称,有人不到五分钟就制造出拜登总统的语音克隆。这很可怕,因为这意味着不良行为者可以在选举前迅速制造误导性音频。追踪这些虚假音频的来源?就像大海捞针,因为技术模仿得太像了。

制造这些克隆的成本也在下降,意味着任何有网络连接的人都能参与。不需要高科技技能或雄厚财力。这种技术的普及使其对选举的威胁更大。我们需要规则来控制这种情况,保护投票系统。

AI生成的机器人电话:选民压制的工具

AI语音克隆不仅是可怕的想法——它已经在发生。FCC一直在调查冒充拜登总统的AI生成机器人电话,告诉人们将选票“留到”十一月,跳过初选。这些电话是阻止人们投票的隐秘方式,且传播很快。

虽然机器人电话有其用途,但它们也被用来传播谎言和恐吓选民。在许多地方,用它们进行选民压制是非法的,但用AI制造的电话很难抓到罪魁祸首。我们需要教育选民,开发识别这些电话的工具,并确保滥用者面临后果。

社交媒体在传播AI生成虚假信息中的角色

社交媒体是把双刃剑。它的信息传播很快,但也是AI生成谎言的温床。互联网伦理专家Irina Raicu表示,社交媒体平台在阻止深度伪造传播方面做得不够。人们不核查就分享,加剧了问题。

AI语音克隆与社交媒体的广泛覆盖相结合,令人头痛。虚假音频可能迅速走红,在被证明虚假前触及数百万人。它还被用来针对特定选民群体传播定制谎言,难以应对。我们需要教育用户,开发捕捉AI伪造的工具,并让社交媒体平台承担责任。

规范政治广告中AI的立法努力

密歇根的开创性立法

一些州正积极应对这一问题。例如,密歇根在州议员Penelope Serneglou的推动下通过了法律,要求政治广告说明是否使用了AI。这帮助选民识别AI内容,了解潜在的操控行为。

密歇根还在考虑规范机器人电话中的AI使用,特别是那些涉及投票地点的电话。这是维护选举公平的重要举措,但只是开始。如何识别AI内容、平衡言论自由与选民保护,仍有许多问题待解。

公民如何保护自己免受AI生成虚假信息的侵害?

保持警惕并核实信息

在AI能制造逼真伪造的当今世界,保持敏锐至关重要。始终核查事实,注意偏见,意识到听到的或看到的不一定是真的。使用Snopes或PolitiFact等工具验证信息,对任何看似过于完美或不符合常理的内容保持怀疑。

- 对音频和视频保持怀疑:如果听起来好得令人难以置信,可能就是假的。检查音频质量和视频中人物的行为。

- 寻找操控痕迹:AI伪造可能有奇怪的停顿、异常音频或不匹配的灯光。

- 核查事实:在分享前,确保信息通过可靠来源验证为真。

- 注意偏见:警惕片面报道或过于戏剧化的新闻。

- 教育他人:分享你对AI伪造的了解,帮助他人保持警惕。

识别深度伪造和合成媒体

深度伪造和其他合成媒体无处不在。它们用AI制造来欺骗我们,很难识别。注意不自然的的表情、扭曲的音频、不一致的光线或过于完美的面孔。如果看到这些迹象,谨慎对待,在相信或分享前进行研究。

规范选举中AI的利与弊

优点

- 通过阻止虚假信息传播,保护选举完整性。

- 提升选民对投票过程的信任和意识。

- 促进政治广告的透明度。

- 阻止不良行为者利用AI干扰选民参与。

- 为应对未来AI挑战提供计划。

缺点

- 可能限制创新和AI的正当用途。

- 可能难以执行,且易被不良行为者规避。

- 引发关于言论自由和政治表达权的担忧。

- 可能被用来压制或审查不同意见。

- 建立和运行可能成本高昂。

关于AI语音克隆的常见问题

什么是AI语音克隆,如何运作?

AI语音克隆是AI分析现有语音录音,提取音高、音调等独特特征,然后生成听起来与原发言者相同的新音频。它用于有声书到诈骗等各种场景,且越来越逼真,难以区分真假。

AI语音克隆的生成速度有多快?

快得吓人。不到五分钟就能生成一个逼真的语音克隆,这在选举期间是个大问题,因为虚假音频可能迅速传播。

什么是AI生成的机器人电话,如何用于选民压制?

AI生成的机器人电话是使用克隆语音冒充某人的自动电话,常用于传播虚假信息或阻止投票。它们是影响选举结果的隐秘方式,覆盖面广且迅速。

社交媒体平台如何无意中传播AI语音克隆生成的虚假信息?

社交媒体因快速分享信息而传播虚假信息,用户常不核查就分享。这使得阻止AI生成谎言的传播变得困难。

AI生成虚假信息有哪些例子?

例子包括政治候选人的虚假声明、名人伪造的背书、投票地点的虚假信息,以及冒充候选人的机器人电话。广告中的AI图像也是其应用方式。

密歇根如何应对政治广告中的AI虚假信息?

密歇根通过法律要求政治广告披露是否使用了AI,帮助选民识别AI内容。他们还在努力规范涉及投票地点的AI电话,以防虚假信息。

有哪些识别AI生成虚假信息的工具或资源?

是的,Snopes、PolitiFact和Google Image Search等工具可帮助验证声明和图像。识别AI伪造的能力对保护钱包和民主进程至关重要。

百度健康近期内部测试了AI医生助手“DoctorClaw”,用于学术文献检索和日常办公辅助

据报道,百度健康已开始对一款专为医生设计的专业AI智能助手进行内部测试。该产品内部代号为“DoctorClaw”(龙虾医生版),标志着百度在医疗领域部署大型语言模型方面迈出了重要一步。知情人士透露,该项目仍处于封闭开发阶段,目前已进入内部测试。虽然具体的产品形态尚未完全披露,但已接近上线。 在功能方面,DoctorClaw初期将侧重于学术文献检索和常规诊疗辅助。但其长期战略旨在深度融入临床诊断、医

百度健康近期内部测试了AI医生助手“DoctorClaw”,用于学术文献检索和日常办公辅助

据报道,百度健康已开始对一款专为医生设计的专业AI智能助手进行内部测试。该产品内部代号为“DoctorClaw”(龙虾医生版),标志着百度在医疗领域部署大型语言模型方面迈出了重要一步。知情人士透露,该项目仍处于封闭开发阶段,目前已进入内部测试。虽然具体的产品形态尚未完全披露,但已接近上线。 在功能方面,DoctorClaw初期将侧重于学术文献检索和常规诊疗辅助。但其长期战略旨在深度融入临床诊断、医

Cursor Composer 2 与 Claude Opus 4.6:基准测试引发新一轮人工智能编程争论

3月19日,Cursor正式发布了其自主研发的编程模型Composer 2。 这一消息在开发者社区中立即引发热议——据 Cursor 称,Composer 2 在 Terminal-Bench 2.0 测试中获得了 61.7% 的得分,在相同的测试条件下,这一成绩显著超过了 Claude Opus 4.6 的 58.0%。Anthropic的旗舰模型竟被自家IDE内置的模型超越?随着消息传开,相关

Cursor Composer 2 与 Claude Opus 4.6:基准测试引发新一轮人工智能编程争论

3月19日,Cursor正式发布了其自主研发的编程模型Composer 2。 这一消息在开发者社区中立即引发热议——据 Cursor 称,Composer 2 在 Terminal-Bench 2.0 测试中获得了 61.7% 的得分,在相同的测试条件下,这一成绩显著超过了 Claude Opus 4.6 的 58.0%。Anthropic的旗舰模型竟被自家IDE内置的模型超越?随着消息传开,相关

StrictlyVC旧金山站将汇聚TDK Ventures、Replit等企业的领军人物

今年首场StrictlyVC活动即将登陆旧金山,时间比你想象的要早。 4月30日,我们在菲律宾文化中心(Sentro Filipino Cultural Center)举办的聚会门票仍在热售中,届时将有阵容强大的演讲嘉宾阵容。除了StrictlyVC一贯以人脉拓展和社区互动著称外,本次旧金山活动对于寻求最新融资洞见的AI创新者和创始人而言,将具有特别重要的价值。谁将登台门票现已开售,但如果您此前未

StrictlyVC旧金山站将汇聚TDK Ventures、Replit等企业的领军人物

今年首场StrictlyVC活动即将登陆旧金山,时间比你想象的要早。 4月30日,我们在菲律宾文化中心(Sentro Filipino Cultural Center)举办的聚会门票仍在热售中,届时将有阵容强大的演讲嘉宾阵容。除了StrictlyVC一贯以人脉拓展和社区互动著称外,本次旧金山活动对于寻求最新融资洞见的AI创新者和创始人而言,将具有特别重要的价值。谁将登台门票现已开售,但如果您此前未

Ого, клонирование голосов ИИ уже влияет на выборы? Это похоже на сценарий из научно-фантастического фильма, который становится реальностью. Технология развивается так быстро, что законодатели явно не поспевают. Как обычным людям, таким как я, защитить себя от такой тонкой формы дезинформации? Может, нам стоит начать использовать кодовые слова в телефонных разговорах с близкими? 😅 Это одновременно захватывающе и пугающе.

This AI voice cloning stuff is wild! It’s like something out of a sci-fi movie, but it’s real and messing with elections? That’s scary. I wonder how we can even trust what we hear anymore. 🫣

首页

首页