AI 聊天機器人面臨開發者設計的具爭議性主題測試

一位化名為「xlr8harder」的開發人員推出 SpeechMap,這是一個「自由言論評估」工具,分析領先的 AI 聊天機器人如何處理有爭議的話題。該平台比較 OpenAI 的 ChatGPT 和 xAI 的 Grok 等模型對政治論述、民權討論和抗議相關查詢的回應。

這項計畫的出現,是因為 AI 公司面臨越來越多的審查,認為他們的系統存在政治偏見。多位白宮盟友與知名科技人物,包括 Elon Musk 與 David Sacks,都指控主流聊天機器人展現出進步傾向的審查制度。

雖然 AI 公司並未直接回應這些指控,但有些公司已表現出回應能力。Meta 最近調整了 Llama 模型,避免在處理辯論主題時偏向特定的政治觀點。

SpeechMap 的創造者解釋了他們的動機:"這些對話屬於公共領域,而非局限於公司董事會。我的平台讓使用者有能力透過客觀的測試來檢視第一手的資料"。

評估方法採用 AI 評判,評估聊天機器人在政治評論、歷史詮釋和國家符號分類方面的回應。每次互動都會被歸類為

- 完全符合(直接回答)

- 迴避式回應

- 直接拒絕

Xlr8harder 承認方法上的限制,包括潛在的判斷模型偏差和技術上的不一致。然而,所收集的資料揭示了領先 AI 系統中值得注意的行為模式。

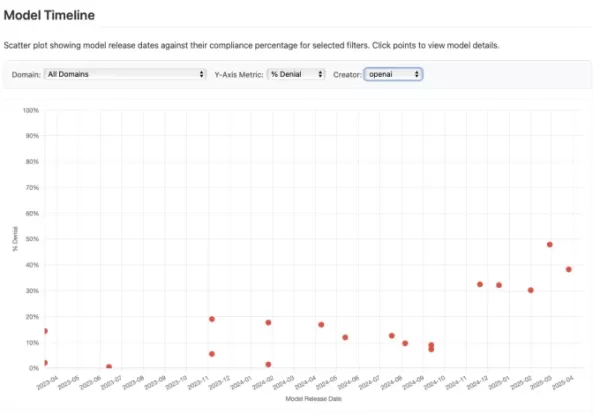

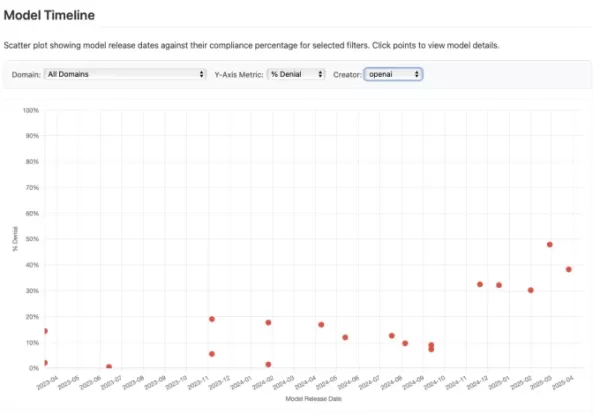

值得注意的發現包括 OpenAI 演變中的政治論述方式。最近的 GPT 迭代顯示,儘管 OpenAI 在二月時承諾要對具爭議性的議題提出更平衡的觀點,但在處理敏感話題時卻更加克制。

基於 SpeechMap 數據的 OpenAI 模型回應趨勢 該分析將 xAI 的 Grok 3 定位為測試中最不受限制的模型,對 96.2% 的提示做出了回應,而行業平均回應率為 71.3%。這與 Musk 原先將 Grok 定位為「清醒」AI 系統的另一種不受限制的選擇不謀而合。

"SpeechMap 開發人員指出:「當大多數模型越來越限制政治評論時,xAI 似乎刻意朝著減少會話限制的方向邁進。

早期的 Grok 版本在性別認同和經濟不平等等問題上仍然表現出進步的傾向,儘管馬斯克做出了中立的承諾。首席執行官之前將這些偏見歸咎於來自公共網路來源的訓練資料影響。

最近的評估顯示,Grok 3 達到了更高的政治中立性,儘管該系統曾因短暫審查馬斯克的負面評論而招致批評。這種演變反映了自由表達原則與 AI 開發人員所面臨的內容審查挑戰之間持續存在的緊張關係。

相關文章

葛瑞格・布洛克曼揭露伊隆・馬斯克如何離開 OpenAI

2017年8月下旬,OpenAI(當時還是一家小型非營利研究實驗室)的核心成員召開會議,商討如何成立營利實體以將其技術商業化,並籌集實現通用人工智慧(AGI)所需的資金。伊隆·馬斯克要求對公司擁有完全控制權,並剛向每位共同創辦人贈送了一輛特斯拉Model 3。技術長格雷格·布羅克曼表示,他認為這是在馬斯克與山姆·奧特曼為各自對公司未來的願景爭取支持之際,試圖用這份禮物來收買他們。 OpenAI的研

葛瑞格・布洛克曼揭露伊隆・馬斯克如何離開 OpenAI

2017年8月下旬,OpenAI(當時還是一家小型非營利研究實驗室)的核心成員召開會議,商討如何成立營利實體以將其技術商業化,並籌集實現通用人工智慧(AGI)所需的資金。伊隆·馬斯克要求對公司擁有完全控制權,並剛向每位共同創辦人贈送了一輛特斯拉Model 3。技術長格雷格·布羅克曼表示,他認為這是在馬斯克與山姆·奧特曼為各自對公司未來的願景爭取支持之際,試圖用這份禮物來收買他們。 OpenAI的研

五角大樓與英偉達、微軟和亞馬遜網路服務公司簽訂了協議,以便在機密網路中部署人工智慧技術。

在此前與谷歌、SpaceX和OpenAI達成協議之後,美國國防部於週五宣佈,它現已與Nvidia、微軟、亞馬遜網路服務和Reflection AI簽訂了合同,這些公司將會將其人工智慧技術和模型部署在保密網路上,用於“合法的操作用途”。宣告中還指出:“這些協議加速了將美國軍隊建設成為以人工智慧為核心作戰力量的程序,並將增強我們的戰士在所有戰爭領域保持決策優勢的能力。”這些協議的簽署,正值五角大樓試圖在與Anthropic就使用條款發生爭議後,多元化其人工智慧供應商的選擇。五角大樓希望無限制地使

五角大樓與英偉達、微軟和亞馬遜網路服務公司簽訂了協議,以便在機密網路中部署人工智慧技術。

在此前與谷歌、SpaceX和OpenAI達成協議之後,美國國防部於週五宣佈,它現已與Nvidia、微軟、亞馬遜網路服務和Reflection AI簽訂了合同,這些公司將會將其人工智慧技術和模型部署在保密網路上,用於“合法的操作用途”。宣告中還指出:“這些協議加速了將美國軍隊建設成為以人工智慧為核心作戰力量的程序,並將增強我們的戰士在所有戰爭領域保持決策優勢的能力。”這些協議的簽署,正值五角大樓試圖在與Anthropic就使用條款發生爭議後,多元化其人工智慧供應商的選擇。五角大樓希望無限制地使

OpenAI在其API中推出了語音智慧功能

OpenAI在週四宣佈,其API現已新增多項語音智慧功能,這些功能旨在幫助開發者構建能夠進行對話、轉錄和翻譯的應用程式。該公司新推出的GPT-Realtime-2是一款語音模型,它能夠生成逼真的聲音模擬效果,從而與使用者進行交流。不過,與前代產品GPT-Realtime-1.5不同,這一版本融入了GPT-5級別的推理能力,OpenAI表示,這種能力使該模型能夠處理更復雜的使用者請求。此外,OpenAI還推出了GPT-Realtime-Translate功能,顧名思義,它能夠提供實時翻譯服務,在用

相關專題推薦

評論 (2)

0/500

OpenAI在其API中推出了語音智慧功能

OpenAI在週四宣佈,其API現已新增多項語音智慧功能,這些功能旨在幫助開發者構建能夠進行對話、轉錄和翻譯的應用程式。該公司新推出的GPT-Realtime-2是一款語音模型,它能夠生成逼真的聲音模擬效果,從而與使用者進行交流。不過,與前代產品GPT-Realtime-1.5不同,這一版本融入了GPT-5級別的推理能力,OpenAI表示,這種能力使該模型能夠處理更復雜的使用者請求。此外,OpenAI還推出了GPT-Realtime-Translate功能,顧名思義,它能夠提供實時翻譯服務,在用

相關專題推薦

評論 (2)

0/500

![WilliamYoung]()

Die Idee ist interessant, aber so ein Benchmark bringt doch immer die Voreingenommenheit des Entwicklers selbst mit rein, oder? 🤔 Die Ergebnisse sollten nicht überinterpretiert werden. Dennoch gut zu sehen, ob manche Modelle wirklich 'ausweichen' oder offen diskutieren. Technisch aber wahrscheinlich recht simpel umgesetzt - ist der Wert also begrenzt?

一位化名為「xlr8harder」的開發人員推出 SpeechMap,這是一個「自由言論評估」工具,分析領先的 AI 聊天機器人如何處理有爭議的話題。該平台比較 OpenAI 的 ChatGPT 和 xAI 的 Grok 等模型對政治論述、民權討論和抗議相關查詢的回應。

這項計畫的出現,是因為 AI 公司面臨越來越多的審查,認為他們的系統存在政治偏見。多位白宮盟友與知名科技人物,包括 Elon Musk 與 David Sacks,都指控主流聊天機器人展現出進步傾向的審查制度。

雖然 AI 公司並未直接回應這些指控,但有些公司已表現出回應能力。Meta 最近調整了 Llama 模型,避免在處理辯論主題時偏向特定的政治觀點。

SpeechMap 的創造者解釋了他們的動機:"這些對話屬於公共領域,而非局限於公司董事會。我的平台讓使用者有能力透過客觀的測試來檢視第一手的資料"。

評估方法採用 AI 評判,評估聊天機器人在政治評論、歷史詮釋和國家符號分類方面的回應。每次互動都會被歸類為

- 完全符合(直接回答)

- 迴避式回應

- 直接拒絕

Xlr8harder 承認方法上的限制,包括潛在的判斷模型偏差和技術上的不一致。然而,所收集的資料揭示了領先 AI 系統中值得注意的行為模式。

值得注意的發現包括 OpenAI 演變中的政治論述方式。最近的 GPT 迭代顯示,儘管 OpenAI 在二月時承諾要對具爭議性的議題提出更平衡的觀點,但在處理敏感話題時卻更加克制。

該分析將 xAI 的 Grok 3 定位為測試中最不受限制的模型,對 96.2% 的提示做出了回應,而行業平均回應率為 71.3%。這與 Musk 原先將 Grok 定位為「清醒」AI 系統的另一種不受限制的選擇不謀而合。

"SpeechMap 開發人員指出:「當大多數模型越來越限制政治評論時,xAI 似乎刻意朝著減少會話限制的方向邁進。

早期的 Grok 版本在性別認同和經濟不平等等問題上仍然表現出進步的傾向,儘管馬斯克做出了中立的承諾。首席執行官之前將這些偏見歸咎於來自公共網路來源的訓練資料影響。

最近的評估顯示,Grok 3 達到了更高的政治中立性,儘管該系統曾因短暫審查馬斯克的負面評論而招致批評。這種演變反映了自由表達原則與 AI 開發人員所面臨的內容審查挑戰之間持續存在的緊張關係。

葛瑞格・布洛克曼揭露伊隆・馬斯克如何離開 OpenAI

2017年8月下旬,OpenAI(當時還是一家小型非營利研究實驗室)的核心成員召開會議,商討如何成立營利實體以將其技術商業化,並籌集實現通用人工智慧(AGI)所需的資金。伊隆·馬斯克要求對公司擁有完全控制權,並剛向每位共同創辦人贈送了一輛特斯拉Model 3。技術長格雷格·布羅克曼表示,他認為這是在馬斯克與山姆·奧特曼為各自對公司未來的願景爭取支持之際,試圖用這份禮物來收買他們。 OpenAI的研

葛瑞格・布洛克曼揭露伊隆・馬斯克如何離開 OpenAI

2017年8月下旬,OpenAI(當時還是一家小型非營利研究實驗室)的核心成員召開會議,商討如何成立營利實體以將其技術商業化,並籌集實現通用人工智慧(AGI)所需的資金。伊隆·馬斯克要求對公司擁有完全控制權,並剛向每位共同創辦人贈送了一輛特斯拉Model 3。技術長格雷格·布羅克曼表示,他認為這是在馬斯克與山姆·奧特曼為各自對公司未來的願景爭取支持之際,試圖用這份禮物來收買他們。 OpenAI的研

五角大樓與英偉達、微軟和亞馬遜網路服務公司簽訂了協議,以便在機密網路中部署人工智慧技術。

在此前與谷歌、SpaceX和OpenAI達成協議之後,美國國防部於週五宣佈,它現已與Nvidia、微軟、亞馬遜網路服務和Reflection AI簽訂了合同,這些公司將會將其人工智慧技術和模型部署在保密網路上,用於“合法的操作用途”。宣告中還指出:“這些協議加速了將美國軍隊建設成為以人工智慧為核心作戰力量的程序,並將增強我們的戰士在所有戰爭領域保持決策優勢的能力。”這些協議的簽署,正值五角大樓試圖在與Anthropic就使用條款發生爭議後,多元化其人工智慧供應商的選擇。五角大樓希望無限制地使

五角大樓與英偉達、微軟和亞馬遜網路服務公司簽訂了協議,以便在機密網路中部署人工智慧技術。

在此前與谷歌、SpaceX和OpenAI達成協議之後,美國國防部於週五宣佈,它現已與Nvidia、微軟、亞馬遜網路服務和Reflection AI簽訂了合同,這些公司將會將其人工智慧技術和模型部署在保密網路上,用於“合法的操作用途”。宣告中還指出:“這些協議加速了將美國軍隊建設成為以人工智慧為核心作戰力量的程序,並將增強我們的戰士在所有戰爭領域保持決策優勢的能力。”這些協議的簽署,正值五角大樓試圖在與Anthropic就使用條款發生爭議後,多元化其人工智慧供應商的選擇。五角大樓希望無限制地使

OpenAI在其API中推出了語音智慧功能

OpenAI在週四宣佈,其API現已新增多項語音智慧功能,這些功能旨在幫助開發者構建能夠進行對話、轉錄和翻譯的應用程式。該公司新推出的GPT-Realtime-2是一款語音模型,它能夠生成逼真的聲音模擬效果,從而與使用者進行交流。不過,與前代產品GPT-Realtime-1.5不同,這一版本融入了GPT-5級別的推理能力,OpenAI表示,這種能力使該模型能夠處理更復雜的使用者請求。此外,OpenAI還推出了GPT-Realtime-Translate功能,顧名思義,它能夠提供實時翻譯服務,在用

OpenAI在其API中推出了語音智慧功能

OpenAI在週四宣佈,其API現已新增多項語音智慧功能,這些功能旨在幫助開發者構建能夠進行對話、轉錄和翻譯的應用程式。該公司新推出的GPT-Realtime-2是一款語音模型,它能夠生成逼真的聲音模擬效果,從而與使用者進行交流。不過,與前代產品GPT-Realtime-1.5不同,這一版本融入了GPT-5級別的推理能力,OpenAI表示,這種能力使該模型能夠處理更復雜的使用者請求。此外,OpenAI還推出了GPT-Realtime-Translate功能,顧名思義,它能夠提供實時翻譯服務,在用

Die Idee ist interessant, aber so ein Benchmark bringt doch immer die Voreingenommenheit des Entwicklers selbst mit rein, oder? 🤔 Die Ergebnisse sollten nicht überinterpretiert werden. Dennoch gut zu sehen, ob manche Modelle wirklich 'ausweichen' oder offen diskutieren. Technisch aber wahrscheinlich recht simpel umgesetzt - ist der Wert also begrenzt?

首頁

首頁