Le nouveau générateur d'images de Chatgpt est vraiment doué pour simuler les reçus

Ce mois-ci, ChatGPT a lancé un nouveau générateur d'images avec son modèle 4o, et il est sacrément doué pour intégrer du texte dans les images. Les gens l'utilisent déjà pour créer de faux reçus de restaurant, ajoutant un nouveau tour au répertoire des deepfakes d'IA que les escrocs adorent utiliser.

Deedy Das, une figure connue sur les réseaux sociaux et dans le monde du capital-risque, a partagé sur X une photo d'un faux reçu d'un vrai steakhouse de San Francisco, affirmant l'avoir créé avec 4o.

Vous pouvez utiliser 4o pour générer de faux reçus.

Il y a trop de processus de vérification dans le monde réel qui reposent sur des « images réelles » comme preuve. Cette époque est révolue. pic.twitter.com/9FORS1PWsb

— Deedy (@deedydas) 29 mars 2025

D'autres ont suivi le mouvement, créant leurs propres faux, certains ajoutant même des taches de nourriture ou de boisson pour les rendre plus crédibles :

Je pense que dans l'image originale, les lettres sont trop parfaites et ne suivent pas les plis du papier. Elles semblent flotter au-dessus du papier. Voici ma tentative pour la rendre plus réaliste. Dites-moi ce que vous en pensez. pic.twitter.com/EixRSHubeY

— Michael Gofman (@michaelgofman) 29 mars 2025

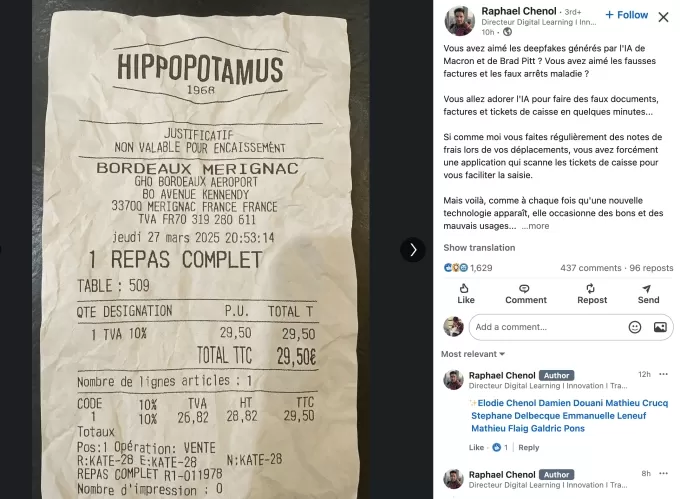

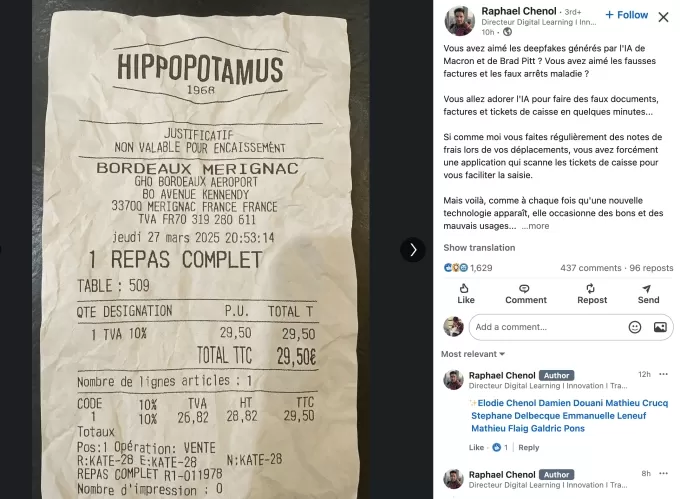

Le faux le plus convaincant que nous ayons trouvé chez TechCrunch venait de France, où un utilisateur de LinkedIn a publié un reçu froissé généré par IA d'une chaîne de restaurants locale :

Nous, chez TechCrunch, avons essayé 4o et réussi à créer un faux reçu pour un Applebee’s à San Francisco :

Nous, chez TechCrunch, avons essayé 4o et réussi à créer un faux reçu pour un Applebee’s à San Francisco :

Crédits image : chagpt / charles rollet Mais notre tentative présentait quelques signes révélateurs de falsification. Pour commencer, le total utilisait une virgule au lieu d'un point, et le calcul était erroné. Les LLM ont encore du mal avec les mathématiques de base, donc ce n'est pas trop surprenant.Il ne faudrait pas grand-chose pour qu'un escroc ajuste quelques chiffres avec un logiciel de retouche photo ou des invites plus spécifiques.

Il est assez clair que faciliter la génération de faux reçus ouvre tout un monde de possibilités de fraude. Il n'est pas difficile d'imaginer des acteurs malveillants utilisant cette technologie pour se faire « rembourser » des dépenses totalement inventées.

Taya Christianson, porte-parole d'OpenAI, a déclaré à TechCrunch que toutes les images créées par ChatGPT contiennent des métadonnées indiquant qu'elles ont été générées par l'IA. Christianson a également mentionné qu'OpenAI « prend des mesures » contre les utilisateurs qui enfreignent ses politiques d'utilisation et qu'ils « apprennent toujours » des usages réels et des retours.

Lorsque nous avons demandé pourquoi ChatGPT permet de créer de faux reçus en premier lieu, et si cela est conforme aux politiques d'utilisation d'OpenAI (qui interdisent la fraude), Christianson a répondu que l'objectif d'OpenAI est de « donner aux utilisateurs autant de liberté créative que possible ». Elle a souligné que les faux reçus d'IA pourraient être utilisés à des fins non frauduleuses, comme « enseigner la littératie financière » ou créer des œuvres d'art originales et des publicités pour produits.

Article connexe

Satya Nadella est prêt à tirer parti du nouvel accord avec OpenAI

Mercredi, un analyste de Wall Street a demandé directement au PDG de Microsoft, Satya Nadella, en quoi le nouveau partenariat avec OpenAI affecterait les résultats financiers de l’entreprise.Nadella a décrit ce nouvel accord comme une victoire pour

Satya Nadella est prêt à tirer parti du nouvel accord avec OpenAI

Mercredi, un analyste de Wall Street a demandé directement au PDG de Microsoft, Satya Nadella, en quoi le nouveau partenariat avec OpenAI affecterait les résultats financiers de l’entreprise.Nadella a décrit ce nouvel accord comme une victoire pour

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

Recommandations de sujets spéciaux liés

commentaires (17)

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

Recommandations de sujets spéciaux liés

commentaires (17)

![JonathanNelson]()

Создание поддельных чеков с помощью ИИ — это просто невероятно! 😱 Теперь мошенники могут легко генерировать фальшивые документы, и это пугает. Как мы можем защитить себя от таких подделок? Может, нужны специальные цифровые водяные знаки?

![FrankSmith]()

Como usuario casual de IA, esto me da un poco de miedo 😅 Hacer recibos falsos tan fácil... ¿qué sigue? ¿Falsificar facturas médicas? Aunque la tecnología es impresionante, ojalá las plataformas implementen medidas para detectar este tipo de abusos antes de que sea demasiado tarde. ¡Necesitamos regulación YA!

![NicholasYoung]()

ChatGPTの新しい画像生成器を使って、豪華なディナーのレシートを作りました。めっちゃリアルで友達も信じちゃった。面白いけど、こんなに簡単に偽物が作れるのはちょっと怖いですね。この機能、使うときは注意が必要です!

![BillyAdams]()

O novo gerador de imagens do ChatGPT é incrível! Usei para criar um recibo falso de um jantar chique e ficou tão real que meus amigos acreditaram. É divertido, mas também assustador como é fácil criar falsificações convincentes. Cuidado com isso!

![StevenHill]()

ChatGPT의 새로운 이미지 생성기로 고급 저녁 식사의 영수증을 만들었어요. 너무 진짜 같아서 친구들도 속았어요. 재미있지만, 이렇게 쉽게 가짜를 만들 수 있다는 게 조금 무섭네요. 이 기능, 사용할 때 조심해야 할 것 같아요!

Ce mois-ci, ChatGPT a lancé un nouveau générateur d'images avec son modèle 4o, et il est sacrément doué pour intégrer du texte dans les images. Les gens l'utilisent déjà pour créer de faux reçus de restaurant, ajoutant un nouveau tour au répertoire des deepfakes d'IA que les escrocs adorent utiliser.

Deedy Das, une figure connue sur les réseaux sociaux et dans le monde du capital-risque, a partagé sur X une photo d'un faux reçu d'un vrai steakhouse de San Francisco, affirmant l'avoir créé avec 4o.

Vous pouvez utiliser 4o pour générer de faux reçus.

Il y a trop de processus de vérification dans le monde réel qui reposent sur des « images réelles » comme preuve. Cette époque est révolue. pic.twitter.com/9FORS1PWsb

— Deedy (@deedydas) 29 mars 2025

D'autres ont suivi le mouvement, créant leurs propres faux, certains ajoutant même des taches de nourriture ou de boisson pour les rendre plus crédibles :

Je pense que dans l'image originale, les lettres sont trop parfaites et ne suivent pas les plis du papier. Elles semblent flotter au-dessus du papier. Voici ma tentative pour la rendre plus réaliste. Dites-moi ce que vous en pensez. pic.twitter.com/EixRSHubeY

— Michael Gofman (@michaelgofman) 29 mars 2025

Le faux le plus convaincant que nous ayons trouvé chez TechCrunch venait de France, où un utilisateur de LinkedIn a publié un reçu froissé généré par IA d'une chaîne de restaurants locale :

Nous, chez TechCrunch, avons essayé 4o et réussi à créer un faux reçu pour un Applebee’s à San Francisco :

Nous, chez TechCrunch, avons essayé 4o et réussi à créer un faux reçu pour un Applebee’s à San Francisco :

Il ne faudrait pas grand-chose pour qu'un escroc ajuste quelques chiffres avec un logiciel de retouche photo ou des invites plus spécifiques.

Il est assez clair que faciliter la génération de faux reçus ouvre tout un monde de possibilités de fraude. Il n'est pas difficile d'imaginer des acteurs malveillants utilisant cette technologie pour se faire « rembourser » des dépenses totalement inventées.

Taya Christianson, porte-parole d'OpenAI, a déclaré à TechCrunch que toutes les images créées par ChatGPT contiennent des métadonnées indiquant qu'elles ont été générées par l'IA. Christianson a également mentionné qu'OpenAI « prend des mesures » contre les utilisateurs qui enfreignent ses politiques d'utilisation et qu'ils « apprennent toujours » des usages réels et des retours.

Lorsque nous avons demandé pourquoi ChatGPT permet de créer de faux reçus en premier lieu, et si cela est conforme aux politiques d'utilisation d'OpenAI (qui interdisent la fraude), Christianson a répondu que l'objectif d'OpenAI est de « donner aux utilisateurs autant de liberté créative que possible ». Elle a souligné que les faux reçus d'IA pourraient être utilisés à des fins non frauduleuses, comme « enseigner la littératie financière » ou créer des œuvres d'art originales et des publicités pour produits.

Satya Nadella est prêt à tirer parti du nouvel accord avec OpenAI

Mercredi, un analyste de Wall Street a demandé directement au PDG de Microsoft, Satya Nadella, en quoi le nouveau partenariat avec OpenAI affecterait les résultats financiers de l’entreprise.Nadella a décrit ce nouvel accord comme une victoire pour

Satya Nadella est prêt à tirer parti du nouvel accord avec OpenAI

Mercredi, un analyste de Wall Street a demandé directement au PDG de Microsoft, Satya Nadella, en quoi le nouveau partenariat avec OpenAI affecterait les résultats financiers de l’entreprise.Nadella a décrit ce nouvel accord comme une victoire pour

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

OpenAI présente les grandes lignes d'une économie de l'IA fondée sur des fonds de richesse publique, une taxe sur les robots et la semaine de quatre jours

Alors que les gouvernements peinent à gérer l’impact économique des machines superintelligentes, OpenAI a publié une série de propositions politiques décrivant comment la richesse et le travail pourra

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

Greg Brockman révèle comment Elon Musk a quitté OpenAI

Fin août 2017, les principaux dirigeants d’OpenAI — alors un petit laboratoire de recherche à but non lucratif — se sont réunis pour discuter de la manière dont ils allaient créer une entité à but luc

Создание поддельных чеков с помощью ИИ — это просто невероятно! 😱 Теперь мошенники могут легко генерировать фальшивые документы, и это пугает. Как мы можем защитить себя от таких подделок? Может, нужны специальные цифровые водяные знаки?

Como usuario casual de IA, esto me da un poco de miedo 😅 Hacer recibos falsos tan fácil... ¿qué sigue? ¿Falsificar facturas médicas? Aunque la tecnología es impresionante, ojalá las plataformas implementen medidas para detectar este tipo de abusos antes de que sea demasiado tarde. ¡Necesitamos regulación YA!

ChatGPTの新しい画像生成器を使って、豪華なディナーのレシートを作りました。めっちゃリアルで友達も信じちゃった。面白いけど、こんなに簡単に偽物が作れるのはちょっと怖いですね。この機能、使うときは注意が必要です!

O novo gerador de imagens do ChatGPT é incrível! Usei para criar um recibo falso de um jantar chique e ficou tão real que meus amigos acreditaram. É divertido, mas também assustador como é fácil criar falsificações convincentes. Cuidado com isso!

ChatGPT의 새로운 이미지 생성기로 고급 저녁 식사의 영수증을 만들었어요. 너무 진짜 같아서 친구들도 속았어요. 재미있지만, 이렇게 쉽게 가짜를 만들 수 있다는 게 조금 무섭네요. 이 기능, 사용할 때 조심해야 할 것 같아요!

Maison

Maison