專注於實惠增強現實的真實對焦系統

革命性的投影式擴增實境技術

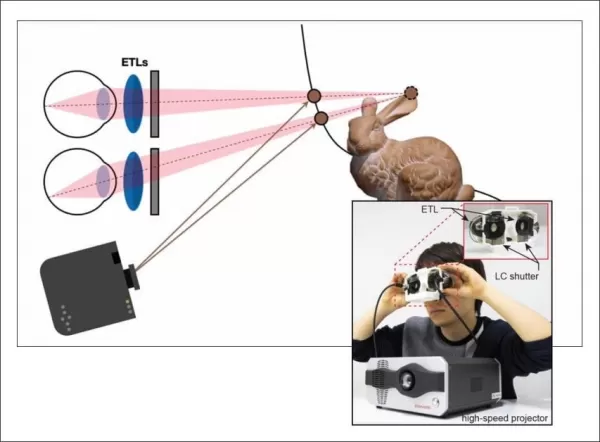

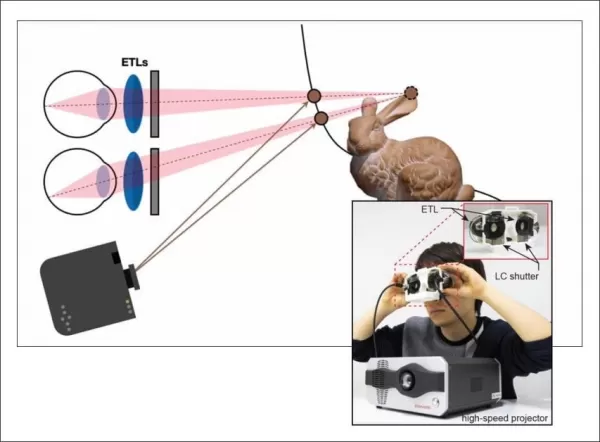

來自著名的電機電子工程師學會 (IEEE) 的研究人員,在以投影為基礎的擴增實境世界中,取得了突破性的躍進。他們的解決方案是什麼?配備電子焦點可調式鏡片 (ETL) 的特殊眼鏡,可模仿我們眼睛自然感知深度的方式。這種創新方法解決了投影系統在受控環境中真正實用的主要障礙。

想像一下,走進一個房間,投影出來的 3D 物件看起來就像周圍的家具一樣真實。這就是這項技術所承諾的真實感。透過與使用者的視線同步改變投影影像的焦點,系統消除了常見於擴增實境裝置的浮動、不自然的銳利度。

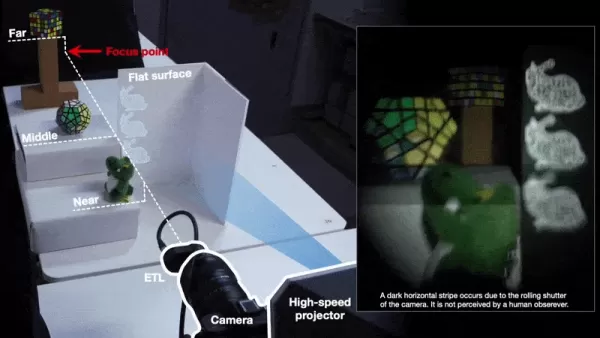

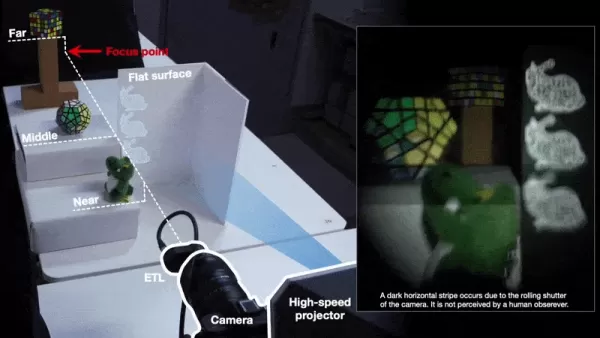

它是如何運作的?

這一切都要歸功於嵌入在觀眾眼鏡中的 ETL 鏡片。這些鏡片可與投影系統溝通,讓系統可根據使用者的視線位置調整投影影像的模糊程度。這可確保虛擬物件在焦點和深度感知方面與真實世界中的物件無縫對齊。

可用性的突破

這篇題為Multifocal Stereoscopic Projection Mapping 的研究論文,為以投影為基礎的 AR 引入了新的可用性層面。一直以來,這些系統都在掙扎於一種稱為 「會聚-適應衝突」(VAC)的現象,即物體的感知距離與實際對焦距離不一致。這會導致物件顯得不自然的銳利或模糊,破壞沉浸感。

這種新方法透過動態調整投射影像的焦距,正面解決 VAC 問題,為使用者創造更真實的體驗。ETL 系統與 Microsoft HoloLens 等可穿戴式 AR 裝置不同,後者嚴重依賴機上處理,而 ETL 系統可將大部分的運算負載卸載至遠端處理器。這可大幅降低延遲,同時提升效能與舒適度。

投影式 AR 的優勢

與傳統 AR 裝置相比,投影式系統具有幾項主要優勢。首先,它們可以透過增加投影機來覆蓋極為寬廣的視野。眼鏡本身也很輕,長時間使用會更舒適。此外,多位使用者只要在投影範圍內,就能同時享受相同的 AR 體驗。

遊戲以外的應用

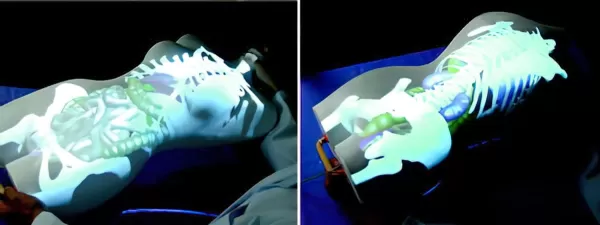

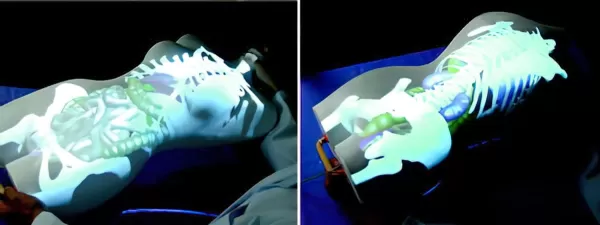

雖然遊戲是這項技術的明顯受益者,但其潛力遠遠超越娛樂。博物館、建築公司、醫科學院,甚至是電話會議平台,都可以利用投影式 AR 來創造身歷其境的體驗。舉例來說,醫學院的學生可以在栩栩如生的人體模型上練習手術,再加上逼真的投影效果。

挑戰與未來展望

儘管這個系統很有前途,但也不是沒有限制。它需要黑暗的環境才能發揮最佳功能,類似於博物館或劇院。此外,目前的版本縮小了觀賞者的視角,不過隨著時間的推移,ETL 技術的進步可以解決這個問題。高速投影機也是有效分割影像的必要條件,但研究團隊使用現成的商用機種成功測試了他們的原型。

若要進一步瞭解這項引人入勝的研發成果,請觀賞下方的影片。

相關文章

以優化為驅動的人工智慧,正成為通用的模型發展新途徑

伊利諾大學厄巴納-香檳分校與維吉尼亞大學的研究人員開發出一種新型模型架構,有望為具備更強推理能力且更具韌性的AI系統鋪平道路。名為「能量基變壓器」(EBT)的架構,能自然運用推論時間擴展性來解決複雜挑戰。對企業而言,這意味著能以成本效益方式部署人工智慧應用,無需專門調校模型即可適應新情境。系統二思維的挑戰在心理學中,人類認知通常分為兩種模式:快速直覺的系統一,以及較緩慢、更刻意且具分析性的系統二。

以優化為驅動的人工智慧,正成為通用的模型發展新途徑

伊利諾大學厄巴納-香檳分校與維吉尼亞大學的研究人員開發出一種新型模型架構,有望為具備更強推理能力且更具韌性的AI系統鋪平道路。名為「能量基變壓器」(EBT)的架構,能自然運用推論時間擴展性來解決複雜挑戰。對企業而言,這意味著能以成本效益方式部署人工智慧應用,無需專門調校模型即可適應新情境。系統二思維的挑戰在心理學中,人類認知通常分為兩種模式:快速直覺的系統一,以及較緩慢、更刻意且具分析性的系統二。

人工智慧熱潮引發網路泡沫時期的泡沫憂慮

數十億美元湧入人工智慧領域的投資熱潮,引發一場激烈辯論:該產業是否正走向網路泡沫式的泡沫?投資者正密切關注熱潮是否降溫,或巨額晶片與基礎建設支出未能帶來預期回報的跡象。美銀全球研究近期調查凸顯此種謹慎態度:54%基金經理人認為人工智慧股票已處泡沫期,38%持反對意見。與網路泡沫的相似之處儘管樂觀情緒蔓延,質疑者仍質疑人工智慧的實質影響力,部分人士更直指其為虛張聲勢或即將破裂的泡沫。思科亞太、日本及

人工智慧熱潮引發網路泡沫時期的泡沫憂慮

數十億美元湧入人工智慧領域的投資熱潮,引發一場激烈辯論:該產業是否正走向網路泡沫式的泡沫?投資者正密切關注熱潮是否降溫,或巨額晶片與基礎建設支出未能帶來預期回報的跡象。美銀全球研究近期調查凸顯此種謹慎態度:54%基金經理人認為人工智慧股票已處泡沫期,38%持反對意見。與網路泡沫的相似之處儘管樂觀情緒蔓延,質疑者仍質疑人工智慧的實質影響力,部分人士更直指其為虛張聲勢或即將破裂的泡沫。思科亞太、日本及

程序記憶降低人工智能代理成本和複雜性

由浙江大學和阿里巴巴集團共同研發的一項新技術為大型語言模型(LLM)代理提供了動態記憶,從而提高其處理複雜任務的效率和效能。這種方法被命名為 Memp,它為代理提供了一種 「程序記憶」,這種記憶會隨著代理積累的經驗不斷更新,這與人類通過重複練習學習的方式類似。 Memp 建立了一個終身學習的系統,在這個系統中,代理不再需要從零開始處理每一項新任務。當他們在真實世界環境中面對新的情境時,他們會穩步改

相關專題推薦

評論 (5)

0/500

程序記憶降低人工智能代理成本和複雜性

由浙江大學和阿里巴巴集團共同研發的一項新技術為大型語言模型(LLM)代理提供了動態記憶,從而提高其處理複雜任務的效率和效能。這種方法被命名為 Memp,它為代理提供了一種 「程序記憶」,這種記憶會隨著代理積累的經驗不斷更新,這與人類通過重複練習學習的方式類似。 Memp 建立了一個終身學習的系統,在這個系統中,代理不再需要從零開始處理每一項新任務。當他們在真實世界環境中面對新的情境時,他們會穩步改

相關專題推薦

評論 (5)

0/500

![WillieJohnson]()

This AR focusing system sounds dope! Special glasses that tweak focus electrically? That's some sci-fi stuff coming to life. Wonder how comfy they are for long sessions tho 🤔

![RonaldLee]()

This AR focusing system sounds like a game-changer! 😎 Affordable glasses with tunable focus? Can't wait to see how this shakes up the market!

![JustinMartin]()

Wow, adjustable focus AR glasses sound like a game-changer! Can't wait to see how affordable they really are.

革命性的投影式擴增實境技術

來自著名的電機電子工程師學會 (IEEE) 的研究人員,在以投影為基礎的擴增實境世界中,取得了突破性的躍進。他們的解決方案是什麼?配備電子焦點可調式鏡片 (ETL) 的特殊眼鏡,可模仿我們眼睛自然感知深度的方式。這種創新方法解決了投影系統在受控環境中真正實用的主要障礙。

想像一下,走進一個房間,投影出來的 3D 物件看起來就像周圍的家具一樣真實。這就是這項技術所承諾的真實感。透過與使用者的視線同步改變投影影像的焦點,系統消除了常見於擴增實境裝置的浮動、不自然的銳利度。

它是如何運作的?

這一切都要歸功於嵌入在觀眾眼鏡中的 ETL 鏡片。這些鏡片可與投影系統溝通,讓系統可根據使用者的視線位置調整投影影像的模糊程度。這可確保虛擬物件在焦點和深度感知方面與真實世界中的物件無縫對齊。

可用性的突破

這篇題為Multifocal Stereoscopic Projection Mapping 的研究論文,為以投影為基礎的 AR 引入了新的可用性層面。一直以來,這些系統都在掙扎於一種稱為 「會聚-適應衝突」(VAC)的現象,即物體的感知距離與實際對焦距離不一致。這會導致物件顯得不自然的銳利或模糊,破壞沉浸感。

這種新方法透過動態調整投射影像的焦距,正面解決 VAC 問題,為使用者創造更真實的體驗。ETL 系統與 Microsoft HoloLens 等可穿戴式 AR 裝置不同,後者嚴重依賴機上處理,而 ETL 系統可將大部分的運算負載卸載至遠端處理器。這可大幅降低延遲,同時提升效能與舒適度。

投影式 AR 的優勢

與傳統 AR 裝置相比,投影式系統具有幾項主要優勢。首先,它們可以透過增加投影機來覆蓋極為寬廣的視野。眼鏡本身也很輕,長時間使用會更舒適。此外,多位使用者只要在投影範圍內,就能同時享受相同的 AR 體驗。

遊戲以外的應用

雖然遊戲是這項技術的明顯受益者,但其潛力遠遠超越娛樂。博物館、建築公司、醫科學院,甚至是電話會議平台,都可以利用投影式 AR 來創造身歷其境的體驗。舉例來說,醫學院的學生可以在栩栩如生的人體模型上練習手術,再加上逼真的投影效果。

挑戰與未來展望

儘管這個系統很有前途,但也不是沒有限制。它需要黑暗的環境才能發揮最佳功能,類似於博物館或劇院。此外,目前的版本縮小了觀賞者的視角,不過隨著時間的推移,ETL 技術的進步可以解決這個問題。高速投影機也是有效分割影像的必要條件,但研究團隊使用現成的商用機種成功測試了他們的原型。

若要進一步瞭解這項引人入勝的研發成果,請觀賞下方的影片。

以優化為驅動的人工智慧,正成為通用的模型發展新途徑

伊利諾大學厄巴納-香檳分校與維吉尼亞大學的研究人員開發出一種新型模型架構,有望為具備更強推理能力且更具韌性的AI系統鋪平道路。名為「能量基變壓器」(EBT)的架構,能自然運用推論時間擴展性來解決複雜挑戰。對企業而言,這意味著能以成本效益方式部署人工智慧應用,無需專門調校模型即可適應新情境。系統二思維的挑戰在心理學中,人類認知通常分為兩種模式:快速直覺的系統一,以及較緩慢、更刻意且具分析性的系統二。

以優化為驅動的人工智慧,正成為通用的模型發展新途徑

伊利諾大學厄巴納-香檳分校與維吉尼亞大學的研究人員開發出一種新型模型架構,有望為具備更強推理能力且更具韌性的AI系統鋪平道路。名為「能量基變壓器」(EBT)的架構,能自然運用推論時間擴展性來解決複雜挑戰。對企業而言,這意味著能以成本效益方式部署人工智慧應用,無需專門調校模型即可適應新情境。系統二思維的挑戰在心理學中,人類認知通常分為兩種模式:快速直覺的系統一,以及較緩慢、更刻意且具分析性的系統二。

人工智慧熱潮引發網路泡沫時期的泡沫憂慮

數十億美元湧入人工智慧領域的投資熱潮,引發一場激烈辯論:該產業是否正走向網路泡沫式的泡沫?投資者正密切關注熱潮是否降溫,或巨額晶片與基礎建設支出未能帶來預期回報的跡象。美銀全球研究近期調查凸顯此種謹慎態度:54%基金經理人認為人工智慧股票已處泡沫期,38%持反對意見。與網路泡沫的相似之處儘管樂觀情緒蔓延,質疑者仍質疑人工智慧的實質影響力,部分人士更直指其為虛張聲勢或即將破裂的泡沫。思科亞太、日本及

人工智慧熱潮引發網路泡沫時期的泡沫憂慮

數十億美元湧入人工智慧領域的投資熱潮,引發一場激烈辯論:該產業是否正走向網路泡沫式的泡沫?投資者正密切關注熱潮是否降溫,或巨額晶片與基礎建設支出未能帶來預期回報的跡象。美銀全球研究近期調查凸顯此種謹慎態度:54%基金經理人認為人工智慧股票已處泡沫期,38%持反對意見。與網路泡沫的相似之處儘管樂觀情緒蔓延,質疑者仍質疑人工智慧的實質影響力,部分人士更直指其為虛張聲勢或即將破裂的泡沫。思科亞太、日本及

程序記憶降低人工智能代理成本和複雜性

由浙江大學和阿里巴巴集團共同研發的一項新技術為大型語言模型(LLM)代理提供了動態記憶,從而提高其處理複雜任務的效率和效能。這種方法被命名為 Memp,它為代理提供了一種 「程序記憶」,這種記憶會隨著代理積累的經驗不斷更新,這與人類通過重複練習學習的方式類似。 Memp 建立了一個終身學習的系統,在這個系統中,代理不再需要從零開始處理每一項新任務。當他們在真實世界環境中面對新的情境時,他們會穩步改

程序記憶降低人工智能代理成本和複雜性

由浙江大學和阿里巴巴集團共同研發的一項新技術為大型語言模型(LLM)代理提供了動態記憶,從而提高其處理複雜任務的效率和效能。這種方法被命名為 Memp,它為代理提供了一種 「程序記憶」,這種記憶會隨著代理積累的經驗不斷更新,這與人類通過重複練習學習的方式類似。 Memp 建立了一個終身學習的系統,在這個系統中,代理不再需要從零開始處理每一項新任務。當他們在真實世界環境中面對新的情境時,他們會穩步改

This AR focusing system sounds dope! Special glasses that tweak focus electrically? That's some sci-fi stuff coming to life. Wonder how comfy they are for long sessions tho 🤔

This AR focusing system sounds like a game-changer! 😎 Affordable glasses with tunable focus? Can't wait to see how this shakes up the market!

Wow, adjustable focus AR glasses sound like a game-changer! Can't wait to see how affordable they really are.

首頁

首頁