Фотографии ареста Трампа, созданные ИИ: правда или фейк?

В современном быстро развивающемся цифровом ландшафте искусственный интеллект (AI) раздвигает границы, делая все более сложным различение между реальным и вымышленным. Недавно интернет был наводнен созданными AI изображениями, показывающими арест бывшего президента Дональда Трампа, что вызвало путаницу и жаркие споры. Эти невероятно реалистичные изображения, созданные с помощью инструментов, таких как Midjourney v5, обманули многих, демонстрируя возрастающую сложность и потенциальные риски контента, созданного AI. Эта статья исследует мир созданных AI изображений, трудности их идентификации и более широкие последствия для новостей и информации.

Ключевые моменты

- Созданные AI изображения ареста Дональда Трампа стали вирусными, сея путаницу.

- Инструменты AI, такие как Midjourney v5, способны создавать гиперреалистичные изображения.

- Становится все труднее отличить созданные AI изображения от настоящих фотографий.

- Распространение созданных AI фейковых новостей угрожает общественному доверию и информированному принятию решений.

- Медийная грамотность и критическое мышление жизненно важны в эпоху созданного AI контента.

- Понимание инструментов и техник создания AI изображений может помочь в выявлении подделок.

Рост фейковых новостей, созданных AI

Сила и опасность генерации изображений AI

Технология AI развивается с невероятной скоростью, открывая эру, в которой инструменты, такие как Midjourney, DALL-E 2 и Stable Diffusion, могут создавать фотореалистичные изображения из простых текстовых подсказок. Эта способность — обоюдоострый меч: она открывает мир творческих возможностей, но также способствует созданию и распространению фейковых новостей, созданных AI.

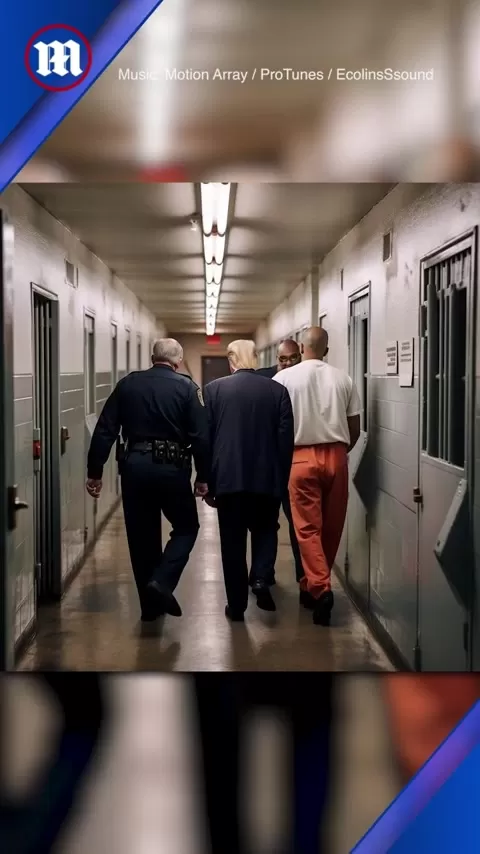

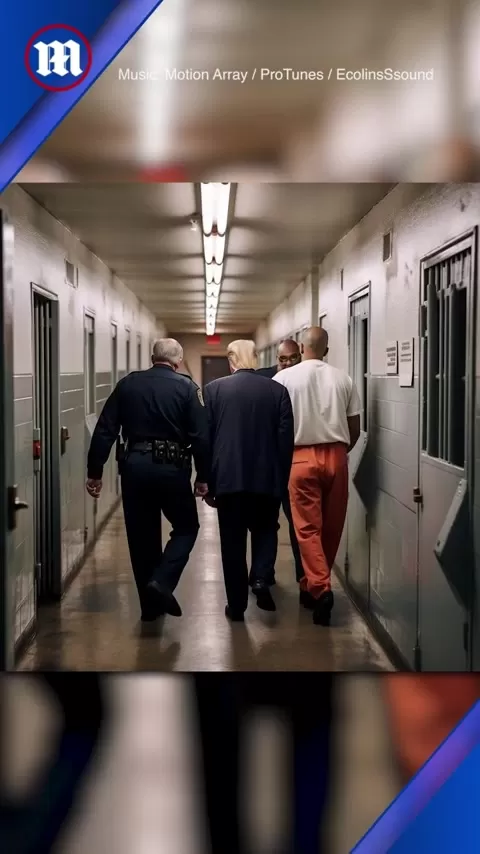

Изображения предполагаемого ареста Дональда Трампа, изображающие его задержание, борьбу и даже в тюрьме, распространились как лесной пожар по социальным сетям. Эти визуальные материалы обманули многих, заставив думать, что это настоящие новостные фотографии, подчеркивая потенциал AI манипулировать общественным мнением, распространять дезинформацию и подрывать доверие к традиционным СМИ.

Midjourney v5, модель AI, стоящая за многими из этих изображений, особенно хороша в создании гиперреалистичного контента. Она может настолько убедительно воспроизводить человеческие черты и окружающую среду, что подделки трудно обнаружить. Этот уровень сложности заставляет проверяющих факты и потребителей медиа быть более бдительными и критичными.

Быстрое распространение фейковых новостей, созданных AI, вызывает тревогу. Алгоритмы социальных сетей, разработанные для повышения вовлеченности, могут непреднамеренно усиливать дезинформацию. Как только созданное AI изображение или видео становится вирусным, его трудно остановить, даже после разоблачения. Это подчеркивает насущную необходимость для платформ социальных сетей разрабатывать стратегии для идентификации и маркировки созданного AI контента.

Как распознать созданные AI изображения: советы и техники

Несмотря на их сложность, созданные AI изображения все еще имеют характерные признаки. Вот несколько советов, которые помогут вам их идентифицировать:

- Изучите детали: AI часто испытывает трудности с мелкими деталями, такими как руки, пальцы и зубы. Ищите любые несоответствия или искажения.

- Анализируйте освещение и тени: Созданные AI изображения могут показывать неестественное или непоследовательное освещение и тени. Проверьте, как свет взаимодействует с объектами и поверхностями.

- Проверяйте несоответствия фона: AI может ошибаться в создании связных фонов. Ищите аномалии или искажения в фоновых элементах.

- Обратный поиск изображений: Используйте инструменты, такие как Google Images или TinEye, чтобы проверить, не было ли изображение идентифицировано как созданное AI или найдено на сайтах, известных своим AI-контентом.

- Консультируйтесь с организациями по проверке фактов: Организации, такие как Snopes и PolitiFact, находятся на передовой в разоблачении фейковых новостей, созданных AI. Проверьте их сайты для информации об интересующем изображении.

- Учитывайте источник: Будьте осторожны с изображениями из неизвестных или ненадежных источников. Проверьте надежность источника, прежде чем делиться или верить изображению.

Эксперты по медийной грамотности подчеркивают важность развития навыков критического мышления для навигации в эпоху созданного AI контента. Они советуют сомневаться в подлинности изображений, проверять информацию из нескольких источников и быть в курсе возможных манипуляций. Понимание инструментов и техник, используемых для создания AI изображений, может помочь в их выявлении. Например, знание того, что AI часто испытывает трудности с руками, может побудить внимательнее рассмотреть эти детали при оценке подлинности изображения.

Кейс-стади: Изображения ареста Дональда Трампа

Ближе к созданному AI контенту

Созданные AI изображения ареста Дональда Трампа представляют увлекательное исследование проблем идентификации фейковых новостей. Созданные с использованием Midjourney v5, эти изображения показывали Трампа в различных сценариях:

- Задержание полицейскими

- Бегство от правоохранительных органов

- Сбивание на землю

- В оранжевом комбинезоне в тюрьме

Эти изображения были настолько реалистичными, что обманули многих пользователей социальных сетей, заставив поверить, что это настоящие новостные фотографии. Они вызвали широкие дебаты, с реакциями от возмущения до празднования того, что некоторые считали реальным событием.

При более внимательном рассмотрении, однако, тонкие признаки указывали на их AI-происхождение, такие как:

- Непоследовательное освещение и тени

- Искаженные руки и пальцы

- Неестественные выражения лица

- Аномалии в фоновых элементах

Влияние этих изображений было значительным, с миллионами просмотров и жаркими дебатами в интернете. Они вызвали обеспокоенность по поводу потенциала AI манипулировать общественным мнением и распространять дезинформацию. Хотя СМИ и проверяющие факты быстро разоблачили изображения, первоначальный ущерб был нанесен, поскольку многие уже сформировали мнение на основе фальшивых визуальных материалов, подчеркивая трудности противодействия фейковым новостям, созданным AI.

Анализ экспертов: Идентификация созданных AI изображений

Эксперты по медийной грамотности и AI предложили свои взгляды на идентификацию созданных AI изображений, таких как изображения ареста Дональда Трампа:

- Контекст имеет решающее значение: Учитывайте контекст, в котором распространяется изображение. Является ли оно из надежного новостного источника? Является ли сопровождающий текст точным и беспристрастным?

- Будьте скептичны: Подходите ко всем изображениям скептически. Не предполагайте, что изображение реально только потому, что оно выглядит убедительно.

- Проверяйте, проверяйте, проверяйте: Всегда проверяйте подлинность изображения, прежде чем делиться или верить ему. Используйте инструменты обратного поиска изображений, консультируйтесь с организациями по проверке фактов и проверяйте у надежных новостных источников.

- Понимайте ограничения AI: Будьте в курсе ограничений AI в генерации изображений. AI часто испытывает трудности с мелкими деталями, поэтому ищите несоответствия в этих областях.

Платформы социальных сетей играют критически важную роль в борьбе с распространением фейковых новостей, созданных AI. Они могут:

- Разрабатывать алгоритмы для идентификации и маркировки созданного AI контента.

- Сотрудничать с организациями по проверке фактов для разоблачения дезинформации.

- Предоставлять пользователям инструменты для сообщения о фейковых новостях, созданных AI.

- Обучать пользователей медийной грамотности и критическому мышлению.

По мере развития технологий AI различение созданных AI изображений и видео от реального контента будет становиться все более сложным. Это требует развития навыков медийной грамотности, критического мышления и здоровой дозы скептицизма для навигации в этом развивающемся ландшафте.

Как защитить себя от фейковых новостей, созданных AI

Практические шаги для потребителей медиа

В эпоху, когда созданный AI контент может быть невероятно убедительным, принятие проактивных шагов для защиты от фейковых новостей является необходимым. Вот руководство, которое поможет вам ориентироваться в цифровом ландшафте с большей осведомленностью:

- Развивайте навыки критического мышления:

- Сомневайтесь во всем:

Вырабатывайте привычку сомневаться в информации, с которой вы сталкиваетесь в интернете, особенно в социальных сетях. Не принимайте информацию за чистую монету, независимо от того, насколько правдоподобной она кажется изначально.

Вырабатывайте привычку сомневаться в информации, с которой вы сталкиваетесь в интернете, особенно в социальных сетях. Не принимайте информацию за чистую монету, независимо от того, насколько правдоподобной она кажется изначально.

- Ищите разные точки зрения: Всегда ищите разнообразные точки зрения по любому вопросу. Полагаться на один источник может привести к предвзятому пониманию событий.

- Проверяйте информацию из надежных источников:

- Проверяйте сайты по проверке фактов: Регулярно консультируйтесь с организациями по проверке фактов, такими как Snopes, PolitiFact и FactCheck.org, чтобы проверить точность новостных историй и вирусного контента.

- Сравнивайте новости: Сравнивайте новостные репортажи из разных известных медиа-источников. Расхождения могут быть тревожным сигналом, указывающим на потенциальную дезинформацию.

- Овладейте техниками обратного поиска изображений:

- Используйте инструменты, такие как Google Images и TinEye: Если вы сталкиваетесь с подозрительным изображением, используйте обратный поиск изображений, чтобы проследить его происхождение и узнать, не было ли оно ранее отмечено как созданное AI или манипулированное.

- Анализируйте контекст изображения: Изучите веб-сайты и аккаунты в социальных сетях, где появляется изображение. Ищите любые признаки изменений или фальсификации.

- Тщательно проверяйте аккаунты в социальных сетях и веб-сайты:

- Оценивайте надежность источника: Прежде чем делиться информацией из любого источника, изучите его историю, миссию и репутацию в плане точности.

- Остерегайтесь предвзятости: Признавайте, что некоторые источники могут иметь политические или идеологические предубеждения. Учитывайте эти предубеждения при оценке представленной ими информации.

- Распознавайте признаки генерации AI:

- Проверяйте мелкие детали: Уделяйте пристальное внимание рукам, лицам и другим сложным деталям. Созданные AI изображения часто содержат аномалии, такие как странной формы пальцы или неестественные текстуры.

- Оценивайте освещение и тени: Анализируйте освещение и тени на изображении. Несоответствия или неестественные узоры могут указывать на манипуляции AI.

- Продвигайте медийную грамотность в вашем сообществе:

- Делитесь знаниями с другими: Обучайте своих друзей, семью и коллег медийной грамотности и навыкам критического мышления.

- Поощряйте активное участие: Продвигайте активное взаимодействие с новостями и информацией. Призывайте других сомневаться, проверять и анализировать, прежде чем верить или делиться контентом.

Созданный AI контент: взвешивание преимуществ и рисков

Плюсы

- Творческий потенциал: Инструменты AI открывают новые пути для художественного самовыражения и дизайна, позволяя пользователям создавать уникальные визуальные материалы.

- Эффективность в создании контента: AI может значительно ускорить процесс создания изображений и видео, что полезно для маркетинга, образования и развлечений.

- Доступность для непрофессионалов: Пользователи без продвинутых навыков могут создавать визуальный контент профессионального качества.

- Автоматизация повторяющихся задач: AI может автоматизировать утомительные задачи, такие как создание макетов продуктов или визуальных материалов для социальных сетей.

Минусы

- Дезинформация и фейковые новости: Легкость создания фальшивых изображений представляет серьезную угрозу общественному доверию и точной информации.

- Этические вопросы: Созданный AI контент вызывает вопросы об аутентичности, авторстве и согласии.

- Сокращение рабочих мест: Автоматизация AI может привести к потере рабочих мест в творческих индустриях.

- Предвзятость и репрезентация: Модели AI могут увековечивать существующие предубеждения, если не обучены на разнообразных наборах данных.

- Манипуляция и обман: Созданные AI визуальные материалы могут использоваться для манипуляции общественным мнением и обмана людей.

Часто задаваемые вопросы

Что такое созданные AI изображения?

Созданные AI изображения — это визуальные материалы, созданные алгоритмами искусственного интеллекта, часто с использованием инструментов, таких как Midjourney, DALL-E 2 или Stable Diffusion. Эти алгоритмы могут создавать высоко реалистичные или стилизованные изображения из текстовых подсказок или других входных данных.

Как определить, является ли изображение созданным AI?

Ищите несоответствия в деталях, таких как руки, освещение и фон. Используйте инструменты обратного поиска изображений, чтобы проверить происхождение изображения, и консультируйтесь с веб-сайтами по проверке фактов для подтверждения.

Что такое Midjourney v5, и что делает его таким мощным?

Midjourney v5 — это продвинутая модель AI, которая превосходно создает фотореалистичные изображения. Ее сложность затрудняет различение созданных AI изображений от настоящих фотографий, требуя тщательной проверки.

Какие этические вопросы связаны с созданным AI контентом?

Этические вопросы включают потенциал распространения дезинформации, вопросы об авторстве и согласии, а также риск сокращения рабочих мест в творческих индустриях.

Как платформы социальных сетей способствуют распространению фейковых новостей, созданных AI?

Алгоритмы социальных сетей, разработанные для усиления вовлеченности, могут непреднамеренно способствовать распространению дезинформации. Платформам необходимо разрабатывать эффективные стратегии для идентификации и маркировки созданного AI контента.

Что я могу сделать, чтобы защитить себя от фейковых новостей, созданных AI?

Развивайте навыки критического мышления, проверяйте информацию из надежных источников, используйте техники обратного поиска изображений и будьте скептичны к контенту из неизвестных источников.

Связанные вопросы

Какие еще инструменты AI используются для генерации изображений?

Помимо Midjourney, популярные инструменты генерации изображений AI включают DALL-E 2, Stable Diffusion и различные функции Adobe Creative Cloud. Каждый инструмент имеет уникальные возможности и сильные стороны, но все они обладают потенциалом для создания убедительного визуального контента. DALL-E 2 известен своей способностью создавать очень воображаемые и сюрреалистические изображения из текстовых подсказок. Stable Diffusion предлагает баланс качества и доступности, что делает его фаворитом среди художников и любителей. Adobe Creative Cloud интегрирует функции, основанные на AI, такие как заполнение с учетом содержимого и перенос стиля для улучшения редактирования фотографий и графического дизайна.

Как используются созданные AI изображения в маркетинге и рекламе?

Созданные AI изображения все чаще используются в маркетинге и рекламе для создания макетов продуктов, генерации визуальных материалов для социальных сетей и производства персонализированного рекламного контента. Инструменты AI могут быстро создавать высококачественные визуальные материалы, адаптированные для конкретных кампаний, экономя время и ресурсы. Однако необходимо учитывать этические аспекты, чтобы обеспечить прозрачность и избежать введения потребителей в заблуждение.

Какие юридические последствия использования созданных AI изображений?

Юридические последствия использования созданных AI изображений все еще развиваются. Проблемы авторского права, права собственности и ответственность за дезинформацию являются ключевыми областями внимания. Важно понимать условия обслуживания инструментов AI и обращаться за юридической консультацией, чтобы обеспечить соответствие законам и правилам об авторском праве.

- Юридические соображения:

- Право собственности на авторские права: Кому принадлежат авторские права на созданное AI изображение — пользователю, разработчику AI или обоим?

- Условия обслуживания: Понимание условий обслуживания инструментов AI имеет решающее значение для определения прав и ограничений использования.

- Ответственность за дезинформацию: Кто несет ответственность, если созданное AI изображение используется для распространения ложной или вводящей в заблуждение информации?

- Конфиденциальность данных: Как используются пользовательские данные для обучения и улучшения моделей AI, и какие меры защиты конфиденциальности применяются?

Связанная статья

Компания Apple удалила приложение Cal AI из-за несанкционированных покупок внутри приложения и манипулятивных способов осуществления платежей.

Недавнее удаление Apple приложения Cal AI, популярного приложения для отслеживания потребления пищи на основе искусственного интеллекта в рамках сервиса MyFitnessPal, подчеркивает строгое соблюдение Apple политик App Store в отношении внешних платеже

Компания Apple удалила приложение Cal AI из-за несанкционированных покупок внутри приложения и манипулятивных способов осуществления платежей.

Недавнее удаление Apple приложения Cal AI, популярного приложения для отслеживания потребления пищи на основе искусственного интеллекта в рамках сервиса MyFitnessPal, подчеркивает строгое соблюдение Apple политик App Store в отношении внешних платеже

Тарификация Github Copilot на основе токенов вызывает возмущение среди разработчиков

Золотой век сервиса GitHub Copilot от Microsoft, по-видимому, подходит к концу, особенно для частных пользователей. Компания переходит от фиксированной абонентской платы к модели оплаты на основе токенов, что может значительно увеличить затраты. Боль

Тарификация Github Copilot на основе токенов вызывает возмущение среди разработчиков

Золотой век сервиса GitHub Copilot от Microsoft, по-видимому, подходит к концу, особенно для частных пользователей. Компания переходит от фиксированной абонентской платы к модели оплаты на основе токенов, что может значительно увеличить затраты. Боль

Основные моменты документа SpaceX о публичном размещении акций: амбиции по расширению услуг спутникового Интернета и использованию искусственного интеллекта

В своем заявлении о регистрации типа S-1, представленном перед планируемым IPO, компания SpaceX представила ряд впечатляющих финансовых показателей, подчеркивающих ее прочные позиции в области аэрокосмической связи и искусственного интеллекта:Число

Рекомендации по связанным специальным темам

Комментарии (2)

Основные моменты документа SpaceX о публичном размещении акций: амбиции по расширению услуг спутникового Интернета и использованию искусственного интеллекта

В своем заявлении о регистрации типа S-1, представленном перед планируемым IPO, компания SpaceX представила ряд впечатляющих финансовых показателей, подчеркивающих ее прочные позиции в области аэрокосмической связи и искусственного интеллекта:Число

Рекомендации по связанным специальным темам

Комментарии (2)

![CarlLewis]()

Those AI-generated Trump arrest photos are wild! 😳 It’s scary how real they look—makes you wonder what else we’re seeing online that’s fake. Gotta double-check everything now!

В современном быстро развивающемся цифровом ландшафте искусственный интеллект (AI) раздвигает границы, делая все более сложным различение между реальным и вымышленным. Недавно интернет был наводнен созданными AI изображениями, показывающими арест бывшего президента Дональда Трампа, что вызвало путаницу и жаркие споры. Эти невероятно реалистичные изображения, созданные с помощью инструментов, таких как Midjourney v5, обманули многих, демонстрируя возрастающую сложность и потенциальные риски контента, созданного AI. Эта статья исследует мир созданных AI изображений, трудности их идентификации и более широкие последствия для новостей и информации.

Ключевые моменты

- Созданные AI изображения ареста Дональда Трампа стали вирусными, сея путаницу.

- Инструменты AI, такие как Midjourney v5, способны создавать гиперреалистичные изображения.

- Становится все труднее отличить созданные AI изображения от настоящих фотографий.

- Распространение созданных AI фейковых новостей угрожает общественному доверию и информированному принятию решений.

- Медийная грамотность и критическое мышление жизненно важны в эпоху созданного AI контента.

- Понимание инструментов и техник создания AI изображений может помочь в выявлении подделок.

Рост фейковых новостей, созданных AI

Сила и опасность генерации изображений AI

Технология AI развивается с невероятной скоростью, открывая эру, в которой инструменты, такие как Midjourney, DALL-E 2 и Stable Diffusion, могут создавать фотореалистичные изображения из простых текстовых подсказок. Эта способность — обоюдоострый меч: она открывает мир творческих возможностей, но также способствует созданию и распространению фейковых новостей, созданных AI.

Изображения предполагаемого ареста Дональда Трампа, изображающие его задержание, борьбу и даже в тюрьме, распространились как лесной пожар по социальным сетям. Эти визуальные материалы обманули многих, заставив думать, что это настоящие новостные фотографии, подчеркивая потенциал AI манипулировать общественным мнением, распространять дезинформацию и подрывать доверие к традиционным СМИ.

Midjourney v5, модель AI, стоящая за многими из этих изображений, особенно хороша в создании гиперреалистичного контента. Она может настолько убедительно воспроизводить человеческие черты и окружающую среду, что подделки трудно обнаружить. Этот уровень сложности заставляет проверяющих факты и потребителей медиа быть более бдительными и критичными.

Быстрое распространение фейковых новостей, созданных AI, вызывает тревогу. Алгоритмы социальных сетей, разработанные для повышения вовлеченности, могут непреднамеренно усиливать дезинформацию. Как только созданное AI изображение или видео становится вирусным, его трудно остановить, даже после разоблачения. Это подчеркивает насущную необходимость для платформ социальных сетей разрабатывать стратегии для идентификации и маркировки созданного AI контента.

Как распознать созданные AI изображения: советы и техники

Несмотря на их сложность, созданные AI изображения все еще имеют характерные признаки. Вот несколько советов, которые помогут вам их идентифицировать:

- Изучите детали: AI часто испытывает трудности с мелкими деталями, такими как руки, пальцы и зубы. Ищите любые несоответствия или искажения.

- Анализируйте освещение и тени: Созданные AI изображения могут показывать неестественное или непоследовательное освещение и тени. Проверьте, как свет взаимодействует с объектами и поверхностями.

- Проверяйте несоответствия фона: AI может ошибаться в создании связных фонов. Ищите аномалии или искажения в фоновых элементах.

- Обратный поиск изображений: Используйте инструменты, такие как Google Images или TinEye, чтобы проверить, не было ли изображение идентифицировано как созданное AI или найдено на сайтах, известных своим AI-контентом.

- Консультируйтесь с организациями по проверке фактов: Организации, такие как Snopes и PolitiFact, находятся на передовой в разоблачении фейковых новостей, созданных AI. Проверьте их сайты для информации об интересующем изображении.

- Учитывайте источник: Будьте осторожны с изображениями из неизвестных или ненадежных источников. Проверьте надежность источника, прежде чем делиться или верить изображению.

Эксперты по медийной грамотности подчеркивают важность развития навыков критического мышления для навигации в эпоху созданного AI контента. Они советуют сомневаться в подлинности изображений, проверять информацию из нескольких источников и быть в курсе возможных манипуляций. Понимание инструментов и техник, используемых для создания AI изображений, может помочь в их выявлении. Например, знание того, что AI часто испытывает трудности с руками, может побудить внимательнее рассмотреть эти детали при оценке подлинности изображения.

Кейс-стади: Изображения ареста Дональда Трампа

Ближе к созданному AI контенту

Созданные AI изображения ареста Дональда Трампа представляют увлекательное исследование проблем идентификации фейковых новостей. Созданные с использованием Midjourney v5, эти изображения показывали Трампа в различных сценариях:

- Задержание полицейскими

- Бегство от правоохранительных органов

- Сбивание на землю

- В оранжевом комбинезоне в тюрьме

Эти изображения были настолько реалистичными, что обманули многих пользователей социальных сетей, заставив поверить, что это настоящие новостные фотографии. Они вызвали широкие дебаты, с реакциями от возмущения до празднования того, что некоторые считали реальным событием.

При более внимательном рассмотрении, однако, тонкие признаки указывали на их AI-происхождение, такие как:

- Непоследовательное освещение и тени

- Искаженные руки и пальцы

- Неестественные выражения лица

- Аномалии в фоновых элементах

Влияние этих изображений было значительным, с миллионами просмотров и жаркими дебатами в интернете. Они вызвали обеспокоенность по поводу потенциала AI манипулировать общественным мнением и распространять дезинформацию. Хотя СМИ и проверяющие факты быстро разоблачили изображения, первоначальный ущерб был нанесен, поскольку многие уже сформировали мнение на основе фальшивых визуальных материалов, подчеркивая трудности противодействия фейковым новостям, созданным AI.

Анализ экспертов: Идентификация созданных AI изображений

Эксперты по медийной грамотности и AI предложили свои взгляды на идентификацию созданных AI изображений, таких как изображения ареста Дональда Трампа:

- Контекст имеет решающее значение: Учитывайте контекст, в котором распространяется изображение. Является ли оно из надежного новостного источника? Является ли сопровождающий текст точным и беспристрастным?

- Будьте скептичны: Подходите ко всем изображениям скептически. Не предполагайте, что изображение реально только потому, что оно выглядит убедительно.

- Проверяйте, проверяйте, проверяйте: Всегда проверяйте подлинность изображения, прежде чем делиться или верить ему. Используйте инструменты обратного поиска изображений, консультируйтесь с организациями по проверке фактов и проверяйте у надежных новостных источников.

- Понимайте ограничения AI: Будьте в курсе ограничений AI в генерации изображений. AI часто испытывает трудности с мелкими деталями, поэтому ищите несоответствия в этих областях.

Платформы социальных сетей играют критически важную роль в борьбе с распространением фейковых новостей, созданных AI. Они могут:

- Разрабатывать алгоритмы для идентификации и маркировки созданного AI контента.

- Сотрудничать с организациями по проверке фактов для разоблачения дезинформации.

- Предоставлять пользователям инструменты для сообщения о фейковых новостях, созданных AI.

- Обучать пользователей медийной грамотности и критическому мышлению.

По мере развития технологий AI различение созданных AI изображений и видео от реального контента будет становиться все более сложным. Это требует развития навыков медийной грамотности, критического мышления и здоровой дозы скептицизма для навигации в этом развивающемся ландшафте.

Как защитить себя от фейковых новостей, созданных AI

Практические шаги для потребителей медиа

В эпоху, когда созданный AI контент может быть невероятно убедительным, принятие проактивных шагов для защиты от фейковых новостей является необходимым. Вот руководство, которое поможет вам ориентироваться в цифровом ландшафте с большей осведомленностью:

- Развивайте навыки критического мышления:

- Сомневайтесь во всем:

Вырабатывайте привычку сомневаться в информации, с которой вы сталкиваетесь в интернете, особенно в социальных сетях. Не принимайте информацию за чистую монету, независимо от того, насколько правдоподобной она кажется изначально.

Вырабатывайте привычку сомневаться в информации, с которой вы сталкиваетесь в интернете, особенно в социальных сетях. Не принимайте информацию за чистую монету, независимо от того, насколько правдоподобной она кажется изначально. - Ищите разные точки зрения: Всегда ищите разнообразные точки зрения по любому вопросу. Полагаться на один источник может привести к предвзятому пониманию событий.

- Сомневайтесь во всем:

- Проверяйте информацию из надежных источников:

- Проверяйте сайты по проверке фактов: Регулярно консультируйтесь с организациями по проверке фактов, такими как Snopes, PolitiFact и FactCheck.org, чтобы проверить точность новостных историй и вирусного контента.

- Сравнивайте новости: Сравнивайте новостные репортажи из разных известных медиа-источников. Расхождения могут быть тревожным сигналом, указывающим на потенциальную дезинформацию.

- Овладейте техниками обратного поиска изображений:

- Используйте инструменты, такие как Google Images и TinEye: Если вы сталкиваетесь с подозрительным изображением, используйте обратный поиск изображений, чтобы проследить его происхождение и узнать, не было ли оно ранее отмечено как созданное AI или манипулированное.

- Анализируйте контекст изображения: Изучите веб-сайты и аккаунты в социальных сетях, где появляется изображение. Ищите любые признаки изменений или фальсификации.

- Тщательно проверяйте аккаунты в социальных сетях и веб-сайты:

- Оценивайте надежность источника: Прежде чем делиться информацией из любого источника, изучите его историю, миссию и репутацию в плане точности.

- Остерегайтесь предвзятости: Признавайте, что некоторые источники могут иметь политические или идеологические предубеждения. Учитывайте эти предубеждения при оценке представленной ими информации.

- Распознавайте признаки генерации AI:

- Проверяйте мелкие детали: Уделяйте пристальное внимание рукам, лицам и другим сложным деталям. Созданные AI изображения часто содержат аномалии, такие как странной формы пальцы или неестественные текстуры.

- Оценивайте освещение и тени: Анализируйте освещение и тени на изображении. Несоответствия или неестественные узоры могут указывать на манипуляции AI.

- Продвигайте медийную грамотность в вашем сообществе:

- Делитесь знаниями с другими: Обучайте своих друзей, семью и коллег медийной грамотности и навыкам критического мышления.

- Поощряйте активное участие: Продвигайте активное взаимодействие с новостями и информацией. Призывайте других сомневаться, проверять и анализировать, прежде чем верить или делиться контентом.

Созданный AI контент: взвешивание преимуществ и рисков

Плюсы

- Творческий потенциал: Инструменты AI открывают новые пути для художественного самовыражения и дизайна, позволяя пользователям создавать уникальные визуальные материалы.

- Эффективность в создании контента: AI может значительно ускорить процесс создания изображений и видео, что полезно для маркетинга, образования и развлечений.

- Доступность для непрофессионалов: Пользователи без продвинутых навыков могут создавать визуальный контент профессионального качества.

- Автоматизация повторяющихся задач: AI может автоматизировать утомительные задачи, такие как создание макетов продуктов или визуальных материалов для социальных сетей.

Минусы

- Дезинформация и фейковые новости: Легкость создания фальшивых изображений представляет серьезную угрозу общественному доверию и точной информации.

- Этические вопросы: Созданный AI контент вызывает вопросы об аутентичности, авторстве и согласии.

- Сокращение рабочих мест: Автоматизация AI может привести к потере рабочих мест в творческих индустриях.

- Предвзятость и репрезентация: Модели AI могут увековечивать существующие предубеждения, если не обучены на разнообразных наборах данных.

- Манипуляция и обман: Созданные AI визуальные материалы могут использоваться для манипуляции общественным мнением и обмана людей.

Часто задаваемые вопросы

Что такое созданные AI изображения?

Созданные AI изображения — это визуальные материалы, созданные алгоритмами искусственного интеллекта, часто с использованием инструментов, таких как Midjourney, DALL-E 2 или Stable Diffusion. Эти алгоритмы могут создавать высоко реалистичные или стилизованные изображения из текстовых подсказок или других входных данных.

Как определить, является ли изображение созданным AI?

Ищите несоответствия в деталях, таких как руки, освещение и фон. Используйте инструменты обратного поиска изображений, чтобы проверить происхождение изображения, и консультируйтесь с веб-сайтами по проверке фактов для подтверждения.

Что такое Midjourney v5, и что делает его таким мощным?

Midjourney v5 — это продвинутая модель AI, которая превосходно создает фотореалистичные изображения. Ее сложность затрудняет различение созданных AI изображений от настоящих фотографий, требуя тщательной проверки.

Какие этические вопросы связаны с созданным AI контентом?

Этические вопросы включают потенциал распространения дезинформации, вопросы об авторстве и согласии, а также риск сокращения рабочих мест в творческих индустриях.

Как платформы социальных сетей способствуют распространению фейковых новостей, созданных AI?

Алгоритмы социальных сетей, разработанные для усиления вовлеченности, могут непреднамеренно способствовать распространению дезинформации. Платформам необходимо разрабатывать эффективные стратегии для идентификации и маркировки созданного AI контента.

Что я могу сделать, чтобы защитить себя от фейковых новостей, созданных AI?

Развивайте навыки критического мышления, проверяйте информацию из надежных источников, используйте техники обратного поиска изображений и будьте скептичны к контенту из неизвестных источников.

Связанные вопросы

Какие еще инструменты AI используются для генерации изображений?

Помимо Midjourney, популярные инструменты генерации изображений AI включают DALL-E 2, Stable Diffusion и различные функции Adobe Creative Cloud. Каждый инструмент имеет уникальные возможности и сильные стороны, но все они обладают потенциалом для создания убедительного визуального контента. DALL-E 2 известен своей способностью создавать очень воображаемые и сюрреалистические изображения из текстовых подсказок. Stable Diffusion предлагает баланс качества и доступности, что делает его фаворитом среди художников и любителей. Adobe Creative Cloud интегрирует функции, основанные на AI, такие как заполнение с учетом содержимого и перенос стиля для улучшения редактирования фотографий и графического дизайна.

Как используются созданные AI изображения в маркетинге и рекламе?

Созданные AI изображения все чаще используются в маркетинге и рекламе для создания макетов продуктов, генерации визуальных материалов для социальных сетей и производства персонализированного рекламного контента. Инструменты AI могут быстро создавать высококачественные визуальные материалы, адаптированные для конкретных кампаний, экономя время и ресурсы. Однако необходимо учитывать этические аспекты, чтобы обеспечить прозрачность и избежать введения потребителей в заблуждение.

Какие юридические последствия использования созданных AI изображений?

Юридические последствия использования созданных AI изображений все еще развиваются. Проблемы авторского права, права собственности и ответственность за дезинформацию являются ключевыми областями внимания. Важно понимать условия обслуживания инструментов AI и обращаться за юридической консультацией, чтобы обеспечить соответствие законам и правилам об авторском праве.

- Юридические соображения:

- Право собственности на авторские права: Кому принадлежат авторские права на созданное AI изображение — пользователю, разработчику AI или обоим?

- Условия обслуживания: Понимание условий обслуживания инструментов AI имеет решающее значение для определения прав и ограничений использования.

- Ответственность за дезинформацию: Кто несет ответственность, если созданное AI изображение используется для распространения ложной или вводящей в заблуждение информации?

- Конфиденциальность данных: Как используются пользовательские данные для обучения и улучшения моделей AI, и какие меры защиты конфиденциальности применяются?

Компания Apple удалила приложение Cal AI из-за несанкционированных покупок внутри приложения и манипулятивных способов осуществления платежей.

Недавнее удаление Apple приложения Cal AI, популярного приложения для отслеживания потребления пищи на основе искусственного интеллекта в рамках сервиса MyFitnessPal, подчеркивает строгое соблюдение Apple политик App Store в отношении внешних платеже

Компания Apple удалила приложение Cal AI из-за несанкционированных покупок внутри приложения и манипулятивных способов осуществления платежей.

Недавнее удаление Apple приложения Cal AI, популярного приложения для отслеживания потребления пищи на основе искусственного интеллекта в рамках сервиса MyFitnessPal, подчеркивает строгое соблюдение Apple политик App Store в отношении внешних платеже

Тарификация Github Copilot на основе токенов вызывает возмущение среди разработчиков

Золотой век сервиса GitHub Copilot от Microsoft, по-видимому, подходит к концу, особенно для частных пользователей. Компания переходит от фиксированной абонентской платы к модели оплаты на основе токенов, что может значительно увеличить затраты. Боль

Тарификация Github Copilot на основе токенов вызывает возмущение среди разработчиков

Золотой век сервиса GitHub Copilot от Microsoft, по-видимому, подходит к концу, особенно для частных пользователей. Компания переходит от фиксированной абонентской платы к модели оплаты на основе токенов, что может значительно увеличить затраты. Боль

Основные моменты документа SpaceX о публичном размещении акций: амбиции по расширению услуг спутникового Интернета и использованию искусственного интеллекта

В своем заявлении о регистрации типа S-1, представленном перед планируемым IPO, компания SpaceX представила ряд впечатляющих финансовых показателей, подчеркивающих ее прочные позиции в области аэрокосмической связи и искусственного интеллекта:Число

Основные моменты документа SpaceX о публичном размещении акций: амбиции по расширению услуг спутникового Интернета и использованию искусственного интеллекта

В своем заявлении о регистрации типа S-1, представленном перед планируемым IPO, компания SpaceX представила ряд впечатляющих финансовых показателей, подчеркивающих ее прочные позиции в области аэрокосмической связи и искусственного интеллекта:Число

Those AI-generated Trump arrest photos are wild! 😳 It’s scary how real they look—makes you wonder what else we’re seeing online that’s fake. Gotta double-check everything now!

Дом

Дом