Debates sobre o benchmarking da IA chegaram a Pokémon

Mesmo o amado mundo de Pokémon não está imune ao drama envolvendo benchmarks de IA. Um post viral recente no X causou bastante alvoroço, alegando que o mais recente modelo Gemini do Google superou o modelo Claude líder da Anthropic na trilogia clássica de videogame Pokémon. Segundo o post, o Gemini chegou impressionantemente a Lavender Town em uma transmissão na Twitch de um desenvolvedor, enquanto o Claude estava atrasado em Mount Moon até o final de fevereiro.

O Gemini está literalmente à frente do Claude no momento em Pokémon após chegar a Lavender Town

Apenas 119 visualizações ao vivo, por sinal, uma transmissão incrivelmente subestimada pic.twitter.com/8AvSovAI4x

— Jush (@Jush21e8) 10 de abril de 2025

No entanto, o que este post convenientemente omitiu foi o fato de que o Gemini tinha uma pequena vantagem injusta. Usuários atentos no Reddit rapidamente apontaram que o desenvolvedor por trás da transmissão do Gemini criou um minimapa personalizado. Essa ferramenta útil auxilia o modelo a reconhecer "tiles" no jogo, como árvores cortáveis, o que reduz significativamente o tempo que o Gemini precisa gastar analisando capturas de tela antes de decidir seu próximo movimento.

Agora, embora Pokémon possa não ser o benchmark de IA mais sério por aí, ele serve como um exemplo divertido, porém revelador, de como diferentes configurações podem distorcer os resultados desses testes. Tome como exemplo o recente modelo da Anthropic, Anthropic 3.7 Sonnet. No benchmark SWE-bench Verified, que testa habilidades de codificação, ele obteve 62,3% de precisão. Mas, com um "scaffold personalizado" que a Anthropic desenvolveu, essa pontuação subiu para 70,3%.

E não para por aí. A Meta pegou um de seus modelos mais novos, Llama 4 Maverick, e o ajustou especificamente para o benchmark LM Arena. A versão padrão do modelo não teve um desempenho tão bom no mesmo teste.

Dado que os benchmarks de IA, incluindo nosso amigável exemplo de Pokémon, já são um pouco incertos, esses ajustes personalizados e abordagens não padronizadas tornam ainda mais difícil fazer comparações significativas entre modelos à medida que chegam ao mercado. Parece que comparar maçãs com maçãs está ficando mais difícil a cada dia.

Artigo relacionado

A IA do Google agora atende a chamadas telefônicas para você

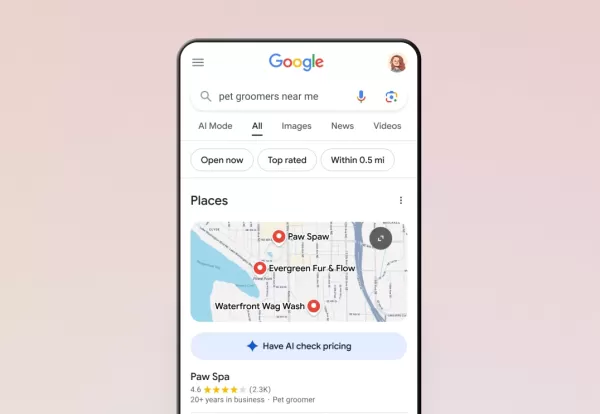

O Google expandiu seu recurso de chamadas com IA para todos os usuários dos EUA por meio da Pesquisa, permitindo que os clientes consultem preços e disponibilidade com empresas locais sem conversas te

A IA do Google agora atende a chamadas telefônicas para você

O Google expandiu seu recurso de chamadas com IA para todos os usuários dos EUA por meio da Pesquisa, permitindo que os clientes consultem preços e disponibilidade com empresas locais sem conversas te

"O aplicativo Dot AI Companion anuncia o encerramento e descontinua o serviço personalizado"

Dot, um aplicativo de acompanhamento de IA projetado para funcionar como amigo pessoal e confidente, encerrará suas operações, de acordo com um anúncio feito na sexta-feira por seus desenvolvedores. A

"O aplicativo Dot AI Companion anuncia o encerramento e descontinua o serviço personalizado"

Dot, um aplicativo de acompanhamento de IA projetado para funcionar como amigo pessoal e confidente, encerrará suas operações, de acordo com um anúncio feito na sexta-feira por seus desenvolvedores. A

Anthropic resolve caso legal sobre pirataria de livros gerados por IA

A Anthropic chegou a uma resolução em uma importante disputa de direitos autorais com autores norte-americanos, concordando com uma proposta de acordo de ação coletiva que evita um julgamento potencia

Comentários (6)

0/200

Anthropic resolve caso legal sobre pirataria de livros gerados por IA

A Anthropic chegou a uma resolução em uma importante disputa de direitos autorais com autores norte-americanos, concordando com uma proposta de acordo de ação coletiva que evita um julgamento potencia

Comentários (6)

0/200

![DouglasMartínez]() DouglasMartínez

DouglasMartínez

6 de Agosto de 2025 à0 18:01:00 WEST

6 de Agosto de 2025 à0 18:01:00 WEST

Whoa, AI playing Pokémon? That's wild! I wonder if Gemini's got a secret Pikachu strategy or just brute-forced its way through. Gotta catch 'em all, I guess! ⚡️

0

0

![JasonKing]() JasonKing

JasonKing

5 de Maio de 2025 à52 12:38:52 WEST

5 de Maio de 2025 à52 12:38:52 WEST

Debates over AI benchmarking in Pokémon? That's wild! I never thought I'd see the day when AI models are compared using Pokémon games. It's fun but kinda confusing. Can someone explain how Gemini outpaced Claude? 🤯

0

0

![NicholasAdams]() NicholasAdams

NicholasAdams

5 de Maio de 2025 à33 00:11:33 WEST

5 de Maio de 2025 à33 00:11:33 WEST

ポケモンでAIのベンチマークを議論するなんて、信じられない!AIモデルがポケモンのゲームで比較される日が来るなんて思わなかった。面白いけど、ちょっと混乱する。ジェミニがクロードをどうやって追い越したのか、誰か説明してくれない?🤯

0

0

![WalterThomas]() WalterThomas

WalterThomas

4 de Maio de 2025 à10 16:05:10 WEST

4 de Maio de 2025 à10 16:05:10 WEST

पोकेमॉन में AI बेंचमार्किंग पर बहस? यह तो पागलपन है! मुझे कभी नहीं लगा था कि मैं AI मॉडल्स को पोकेमॉन गेम्स का उपयोग करके तुलना करते हुए देखूंगा। यह मजेदार है लेकिन थोड़ा भ्रमित करने वाला है। कोई बता सकता है कि जेमिनी ने क्लॉड को कैसे पछाड़ा? 🤯

0

0

![AlbertThomas]() AlbertThomas

AlbertThomas

4 de Maio de 2025 à28 07:38:28 WEST

4 de Maio de 2025 à28 07:38:28 WEST

포켓몬에서 AI 벤치마킹 논쟁이라니, 이건 정말 놀랍네요! AI 모델이 포켓몬 게임으로 비교될 날이 올 줄은 몰랐어요. 재미있지만 조금 헷갈려요. 제미니가 클로드를 어떻게 앞질렀는지 설명해줄 수 있는 분? 🤯

0

0

![CharlesRoberts]() CharlesRoberts

CharlesRoberts

3 de Maio de 2025 à44 20:01:44 WEST

3 de Maio de 2025 à44 20:01:44 WEST

Debates sobre benchmarking de IA em Pokémon? Isso é loucura! Nunca pensei que veria o dia em que modelos de IA seriam comparados usando jogos de Pokémon. É divertido, mas um pouco confuso. Alguém pode explicar como o Gemini superou o Claude? 🤯

0

0

Mesmo o amado mundo de Pokémon não está imune ao drama envolvendo benchmarks de IA. Um post viral recente no X causou bastante alvoroço, alegando que o mais recente modelo Gemini do Google superou o modelo Claude líder da Anthropic na trilogia clássica de videogame Pokémon. Segundo o post, o Gemini chegou impressionantemente a Lavender Town em uma transmissão na Twitch de um desenvolvedor, enquanto o Claude estava atrasado em Mount Moon até o final de fevereiro.

O Gemini está literalmente à frente do Claude no momento em Pokémon após chegar a Lavender Town

Apenas 119 visualizações ao vivo, por sinal, uma transmissão incrivelmente subestimada pic.twitter.com/8AvSovAI4x

— Jush (@Jush21e8) 10 de abril de 2025

No entanto, o que este post convenientemente omitiu foi o fato de que o Gemini tinha uma pequena vantagem injusta. Usuários atentos no Reddit rapidamente apontaram que o desenvolvedor por trás da transmissão do Gemini criou um minimapa personalizado. Essa ferramenta útil auxilia o modelo a reconhecer "tiles" no jogo, como árvores cortáveis, o que reduz significativamente o tempo que o Gemini precisa gastar analisando capturas de tela antes de decidir seu próximo movimento.

Agora, embora Pokémon possa não ser o benchmark de IA mais sério por aí, ele serve como um exemplo divertido, porém revelador, de como diferentes configurações podem distorcer os resultados desses testes. Tome como exemplo o recente modelo da Anthropic, Anthropic 3.7 Sonnet. No benchmark SWE-bench Verified, que testa habilidades de codificação, ele obteve 62,3% de precisão. Mas, com um "scaffold personalizado" que a Anthropic desenvolveu, essa pontuação subiu para 70,3%.

E não para por aí. A Meta pegou um de seus modelos mais novos, Llama 4 Maverick, e o ajustou especificamente para o benchmark LM Arena. A versão padrão do modelo não teve um desempenho tão bom no mesmo teste.

Dado que os benchmarks de IA, incluindo nosso amigável exemplo de Pokémon, já são um pouco incertos, esses ajustes personalizados e abordagens não padronizadas tornam ainda mais difícil fazer comparações significativas entre modelos à medida que chegam ao mercado. Parece que comparar maçãs com maçãs está ficando mais difícil a cada dia.

A IA do Google agora atende a chamadas telefônicas para você

O Google expandiu seu recurso de chamadas com IA para todos os usuários dos EUA por meio da Pesquisa, permitindo que os clientes consultem preços e disponibilidade com empresas locais sem conversas te

A IA do Google agora atende a chamadas telefônicas para você

O Google expandiu seu recurso de chamadas com IA para todos os usuários dos EUA por meio da Pesquisa, permitindo que os clientes consultem preços e disponibilidade com empresas locais sem conversas te

Anthropic resolve caso legal sobre pirataria de livros gerados por IA

A Anthropic chegou a uma resolução em uma importante disputa de direitos autorais com autores norte-americanos, concordando com uma proposta de acordo de ação coletiva que evita um julgamento potencia

Anthropic resolve caso legal sobre pirataria de livros gerados por IA

A Anthropic chegou a uma resolução em uma importante disputa de direitos autorais com autores norte-americanos, concordando com uma proposta de acordo de ação coletiva que evita um julgamento potencia

6 de Agosto de 2025 à0 18:01:00 WEST

6 de Agosto de 2025 à0 18:01:00 WEST

Whoa, AI playing Pokémon? That's wild! I wonder if Gemini's got a secret Pikachu strategy or just brute-forced its way through. Gotta catch 'em all, I guess! ⚡️

0

0

5 de Maio de 2025 à52 12:38:52 WEST

5 de Maio de 2025 à52 12:38:52 WEST

Debates over AI benchmarking in Pokémon? That's wild! I never thought I'd see the day when AI models are compared using Pokémon games. It's fun but kinda confusing. Can someone explain how Gemini outpaced Claude? 🤯

0

0

5 de Maio de 2025 à33 00:11:33 WEST

5 de Maio de 2025 à33 00:11:33 WEST

ポケモンでAIのベンチマークを議論するなんて、信じられない!AIモデルがポケモンのゲームで比較される日が来るなんて思わなかった。面白いけど、ちょっと混乱する。ジェミニがクロードをどうやって追い越したのか、誰か説明してくれない?🤯

0

0

4 de Maio de 2025 à10 16:05:10 WEST

4 de Maio de 2025 à10 16:05:10 WEST

पोकेमॉन में AI बेंचमार्किंग पर बहस? यह तो पागलपन है! मुझे कभी नहीं लगा था कि मैं AI मॉडल्स को पोकेमॉन गेम्स का उपयोग करके तुलना करते हुए देखूंगा। यह मजेदार है लेकिन थोड़ा भ्रमित करने वाला है। कोई बता सकता है कि जेमिनी ने क्लॉड को कैसे पछाड़ा? 🤯

0

0

4 de Maio de 2025 à28 07:38:28 WEST

4 de Maio de 2025 à28 07:38:28 WEST

포켓몬에서 AI 벤치마킹 논쟁이라니, 이건 정말 놀랍네요! AI 모델이 포켓몬 게임으로 비교될 날이 올 줄은 몰랐어요. 재미있지만 조금 헷갈려요. 제미니가 클로드를 어떻게 앞질렀는지 설명해줄 수 있는 분? 🤯

0

0

3 de Maio de 2025 à44 20:01:44 WEST

3 de Maio de 2025 à44 20:01:44 WEST

Debates sobre benchmarking de IA em Pokémon? Isso é loucura! Nunca pensei que veria o dia em que modelos de IA seriam comparados usando jogos de Pokémon. É divertido, mas um pouco confuso. Alguém pode explicar como o Gemini superou o Claude? 🤯

0

0