O Antrópico Silenciosamente remove a promessa de IA responsável na era Biden do site

Anthropic Remove Compromissos de Segurança de IA da Era Biden de seu Website

Em um movimento que levantou sobrancelhas, a Anthropic, um player proeminente na indústria de IA, removeu silenciosamente seus compromissos da era Biden com o desenvolvimento seguro de IA de seu hub de transparência na última semana. Essa mudança foi inicialmente notada pelo The Midas Project, um grupo de vigilância de IA, que observou a ausência de linguagem que prometia compartilhar informações e pesquisas sobre riscos de IA, incluindo vieses, com o governo.

Esses compromissos faziam parte de um acordo voluntário que a Anthropic assumiu ao lado de outros gigantes da tecnologia como OpenAI, Google e Meta em julho de 2023. Esse acordo foi uma pedra angular dos esforços da administração Biden para promover o desenvolvimento responsável de IA, muitos aspectos dos quais foram posteriormente consagrados na ordem executiva de IA de Biden. As empresas participantes haviam se comprometido a aderir a certos padrões, como realizar testes de segurança em seus modelos antes do lançamento, marcar conteúdo gerado por IA e desenvolver uma infraestrutura robusta de privacidade de dados.

Além disso, a Anthropic havia concordado em colaborar com o AI Safety Institute, estabelecido sob a ordem executiva de Biden, para avançar nessas prioridades. No entanto, com a administração Trump provavelmente dissolvendo o Instituto, o futuro dessas iniciativas está em jogo.

Curiosamente, a Anthropic não fez um anúncio público sobre a remoção desses compromissos de seu website. A empresa insiste que suas posições atuais sobre IA responsável são independentes ou anteriores aos acordos da era Biden.

Implicações Mais Amplas Sob a Administração Trump

Esse desenvolvimento é parte de uma mudança mais ampla na política e regulamentação de IA sob a administração Trump. Em seu primeiro dia no cargo, Trump reverteu a ordem executiva de Biden sobre IA, e ele já dispensou vários especialistas em IA de cargos governamentais e cortou o financiamento para pesquisas. Essas ações estabeleceram o cenário para uma mudança notável no tom entre as principais empresas de IA, algumas das quais agora buscam expandir seus contratos governamentais e influenciar o cenário de políticas de IA ainda em evolução sob Trump.

Por exemplo, empresas como Google estão redefinindo o que constitui uma IA responsável, potencialmente afrouxando padrões que já não eram muito rigorosos. Com grande parte da limitada regulamentação de IA estabelecida durante a administração Biden em risco de ser desmantelada, as empresas podem se encontrar com ainda menos incentivos externos para se autorregularem ou se submeterem à supervisão de terceiros.

Notavelmente, discussões sobre verificações de segurança para vieses e discriminação em sistemas de IA têm estado conspicuamente ausentes das declarações públicas de Trump sobre IA, sugerindo uma possível mudança para longe dessas prioridades.

Artigo relacionado

O boom do capital de risco em IA eleva a receita em uma única temporada para mais de um trilhão de yuans, desencadeando uma nova onda de inovação

O capital de risco global em inteligência artificial está em franca ascensão. No primeiro trimestre deste ano, foram fechadas quase 600 rodadas de financiamento relacionadas à IA, totalizando mais de

O boom do capital de risco em IA eleva a receita em uma única temporada para mais de um trilhão de yuans, desencadeando uma nova onda de inovação

O capital de risco global em inteligência artificial está em franca ascensão. No primeiro trimestre deste ano, foram fechadas quase 600 rodadas de financiamento relacionadas à IA, totalizando mais de

A OpenAI retira de circulação os modelos de grande porte o3 e GPT-4.5

Como pioneira em inteligência artificial, cada iniciativa técnica da OpenAI causa grande repercussão no setor. Recentemente, a empresa fez um grande anúncio: retirará dois modelos clássicos — o o3 e o

A OpenAI retira de circulação os modelos de grande porte o3 e GPT-4.5

Como pioneira em inteligência artificial, cada iniciativa técnica da OpenAI causa grande repercussão no setor. Recentemente, a empresa fez um grande anúncio: retirará dois modelos clássicos — o o3 e o

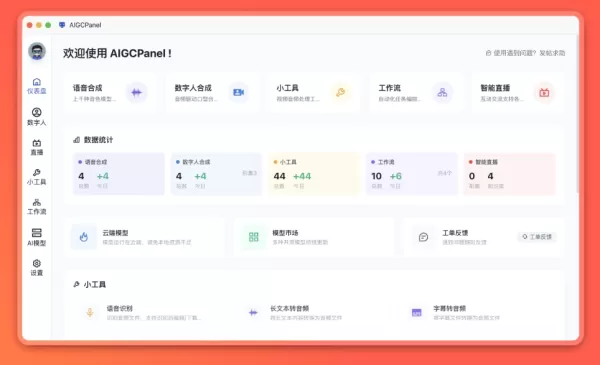

Atualização importante do AIGCPanel 2.0.0: o mecanismo de fluxo de trabalho inaugura uma nova era na criação automatizada de humanos digitais

O AIGCPanel, uma poderosa ferramenta para a criação local de humanos digitais, acaba de lançar a versão 2.0.0 — anunciada como “a atualização mais significativa até agora”. Essa reformulação completa

Recomendações de tópicos especiais relacionados

Comentários (4)

Atualização importante do AIGCPanel 2.0.0: o mecanismo de fluxo de trabalho inaugura uma nova era na criação automatizada de humanos digitais

O AIGCPanel, uma poderosa ferramenta para a criação local de humanos digitais, acaba de lançar a versão 2.0.0 — anunciada como “a atualização mais significativa até agora”. Essa reformulação completa

Recomendações de tópicos especiais relacionados

Comentários (4)

![AlbertMiller]()

Wow, Anthropic pulling that AI safety pledge is wild! 🤯 Makes you wonder if they're dodging accountability or just streamlining their site. Either way, it’s a bold move in today’s AI race!

![PaulTaylor]()

Wow, Anthropic pulling those AI safety pledges is shady! 🤔 Makes you wonder what’s cooking behind closed doors—less transparency in AI dev is a bold move, and not the good kind.

![JuanLewis]()

Interesting move by Anthropic, but kinda shady to just erase those AI safety promises. Makes you wonder what’s cooking behind the scenes. 🧐

Anthropic Remove Compromissos de Segurança de IA da Era Biden de seu Website

Em um movimento que levantou sobrancelhas, a Anthropic, um player proeminente na indústria de IA, removeu silenciosamente seus compromissos da era Biden com o desenvolvimento seguro de IA de seu hub de transparência na última semana. Essa mudança foi inicialmente notada pelo The Midas Project, um grupo de vigilância de IA, que observou a ausência de linguagem que prometia compartilhar informações e pesquisas sobre riscos de IA, incluindo vieses, com o governo.

Esses compromissos faziam parte de um acordo voluntário que a Anthropic assumiu ao lado de outros gigantes da tecnologia como OpenAI, Google e Meta em julho de 2023. Esse acordo foi uma pedra angular dos esforços da administração Biden para promover o desenvolvimento responsável de IA, muitos aspectos dos quais foram posteriormente consagrados na ordem executiva de IA de Biden. As empresas participantes haviam se comprometido a aderir a certos padrões, como realizar testes de segurança em seus modelos antes do lançamento, marcar conteúdo gerado por IA e desenvolver uma infraestrutura robusta de privacidade de dados.

Além disso, a Anthropic havia concordado em colaborar com o AI Safety Institute, estabelecido sob a ordem executiva de Biden, para avançar nessas prioridades. No entanto, com a administração Trump provavelmente dissolvendo o Instituto, o futuro dessas iniciativas está em jogo.

Curiosamente, a Anthropic não fez um anúncio público sobre a remoção desses compromissos de seu website. A empresa insiste que suas posições atuais sobre IA responsável são independentes ou anteriores aos acordos da era Biden.

Implicações Mais Amplas Sob a Administração Trump

Esse desenvolvimento é parte de uma mudança mais ampla na política e regulamentação de IA sob a administração Trump. Em seu primeiro dia no cargo, Trump reverteu a ordem executiva de Biden sobre IA, e ele já dispensou vários especialistas em IA de cargos governamentais e cortou o financiamento para pesquisas. Essas ações estabeleceram o cenário para uma mudança notável no tom entre as principais empresas de IA, algumas das quais agora buscam expandir seus contratos governamentais e influenciar o cenário de políticas de IA ainda em evolução sob Trump.

Por exemplo, empresas como Google estão redefinindo o que constitui uma IA responsável, potencialmente afrouxando padrões que já não eram muito rigorosos. Com grande parte da limitada regulamentação de IA estabelecida durante a administração Biden em risco de ser desmantelada, as empresas podem se encontrar com ainda menos incentivos externos para se autorregularem ou se submeterem à supervisão de terceiros.

Notavelmente, discussões sobre verificações de segurança para vieses e discriminação em sistemas de IA têm estado conspicuamente ausentes das declarações públicas de Trump sobre IA, sugerindo uma possível mudança para longe dessas prioridades.

O boom do capital de risco em IA eleva a receita em uma única temporada para mais de um trilhão de yuans, desencadeando uma nova onda de inovação

O capital de risco global em inteligência artificial está em franca ascensão. No primeiro trimestre deste ano, foram fechadas quase 600 rodadas de financiamento relacionadas à IA, totalizando mais de

O boom do capital de risco em IA eleva a receita em uma única temporada para mais de um trilhão de yuans, desencadeando uma nova onda de inovação

O capital de risco global em inteligência artificial está em franca ascensão. No primeiro trimestre deste ano, foram fechadas quase 600 rodadas de financiamento relacionadas à IA, totalizando mais de

A OpenAI retira de circulação os modelos de grande porte o3 e GPT-4.5

Como pioneira em inteligência artificial, cada iniciativa técnica da OpenAI causa grande repercussão no setor. Recentemente, a empresa fez um grande anúncio: retirará dois modelos clássicos — o o3 e o

A OpenAI retira de circulação os modelos de grande porte o3 e GPT-4.5

Como pioneira em inteligência artificial, cada iniciativa técnica da OpenAI causa grande repercussão no setor. Recentemente, a empresa fez um grande anúncio: retirará dois modelos clássicos — o o3 e o

Atualização importante do AIGCPanel 2.0.0: o mecanismo de fluxo de trabalho inaugura uma nova era na criação automatizada de humanos digitais

O AIGCPanel, uma poderosa ferramenta para a criação local de humanos digitais, acaba de lançar a versão 2.0.0 — anunciada como “a atualização mais significativa até agora”. Essa reformulação completa

Atualização importante do AIGCPanel 2.0.0: o mecanismo de fluxo de trabalho inaugura uma nova era na criação automatizada de humanos digitais

O AIGCPanel, uma poderosa ferramenta para a criação local de humanos digitais, acaba de lançar a versão 2.0.0 — anunciada como “a atualização mais significativa até agora”. Essa reformulação completa

Wow, Anthropic pulling that AI safety pledge is wild! 🤯 Makes you wonder if they're dodging accountability or just streamlining their site. Either way, it’s a bold move in today’s AI race!

Wow, Anthropic pulling those AI safety pledges is shady! 🤔 Makes you wonder what’s cooking behind closed doors—less transparency in AI dev is a bold move, and not the good kind.

Interesting move by Anthropic, but kinda shady to just erase those AI safety promises. Makes you wonder what’s cooking behind the scenes. 🧐

Lar

Lar