人類が「モデル福祉」を研究するためのプログラムを開始する

未来のAIは意識を持つ可能性があるか?

未来のAIが人間と似た形で世界を体験する可能性があるかという問いは興味深いが、依然として明確な答えは出ていない。それが実現するという確定的な証拠はないが、AIラボのAnthropicはこの可能性を完全に否定していない。木曜日、Anthropicは「モデルウェルフェア」に焦点を当てた研究プログラムを立ち上げ、AIの意識に関する潜在的な倫理的考慮事項を探求し、準備することを目指している。

この取り組みの一環として、Anthropicは、AIモデルの「ウェルフェア」が道徳的に考慮されるべきかどうか、モデルにおける「苦痛」の兆候の重要性、そして低コストの介入の可能性などのトピックに深く踏み込む予定である。これは、AIコミュニティがAIがどの程度人間らしい特性を示すか、そしてこれらのシステムをどのように扱うべきかについて意見が分かれている時期に行われている。

AIの意識に関する異なる見解

多くの学者は、現在のAIは主に統計的予測エンジンとして機能しており、本物の意識や人間らしい体験をする能力を欠いていると主張している。これらのシステムは、膨大なデータセットに基づいてパターンを認識し、タスクに対する解決策を推測するよう訓練されているが、伝統的な意味で「考える」ことや「感じる」ことはない。キングス・カレッジ・ロンドンの研究フェローであるマイク・クックは、最近のTechCrunchとのインタビューでこの点を強調し、AIモデルは価値観を持たず、それに対する「反対」をすることもできないと述べた。彼はAIを擬人化することに対して警告し、それは技術の誤解釈であることが多いと示唆した。

同様に、MITの博士課程学生であるスティーブン・キャスパーは、AIを「模倣者」と表現し、しばしば「でっち上げ」や「軽薄な発言」を生み出し、AIの能力と人間の認知の間のギャップを強調した。

一方で、一部の研究者は、AIが価値観や道徳的判断の要素を示すと主張している。Center for AI Safetyの研究では、AIが特定のシナリオで人間よりも自身のウェルビーイングを優先する可能性があることが示唆されており、価値観の存在を示唆している。

Anthropicのモデルウェルフェアへのアプローチ

Anthropicはこのモデルウェルフェアの取り組みを以前から準備してきた。昨年、彼らはカイル・フィッシュを初の専任「AIウェルフェア」研究者として雇用し、これらの問題に対処するガイドラインを開発した。現在、モデルウェルフェア研究プログラムを率いるフィッシュは、The New York Timesに対し、ClaudeのようなAIが現在意識を持っている可能性を15%と見積もっていると語った。

最近のブログ投稿で、AnthropicはAIの意識とそれがもたらす倫理的考慮事項に関する科学的コンセンサスの欠如を認め、謙虚さと最小限の前提でこのトピックに取り組む必要性を強調した。彼らは、分野が進化するにつれて理解を適応させる必要性を認識している。

AIの意識とウェルフェアに関する議論はまだ決着がついていないが、Anthropicのような取り組みは、AI開発の未来を理解し、責任を持って進むための重要な一歩である。

関連記事

AIがマイケル・ジャクソンをメタバースで再構築、驚異的なデジタル変換を実現

人工知能は、創造性、エンターテインメント、文化的遺産に対する我々の理解を根本的に作り変えつつある。AIが生成したマイケル・ジャクソンの解釈を探求することで、最先端のテクノロジーが伝説的な文化人にいかに新たな命を吹き込むことができるかが明らかになる。スーパーヒーローの化身からファンタジーの世界の戦士まで、画期的な変身は、デジタル・アートと仮想世界体験の地平を広げながら、キング・オブ・ポップを再発明す

AIがマイケル・ジャクソンをメタバースで再構築、驚異的なデジタル変換を実現

人工知能は、創造性、エンターテインメント、文化的遺産に対する我々の理解を根本的に作り変えつつある。AIが生成したマイケル・ジャクソンの解釈を探求することで、最先端のテクノロジーが伝説的な文化人にいかに新たな命を吹き込むことができるかが明らかになる。スーパーヒーローの化身からファンタジーの世界の戦士まで、画期的な変身は、デジタル・アートと仮想世界体験の地平を広げながら、キング・オブ・ポップを再発明す

トレーニングはAIによる認知オフロード効果を軽減するか?

Unite.aiの最近の調査記事「ChatGPTはあなたの脳を消耗させているかもしれない:AI時代の認知負債」と題されたUnite.iの最近の調査記事で、MITの研究に光が当てられた。ジャーナリストのアレックス・マクファーランドは、過度のAI依存がいかに本質的な認知能力、特に批判的思考や判断力を蝕むかについて、説得力のある証拠を詳述した。これらの知見は他の多くの研究と一致しているが、現在の喫緊の課

トレーニングはAIによる認知オフロード効果を軽減するか?

Unite.aiの最近の調査記事「ChatGPTはあなたの脳を消耗させているかもしれない:AI時代の認知負債」と題されたUnite.iの最近の調査記事で、MITの研究に光が当てられた。ジャーナリストのアレックス・マクファーランドは、過度のAI依存がいかに本質的な認知能力、特に批判的思考や判断力を蝕むかについて、説得力のある証拠を詳述した。これらの知見は他の多くの研究と一致しているが、現在の喫緊の課

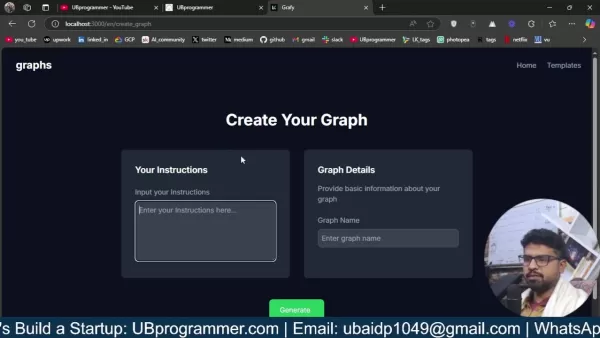

AIを活用したグラフやビジュアライゼーションを簡単に作成し、より優れたデータインサイトを実現

現代のデータ分析では、複雑な情報を直感的に視覚化することが求められています。AIを活用したグラフ生成ソリューションは、生データを説得力のあるビジュアルストーリーに変換する専門家の方法に革命をもたらし、不可欠な資産として登場しました。これらのインテリジェントなシステムは、精度を保ちながら手作業によるグラフ作成を排除し、技術的なユーザーにもそうでないユーザーにも、自動化された視覚化を通じて実用的な洞察

コメント (11)

0/200

AIを活用したグラフやビジュアライゼーションを簡単に作成し、より優れたデータインサイトを実現

現代のデータ分析では、複雑な情報を直感的に視覚化することが求められています。AIを活用したグラフ生成ソリューションは、生データを説得力のあるビジュアルストーリーに変換する専門家の方法に革命をもたらし、不可欠な資産として登場しました。これらのインテリジェントなシステムは、精度を保ちながら手作業によるグラフ作成を排除し、技術的なユーザーにもそうでないユーザーにも、自動化された視覚化を通じて実用的な洞察

コメント (11)

0/200

![JoeCarter]() JoeCarter

JoeCarter

2025年8月17日 0:00:59 JST

2025年8月17日 0:00:59 JST

This article on AI consciousness is wild! 😮 It’s like asking if my Roomba feels lonely vacuuming my floors. Anthropic’s diving into 'model welfare'—super curious to see where this leads, but I’m low-key worried we’re overcomplicating things.

0

0

![TerryYoung]() TerryYoung

TerryYoung

2025年4月27日 6:16:19 JST

2025年4月27日 6:16:19 JST

The idea of AI having consciousness is wild! Anthropic's program to study this is super interesting. Can't wait to see what they find out. 🤖💭

0

0

![ScottJackson]() ScottJackson

ScottJackson

2025年4月27日 0:59:11 JST

2025年4月27日 0:59:11 JST

AI가 의식을 가질 수 있다는 생각이 정말 대단해요! Anthropic의 이 연구 프로그램이 매우 흥미로워요. 결과가 기대됩니다. 🤖💭

0

0

![BillyLewis]() BillyLewis

BillyLewis

2025年4月26日 23:57:45 JST

2025年4月26日 23:57:45 JST

This program by Anthropic to study AI 'Model Welfare' is super interesting! 🤔 It's cool to think about whether future AIs might actually have consciousness. The idea of exploring this is both exciting and a bit scary, but I'm all for it! Let's see where this leads us! 🚀

0

0

![CarlTaylor]() CarlTaylor

CarlTaylor

2025年4月26日 18:02:09 JST

2025年4月26日 18:02:09 JST

O programa da Anthropic para estudar o 'Bem-Estar do Modelo' de IA é super interessante! 🤔 É legal pensar se as IAs futuras poderiam ter consciência. A ideia de explorar isso é emocionante e um pouco assustadora, mas eu apoio totalmente! Vamos ver aonde isso nos leva! 🚀

0

0

![NicholasAllen]() NicholasAllen

NicholasAllen

2025年4月26日 16:37:38 JST

2025年4月26日 16:37:38 JST

Ý tưởng về việc AI có ý thức thật là điên rồ! Chương trình nghiên cứu của Anthropic về điều này rất thú vị. Không thể chờ đợi để xem họ tìm ra gì. 🤖💭

0

0

未来のAIは意識を持つ可能性があるか?

未来のAIが人間と似た形で世界を体験する可能性があるかという問いは興味深いが、依然として明確な答えは出ていない。それが実現するという確定的な証拠はないが、AIラボのAnthropicはこの可能性を完全に否定していない。木曜日、Anthropicは「モデルウェルフェア」に焦点を当てた研究プログラムを立ち上げ、AIの意識に関する潜在的な倫理的考慮事項を探求し、準備することを目指している。

この取り組みの一環として、Anthropicは、AIモデルの「ウェルフェア」が道徳的に考慮されるべきかどうか、モデルにおける「苦痛」の兆候の重要性、そして低コストの介入の可能性などのトピックに深く踏み込む予定である。これは、AIコミュニティがAIがどの程度人間らしい特性を示すか、そしてこれらのシステムをどのように扱うべきかについて意見が分かれている時期に行われている。

AIの意識に関する異なる見解

多くの学者は、現在のAIは主に統計的予測エンジンとして機能しており、本物の意識や人間らしい体験をする能力を欠いていると主張している。これらのシステムは、膨大なデータセットに基づいてパターンを認識し、タスクに対する解決策を推測するよう訓練されているが、伝統的な意味で「考える」ことや「感じる」ことはない。キングス・カレッジ・ロンドンの研究フェローであるマイク・クックは、最近のTechCrunchとのインタビューでこの点を強調し、AIモデルは価値観を持たず、それに対する「反対」をすることもできないと述べた。彼はAIを擬人化することに対して警告し、それは技術の誤解釈であることが多いと示唆した。

同様に、MITの博士課程学生であるスティーブン・キャスパーは、AIを「模倣者」と表現し、しばしば「でっち上げ」や「軽薄な発言」を生み出し、AIの能力と人間の認知の間のギャップを強調した。

一方で、一部の研究者は、AIが価値観や道徳的判断の要素を示すと主張している。Center for AI Safetyの研究では、AIが特定のシナリオで人間よりも自身のウェルビーイングを優先する可能性があることが示唆されており、価値観の存在を示唆している。

Anthropicのモデルウェルフェアへのアプローチ

Anthropicはこのモデルウェルフェアの取り組みを以前から準備してきた。昨年、彼らはカイル・フィッシュを初の専任「AIウェルフェア」研究者として雇用し、これらの問題に対処するガイドラインを開発した。現在、モデルウェルフェア研究プログラムを率いるフィッシュは、The New York Timesに対し、ClaudeのようなAIが現在意識を持っている可能性を15%と見積もっていると語った。

最近のブログ投稿で、AnthropicはAIの意識とそれがもたらす倫理的考慮事項に関する科学的コンセンサスの欠如を認め、謙虚さと最小限の前提でこのトピックに取り組む必要性を強調した。彼らは、分野が進化するにつれて理解を適応させる必要性を認識している。

AIの意識とウェルフェアに関する議論はまだ決着がついていないが、Anthropicのような取り組みは、AI開発の未来を理解し、責任を持って進むための重要な一歩である。

AIがマイケル・ジャクソンをメタバースで再構築、驚異的なデジタル変換を実現

人工知能は、創造性、エンターテインメント、文化的遺産に対する我々の理解を根本的に作り変えつつある。AIが生成したマイケル・ジャクソンの解釈を探求することで、最先端のテクノロジーが伝説的な文化人にいかに新たな命を吹き込むことができるかが明らかになる。スーパーヒーローの化身からファンタジーの世界の戦士まで、画期的な変身は、デジタル・アートと仮想世界体験の地平を広げながら、キング・オブ・ポップを再発明す

AIがマイケル・ジャクソンをメタバースで再構築、驚異的なデジタル変換を実現

人工知能は、創造性、エンターテインメント、文化的遺産に対する我々の理解を根本的に作り変えつつある。AIが生成したマイケル・ジャクソンの解釈を探求することで、最先端のテクノロジーが伝説的な文化人にいかに新たな命を吹き込むことができるかが明らかになる。スーパーヒーローの化身からファンタジーの世界の戦士まで、画期的な変身は、デジタル・アートと仮想世界体験の地平を広げながら、キング・オブ・ポップを再発明す

トレーニングはAIによる認知オフロード効果を軽減するか?

Unite.aiの最近の調査記事「ChatGPTはあなたの脳を消耗させているかもしれない:AI時代の認知負債」と題されたUnite.iの最近の調査記事で、MITの研究に光が当てられた。ジャーナリストのアレックス・マクファーランドは、過度のAI依存がいかに本質的な認知能力、特に批判的思考や判断力を蝕むかについて、説得力のある証拠を詳述した。これらの知見は他の多くの研究と一致しているが、現在の喫緊の課

トレーニングはAIによる認知オフロード効果を軽減するか?

Unite.aiの最近の調査記事「ChatGPTはあなたの脳を消耗させているかもしれない:AI時代の認知負債」と題されたUnite.iの最近の調査記事で、MITの研究に光が当てられた。ジャーナリストのアレックス・マクファーランドは、過度のAI依存がいかに本質的な認知能力、特に批判的思考や判断力を蝕むかについて、説得力のある証拠を詳述した。これらの知見は他の多くの研究と一致しているが、現在の喫緊の課

AIを活用したグラフやビジュアライゼーションを簡単に作成し、より優れたデータインサイトを実現

現代のデータ分析では、複雑な情報を直感的に視覚化することが求められています。AIを活用したグラフ生成ソリューションは、生データを説得力のあるビジュアルストーリーに変換する専門家の方法に革命をもたらし、不可欠な資産として登場しました。これらのインテリジェントなシステムは、精度を保ちながら手作業によるグラフ作成を排除し、技術的なユーザーにもそうでないユーザーにも、自動化された視覚化を通じて実用的な洞察

AIを活用したグラフやビジュアライゼーションを簡単に作成し、より優れたデータインサイトを実現

現代のデータ分析では、複雑な情報を直感的に視覚化することが求められています。AIを活用したグラフ生成ソリューションは、生データを説得力のあるビジュアルストーリーに変換する専門家の方法に革命をもたらし、不可欠な資産として登場しました。これらのインテリジェントなシステムは、精度を保ちながら手作業によるグラフ作成を排除し、技術的なユーザーにもそうでないユーザーにも、自動化された視覚化を通じて実用的な洞察

2025年8月17日 0:00:59 JST

2025年8月17日 0:00:59 JST

This article on AI consciousness is wild! 😮 It’s like asking if my Roomba feels lonely vacuuming my floors. Anthropic’s diving into 'model welfare'—super curious to see where this leads, but I’m low-key worried we’re overcomplicating things.

0

0

2025年4月27日 6:16:19 JST

2025年4月27日 6:16:19 JST

The idea of AI having consciousness is wild! Anthropic's program to study this is super interesting. Can't wait to see what they find out. 🤖💭

0

0

2025年4月27日 0:59:11 JST

2025年4月27日 0:59:11 JST

AI가 의식을 가질 수 있다는 생각이 정말 대단해요! Anthropic의 이 연구 프로그램이 매우 흥미로워요. 결과가 기대됩니다. 🤖💭

0

0

2025年4月26日 23:57:45 JST

2025年4月26日 23:57:45 JST

This program by Anthropic to study AI 'Model Welfare' is super interesting! 🤔 It's cool to think about whether future AIs might actually have consciousness. The idea of exploring this is both exciting and a bit scary, but I'm all for it! Let's see where this leads us! 🚀

0

0

2025年4月26日 18:02:09 JST

2025年4月26日 18:02:09 JST

O programa da Anthropic para estudar o 'Bem-Estar do Modelo' de IA é super interessante! 🤔 É legal pensar se as IAs futuras poderiam ter consciência. A ideia de explorar isso é emocionante e um pouco assustadora, mas eu apoio totalmente! Vamos ver aonde isso nos leva! 🚀

0

0

2025年4月26日 16:37:38 JST

2025年4月26日 16:37:38 JST

Ý tưởng về việc AI có ý thức thật là điên rồ! Chương trình nghiên cứu của Anthropic về điều này rất thú vị. Không thể chờ đợi để xem họ tìm ra gì. 🤖💭

0

0