トップグローバルリスクとして特定されたAI駆動の誤った情報

今後2年間で多くの国が選挙に備える時期に近づく中、人工知能(AI)によって加速された誤情報や偽情報の脅威が、最も重大なグローバルリスクとして大きく浮上しています。この懸念は、世界経済フォーラム(WEF)の「グローバルリスク報告書2024」で強調されており、偽情報と社会的不安の絡み合いが、特に主要経済国で選挙が行われる中で、最前線に立つと指摘されています。

生活費に関する不安が高まる中、AIによって推進される誤情報のリスクが、今年は他の懸念を凌駕する見込みです。WEFによると、誤情報と偽情報がグローバルリスクの最上位に位置し、極端な気象現象や社会的分断がそれに続きます。報告書では、サイバーセキュリティの不安定さや国家間の武力紛争も、上位5つのリスクに含まれています。

リスク認識の地域差

誤情報と偽情報はインドでは最上位のリスクとされていますが、米国では6位、欧州連合では8位にランクされています。WEFは、洗練された技術への容易なアクセスと、情報や機関への信頼の低下によって、操作された情報の能力が急速に加速し、状況を悪化させていると指摘しています。

合成コンテンツの影響

今後数年間、さまざまなアクターが合成コンテンツの急増を悪用し、社会的分断、思想的暴力、政治的抑圧をさらに激化させることが予想されます。インド、インドネシア、米国、英国など、約30億人が投票する国々で、誤情報の広範な拡散は、新たに選出された政府の正当性を危うくする可能性があります。

使いやすいAIツールへのアクセスが容易になったことで、偽情報や「合成」コンテンツ(高度な音声クローニングや偽ウェブサイトなど)が急増しています。WEFは、この合成コンテンツが今後2年間で個人を操作し、経済を害し、社会を多方面で分断すると警告しています。気候変動活動から紛争のエスカレーションまで、さまざまな目的で使用される可能性があります。

新たな脅威と規制対応

同意のないディープフェイクポルノや株式市場の操作など、新たな種類の犯罪も増加しています。WEFは、これらの問題が暴力的な抗議、憎悪犯罪、内戦、テロリズムにつながる可能性があると警告しています。

これに対応して、一部の国では、オンラインおよび違法コンテンツのホストと作成者を対象とした新たな規制をすでに導入しています。生成AIの初期規制(例えば、中国のAI生成コンテンツに透かしを入れる要件など)は、AI生成コンテンツからの意図しない誤情報を含む偽情報の特定に役立つ可能性があります。しかし、WEFは、規制のペースが技術の急速な発展に追いつく可能性は低いと指摘しています。

最近の技術進歩により、偽情報の量、リーチ、効果が増大し、追跡、帰属、制御が難しくなっています。ソーシャルメディアプラットフォームは、複数の重複するキャンペーンによって、整合性を維持する任務に圧倒される可能性があります。さらに、誤情報はますます個人化され、WhatsAppやWeChatなどの透明性の低いメッセージングプラットフォームを通じて拡散される傾向にあります。

AI生成コンテンツと人間生成コンテンツの区別の難しさ

WEFは、AI生成コンテンツと人間生成コンテンツの区別が、洗練された検出システムや技術に精通した個人にとってもますます困難になっていると強調しています。しかし、一部の国はこの課題に対処する措置を講じています。

シンガポールのディープフェイク対策イニシアチブ

シンガポールは、オンラインの信頼と安全性に関する研究プログラムに2,000万シンガポールドル(1,504万米ドル)を投資することを発表しました。このプログラムには、有害なオンラインコンテンツに対抗するツールを開発するセンターの設立が含まれ、2028年まで実施される予定です。

2024年前半に開設予定のオンライン安全性先進技術センターは、研究者や組織を集め、より安全なインターネットのための強固なエコシステムを構築することを目指しています。このセンターは、ディープフェイクや虚偽の主張などの有害なコンテンツを検出するツールの開発とカスタマイズに重点を置き、社会的脆弱性を特定し、有害なコンテンツへの感受性を下げる介入策の開発にも取り組みます。

MCIはすでに学界や公共・民間部門の100人以上の専門家と連携し、30人の参加者がセンターの活動に直接関与しています。開発されたツールはテストされ、採用が提案され、透かしやコンテンツ認証などの技術を通じてデジタル信頼を高めることを目指します。

誤情報の広範な影響

WEFは、誤情報が放置されれば、2つの対照的なシナリオにつながる可能性があると警告しています。一方で、一部の政府やプラットフォームが言論の自由と市民的自由を優先し、偽情報を効果的に抑制できず、社会全体で「真実」の定義が対立する可能性があります。これは、国家および非国家アクターによって、社会的分断を深め、政治機関への公衆の信頼を損ない、国家の結束を脅かすために悪用される可能性があります。

他方、誤情報の拡散に対応して、一部の国は情報への管理を強化し、国内プロパガンダや検閲のリスクを冒す可能性があります。真実の概念が損なわれるにつれて、政府は「真実」の定義に基づいて情報を制御する権限を強め、インターネット、報道、情報アクセスの自由のさらなる侵食や、情報フローのより広範な抑圧につながる可能性があります。

関連記事

AIがマイケル・ジャクソンをメタバースで再構築、驚異的なデジタル変換を実現

人工知能は、創造性、エンターテインメント、文化的遺産に対する我々の理解を根本的に作り変えつつある。AIが生成したマイケル・ジャクソンの解釈を探求することで、最先端のテクノロジーが伝説的な文化人にいかに新たな命を吹き込むことができるかが明らかになる。スーパーヒーローの化身からファンタジーの世界の戦士まで、画期的な変身は、デジタル・アートと仮想世界体験の地平を広げながら、キング・オブ・ポップを再発明す

AIがマイケル・ジャクソンをメタバースで再構築、驚異的なデジタル変換を実現

人工知能は、創造性、エンターテインメント、文化的遺産に対する我々の理解を根本的に作り変えつつある。AIが生成したマイケル・ジャクソンの解釈を探求することで、最先端のテクノロジーが伝説的な文化人にいかに新たな命を吹き込むことができるかが明らかになる。スーパーヒーローの化身からファンタジーの世界の戦士まで、画期的な変身は、デジタル・アートと仮想世界体験の地平を広げながら、キング・オブ・ポップを再発明す

トレーニングはAIによる認知オフロード効果を軽減するか?

Unite.aiの最近の調査記事「ChatGPTはあなたの脳を消耗させているかもしれない:AI時代の認知負債」と題されたUnite.iの最近の調査記事で、MITの研究に光が当てられた。ジャーナリストのアレックス・マクファーランドは、過度のAI依存がいかに本質的な認知能力、特に批判的思考や判断力を蝕むかについて、説得力のある証拠を詳述した。これらの知見は他の多くの研究と一致しているが、現在の喫緊の課

トレーニングはAIによる認知オフロード効果を軽減するか?

Unite.aiの最近の調査記事「ChatGPTはあなたの脳を消耗させているかもしれない:AI時代の認知負債」と題されたUnite.iの最近の調査記事で、MITの研究に光が当てられた。ジャーナリストのアレックス・マクファーランドは、過度のAI依存がいかに本質的な認知能力、特に批判的思考や判断力を蝕むかについて、説得力のある証拠を詳述した。これらの知見は他の多くの研究と一致しているが、現在の喫緊の課

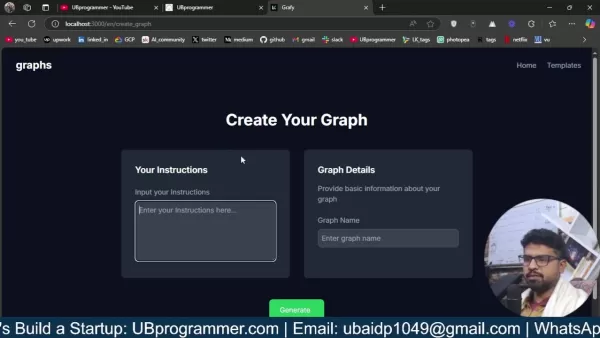

AIを活用したグラフやビジュアライゼーションを簡単に作成し、より優れたデータインサイトを実現

現代のデータ分析では、複雑な情報を直感的に視覚化することが求められています。AIを活用したグラフ生成ソリューションは、生データを説得力のあるビジュアルストーリーに変換する専門家の方法に革命をもたらし、不可欠な資産として登場しました。これらのインテリジェントなシステムは、精度を保ちながら手作業によるグラフ作成を排除し、技術的なユーザーにもそうでないユーザーにも、自動化された視覚化を通じて実用的な洞察

コメント (8)

0/200

AIを活用したグラフやビジュアライゼーションを簡単に作成し、より優れたデータインサイトを実現

現代のデータ分析では、複雑な情報を直感的に視覚化することが求められています。AIを活用したグラフ生成ソリューションは、生データを説得力のあるビジュアルストーリーに変換する専門家の方法に革命をもたらし、不可欠な資産として登場しました。これらのインテリジェントなシステムは、精度を保ちながら手作業によるグラフ作成を排除し、技術的なユーザーにもそうでないユーザーにも、自動化された視覚化を通じて実用的な洞察

コメント (8)

0/200

![CharlesThomas]() CharlesThomas

CharlesThomas

2025年9月8日 19:30:37 JST

2025年9月8日 19:30:37 JST

AI假訊息真的越來越可怕了...我昨天在群組看到的深偽影片根本分不出真假😰 選舉期間會不會整個亂成一團啊?政府到底有沒有在管?

0

0

![KeithGonzález]() KeithGonzález

KeithGonzález

2025年8月21日 18:01:16 JST

2025年8月21日 18:01:16 JST

AI misinformation as a top global risk is scary stuff! 😱 With elections coming up, I wonder how we can trust what we read online anymore. Governments and tech companies need to step up and tackle this mess before it spirals out of control.

0

0

![MatthewBaker]() MatthewBaker

MatthewBaker

2025年8月19日 20:01:06 JST

2025年8月19日 20:01:06 JST

AI misinformation as a top risk? Scary stuff! With elections coming, I’m worried how AI could mess with truth. 🥶 Hope we get better tools to fight this!

0

0

![WillieJackson]() WillieJackson

WillieJackson

2025年4月21日 4:21:01 JST

2025年4月21日 4:21:01 JST

Con las elecciones acercándose, el riesgo de desinformación potenciado por IA es una amenaza real. Esta herramienta es un despertador, pero también un poco abrumadora. Necesitamos más herramientas así para mantenernos informados y seguros. ¡Mantente alerta, gente! 😨

0

0

![ThomasYoung]() ThomasYoung

ThomasYoung

2025年4月20日 15:44:05 JST

2025年4月20日 15:44:05 JST

Com as eleições se aproximando, o risco de desinformação impulsionada por IA é assustadoramente real. Esta ferramenta é um alerta, mas também me deixa um pouco sobrecarregado. Precisamos de mais ferramentas assim para nos manter informados e seguros. Fiquem atentos, pessoal! 😬

0

0

![KevinMartinez]() KevinMartinez

KevinMartinez

2025年4月20日 7:50:18 JST

2025年4月20日 7:50:18 JST

This tool is a wake-up call! With elections coming up, the AI-driven misinformation risk is scary real. It's eye-opening but also kinda overwhelming. We need more tools like this to keep us informed and safe. Stay vigilant, folks! 😅

0

0

今後2年間で多くの国が選挙に備える時期に近づく中、人工知能(AI)によって加速された誤情報や偽情報の脅威が、最も重大なグローバルリスクとして大きく浮上しています。この懸念は、世界経済フォーラム(WEF)の「グローバルリスク報告書2024」で強調されており、偽情報と社会的不安の絡み合いが、特に主要経済国で選挙が行われる中で、最前線に立つと指摘されています。

生活費に関する不安が高まる中、AIによって推進される誤情報のリスクが、今年は他の懸念を凌駕する見込みです。WEFによると、誤情報と偽情報がグローバルリスクの最上位に位置し、極端な気象現象や社会的分断がそれに続きます。報告書では、サイバーセキュリティの不安定さや国家間の武力紛争も、上位5つのリスクに含まれています。

リスク認識の地域差

誤情報と偽情報はインドでは最上位のリスクとされていますが、米国では6位、欧州連合では8位にランクされています。WEFは、洗練された技術への容易なアクセスと、情報や機関への信頼の低下によって、操作された情報の能力が急速に加速し、状況を悪化させていると指摘しています。

合成コンテンツの影響

今後数年間、さまざまなアクターが合成コンテンツの急増を悪用し、社会的分断、思想的暴力、政治的抑圧をさらに激化させることが予想されます。インド、インドネシア、米国、英国など、約30億人が投票する国々で、誤情報の広範な拡散は、新たに選出された政府の正当性を危うくする可能性があります。

使いやすいAIツールへのアクセスが容易になったことで、偽情報や「合成」コンテンツ(高度な音声クローニングや偽ウェブサイトなど)が急増しています。WEFは、この合成コンテンツが今後2年間で個人を操作し、経済を害し、社会を多方面で分断すると警告しています。気候変動活動から紛争のエスカレーションまで、さまざまな目的で使用される可能性があります。

新たな脅威と規制対応

同意のないディープフェイクポルノや株式市場の操作など、新たな種類の犯罪も増加しています。WEFは、これらの問題が暴力的な抗議、憎悪犯罪、内戦、テロリズムにつながる可能性があると警告しています。

これに対応して、一部の国では、オンラインおよび違法コンテンツのホストと作成者を対象とした新たな規制をすでに導入しています。生成AIの初期規制(例えば、中国のAI生成コンテンツに透かしを入れる要件など)は、AI生成コンテンツからの意図しない誤情報を含む偽情報の特定に役立つ可能性があります。しかし、WEFは、規制のペースが技術の急速な発展に追いつく可能性は低いと指摘しています。

最近の技術進歩により、偽情報の量、リーチ、効果が増大し、追跡、帰属、制御が難しくなっています。ソーシャルメディアプラットフォームは、複数の重複するキャンペーンによって、整合性を維持する任務に圧倒される可能性があります。さらに、誤情報はますます個人化され、WhatsAppやWeChatなどの透明性の低いメッセージングプラットフォームを通じて拡散される傾向にあります。

AI生成コンテンツと人間生成コンテンツの区別の難しさ

WEFは、AI生成コンテンツと人間生成コンテンツの区別が、洗練された検出システムや技術に精通した個人にとってもますます困難になっていると強調しています。しかし、一部の国はこの課題に対処する措置を講じています。

シンガポールのディープフェイク対策イニシアチブ

シンガポールは、オンラインの信頼と安全性に関する研究プログラムに2,000万シンガポールドル(1,504万米ドル)を投資することを発表しました。このプログラムには、有害なオンラインコンテンツに対抗するツールを開発するセンターの設立が含まれ、2028年まで実施される予定です。

2024年前半に開設予定のオンライン安全性先進技術センターは、研究者や組織を集め、より安全なインターネットのための強固なエコシステムを構築することを目指しています。このセンターは、ディープフェイクや虚偽の主張などの有害なコンテンツを検出するツールの開発とカスタマイズに重点を置き、社会的脆弱性を特定し、有害なコンテンツへの感受性を下げる介入策の開発にも取り組みます。

MCIはすでに学界や公共・民間部門の100人以上の専門家と連携し、30人の参加者がセンターの活動に直接関与しています。開発されたツールはテストされ、採用が提案され、透かしやコンテンツ認証などの技術を通じてデジタル信頼を高めることを目指します。

誤情報の広範な影響

WEFは、誤情報が放置されれば、2つの対照的なシナリオにつながる可能性があると警告しています。一方で、一部の政府やプラットフォームが言論の自由と市民的自由を優先し、偽情報を効果的に抑制できず、社会全体で「真実」の定義が対立する可能性があります。これは、国家および非国家アクターによって、社会的分断を深め、政治機関への公衆の信頼を損ない、国家の結束を脅かすために悪用される可能性があります。

他方、誤情報の拡散に対応して、一部の国は情報への管理を強化し、国内プロパガンダや検閲のリスクを冒す可能性があります。真実の概念が損なわれるにつれて、政府は「真実」の定義に基づいて情報を制御する権限を強め、インターネット、報道、情報アクセスの自由のさらなる侵食や、情報フローのより広範な抑圧につながる可能性があります。

AIがマイケル・ジャクソンをメタバースで再構築、驚異的なデジタル変換を実現

人工知能は、創造性、エンターテインメント、文化的遺産に対する我々の理解を根本的に作り変えつつある。AIが生成したマイケル・ジャクソンの解釈を探求することで、最先端のテクノロジーが伝説的な文化人にいかに新たな命を吹き込むことができるかが明らかになる。スーパーヒーローの化身からファンタジーの世界の戦士まで、画期的な変身は、デジタル・アートと仮想世界体験の地平を広げながら、キング・オブ・ポップを再発明す

AIがマイケル・ジャクソンをメタバースで再構築、驚異的なデジタル変換を実現

人工知能は、創造性、エンターテインメント、文化的遺産に対する我々の理解を根本的に作り変えつつある。AIが生成したマイケル・ジャクソンの解釈を探求することで、最先端のテクノロジーが伝説的な文化人にいかに新たな命を吹き込むことができるかが明らかになる。スーパーヒーローの化身からファンタジーの世界の戦士まで、画期的な変身は、デジタル・アートと仮想世界体験の地平を広げながら、キング・オブ・ポップを再発明す

トレーニングはAIによる認知オフロード効果を軽減するか?

Unite.aiの最近の調査記事「ChatGPTはあなたの脳を消耗させているかもしれない:AI時代の認知負債」と題されたUnite.iの最近の調査記事で、MITの研究に光が当てられた。ジャーナリストのアレックス・マクファーランドは、過度のAI依存がいかに本質的な認知能力、特に批判的思考や判断力を蝕むかについて、説得力のある証拠を詳述した。これらの知見は他の多くの研究と一致しているが、現在の喫緊の課

トレーニングはAIによる認知オフロード効果を軽減するか?

Unite.aiの最近の調査記事「ChatGPTはあなたの脳を消耗させているかもしれない:AI時代の認知負債」と題されたUnite.iの最近の調査記事で、MITの研究に光が当てられた。ジャーナリストのアレックス・マクファーランドは、過度のAI依存がいかに本質的な認知能力、特に批判的思考や判断力を蝕むかについて、説得力のある証拠を詳述した。これらの知見は他の多くの研究と一致しているが、現在の喫緊の課

AIを活用したグラフやビジュアライゼーションを簡単に作成し、より優れたデータインサイトを実現

現代のデータ分析では、複雑な情報を直感的に視覚化することが求められています。AIを活用したグラフ生成ソリューションは、生データを説得力のあるビジュアルストーリーに変換する専門家の方法に革命をもたらし、不可欠な資産として登場しました。これらのインテリジェントなシステムは、精度を保ちながら手作業によるグラフ作成を排除し、技術的なユーザーにもそうでないユーザーにも、自動化された視覚化を通じて実用的な洞察

AIを活用したグラフやビジュアライゼーションを簡単に作成し、より優れたデータインサイトを実現

現代のデータ分析では、複雑な情報を直感的に視覚化することが求められています。AIを活用したグラフ生成ソリューションは、生データを説得力のあるビジュアルストーリーに変換する専門家の方法に革命をもたらし、不可欠な資産として登場しました。これらのインテリジェントなシステムは、精度を保ちながら手作業によるグラフ作成を排除し、技術的なユーザーにもそうでないユーザーにも、自動化された視覚化を通じて実用的な洞察

2025年9月8日 19:30:37 JST

2025年9月8日 19:30:37 JST

AI假訊息真的越來越可怕了...我昨天在群組看到的深偽影片根本分不出真假😰 選舉期間會不會整個亂成一團啊?政府到底有沒有在管?

0

0

2025年8月21日 18:01:16 JST

2025年8月21日 18:01:16 JST

AI misinformation as a top global risk is scary stuff! 😱 With elections coming up, I wonder how we can trust what we read online anymore. Governments and tech companies need to step up and tackle this mess before it spirals out of control.

0

0

2025年8月19日 20:01:06 JST

2025年8月19日 20:01:06 JST

AI misinformation as a top risk? Scary stuff! With elections coming, I’m worried how AI could mess with truth. 🥶 Hope we get better tools to fight this!

0

0

2025年4月21日 4:21:01 JST

2025年4月21日 4:21:01 JST

Con las elecciones acercándose, el riesgo de desinformación potenciado por IA es una amenaza real. Esta herramienta es un despertador, pero también un poco abrumadora. Necesitamos más herramientas así para mantenernos informados y seguros. ¡Mantente alerta, gente! 😨

0

0

2025年4月20日 15:44:05 JST

2025年4月20日 15:44:05 JST

Com as eleições se aproximando, o risco de desinformação impulsionada por IA é assustadoramente real. Esta ferramenta é um alerta, mas também me deixa um pouco sobrecarregado. Precisamos de mais ferramentas assim para nos manter informados e seguros. Fiquem atentos, pessoal! 😬

0

0

2025年4月20日 7:50:18 JST

2025年4月20日 7:50:18 JST

This tool is a wake-up call! With elections coming up, the AI-driven misinformation risk is scary real. It's eye-opening but also kinda overwhelming. We need more tools like this to keep us informed and safe. Stay vigilant, folks! 😅

0

0