Los científicos de EE. UU. Invitados por la IA abierta y el antrópico para experimentar con modelos fronterizos

Ampliando las asociaciones de IA entre gigantes tecnológicos y el gobierno de EE. UU.

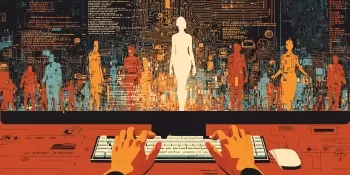

El panorama del desarrollo de la IA está evolucionando rápidamente, con grandes empresas de IA como Anthropic y OpenAI fortaleciendo sus lazos con el gobierno de EE. UU. En medio de las continuas incertidumbres sobre la seguridad y la regulación de la IA, estas colaboraciones se están intensificando, destacando la creciente dependencia del gobierno en la tecnología de IA de vanguardia para el avance científico.

Un reciente viernes, un evento único llamado AI Jam Session, organizado por OpenAI, reunió a 1,000 científicos de nueve laboratorios diferentes. Este evento fue una plataforma para que los investigadores probaran y exploraran las capacidades de varios modelos avanzados de IA, incluyendo el o3-mini de OpenAI y el más reciente de Anthropic, Claude 3.7 Sonnet. La sesión no se trataba solo de mostrar tecnología; fue una oportunidad para que los científicos aprovecharan la IA para expandir los límites de su investigación.

Anthropic destacó el evento como un paso crucial para evaluar el rol de la IA en la investigación científica, afirmando que proporciona una "evaluación más auténtica del potencial de la IA para manejar las complejidades y matices de la investigación científica." El enfoque estuvo en cómo la IA puede abordar desafíos científicos complejos que tradicionalmente requieren un tiempo y recursos extensos.

Fortaleciendo lazos con agencias gubernamentales

El AI Jam Session es un componente de acuerdos más amplios entre estos gigantes de la IA y entidades gubernamentales de EE. UU. Por ejemplo, en abril, Anthropic se asoció con el Departamento de Energía (DOE) y la Administración Nacional de Seguridad Nuclear (NNSA) para probar rigurosamente Claude 3 Sonnet ante posibles riesgos relacionados con la información nuclear. De manera similar, el 30 de enero, OpenAI anunció una colaboración con los Laboratorios Nacionales del DOE para mejorar la investigación científica utilizando sus últimos modelos de IA.

Los Laboratorios Nacionales del DOE, una red de 17 instalaciones de investigación en todo EE. UU., son fundamentales para explorar áreas críticas como la seguridad nuclear y las soluciones climáticas. Se animó a los científicos involucrados en estas sesiones a proporcionar retroalimentación que podría dar forma a futuros sistemas de IA para satisfacer mejor las necesidades científicas. OpenAI enfatizó que los conocimientos de la sesión se compartirían para ayudar a los científicos a utilizar la IA de manera más efectiva.

Implicaciones más amplias e iniciativas gubernamentales

La asociación de OpenAI con los Laboratorios Nacionales se extiende a varios campos, desde acelerar el tratamiento y la prevención de enfermedades hasta mejorar la seguridad cibernética y nuclear, explorar energías renovables y avanzar en la investigación en física. Junto a estos esfuerzos, iniciativas como ChatGPT Gov, un chatbot especializado para agencias gubernamentales, y el Proyecto Stargate, un plan de inversión masiva en centros de datos, subrayan la creciente integración de la IA en las operaciones gubernamentales.

Estas colaboraciones sugieren un cambio en la estrategia de IA de EE. UU., particularmente bajo la administración de Trump, que parece estar alejándose de regulaciones y medidas de seguridad estrictas. Los recientes recortes de personal en el Instituto de Seguridad de IA y la renuncia de su director sugieren una despriorización de la supervisión de seguridad. El Plan de Acción de IA de la administración aún no se ha anunciado, dejando incierta la regulación futura de la IA.

A medida que estas asociaciones se vuelven más frecuentes, existe el riesgo de una supervisión aún menor sobre la seguridad y el poder de los nuevos modelos de IA. Con el ritmo de implementación de la IA acelerándose y la regulación aún en sus inicios en EE. UU., el equilibrio entre innovación y seguridad se vuelve cada vez más delicado.

Artículo relacionado

Craig Federighi, de Apple, admite que Siri, impulsada por IA, tenía graves fallos en sus primeras fases

Ejecutivos de Apple explican el retraso en la actualización de SiriDurante la WWDC 2024, Apple prometió en un principio importantes mejoras de Siri, como el conocimiento personalizado del contexto y

Craig Federighi, de Apple, admite que Siri, impulsada por IA, tenía graves fallos en sus primeras fases

Ejecutivos de Apple explican el retraso en la actualización de SiriDurante la WWDC 2024, Apple prometió en un principio importantes mejoras de Siri, como el conocimiento personalizado del contexto y

Dominar las Técnicas de Inpainting AI: Guía intermedia para una edición de imágenes impecable

Descubra las capacidades transformadoras de la tecnología AI inpainting de Midjourney, una función revolucionaria que permite a los creadores refinar y perfeccionar las ilustraciones generadas por AI

Dominar las Técnicas de Inpainting AI: Guía intermedia para una edición de imágenes impecable

Descubra las capacidades transformadoras de la tecnología AI inpainting de Midjourney, una función revolucionaria que permite a los creadores refinar y perfeccionar las ilustraciones generadas por AI

Manus estrena su herramienta de IA "Wide Research" con más de 100 agentes para el raspado web

Manus, empresa china innovadora en IA, que ya había llamado la atención por su pionera plataforma de orquestación multiagente dirigida tanto a consumidores como a usuarios profesionales, ha desvelado

comentario (17)

0/200

Manus estrena su herramienta de IA "Wide Research" con más de 100 agentes para el raspado web

Manus, empresa china innovadora en IA, que ya había llamado la atención por su pionera plataforma de orquestación multiagente dirigida tanto a consumidores como a usuarios profesionales, ha desvelado

comentario (17)

0/200

![KevinWalker]() KevinWalker

KevinWalker

1 de agosto de 2025 08:20:48 GMT+02:00

1 de agosto de 2025 08:20:48 GMT+02:00

Super cool to see OpenAI and Anthropic teaming up with scientists! 😎 Wonder how this’ll shape AI safety rules down the line.

0

0

![SamuelWilson]() SamuelWilson

SamuelWilson

28 de julio de 2025 03:19:30 GMT+02:00

28 de julio de 2025 03:19:30 GMT+02:00

Super cool to see OpenAI and Anthropic teaming up with scientists! 😎 Wonder how this’ll shape AI safety talks—hope they’re not just handing over the keys to the kingdom!

0

0

![WilliamMiller]() WilliamMiller

WilliamMiller

24 de abril de 2025 17:50:53 GMT+02:00

24 de abril de 2025 17:50:53 GMT+02:00

Nossa, essa colaboração entre cientistas dos EUA e gigantes da IA como Open AI e Anthropic é incrível! Parece que estamos assistindo ao futuro se desenrolar bem na nossa frente. Mal posso esperar para ver o que eles vão inventar! 🚀

0

0

![DouglasHarris]() DouglasHarris

DouglasHarris

22 de abril de 2025 18:03:26 GMT+02:00

22 de abril de 2025 18:03:26 GMT+02:00

वाह, यूएस के वैज्ञानिकों और ओपन एआई और एंथ्रोपिक जैसी एआई की दिग्गज कंपनियों के बीच यह सहयोग मनमोहक है! ऐसा लगता है जैसे हम भविष्य को अपनी आँखों के सामने खुलते देख रहे हैं। इनके क्या नवीन चीजें निकालेंगे, यह देखने के लिए बेताब हूँ! 🚀

0

0

![WillMitchell]() WillMitchell

WillMitchell

21 de abril de 2025 12:18:41 GMT+02:00

21 de abril de 2025 12:18:41 GMT+02:00

¡Vaya, esta colaboración entre científicos de EE. UU. y gigantes de la IA como Open AI y Anthropic es alucinante! Es como ver el futuro desarrollarse ante nuestros ojos. ¡No puedo esperar para ver qué cosas innovadoras sacan! 🚀

0

0

![RichardJackson]() RichardJackson

RichardJackson

19 de abril de 2025 14:42:17 GMT+02:00

19 de abril de 2025 14:42:17 GMT+02:00

米国の科学者とOpenAIやAnthropicのようなAI巨人とのコラボレーションは本当にワクワクします!未来が目の前で展開しているようです。何か革新的なものが生まれるのを楽しみにしています。ただ、安全性にも気を配ってほしいですね、ね?🤞

0

0

Ampliando las asociaciones de IA entre gigantes tecnológicos y el gobierno de EE. UU.

El panorama del desarrollo de la IA está evolucionando rápidamente, con grandes empresas de IA como Anthropic y OpenAI fortaleciendo sus lazos con el gobierno de EE. UU. En medio de las continuas incertidumbres sobre la seguridad y la regulación de la IA, estas colaboraciones se están intensificando, destacando la creciente dependencia del gobierno en la tecnología de IA de vanguardia para el avance científico.

Un reciente viernes, un evento único llamado AI Jam Session, organizado por OpenAI, reunió a 1,000 científicos de nueve laboratorios diferentes. Este evento fue una plataforma para que los investigadores probaran y exploraran las capacidades de varios modelos avanzados de IA, incluyendo el o3-mini de OpenAI y el más reciente de Anthropic, Claude 3.7 Sonnet. La sesión no se trataba solo de mostrar tecnología; fue una oportunidad para que los científicos aprovecharan la IA para expandir los límites de su investigación.

Anthropic destacó el evento como un paso crucial para evaluar el rol de la IA en la investigación científica, afirmando que proporciona una "evaluación más auténtica del potencial de la IA para manejar las complejidades y matices de la investigación científica." El enfoque estuvo en cómo la IA puede abordar desafíos científicos complejos que tradicionalmente requieren un tiempo y recursos extensos.

Fortaleciendo lazos con agencias gubernamentales

El AI Jam Session es un componente de acuerdos más amplios entre estos gigantes de la IA y entidades gubernamentales de EE. UU. Por ejemplo, en abril, Anthropic se asoció con el Departamento de Energía (DOE) y la Administración Nacional de Seguridad Nuclear (NNSA) para probar rigurosamente Claude 3 Sonnet ante posibles riesgos relacionados con la información nuclear. De manera similar, el 30 de enero, OpenAI anunció una colaboración con los Laboratorios Nacionales del DOE para mejorar la investigación científica utilizando sus últimos modelos de IA.

Los Laboratorios Nacionales del DOE, una red de 17 instalaciones de investigación en todo EE. UU., son fundamentales para explorar áreas críticas como la seguridad nuclear y las soluciones climáticas. Se animó a los científicos involucrados en estas sesiones a proporcionar retroalimentación que podría dar forma a futuros sistemas de IA para satisfacer mejor las necesidades científicas. OpenAI enfatizó que los conocimientos de la sesión se compartirían para ayudar a los científicos a utilizar la IA de manera más efectiva.

Implicaciones más amplias e iniciativas gubernamentales

La asociación de OpenAI con los Laboratorios Nacionales se extiende a varios campos, desde acelerar el tratamiento y la prevención de enfermedades hasta mejorar la seguridad cibernética y nuclear, explorar energías renovables y avanzar en la investigación en física. Junto a estos esfuerzos, iniciativas como ChatGPT Gov, un chatbot especializado para agencias gubernamentales, y el Proyecto Stargate, un plan de inversión masiva en centros de datos, subrayan la creciente integración de la IA en las operaciones gubernamentales.

Estas colaboraciones sugieren un cambio en la estrategia de IA de EE. UU., particularmente bajo la administración de Trump, que parece estar alejándose de regulaciones y medidas de seguridad estrictas. Los recientes recortes de personal en el Instituto de Seguridad de IA y la renuncia de su director sugieren una despriorización de la supervisión de seguridad. El Plan de Acción de IA de la administración aún no se ha anunciado, dejando incierta la regulación futura de la IA.

A medida que estas asociaciones se vuelven más frecuentes, existe el riesgo de una supervisión aún menor sobre la seguridad y el poder de los nuevos modelos de IA. Con el ritmo de implementación de la IA acelerándose y la regulación aún en sus inicios en EE. UU., el equilibrio entre innovación y seguridad se vuelve cada vez más delicado.

Craig Federighi, de Apple, admite que Siri, impulsada por IA, tenía graves fallos en sus primeras fases

Ejecutivos de Apple explican el retraso en la actualización de SiriDurante la WWDC 2024, Apple prometió en un principio importantes mejoras de Siri, como el conocimiento personalizado del contexto y

Craig Federighi, de Apple, admite que Siri, impulsada por IA, tenía graves fallos en sus primeras fases

Ejecutivos de Apple explican el retraso en la actualización de SiriDurante la WWDC 2024, Apple prometió en un principio importantes mejoras de Siri, como el conocimiento personalizado del contexto y

Dominar las Técnicas de Inpainting AI: Guía intermedia para una edición de imágenes impecable

Descubra las capacidades transformadoras de la tecnología AI inpainting de Midjourney, una función revolucionaria que permite a los creadores refinar y perfeccionar las ilustraciones generadas por AI

Dominar las Técnicas de Inpainting AI: Guía intermedia para una edición de imágenes impecable

Descubra las capacidades transformadoras de la tecnología AI inpainting de Midjourney, una función revolucionaria que permite a los creadores refinar y perfeccionar las ilustraciones generadas por AI

Manus estrena su herramienta de IA "Wide Research" con más de 100 agentes para el raspado web

Manus, empresa china innovadora en IA, que ya había llamado la atención por su pionera plataforma de orquestación multiagente dirigida tanto a consumidores como a usuarios profesionales, ha desvelado

Manus estrena su herramienta de IA "Wide Research" con más de 100 agentes para el raspado web

Manus, empresa china innovadora en IA, que ya había llamado la atención por su pionera plataforma de orquestación multiagente dirigida tanto a consumidores como a usuarios profesionales, ha desvelado

1 de agosto de 2025 08:20:48 GMT+02:00

1 de agosto de 2025 08:20:48 GMT+02:00

Super cool to see OpenAI and Anthropic teaming up with scientists! 😎 Wonder how this’ll shape AI safety rules down the line.

0

0

28 de julio de 2025 03:19:30 GMT+02:00

28 de julio de 2025 03:19:30 GMT+02:00

Super cool to see OpenAI and Anthropic teaming up with scientists! 😎 Wonder how this’ll shape AI safety talks—hope they’re not just handing over the keys to the kingdom!

0

0

24 de abril de 2025 17:50:53 GMT+02:00

24 de abril de 2025 17:50:53 GMT+02:00

Nossa, essa colaboração entre cientistas dos EUA e gigantes da IA como Open AI e Anthropic é incrível! Parece que estamos assistindo ao futuro se desenrolar bem na nossa frente. Mal posso esperar para ver o que eles vão inventar! 🚀

0

0

22 de abril de 2025 18:03:26 GMT+02:00

22 de abril de 2025 18:03:26 GMT+02:00

वाह, यूएस के वैज्ञानिकों और ओपन एआई और एंथ्रोपिक जैसी एआई की दिग्गज कंपनियों के बीच यह सहयोग मनमोहक है! ऐसा लगता है जैसे हम भविष्य को अपनी आँखों के सामने खुलते देख रहे हैं। इनके क्या नवीन चीजें निकालेंगे, यह देखने के लिए बेताब हूँ! 🚀

0

0

21 de abril de 2025 12:18:41 GMT+02:00

21 de abril de 2025 12:18:41 GMT+02:00

¡Vaya, esta colaboración entre científicos de EE. UU. y gigantes de la IA como Open AI y Anthropic es alucinante! Es como ver el futuro desarrollarse ante nuestros ojos. ¡No puedo esperar para ver qué cosas innovadoras sacan! 🚀

0

0

19 de abril de 2025 14:42:17 GMT+02:00

19 de abril de 2025 14:42:17 GMT+02:00

米国の科学者とOpenAIやAnthropicのようなAI巨人とのコラボレーションは本当にワクワクします!未来が目の前で展開しているようです。何か革新的なものが生まれるのを楽しみにしています。ただ、安全性にも気を配ってほしいですね、ね?🤞

0

0