Desenvolvimento Ético de IA: Considerações Críticas para Inovação Responsável

À medida que a Inteligência Artificial (IA) avança e se integra à vida cotidiana, as considerações éticas em seu desenvolvimento e uso são fundamentais. Este artigo explora aspectos essenciais como transparência, justiça, privacidade, responsabilidade, segurança e o uso da IA para o benefício da sociedade. Compreender essas dimensões é chave para construir confiança, promover inovação responsável e maximizar o potencial da IA enquanto se minimizam os riscos. Vamos navegar pelas complexidades éticas da IA para garantir que ela sirva à humanidade de forma responsável e eficaz.

Principais Conclusões

Transparência e explicabilidade constroem confiança nos sistemas de IA.

Justiça e redução de viés são vitais para prevenir discriminação e promover equidade.

Priorizar privacidade e segurança de dados protege informações sensíveis.

Estruturas de responsabilidade são essenciais para lidar com danos relacionados à IA.

Segurança e robustez da IA previnem consequências não intencionais e garantem confiabilidade.

Usar a IA para o bem social aborda desafios em saúde, educação e além.

Mitigar impactos no mercado de trabalho reduz deslocamento de empregos e desigualdade.

Preservar a autonomia humana mantém a agência e o controle de decisão.

A pesquisa ética em IA exige consideração cuidadosa de benefícios e riscos.

Governança eficaz da IA garante desenvolvimento e implementação responsáveis.

Explorando as Dimensões Éticas da IA

Transparência e Explicabilidade em IA

À medida que os sistemas de IA se tornam mais sofisticados, entender suas operações se torna cada vez mais difícil. Transparência e explicabilidade são cruciais para fomentar confiança e responsabilidade.

Transparência em IA envolve clareza sobre como os sistemas funcionam, incluindo seus dados, algoritmos e processos de tomada de decisão. A explicabilidade garante que as decisões da IA sejam compreensíveis para humanos, permitindo que as partes interessadas entendam o raciocínio por trás dos resultados.

O Papel da IA Explicável (XAI):

A IA Explicável (XAI) desenvolve modelos que humanos podem interpretar, permitindo que as partes interessadas avaliem os fundamentos das decisões, aumentando a confiança e a supervisão. Técnicas principais de XAI incluem:

- Sistemas baseados em regras: Empregam regras claras para decisões transparentes.

- Árvores de decisão: Oferecem caminhos de decisão visuais para maior compreensão.

- Importância de características: Destacam fatores de dados principais que impulsionam previsões do modelo.

Vantagens da Transparência e Explicabilidade:

- Fomentar Confiança: Sistemas claros incentivam a confiança e adoção dos usuários.

- Aumentar Responsabilidade: Compreender operações ajuda a identificar e corrigir erros ou vieses.

- Apoiar Supervisão: A transparência permite que as partes interessadas garantam alinhamento ético.

- Melhorar a Tomada de Decisão: Fundamentos claros fornecem insights para escolhas informadas.

Justiça e Redução de Viés em IA

Sistemas de IA podem perpetuar vieses presentes nos dados de treinamento, levando a resultados injustos. A justiça garante que a IA evite discriminação com base em atributos como raça, gênero ou religião, enquanto a redução de viés aborda desigualdades nos resultados do sistema.

Fontes de Viés em IA:

- Viés Histórico: Reflete vieses sociais nos dados de treinamento.

- Viés de Amostragem: Decorre de amostras de dados não representativas.

- Viés de Medição: Resulta de métodos de medição falhos.

- Viés Algorítmico: Surge do design ou implementação do algoritmo.

Estratégias de Redução de Viés:

- Pré-processamento de Dados: Limpar dados para minimizar vieses.

- Design de Algoritmo: Criar algoritmos focados em justiça.

- Avaliação de Modelo: Usar métricas para avaliar viés e justiça.

- Pós-processamento: Ajustar resultados para reduzir efeitos discriminatórios.

Promovendo Equidade:

- Conjuntos de Dados Diversos: Treinar IA com dados representativos.

- Auditorias de Viés: Verificar regularmente sistemas por comportamentos enviesados.

- Engajamento de Partes Interessadas: Envolver grupos diversos no desenvolvimento.

- Transparência e Responsabilidade: Garantir tomadas de decisão claras e responsáveis.

Privacidade e Segurança de Dados em IA

A IA depende de vastos conjuntos de dados, muitas vezes incluindo informações sensíveis. Proteger a privacidade e garantir a segurança dos dados são cruciais para a confiança do usuário.

A privacidade em IA protege dados pessoais contra acesso ou uso não autorizado, enquanto a segurança de dados previne roubo, perda ou corrupção.

Princípios Fundamentais de Privacidade e Segurança:

- Minimização de Dados: Coletar apenas dados essenciais.

- Limitação de Finalidade: Usar dados apenas para os propósitos pretendidos.

- Segurança de Dados: Aplicar salvaguardas robustas contra acesso não autorizado.

- Transparência: Informar os usuários sobre o uso de dados.

- Controle do Usuário: Permitir que indivíduos gerenciem seus dados.

Técnicas para Privacidade e Segurança:

- Anonimização: Remover dados identificáveis para proteger a privacidade.

- Privacidade Diferencial: Adicionar ruído aos dados para análise sem comprometer identidades.

- Aprendizado Federado: Treinar modelos em dados descentralizados sem compartilhá-los.

- Criptografia: Proteger dados contra acesso não autorizado.

Construindo Confiança através da Privacidade:

- Tecnologias de Melhoria de Privacidade: Proteger dados do usuário com ferramentas avançadas.

- Medidas de Segurança de Dados: Prevenir violações com proteções robustas.

- Conformidade Regulatória: Aderir a leis como GDPR e CCPA.

- Comunicação Clara: Informar os usuários sobre práticas de privacidade.

Responsabilidade e Accountability em IA

Atribuir responsabilidade por erros ou danos causados pela IA é complexo, especialmente com múltiplas partes interessadas envolvidas. Estruturas claras são necessárias para garantir a responsabilidade.

A responsabilidade garante que aqueles que desenvolvem e implementam IA sejam responsáveis por seus impactos, enquanto a responsabilidade foca na gestão ética.

Desafios de Responsabilidade:

- Complexidade do Sistema: Rastrear erros em sistemas de IA intricados é difícil.

- Múltiplas Partes Interessadas: Várias partes estão envolvidas no ciclo de vida da IA.

- Falta de Estruturas Legais: Diretrizes claras de responsabilidade muitas vezes estão ausentes.

Promovendo Responsabilidade:

- Diretrizes Claras: Estabelecer padrões para desenvolvimento e uso de IA.

- Estruturas Legais: Definir responsabilidade por resultados impulsionados por IA.

- Auditoria e Monitoramento: Detectar e abordar erros ou vieses.

- IA Explicável: Usar XAI para esclarecer fundamentos de decisão.

Incentivando Práticas Éticas:

- Treinamento Ético: Educar desenvolvedores sobre princípios éticos.

- Comitês de Revisão Ética: Avaliar projetos de IA quanto a impactos éticos.

- Padrões da Indústria: Estabelecer normas para IA responsável.

- Engajamento de Partes Interessadas: Envolver grupos diversos em avaliações.

Segurança e Robustez da IA

Os sistemas de IA devem ser seguros e resilientes para evitar danos e garantir confiabilidade contra ataques ou erros.

Considerações Chave de Segurança e Robustez:

- Consequências Não Intencionais: Prevenir danos causados por ações da IA.

- Ataques Adversariais: Proteger contra manipulações maliciosas.

- Entradas Inesperadas: Lidar eficazmente com entradas fora da distribuição.

- Confiabilidade do Sistema: Garantir desempenho consistente.

Melhorando Segurança e Robustez:

- Verificação Formal: Usar matemática para confirmar a segurança do sistema.

- Treinamento Adversarial: Treinar sistemas para resistir a ataques.

- Detecção de Anomalias: Identificar e sinalizar entradas incomuns.

- Redundância: Construir sistemas tolerantes a falhas para confiabilidade.

Avançando a Inovação Responsável:

- Pesquisa em Segurança: Investir em estudos de segurança de IA.

- Padrões de Segurança: Desenvolver diretrizes para IA robusta.

- Teste e Validação: Testar sistemas rigorosamente quanto à segurança.

- Monitoramento Contínuo: Acompanhar sistemas para abordar problemas.

IA para o Bem Social

A IA pode enfrentar desafios sociais como saúde, educação e sustentabilidade, melhorando vidas por meio de soluções direcionadas.

Saúde: Melhorar diagnóstico, tratamento e prevenção.

Educação: Personalizar aprendizado e melhorar acesso.

Sustentabilidade Ambiental: Otimizar recursos e reduzir poluição.

Redução da Pobreza: Expandir acesso financeiro e oportunidades de emprego.

Alívio de Desastres: Melhorar preparação e recuperação.

Considerações Éticas para o Bem Social:

- Equidade e Inclusão: Garantir que os benefícios alcancem grupos marginalizados.

- Transparência e Responsabilidade: Manter processos claros de tomada de decisão.

- Privacidade e Segurança: Proteger dados sensíveis.

- Autonomia Humana: Preservar o controle individual.

Promovendo Iniciativas de Bem Social:

- Financiar Pesquisa: Apoiar IA para impacto social.

- Apoiar Startups: Respaldar empreendimentos que abordam questões sociais.

- Parcerias Público-Privadas: Colaborar em soluções impactantes.

- Engajamento de Partes Interessadas: Envolver grupos diversos no desenvolvimento.

Impactos no Trabalho e Emprego

O potencial de automação da IA levanta preocupações sobre deslocamento de empregos e desigualdade, exigindo estratégias proativas para a força de trabalho.

Impactos da IA no Trabalho:

- Deslocamento de Empregos: A automação pode reduzir empregos em alguns setores.

- Criação de Empregos: Novas funções surgem em campos relacionados à IA.

- Brecha de Habilidades: A demanda cresce por habilidades especializadas.

- Desigualdade de Renda: Lacunas se ampliam entre níveis de habilidade.

Mitigando Impactos no Trabalho:

- Programas de Requalificação: Treinar trabalhadores para novas funções.

- Criação de Empregos: Investir em indústrias impulsionadas por IA.

- Redes de Segurança Social: Apoiar trabalhadores deslocados.

- Aprendizado ao Longo da Vida: Promover desenvolvimento contínuo de habilidades.

Garantindo uma Transição Justa:

- Programas de Retreinamento: Ajudar trabalhadores a mudar para novas indústrias.

- Benefícios de Desemprego: Apoiar aqueles afetados pela automação.

- Renda Básica Universal: Explorar redes de segurança para todos.

- Empoderamento dos Trabalhadores: Envolver trabalhadores nas decisões sobre IA.

Preservando a Autonomia Humana

IA avançada pode diminuir o controle humano, tornando essencial manter a agência e o poder de decisão.

A autonomia humana garante que os indivíduos mantenham controle sobre suas escolhas e vidas, evitando influência indevida da IA.

Riscos à Autonomia:

- Manipulação por IA: Sistemas podem influenciar comportamentos sutilmente.

- Dependência Excessiva: Dependência de IA pode enfraquecer o pensamento crítico.

- Perda de Controle: Consequências não intencionais de IA não verificada.

Preservando a Autonomia:

- Transparência: Garantir processos de IA claros e compreensíveis.

- Humano no Ciclo: Exigir supervisão humana em sistemas de IA.

- Controle do Usuário: Permitir optar por não participar de decisões impulsionadas por IA.

- Educação em Pensamento Crítico: Capacitar tomadas de decisão informadas.

Desenvolvimento Ético de IA:

- Valores Humanos: Alinhar IA com o bem-estar social.

- Mitigação de Viés: Prevenir resultados discriminatórios.

- Privacidade de Dados: Proteger informações pessoais.

- Responsabilidade: Responsabilizar desenvolvedores pelas ações da IA.

Pesquisa Ética em IA

A pesquisa responsável em IA equilibra inovação com consideração cuidadosa dos impactos sociais e ambientais.

Princípios de Pesquisa Ética:

- Transparência: Compartilhar descobertas para fomentar colaboração.

- Responsabilidade: Assumir as consequências da pesquisa.

- Beneficência: Maximizar benefícios, minimizar danos.

- Justiça: Garantir que a pesquisa beneficie a todos, incluindo grupos marginalizados.

Promovendo Pesquisa Ética:

- Comitês de Revisão Ética: Avaliar implicações da pesquisa.

- Diretrizes Éticas: Estabelecer padrões para pesquisadores.

- Engajamento de Partes Interessadas: Envolver perspectivas diversas.

- Educação Pública: Informar a sociedade sobre o potencial da IA.

Impulsionando Inovação:

- Pesquisa Aberta: Incentivar compartilhamento de dados para progresso.

- Educação em IA: Treinar uma força de trabalho qualificada.

- Colaboração: Fomentar parcerias entre setores.

- Inovação Ética: Desenvolver soluções para desafios sociais.

Governança e Regulação de IA

Governança robusta e regulamentações são cruciais para abordar preocupações éticas e garantir o desenvolvimento responsável da IA.

Desafios de Governança:

- Avanços Rápidos: Acompanhar o ritmo da IA.

- Complexidade do Sistema: Compreender a ética intricada da IA.

- Falta de Consenso: Concordar sobre padrões éticos.

Estratégias de Governança Eficaz:

- Padrões Éticos: Definir princípios de IA responsável.

- Estruturas Regulatórias: Estabelecer diretrizes legais.

- Comitês Éticos: Fornecer supervisão e orientação.

- Transparência: Exigir processos claros de tomada de decisão.

Construindo Confiança Pública:

- Responsabilidade: Garantir que desenvolvedores sejam responsáveis.

- Direitos Humanos: Proteger liberdades individuais.

- Bem Social: Usar IA para atender às necessidades da sociedade.

- Engajamento Público: Envolver comunidades em discussões de governança.

Exemplo de Estrutura de Governança de IA:

Componente Descrição Princípios Éticos Valores centrais como justiça, transparência e responsabilidade que guiam o desenvolvimento de IA. Diretrizes de Política Regras detalhando como os sistemas de IA devem ser projetados e implementados. Estrutura Regulatória Requisitos legais que garantem conformidade ética e proteção de direitos humanos. Mecanismos de Supervisão Processos para monitoramento e auditoria de IA para uso ético. Medidas de Responsabilidade Sistemas para responsabilizar desenvolvedores, incluindo penalidades por violações éticas.

Vantagens da IA Ética

Moldando um Futuro Responsável para a IA

Abordar a ética da IA é crucial para criar um futuro onde a IA beneficie a humanidade de forma responsável. Priorizar a ética desbloqueia o potencial da IA enquanto minimiza riscos. Benefícios principais incluem:

- Construir Confiança: Práticas éticas aumentam a confiança das partes interessadas, impulsionando a adoção da IA.

- Fomentar Inovação: Considerações éticas estimulam inovação alinhada a valores, aumentando a competitividade.

- Promover Equidade: IA ética reduz vieses, garantindo resultados justos para todos.

- Melhorar Transparência: Processos claros aumentam a responsabilidade e a confiança.

- Proteger Direitos: IA ética salvaguarda a dignidade e a autonomia humana.

- Incentivar Colaboração: Valores éticos compartilhados unem as partes interessadas para uma IA responsável.

Em última análise, a IA ética é uma necessidade moral e estratégica, garantindo um futuro onde a IA melhora o bem-estar humano.

Guia para o Desenvolvimento Ético de IA

Passo 1: Definir Princípios Éticos

Comece definindo princípios éticos claros que reflitam os valores organizacionais e as normas sociais, desenvolvidos com a contribuição de diversas partes interessadas.

Princípios principais:

- Justiça: Garantir tratamento equitativo sem viés.

- Transparência: Tornar os processos de IA claros para as partes interessadas.

- Responsabilidade: Atribuir responsabilidade pelas ações da IA.

- Privacidade: Proteger dados pessoais.

- Segurança: Projetar sistemas para prevenir danos.

Passo 2: Avaliar Riscos Éticos

Realizar avaliações de risco abrangentes para identificar preocupações éticas, envolvendo especialistas em ética, direito e IA.

Áreas de risco:

- Viés: Detectar vieses em dados e algoritmos.

- Discriminação: Avaliar riscos de tratamento injusto.

- Violações de Privacidade: Avaliar riscos de uso indevido de dados.

- Ameaças de Segurança: Identificar vulnerabilidades a ataques.

- Consequências Não Intencionais: Considerar danos potenciais.

Passo 3: Incorporar Ética no Design

Incorporar considerações éticas no design da IA desde o início, priorizando justiça, transparência e responsabilidade.

Abordagens de design:

- Algoritmos Conscientes de Justiça: Promover resultados equitativos.

- IA Explicável: Usar XAI para decisões compreensíveis.

- Tecnologias de Privacidade: Proteger dados do usuário.

- Supervisão Humana: Exigir intervenção humana em IA.

- Ferramentas de Transparência: Informar usuários sobre o uso de dados.

Passo 4: Monitorar e Auditar Sistemas

Implementar monitoramento e auditoria para detectar problemas éticos, garantindo conformidade com princípios e regulamentações.

Práticas:

- Monitoramento de Desempenho: Acompanhar métricas para viés.

- Auditoria de Dados: Verificar dados quanto a vieses.

- Transparência de Algoritmo: Monitorar algoritmos quanto à ética.

- Feedback do Usuário: Coletar entrada sobre preocupações éticas.

- Conformidade: Garantir adesão aos padrões éticos.

Passo 5: Garantir Responsabilidade

Estabelecer responsabilidade clara pelas ações da IA, com mecanismos de relatórios para abordar preocupações éticas prontamente.

Medidas:

- Oficial de Ética: Supervisionar práticas éticas.

- Comitê de Revisão: Avaliar a ética de projetos de IA.

- Canais de Relatório: Habilitar feedback das partes interessadas.

- Proteção a Denunciantes: Proteger aqueles que relatam problemas.

- Sanções: Penalizar violações éticas.

Prós e Contras da Ética em IA

Prós

Maior confiança e adoção de sistemas de IA

Responsabilidade e clareza aprimoradas nas decisões

Redução de viés e resultados mais justos

Proteções mais fortes para privacidade e segurança de dados

Maior foco em IA para benefício social

Contras

Maiores custos e tempo de desenvolvimento

Complexidade em aplicar diretrizes éticas

Equilíbrio entre ética e inovação

Desafios em concordar sobre padrões éticos

Riscos de resultados éticos não intencionais

Perguntas Frequentes sobre Ética em IA

Quais são as principais preocupações éticas em IA?

Preocupações principais incluem transparência, justiça, privacidade, responsabilidade e segurança, todos cruciais para o uso responsável da IA.

Como garantir justiça em IA?

Usar dados diversos, algoritmos conscientes de justiça, auditorias regulares e engajamento de partes interessadas para promover resultados equitativos.

Como proteger a privacidade em IA?

Adotar minimização de dados, criptografia, privacidade diferencial, aprendizado federado e práticas de dados transparentes.

Quem é responsável por erros de IA?

Diretrizes claras e estruturas legais são necessárias para atribuir responsabilidade, apoiadas por medidas de accountability.

Como tornar os sistemas de IA seguros?

Usar verificação formal, treinamento adversarial, detecção de anomalias e testes rigorosos para garantir segurança e robustez.

Como a IA pode promover o bem social?

A IA pode abordar desafios de saúde, educação e sustentabilidade, melhorando vidas por meio de soluções éticas.

Perguntas Relacionadas à Ética em IA

Quais são as implicações da IA para a autonomia humana?

A IA pode erodir a autonomia, exigindo transparência, supervisão humana e controle do usuário para manter a agência.

Como integrar a ética no desenvolvimento de IA?

Definir princípios, avaliar riscos, incorporar ética no design, monitorar sistemas e garantir responsabilidade.

Quais desafios existem na governança de IA?

Avanços rápidos, complexidade do sistema e falta de consenso complicam a criação de regulamentações eficazes.

Como preparar para o impacto da IA no trabalho?

Implementar requalificação, criar novos empregos, oferecer redes de segurança e promover aprendizado ao longo da vida para se adaptar às mudanças impulsionadas por IA.

Artigo relacionado

Google Revela Modo AI e Veo 3 para Revolucionar a Pesquisa e a Criação de Vídeos

A Google lançou recentemente o Modo AI e o Veo 3, duas tecnologias inovadoras destinadas a transformar a pesquisa na web e a criação de conteúdo digital. O Modo AI oferece uma experiência de pesquisa

Google Revela Modo AI e Veo 3 para Revolucionar a Pesquisa e a Criação de Vídeos

A Google lançou recentemente o Modo AI e o Veo 3, duas tecnologias inovadoras destinadas a transformar a pesquisa na web e a criação de conteúdo digital. O Modo AI oferece uma experiência de pesquisa

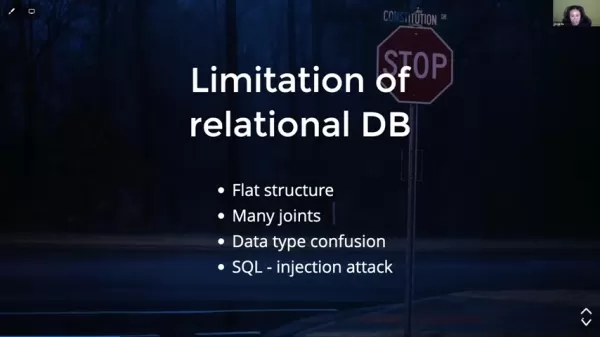

Necessidade Urgente da Indústria de IA por Bancos de Dados de Grafo com Controle de Revisão

O setor de IA está avançando rapidamente, exigindo ferramentas avançadas para gerenciar dados complexos e fluxos de trabalho. Bancos de dados relacionais tradicionais frequentemente não conseguem aten

Necessidade Urgente da Indústria de IA por Bancos de Dados de Grafo com Controle de Revisão

O setor de IA está avançando rapidamente, exigindo ferramentas avançadas para gerenciar dados complexos e fluxos de trabalho. Bancos de dados relacionais tradicionais frequentemente não conseguem aten

Desvendando Amor e Dever em "Sajadah Merah"

A canção "Sajadah Merah" tece uma história comovente de amor, fé e os sacrifícios feitos por família e obrigação. Ela mergulha nas emoções de um homem que amou uma mulher que, devido às circunstâncias

Comentários (0)

0/200

Desvendando Amor e Dever em "Sajadah Merah"

A canção "Sajadah Merah" tece uma história comovente de amor, fé e os sacrifícios feitos por família e obrigação. Ela mergulha nas emoções de um homem que amou uma mulher que, devido às circunstâncias

Comentários (0)

0/200

À medida que a Inteligência Artificial (IA) avança e se integra à vida cotidiana, as considerações éticas em seu desenvolvimento e uso são fundamentais. Este artigo explora aspectos essenciais como transparência, justiça, privacidade, responsabilidade, segurança e o uso da IA para o benefício da sociedade. Compreender essas dimensões é chave para construir confiança, promover inovação responsável e maximizar o potencial da IA enquanto se minimizam os riscos. Vamos navegar pelas complexidades éticas da IA para garantir que ela sirva à humanidade de forma responsável e eficaz.

Principais Conclusões

Transparência e explicabilidade constroem confiança nos sistemas de IA.

Justiça e redução de viés são vitais para prevenir discriminação e promover equidade.

Priorizar privacidade e segurança de dados protege informações sensíveis.

Estruturas de responsabilidade são essenciais para lidar com danos relacionados à IA.

Segurança e robustez da IA previnem consequências não intencionais e garantem confiabilidade.

Usar a IA para o bem social aborda desafios em saúde, educação e além.

Mitigar impactos no mercado de trabalho reduz deslocamento de empregos e desigualdade.

Preservar a autonomia humana mantém a agência e o controle de decisão.

A pesquisa ética em IA exige consideração cuidadosa de benefícios e riscos.

Governança eficaz da IA garante desenvolvimento e implementação responsáveis.

Explorando as Dimensões Éticas da IA

Transparência e Explicabilidade em IA

À medida que os sistemas de IA se tornam mais sofisticados, entender suas operações se torna cada vez mais difícil. Transparência e explicabilidade são cruciais para fomentar confiança e responsabilidade.

Transparência em IA envolve clareza sobre como os sistemas funcionam, incluindo seus dados, algoritmos e processos de tomada de decisão. A explicabilidade garante que as decisões da IA sejam compreensíveis para humanos, permitindo que as partes interessadas entendam o raciocínio por trás dos resultados.

O Papel da IA Explicável (XAI):

A IA Explicável (XAI) desenvolve modelos que humanos podem interpretar, permitindo que as partes interessadas avaliem os fundamentos das decisões, aumentando a confiança e a supervisão. Técnicas principais de XAI incluem:

- Sistemas baseados em regras: Empregam regras claras para decisões transparentes.

- Árvores de decisão: Oferecem caminhos de decisão visuais para maior compreensão.

- Importância de características: Destacam fatores de dados principais que impulsionam previsões do modelo.

Vantagens da Transparência e Explicabilidade:

- Fomentar Confiança: Sistemas claros incentivam a confiança e adoção dos usuários.

- Aumentar Responsabilidade: Compreender operações ajuda a identificar e corrigir erros ou vieses.

- Apoiar Supervisão: A transparência permite que as partes interessadas garantam alinhamento ético.

- Melhorar a Tomada de Decisão: Fundamentos claros fornecem insights para escolhas informadas.

Justiça e Redução de Viés em IA

Sistemas de IA podem perpetuar vieses presentes nos dados de treinamento, levando a resultados injustos. A justiça garante que a IA evite discriminação com base em atributos como raça, gênero ou religião, enquanto a redução de viés aborda desigualdades nos resultados do sistema.

Fontes de Viés em IA:

- Viés Histórico: Reflete vieses sociais nos dados de treinamento.

- Viés de Amostragem: Decorre de amostras de dados não representativas.

- Viés de Medição: Resulta de métodos de medição falhos.

- Viés Algorítmico: Surge do design ou implementação do algoritmo.

Estratégias de Redução de Viés:

- Pré-processamento de Dados: Limpar dados para minimizar vieses.

- Design de Algoritmo: Criar algoritmos focados em justiça.

- Avaliação de Modelo: Usar métricas para avaliar viés e justiça.

- Pós-processamento: Ajustar resultados para reduzir efeitos discriminatórios.

Promovendo Equidade:

- Conjuntos de Dados Diversos: Treinar IA com dados representativos.

- Auditorias de Viés: Verificar regularmente sistemas por comportamentos enviesados.

- Engajamento de Partes Interessadas: Envolver grupos diversos no desenvolvimento.

- Transparência e Responsabilidade: Garantir tomadas de decisão claras e responsáveis.

Privacidade e Segurança de Dados em IA

A IA depende de vastos conjuntos de dados, muitas vezes incluindo informações sensíveis. Proteger a privacidade e garantir a segurança dos dados são cruciais para a confiança do usuário.

A privacidade em IA protege dados pessoais contra acesso ou uso não autorizado, enquanto a segurança de dados previne roubo, perda ou corrupção.

Princípios Fundamentais de Privacidade e Segurança:

- Minimização de Dados: Coletar apenas dados essenciais.

- Limitação de Finalidade: Usar dados apenas para os propósitos pretendidos.

- Segurança de Dados: Aplicar salvaguardas robustas contra acesso não autorizado.

- Transparência: Informar os usuários sobre o uso de dados.

- Controle do Usuário: Permitir que indivíduos gerenciem seus dados.

Técnicas para Privacidade e Segurança:

- Anonimização: Remover dados identificáveis para proteger a privacidade.

- Privacidade Diferencial: Adicionar ruído aos dados para análise sem comprometer identidades.

- Aprendizado Federado: Treinar modelos em dados descentralizados sem compartilhá-los.

- Criptografia: Proteger dados contra acesso não autorizado.

Construindo Confiança através da Privacidade:

- Tecnologias de Melhoria de Privacidade: Proteger dados do usuário com ferramentas avançadas.

- Medidas de Segurança de Dados: Prevenir violações com proteções robustas.

- Conformidade Regulatória: Aderir a leis como GDPR e CCPA.

- Comunicação Clara: Informar os usuários sobre práticas de privacidade.

Responsabilidade e Accountability em IA

Atribuir responsabilidade por erros ou danos causados pela IA é complexo, especialmente com múltiplas partes interessadas envolvidas. Estruturas claras são necessárias para garantir a responsabilidade.

A responsabilidade garante que aqueles que desenvolvem e implementam IA sejam responsáveis por seus impactos, enquanto a responsabilidade foca na gestão ética.

Desafios de Responsabilidade:

- Complexidade do Sistema: Rastrear erros em sistemas de IA intricados é difícil.

- Múltiplas Partes Interessadas: Várias partes estão envolvidas no ciclo de vida da IA.

- Falta de Estruturas Legais: Diretrizes claras de responsabilidade muitas vezes estão ausentes.

Promovendo Responsabilidade:

- Diretrizes Claras: Estabelecer padrões para desenvolvimento e uso de IA.

- Estruturas Legais: Definir responsabilidade por resultados impulsionados por IA.

- Auditoria e Monitoramento: Detectar e abordar erros ou vieses.

- IA Explicável: Usar XAI para esclarecer fundamentos de decisão.

Incentivando Práticas Éticas:

- Treinamento Ético: Educar desenvolvedores sobre princípios éticos.

- Comitês de Revisão Ética: Avaliar projetos de IA quanto a impactos éticos.

- Padrões da Indústria: Estabelecer normas para IA responsável.

- Engajamento de Partes Interessadas: Envolver grupos diversos em avaliações.

Segurança e Robustez da IA

Os sistemas de IA devem ser seguros e resilientes para evitar danos e garantir confiabilidade contra ataques ou erros.

Considerações Chave de Segurança e Robustez:

- Consequências Não Intencionais: Prevenir danos causados por ações da IA.

- Ataques Adversariais: Proteger contra manipulações maliciosas.

- Entradas Inesperadas: Lidar eficazmente com entradas fora da distribuição.

- Confiabilidade do Sistema: Garantir desempenho consistente.

Melhorando Segurança e Robustez:

- Verificação Formal: Usar matemática para confirmar a segurança do sistema.

- Treinamento Adversarial: Treinar sistemas para resistir a ataques.

- Detecção de Anomalias: Identificar e sinalizar entradas incomuns.

- Redundância: Construir sistemas tolerantes a falhas para confiabilidade.

Avançando a Inovação Responsável:

- Pesquisa em Segurança: Investir em estudos de segurança de IA.

- Padrões de Segurança: Desenvolver diretrizes para IA robusta.

- Teste e Validação: Testar sistemas rigorosamente quanto à segurança.

- Monitoramento Contínuo: Acompanhar sistemas para abordar problemas.

IA para o Bem Social

A IA pode enfrentar desafios sociais como saúde, educação e sustentabilidade, melhorando vidas por meio de soluções direcionadas.

Saúde: Melhorar diagnóstico, tratamento e prevenção.

Educação: Personalizar aprendizado e melhorar acesso.

Sustentabilidade Ambiental: Otimizar recursos e reduzir poluição.

Redução da Pobreza: Expandir acesso financeiro e oportunidades de emprego.

Alívio de Desastres: Melhorar preparação e recuperação.

Considerações Éticas para o Bem Social:

- Equidade e Inclusão: Garantir que os benefícios alcancem grupos marginalizados.

- Transparência e Responsabilidade: Manter processos claros de tomada de decisão.

- Privacidade e Segurança: Proteger dados sensíveis.

- Autonomia Humana: Preservar o controle individual.

Promovendo Iniciativas de Bem Social:

- Financiar Pesquisa: Apoiar IA para impacto social.

- Apoiar Startups: Respaldar empreendimentos que abordam questões sociais.

- Parcerias Público-Privadas: Colaborar em soluções impactantes.

- Engajamento de Partes Interessadas: Envolver grupos diversos no desenvolvimento.

Impactos no Trabalho e Emprego

O potencial de automação da IA levanta preocupações sobre deslocamento de empregos e desigualdade, exigindo estratégias proativas para a força de trabalho.

Impactos da IA no Trabalho:

- Deslocamento de Empregos: A automação pode reduzir empregos em alguns setores.

- Criação de Empregos: Novas funções surgem em campos relacionados à IA.

- Brecha de Habilidades: A demanda cresce por habilidades especializadas.

- Desigualdade de Renda: Lacunas se ampliam entre níveis de habilidade.

Mitigando Impactos no Trabalho:

- Programas de Requalificação: Treinar trabalhadores para novas funções.

- Criação de Empregos: Investir em indústrias impulsionadas por IA.

- Redes de Segurança Social: Apoiar trabalhadores deslocados.

- Aprendizado ao Longo da Vida: Promover desenvolvimento contínuo de habilidades.

Garantindo uma Transição Justa:

- Programas de Retreinamento: Ajudar trabalhadores a mudar para novas indústrias.

- Benefícios de Desemprego: Apoiar aqueles afetados pela automação.

- Renda Básica Universal: Explorar redes de segurança para todos.

- Empoderamento dos Trabalhadores: Envolver trabalhadores nas decisões sobre IA.

Preservando a Autonomia Humana

IA avançada pode diminuir o controle humano, tornando essencial manter a agência e o poder de decisão.

A autonomia humana garante que os indivíduos mantenham controle sobre suas escolhas e vidas, evitando influência indevida da IA.

Riscos à Autonomia:

- Manipulação por IA: Sistemas podem influenciar comportamentos sutilmente.

- Dependência Excessiva: Dependência de IA pode enfraquecer o pensamento crítico.

- Perda de Controle: Consequências não intencionais de IA não verificada.

Preservando a Autonomia:

- Transparência: Garantir processos de IA claros e compreensíveis.

- Humano no Ciclo: Exigir supervisão humana em sistemas de IA.

- Controle do Usuário: Permitir optar por não participar de decisões impulsionadas por IA.

- Educação em Pensamento Crítico: Capacitar tomadas de decisão informadas.

Desenvolvimento Ético de IA:

- Valores Humanos: Alinhar IA com o bem-estar social.

- Mitigação de Viés: Prevenir resultados discriminatórios.

- Privacidade de Dados: Proteger informações pessoais.

- Responsabilidade: Responsabilizar desenvolvedores pelas ações da IA.

Pesquisa Ética em IA

A pesquisa responsável em IA equilibra inovação com consideração cuidadosa dos impactos sociais e ambientais.

Princípios de Pesquisa Ética:

- Transparência: Compartilhar descobertas para fomentar colaboração.

- Responsabilidade: Assumir as consequências da pesquisa.

- Beneficência: Maximizar benefícios, minimizar danos.

- Justiça: Garantir que a pesquisa beneficie a todos, incluindo grupos marginalizados.

Promovendo Pesquisa Ética:

- Comitês de Revisão Ética: Avaliar implicações da pesquisa.

- Diretrizes Éticas: Estabelecer padrões para pesquisadores.

- Engajamento de Partes Interessadas: Envolver perspectivas diversas.

- Educação Pública: Informar a sociedade sobre o potencial da IA.

Impulsionando Inovação:

- Pesquisa Aberta: Incentivar compartilhamento de dados para progresso.

- Educação em IA: Treinar uma força de trabalho qualificada.

- Colaboração: Fomentar parcerias entre setores.

- Inovação Ética: Desenvolver soluções para desafios sociais.

Governança e Regulação de IA

Governança robusta e regulamentações são cruciais para abordar preocupações éticas e garantir o desenvolvimento responsável da IA.

Desafios de Governança:

- Avanços Rápidos: Acompanhar o ritmo da IA.

- Complexidade do Sistema: Compreender a ética intricada da IA.

- Falta de Consenso: Concordar sobre padrões éticos.

Estratégias de Governança Eficaz:

- Padrões Éticos: Definir princípios de IA responsável.

- Estruturas Regulatórias: Estabelecer diretrizes legais.

- Comitês Éticos: Fornecer supervisão e orientação.

- Transparência: Exigir processos claros de tomada de decisão.

Construindo Confiança Pública:

- Responsabilidade: Garantir que desenvolvedores sejam responsáveis.

- Direitos Humanos: Proteger liberdades individuais.

- Bem Social: Usar IA para atender às necessidades da sociedade.

- Engajamento Público: Envolver comunidades em discussões de governança.

Exemplo de Estrutura de Governança de IA:

| Componente | Descrição |

|---|---|

| Princípios Éticos | Valores centrais como justiça, transparência e responsabilidade que guiam o desenvolvimento de IA. |

| Diretrizes de Política | Regras detalhando como os sistemas de IA devem ser projetados e implementados. |

| Estrutura Regulatória | Requisitos legais que garantem conformidade ética e proteção de direitos humanos. |

| Mecanismos de Supervisão | Processos para monitoramento e auditoria de IA para uso ético. |

| Medidas de Responsabilidade | Sistemas para responsabilizar desenvolvedores, incluindo penalidades por violações éticas. |

Vantagens da IA Ética

Moldando um Futuro Responsável para a IA

Abordar a ética da IA é crucial para criar um futuro onde a IA beneficie a humanidade de forma responsável. Priorizar a ética desbloqueia o potencial da IA enquanto minimiza riscos. Benefícios principais incluem:

- Construir Confiança: Práticas éticas aumentam a confiança das partes interessadas, impulsionando a adoção da IA.

- Fomentar Inovação: Considerações éticas estimulam inovação alinhada a valores, aumentando a competitividade.

- Promover Equidade: IA ética reduz vieses, garantindo resultados justos para todos.

- Melhorar Transparência: Processos claros aumentam a responsabilidade e a confiança.

- Proteger Direitos: IA ética salvaguarda a dignidade e a autonomia humana.

- Incentivar Colaboração: Valores éticos compartilhados unem as partes interessadas para uma IA responsável.

Em última análise, a IA ética é uma necessidade moral e estratégica, garantindo um futuro onde a IA melhora o bem-estar humano.

Guia para o Desenvolvimento Ético de IA

Passo 1: Definir Princípios Éticos

Comece definindo princípios éticos claros que reflitam os valores organizacionais e as normas sociais, desenvolvidos com a contribuição de diversas partes interessadas.

Princípios principais:

- Justiça: Garantir tratamento equitativo sem viés.

- Transparência: Tornar os processos de IA claros para as partes interessadas.

- Responsabilidade: Atribuir responsabilidade pelas ações da IA.

- Privacidade: Proteger dados pessoais.

- Segurança: Projetar sistemas para prevenir danos.

Passo 2: Avaliar Riscos Éticos

Realizar avaliações de risco abrangentes para identificar preocupações éticas, envolvendo especialistas em ética, direito e IA.

Áreas de risco:

- Viés: Detectar vieses em dados e algoritmos.

- Discriminação: Avaliar riscos de tratamento injusto.

- Violações de Privacidade: Avaliar riscos de uso indevido de dados.

- Ameaças de Segurança: Identificar vulnerabilidades a ataques.

- Consequências Não Intencionais: Considerar danos potenciais.

Passo 3: Incorporar Ética no Design

Incorporar considerações éticas no design da IA desde o início, priorizando justiça, transparência e responsabilidade.

Abordagens de design:

- Algoritmos Conscientes de Justiça: Promover resultados equitativos.

- IA Explicável: Usar XAI para decisões compreensíveis.

- Tecnologias de Privacidade: Proteger dados do usuário.

- Supervisão Humana: Exigir intervenção humana em IA.

- Ferramentas de Transparência: Informar usuários sobre o uso de dados.

Passo 4: Monitorar e Auditar Sistemas

Implementar monitoramento e auditoria para detectar problemas éticos, garantindo conformidade com princípios e regulamentações.

Práticas:

- Monitoramento de Desempenho: Acompanhar métricas para viés.

- Auditoria de Dados: Verificar dados quanto a vieses.

- Transparência de Algoritmo: Monitorar algoritmos quanto à ética.

- Feedback do Usuário: Coletar entrada sobre preocupações éticas.

- Conformidade: Garantir adesão aos padrões éticos.

Passo 5: Garantir Responsabilidade

Estabelecer responsabilidade clara pelas ações da IA, com mecanismos de relatórios para abordar preocupações éticas prontamente.

Medidas:

- Oficial de Ética: Supervisionar práticas éticas.

- Comitê de Revisão: Avaliar a ética de projetos de IA.

- Canais de Relatório: Habilitar feedback das partes interessadas.

- Proteção a Denunciantes: Proteger aqueles que relatam problemas.

- Sanções: Penalizar violações éticas.

Prós e Contras da Ética em IA

Prós

Maior confiança e adoção de sistemas de IA

Responsabilidade e clareza aprimoradas nas decisões

Redução de viés e resultados mais justos

Proteções mais fortes para privacidade e segurança de dados

Maior foco em IA para benefício social

Contras

Maiores custos e tempo de desenvolvimento

Complexidade em aplicar diretrizes éticas

Equilíbrio entre ética e inovação

Desafios em concordar sobre padrões éticos

Riscos de resultados éticos não intencionais

Perguntas Frequentes sobre Ética em IA

Quais são as principais preocupações éticas em IA?

Preocupações principais incluem transparência, justiça, privacidade, responsabilidade e segurança, todos cruciais para o uso responsável da IA.

Como garantir justiça em IA?

Usar dados diversos, algoritmos conscientes de justiça, auditorias regulares e engajamento de partes interessadas para promover resultados equitativos.

Como proteger a privacidade em IA?

Adotar minimização de dados, criptografia, privacidade diferencial, aprendizado federado e práticas de dados transparentes.

Quem é responsável por erros de IA?

Diretrizes claras e estruturas legais são necessárias para atribuir responsabilidade, apoiadas por medidas de accountability.

Como tornar os sistemas de IA seguros?

Usar verificação formal, treinamento adversarial, detecção de anomalias e testes rigorosos para garantir segurança e robustez.

Como a IA pode promover o bem social?

A IA pode abordar desafios de saúde, educação e sustentabilidade, melhorando vidas por meio de soluções éticas.

Perguntas Relacionadas à Ética em IA

Quais são as implicações da IA para a autonomia humana?

A IA pode erodir a autonomia, exigindo transparência, supervisão humana e controle do usuário para manter a agência.

Como integrar a ética no desenvolvimento de IA?

Definir princípios, avaliar riscos, incorporar ética no design, monitorar sistemas e garantir responsabilidade.

Quais desafios existem na governança de IA?

Avanços rápidos, complexidade do sistema e falta de consenso complicam a criação de regulamentações eficazes.

Como preparar para o impacto da IA no trabalho?

Implementar requalificação, criar novos empregos, oferecer redes de segurança e promover aprendizado ao longo da vida para se adaptar às mudanças impulsionadas por IA.

Necessidade Urgente da Indústria de IA por Bancos de Dados de Grafo com Controle de Revisão

O setor de IA está avançando rapidamente, exigindo ferramentas avançadas para gerenciar dados complexos e fluxos de trabalho. Bancos de dados relacionais tradicionais frequentemente não conseguem aten

Necessidade Urgente da Indústria de IA por Bancos de Dados de Grafo com Controle de Revisão

O setor de IA está avançando rapidamente, exigindo ferramentas avançadas para gerenciar dados complexos e fluxos de trabalho. Bancos de dados relacionais tradicionais frequentemente não conseguem aten

Desvendando Amor e Dever em "Sajadah Merah"

A canção "Sajadah Merah" tece uma história comovente de amor, fé e os sacrifícios feitos por família e obrigação. Ela mergulha nas emoções de um homem que amou uma mulher que, devido às circunstâncias

Desvendando Amor e Dever em "Sajadah Merah"

A canção "Sajadah Merah" tece uma história comovente de amor, fé e os sacrifícios feitos por família e obrigação. Ela mergulha nas emoções de um homem que amou uma mulher que, devido às circunstâncias