Flutterflowを使用してAIサウンドFXジェネレーターを構築し、複製します

AIの力を活用して独自のサウンドエフェクトを作成する方法を考えたことはありますか?このチュートリアルでは、ノーコードプラットフォームを使用してAI駆動のサウンドエフェクトジェネレーターを構築する手順を説明します。具体的には、ユーザーインターフェースにFlutterFlowを、AIモデルホスティングにReplicateを組み合わせます。これらの手順に従うことで、テキストプロンプトからユニークなサウンドエフェクトをすぐに生成できるようになります。

主なポイント

- AI駆動のサウンドエフェクトジェネレーターを作成する。

- ユーザーインターフェース設計にFlutterFlowを使用する。

- AIモデルホスティングと実行にReplicateを統合する。

- 迅速な開発のためにノーコードアプローチを採用する。

- テキストプロンプトからユニークなサウンドエフェクトを生成する。

AIサウンドエフェクトジェネレーターの作成:ノーコードチュートリアル

AIサウンドエフェクト生成の概要

人工知能は、ビデオからオーディオまで、コンテンツ作成の世界を革新しています。その中でも特に魅力的な応用例の一つがサウンドデザインで、AIは簡単なテキスト記述をリッチなサウンドエフェクトに変換できます。これにより、開発者と趣味人双方にとって創造的な可能性が広がります。ノーコードプラットフォームとAIホスティングサービスを活用することで、深い技術スキルがなくても強力なツールを作成できます。

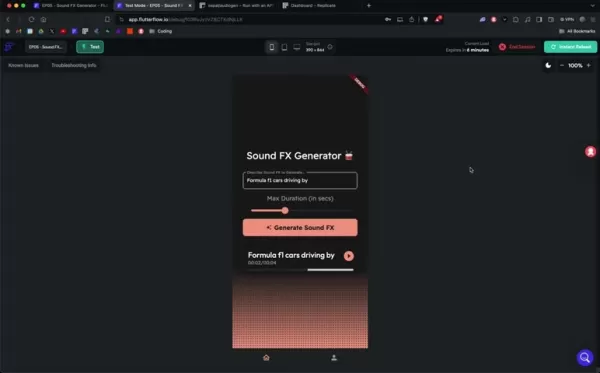

このチュートリアルでは、ユーザーインターフェースにFlutterFlowを、AIモデルの実行にReplicateを使用して、サウンドエフェクトジェネレーターを構築するプロセスを説明します。

FlutterFlowの理解:ノーコードUIビルダー

FlutterFlowは、コードに深く踏み込まずにモバイルおよびウェブアプリケーションを設計したい人にとって革新的なツールです。ビジュアルにユーザーインターフェースを構築し、インタラクションを定義し、外部データソースに接続できるローコードプラットフォームです。ドラッグアンドドロップのコンポーネント、事前構築されたテンプレート、Firebaseとのシームレスな統合などの機能を備えており、FlutterFlowはアプリ開発をより迅速かつアクセスしやすくします。AI駆動のサウンドエフェクトジェネレーターのフロントエンドを構築するのに最適なツールです。FlutterFlowの設計機能とReplicateのAI能力を組み合わせることで、革新的なアプリケーションを迅速かつ効率的に構築できます。

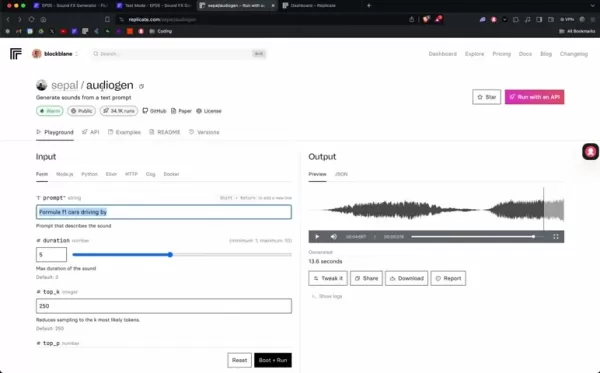

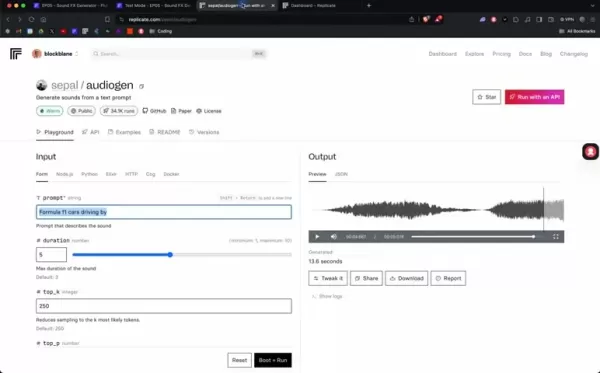

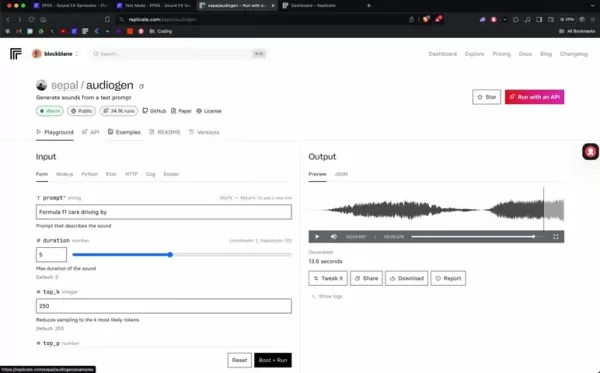

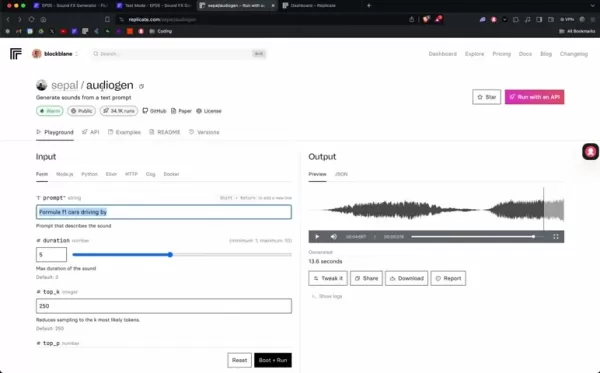

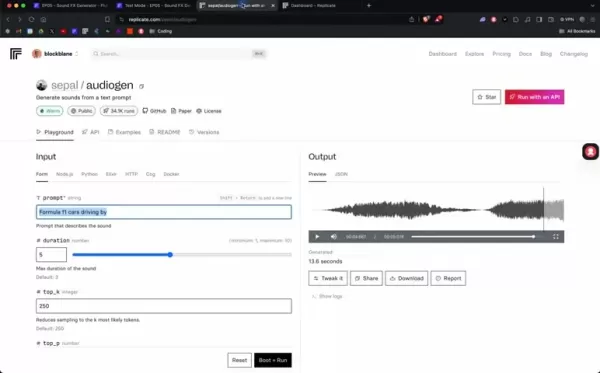

Replicate:AIモデルホスティングと実行

Replicateは、クラウドでAIモデルを実行およびデプロイすることを簡単にします。SepalのAudiogenを含むさまざまな事前トレーニング済みAIモデルにアクセスできるプラットフォームを提供します。Replicateは、サーバーやインフラストラクチャの管理の手間を省き、アプリケーションのロジックとユーザーエクスペリエンスに集中できるようにします。

APIトークンを使用することで、Replicate APIにアクセスし、アプリケーションでのオーディオ生成を強化できます。

必要なコンポーネント:FlutterFlowとReplicateの統合

AIサウンドエフェクトジェネレーターを始めるには、FlutterFlowとReplicateの両方をセットアップする必要があります。これには、アカウントの作成とそのインターフェースに慣れることが含まれます。準備方法は以下の通りです:

- flutterflow.ioでFlutterFlowアカウントにサインアップする。

- replicate.comでReplicateアカウントを作成する。

- Replicateアカウント設定からAPIトークンを生成する。

これらの手順を完了すると、UIデザインとAIモデル実行を組み合わせ、ユニークなサウンドエフェクトジェネレーターの開発を始める準備が整います。

サウンドエフェクトジェネレーター構築のステップごとのガイド

以下の手順に従ってサウンドエフェクトジェネレーターを構築します:

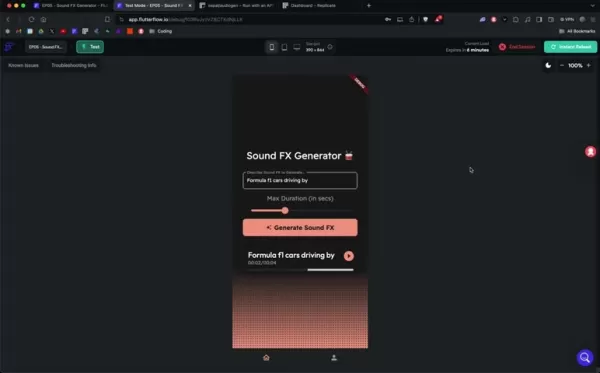

- ユーザーインターフェースの設計: FlutterFlowのドラッグアンドドロップインターフェースを使用して、直感的なUIを作成します。プロンプト用のテキスト入力フィールドや持続時間用のスライダーなどの要素を含めます。

- テキスト入力の設定: ユーザーが生成したいサウンドエフェクトを記述できるテキストフィールドを設定します。このフィールドがシステムに適切に接続されていることを確認します。

- 持続時間スライダーの追加: ユーザーがサウンドエフェクトの長さを指定できるスライダーを含めます。必要に応じて設定をカスタマイズします。

- 生成ボタンの実装: ReplicateでのAIモデル実行をトリガーするボタンを作成します。このボタンはAPI呼び出しを開始します。

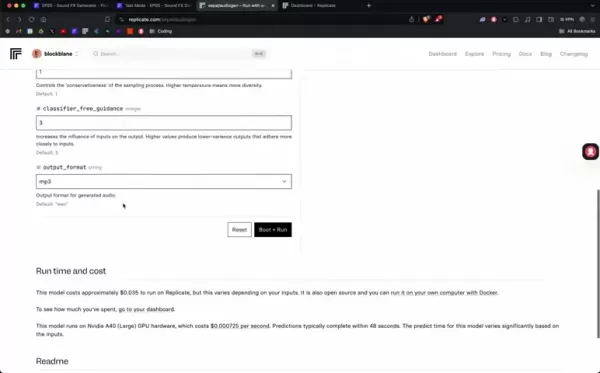

- Replicate APIの統合: Replicate APIを使用して、テキストプロンプトと持続時間パラメータをAIモデルに送信します。FlutterFlowのカスタム関数機能を使用してこれらのAPIリクエストを処理します。

- API呼び出しの作成: FlutterFlowの設定メニューにある「API Calls」セクションに移動し、ReplicateへのAPI呼び出しを設定します。ヘッダー、ボディ、変数をAPI標準に従って設定します。

- サウンドエフェクトの受信と再生: AIモデルがサウンドエフェクトを生成したら、それを取得し、FlutterFlowのオーディオプレーヤーコンポーネントを使用してユーザーに再生します。

アプリケーションの微調整とテスト

コアコンポーネントを設定した後、ユーザーエクスペリエンスを微調整し、機能性をテストする時間です。デバッグと公開後のスムーズな動作を確保するために、テストは重要です。UI要素を調整し、APIパラメータを洗練し、さまざまなデバイスでテストして最適なパフォーマンスを確保します。FlutterFlowとReplicateのデバッグツールを使用して問題を特定し解決します。最後に、ユーザーからのフィードバックとパフォーマンスデータに基づいてアプリケーションを最適化します。

- テストとデバッグの結果に基づいてUIデザインを洗練する。

- ReplicateとのAI統合を最適化して、遅延を減らし速度を向上させる。

- さまざまなデバイスとネットワーク構成でアプリケーションを徹底的にテストする。

サウンドエフェクトジェネレーターを強化する追加機能

サウンドエフェクトジェネレーターをさらに魅力的にするために、以下の追加機能を検討してください:

- プリセットサウンドエフェクト: ユーザーが選択できるプリセットサウンドエフェクトのセットを提供する。

- ダウンロードオプション: 生成したサウンドエフェクトをダウンロードできるようにする。

- カテゴリベースのサウンド: ナビゲーションを容易にするためにサウンドを異なるカテゴリに整理する。

- カスタマイズ可能なパラメータ: テンポなどのサウンドエフェクトパラメータをより細かく制御できるようにする。

AIサウンドジェネレーター使用時の主な考慮事項

倫理的かつ責任ある使用

AI生成コンテンツを扱う際には、倫理的考慮が重要です。常に著作権法を確認し、ライセンス契約を尊重してください。オーディオ生成に関連する可能性のある規制に注意してください。透明性が重要です—サウンドエフェクトがAI生成であることをユーザーに知らせます。また、トレーニングデータに存在する可能性のあるバイアスに留意し、それが生成されるサウンドに影響を与える可能性があります。適切なガバナンスとデータ使用ポリシーは、AIサウンド生成が法律、倫理、ユーザー同意を尊重することを保証するために不可欠です。生成AI技術が進化するにつれて、倫理的要件を満たし、責任あるAIツールを構築するために慣行を適応させてください。

replicate.comの使用方法

Replicateでモデルを実行する

Replicateは、使いやすいインターフェースを通じてクラウドでモデルを実行することを簡単にします。

これにより、どこからでもさまざまなプログラミング言語でモデルを実行できます。

テキストプロンプトからサウンドを生成する

Audiogenを使用すると、テキストプロンプトからサウンドを生成できます。希望するサウンドと持続時間を指定するだけで、Audiogen AIが残りを処理します。Replicateではアカウントを作成し、ローカルコードを実行せずにAudiogenモデルを実行してオーディオを生成できます。

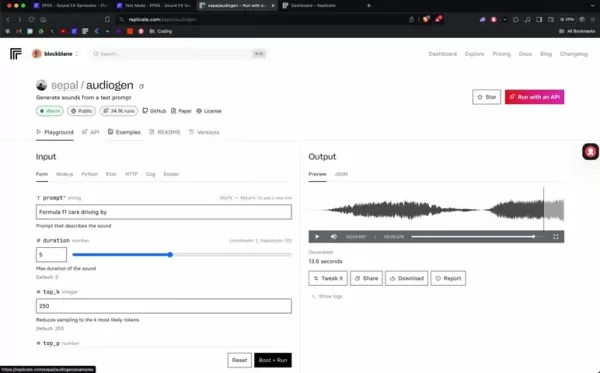

例を見る

Audiogenモデルを成功裏に使用するために、replicate.comでは「examples」タブの下に一連の例を提供しています。これらはコードスニペットの形式で提供され、作成物を微調整するのに役立ちます。

AIサウンドエフェクトジェネレーター:メリットとデメリットの比較

メリット

- 速度と効率: 迅速なサウンドエフェクト生成で時間を節約。

- コスト効率: 広範な手動サウンドデザインの必要性を軽減。

- アクセシビリティ: サウンドデザインを非専門家にも利用可能にする。

- カスタマイズ: テキストプロンプトにより高度にカスタマイズされたサウンドエフェクトが可能。

- スケーラビリティ: さまざまなプロジェクト要件に合わせて多様なサウンドを簡単に生成。

デメリット

- 品質のバラつき: 出力品質は変動し、反復的な改良が必要な場合がある。

- AIモデルへの依存: 基盤となるAIの正確性と能力に依存。

- 倫理的考慮: 著作権とライセンス問題に注意が必要。

- 制御の制限: 手動方法に比べてサウンドデザインの直接的な制御が少ない。

- バイアスの可能性: AIがトレーニングデータのバイアスを反映したサウンドを生成する可能性がある。

FAQ

FlutterFlowとは何ですか?

FlutterFlowは、集中的なコーディングなしでUIデザインを簡素化するローコードプラットフォームです。ドラッグアンドドロップインターフェースと事前構築されたテンプレートにより、アプリ開発が迅速かつ簡単になります。

Replicateとは何ですか?

Replicateは、APIを提供することでAIモデルの実行とデプロイを簡素化します。開発者はバックエンドインフラストラクチャを気にせずにAI機能を活用できます。

SepalのAudiogenとは何ですか?

Audiogenは、Sepalによって開発されたテキストからオーディオへのモデルです。テキストプロンプトに基づいてサウンドエフェクトを生成します。

FlutterFlowでAPI呼び出しをテストする方法は?

FlutterFlowで「API Calls」セクションに移動し、「Response & Test」タブを選択します。ここで、各変数に正しい値を挿入し、「Test API Call」を押してAPI呼び出しをテストできます。

関連する質問

他にどのようなノーコードAIツールが利用可能ですか?

AI駆動のサウンドエフェクトジェネレーターを作成するのに役立つさまざまなノーコードAIツールがあります。AIサービスとAPIがノーコードプラットフォームと互換性が高まるにつれて、選択肢が拡大しています。これには、自然言語からコードを生成するツールや、AIモデル作成のためのビジュアルプログラミングツールが含まれ、特にFlutterFlowのようなUI開発プラットフォームと統合すると開発がさらにアクセスしやすくなります。

より良いサウンドエフェクトを得るためにプロンプトを最適化するには?

AIモデルから最適な結果を得るには、プロンプトは具体的、明確、簡潔である必要があります。さまざまなプロンプト、持続時間、パラメータ設定を試してください。反復的なテストとユーザーからのフィードバックは、プロンプトを時間とともに洗練するのに役立ちます。AIコミュニケーションのベストプラクティスに従うことで、高品質な結果を得られます。オーディオ作成では、特定のサウンドの種類、希望する雰囲気、使用したい楽器を含めることを検討してください。

AIサウンドエフェクトジェネレーターの制限は何ですか?

AI生成のサウンドエフェクトには、品質のバラつきや潜在的な著作権問題などの特定の制限があります。品質を向上させるには、プロンプトを最適化し、ライセンスと著作権に常に留意してください。技術が進化するにつれて、これらの制限の一部は解消される可能性がありますが、AIサウンドジェネレーターは人間のサウンドデザイナーの創造性を完全に再現することはできず、依然として一定の限界があります。

関連記事

DeepSeek Code、まもなくリリースへ

AI技術の進展が加速する中、DeepSeekは今、まさに刺激的な転換点を迎えています。同社は最近、700億元を超える資金調達に成功したことを明らかにしました。経営陣は、目先の商業的利益よりも、画期的なAI研究への取り組みを重視する姿勢を強調しています。この戦略的転換は、新製品、とりわけ待望の「DeepSeek Code」の開発に全力を注ぐというDeepSeekの決意を示しています。DeepSeek

DeepSeek Code、まもなくリリースへ

AI技術の進展が加速する中、DeepSeekは今、まさに刺激的な転換点を迎えています。同社は最近、700億元を超える資金調達に成功したことを明らかにしました。経営陣は、目先の商業的利益よりも、画期的なAI研究への取り組みを重視する姿勢を強調しています。この戦略的転換は、新製品、とりわけ待望の「DeepSeek Code」の開発に全力を注ぐというDeepSeekの決意を示しています。DeepSeek

マスク氏の「Grok」:1.5兆のパラメータとカーソルコードの統合――ゲームチェンジャーか、それともブラフか?

イーロン・マスクがついに動き出した。AI開発競争において、OpenAIとAnthropicは加速している一方、xAIは出遅れているようだ。マスクはたびたび「Claude」に対抗する意向を表明してきたが、Grok4.Xシリーズへの度重なるアップデートにもかかわらず、結果は理論上は良好に見えても実用面では不十分であり、その差はほとんど縮まっていない。しかし、今回、彼には新たな切り札がある。マスクはX(

マスク氏の「Grok」:1.5兆のパラメータとカーソルコードの統合――ゲームチェンジャーか、それともブラフか?

イーロン・マスクがついに動き出した。AI開発競争において、OpenAIとAnthropicは加速している一方、xAIは出遅れているようだ。マスクはたびたび「Claude」に対抗する意向を表明してきたが、Grok4.Xシリーズへの度重なるアップデートにもかかわらず、結果は理論上は良好に見えても実用面では不十分であり、その差はほとんど縮まっていない。しかし、今回、彼には新たな切り札がある。マスクはX(

OpenAI、アルトマン氏の解任を困難にするため、密かに定款を変更

2023年のクーデターのような事態を受けて、OpenAIは定款を改定し、サム・アルトマンCEOに対する保護措置をさらに強化した。最近公開された裁判文書によると、アルトマン氏の地位は今や揺るぎないものとなっており、外部からの干渉や、取締役会による解任の動きに対する障壁が大幅に高まっている。イーロン・マスクがOpenAIを相手取った訴訟における専門家証人は、これらの変更が同社が営利モデルへ移行する過程

関連特集おすすめ

コメント (16)

0/500

OpenAI、アルトマン氏の解任を困難にするため、密かに定款を変更

2023年のクーデターのような事態を受けて、OpenAIは定款を改定し、サム・アルトマンCEOに対する保護措置をさらに強化した。最近公開された裁判文書によると、アルトマン氏の地位は今や揺るぎないものとなっており、外部からの干渉や、取締役会による解任の動きに対する障壁が大幅に高まっている。イーロン・マスクがOpenAIを相手取った訴訟における専門家証人は、これらの変更が同社が営利モデルへ移行する過程

関連特集おすすめ

コメント (16)

0/500

![MatthewGonzalez]()

Que ideia incrível! Já imaginou como isso pode mudar o desenvolvimento de jogos independentes? Em vez de depender de bibliotecas caras ou gravações caseiras, você pode gerar efeitos sonoros sob medida em minutos. A parte mais interessante pra mim é a combinação FlutterFlow + Replicate - mostra como plataformas no-code estão ficando sofisticadas o suficiente para integrações complexas com IA. Será que em breve teremos 'produtores de som' baseados em IA substituindo algumas funções técnicas? 🎮🔊

![NicholasSanchez]()

와..플러터플로우로 AI 음향 효과 생성기 만들기라니 진짜 신기하네요! 🎵 이런 튜토리얼을 찾고 있었는데 운이 좋아요. 리플리케이트랑 연동하는 부분도 궁금했거든요. 주말에 꼭 따라해봐야겠어요 😆

![GregoryRodriguez]()

This tutorial is a game-changer for indie devs! 🎮 Finally a practical way to create custom SFX without expensive tools or coding nightmares. Though I wonder if the AI-generated sounds will have that 'human touch' missing in procedural audio...

![GeorgeMiller]()

This is so cool! I had no idea you could make AI sound effects with no-code tools like FlutterFlow. Gonna try this out for my game project! 🎮

AIの力を活用して独自のサウンドエフェクトを作成する方法を考えたことはありますか?このチュートリアルでは、ノーコードプラットフォームを使用してAI駆動のサウンドエフェクトジェネレーターを構築する手順を説明します。具体的には、ユーザーインターフェースにFlutterFlowを、AIモデルホスティングにReplicateを組み合わせます。これらの手順に従うことで、テキストプロンプトからユニークなサウンドエフェクトをすぐに生成できるようになります。

主なポイント

- AI駆動のサウンドエフェクトジェネレーターを作成する。

- ユーザーインターフェース設計にFlutterFlowを使用する。

- AIモデルホスティングと実行にReplicateを統合する。

- 迅速な開発のためにノーコードアプローチを採用する。

- テキストプロンプトからユニークなサウンドエフェクトを生成する。

AIサウンドエフェクトジェネレーターの作成:ノーコードチュートリアル

AIサウンドエフェクト生成の概要

人工知能は、ビデオからオーディオまで、コンテンツ作成の世界を革新しています。その中でも特に魅力的な応用例の一つがサウンドデザインで、AIは簡単なテキスト記述をリッチなサウンドエフェクトに変換できます。これにより、開発者と趣味人双方にとって創造的な可能性が広がります。ノーコードプラットフォームとAIホスティングサービスを活用することで、深い技術スキルがなくても強力なツールを作成できます。

このチュートリアルでは、ユーザーインターフェースにFlutterFlowを、AIモデルの実行にReplicateを使用して、サウンドエフェクトジェネレーターを構築するプロセスを説明します。

FlutterFlowの理解:ノーコードUIビルダー

FlutterFlowは、コードに深く踏み込まずにモバイルおよびウェブアプリケーションを設計したい人にとって革新的なツールです。ビジュアルにユーザーインターフェースを構築し、インタラクションを定義し、外部データソースに接続できるローコードプラットフォームです。ドラッグアンドドロップのコンポーネント、事前構築されたテンプレート、Firebaseとのシームレスな統合などの機能を備えており、FlutterFlowはアプリ開発をより迅速かつアクセスしやすくします。AI駆動のサウンドエフェクトジェネレーターのフロントエンドを構築するのに最適なツールです。FlutterFlowの設計機能とReplicateのAI能力を組み合わせることで、革新的なアプリケーションを迅速かつ効率的に構築できます。

Replicate:AIモデルホスティングと実行

Replicateは、クラウドでAIモデルを実行およびデプロイすることを簡単にします。SepalのAudiogenを含むさまざまな事前トレーニング済みAIモデルにアクセスできるプラットフォームを提供します。Replicateは、サーバーやインフラストラクチャの管理の手間を省き、アプリケーションのロジックとユーザーエクスペリエンスに集中できるようにします。

APIトークンを使用することで、Replicate APIにアクセスし、アプリケーションでのオーディオ生成を強化できます。

必要なコンポーネント:FlutterFlowとReplicateの統合

AIサウンドエフェクトジェネレーターを始めるには、FlutterFlowとReplicateの両方をセットアップする必要があります。これには、アカウントの作成とそのインターフェースに慣れることが含まれます。準備方法は以下の通りです:

- flutterflow.ioでFlutterFlowアカウントにサインアップする。

- replicate.comでReplicateアカウントを作成する。

- Replicateアカウント設定からAPIトークンを生成する。

これらの手順を完了すると、UIデザインとAIモデル実行を組み合わせ、ユニークなサウンドエフェクトジェネレーターの開発を始める準備が整います。

サウンドエフェクトジェネレーター構築のステップごとのガイド

以下の手順に従ってサウンドエフェクトジェネレーターを構築します:

- ユーザーインターフェースの設計: FlutterFlowのドラッグアンドドロップインターフェースを使用して、直感的なUIを作成します。プロンプト用のテキスト入力フィールドや持続時間用のスライダーなどの要素を含めます。

- テキスト入力の設定: ユーザーが生成したいサウンドエフェクトを記述できるテキストフィールドを設定します。このフィールドがシステムに適切に接続されていることを確認します。

- 持続時間スライダーの追加: ユーザーがサウンドエフェクトの長さを指定できるスライダーを含めます。必要に応じて設定をカスタマイズします。

- 生成ボタンの実装: ReplicateでのAIモデル実行をトリガーするボタンを作成します。このボタンはAPI呼び出しを開始します。

- Replicate APIの統合: Replicate APIを使用して、テキストプロンプトと持続時間パラメータをAIモデルに送信します。FlutterFlowのカスタム関数機能を使用してこれらのAPIリクエストを処理します。

- API呼び出しの作成: FlutterFlowの設定メニューにある「API Calls」セクションに移動し、ReplicateへのAPI呼び出しを設定します。ヘッダー、ボディ、変数をAPI標準に従って設定します。

- サウンドエフェクトの受信と再生: AIモデルがサウンドエフェクトを生成したら、それを取得し、FlutterFlowのオーディオプレーヤーコンポーネントを使用してユーザーに再生します。

アプリケーションの微調整とテスト

コアコンポーネントを設定した後、ユーザーエクスペリエンスを微調整し、機能性をテストする時間です。デバッグと公開後のスムーズな動作を確保するために、テストは重要です。UI要素を調整し、APIパラメータを洗練し、さまざまなデバイスでテストして最適なパフォーマンスを確保します。FlutterFlowとReplicateのデバッグツールを使用して問題を特定し解決します。最後に、ユーザーからのフィードバックとパフォーマンスデータに基づいてアプリケーションを最適化します。

- テストとデバッグの結果に基づいてUIデザインを洗練する。

- ReplicateとのAI統合を最適化して、遅延を減らし速度を向上させる。

- さまざまなデバイスとネットワーク構成でアプリケーションを徹底的にテストする。

サウンドエフェクトジェネレーターを強化する追加機能

サウンドエフェクトジェネレーターをさらに魅力的にするために、以下の追加機能を検討してください:

- プリセットサウンドエフェクト: ユーザーが選択できるプリセットサウンドエフェクトのセットを提供する。

- ダウンロードオプション: 生成したサウンドエフェクトをダウンロードできるようにする。

- カテゴリベースのサウンド: ナビゲーションを容易にするためにサウンドを異なるカテゴリに整理する。

- カスタマイズ可能なパラメータ: テンポなどのサウンドエフェクトパラメータをより細かく制御できるようにする。

AIサウンドジェネレーター使用時の主な考慮事項

倫理的かつ責任ある使用

AI生成コンテンツを扱う際には、倫理的考慮が重要です。常に著作権法を確認し、ライセンス契約を尊重してください。オーディオ生成に関連する可能性のある規制に注意してください。透明性が重要です—サウンドエフェクトがAI生成であることをユーザーに知らせます。また、トレーニングデータに存在する可能性のあるバイアスに留意し、それが生成されるサウンドに影響を与える可能性があります。適切なガバナンスとデータ使用ポリシーは、AIサウンド生成が法律、倫理、ユーザー同意を尊重することを保証するために不可欠です。生成AI技術が進化するにつれて、倫理的要件を満たし、責任あるAIツールを構築するために慣行を適応させてください。

replicate.comの使用方法

Replicateでモデルを実行する

Replicateは、使いやすいインターフェースを通じてクラウドでモデルを実行することを簡単にします。

これにより、どこからでもさまざまなプログラミング言語でモデルを実行できます。

テキストプロンプトからサウンドを生成する

Audiogenを使用すると、テキストプロンプトからサウンドを生成できます。希望するサウンドと持続時間を指定するだけで、Audiogen AIが残りを処理します。Replicateではアカウントを作成し、ローカルコードを実行せずにAudiogenモデルを実行してオーディオを生成できます。

例を見る

Audiogenモデルを成功裏に使用するために、replicate.comでは「examples」タブの下に一連の例を提供しています。これらはコードスニペットの形式で提供され、作成物を微調整するのに役立ちます。

AIサウンドエフェクトジェネレーター:メリットとデメリットの比較

メリット

- 速度と効率: 迅速なサウンドエフェクト生成で時間を節約。

- コスト効率: 広範な手動サウンドデザインの必要性を軽減。

- アクセシビリティ: サウンドデザインを非専門家にも利用可能にする。

- カスタマイズ: テキストプロンプトにより高度にカスタマイズされたサウンドエフェクトが可能。

- スケーラビリティ: さまざまなプロジェクト要件に合わせて多様なサウンドを簡単に生成。

デメリット

- 品質のバラつき: 出力品質は変動し、反復的な改良が必要な場合がある。

- AIモデルへの依存: 基盤となるAIの正確性と能力に依存。

- 倫理的考慮: 著作権とライセンス問題に注意が必要。

- 制御の制限: 手動方法に比べてサウンドデザインの直接的な制御が少ない。

- バイアスの可能性: AIがトレーニングデータのバイアスを反映したサウンドを生成する可能性がある。

FAQ

FlutterFlowとは何ですか?

FlutterFlowは、集中的なコーディングなしでUIデザインを簡素化するローコードプラットフォームです。ドラッグアンドドロップインターフェースと事前構築されたテンプレートにより、アプリ開発が迅速かつ簡単になります。

Replicateとは何ですか?

Replicateは、APIを提供することでAIモデルの実行とデプロイを簡素化します。開発者はバックエンドインフラストラクチャを気にせずにAI機能を活用できます。

SepalのAudiogenとは何ですか?

Audiogenは、Sepalによって開発されたテキストからオーディオへのモデルです。テキストプロンプトに基づいてサウンドエフェクトを生成します。

FlutterFlowでAPI呼び出しをテストする方法は?

FlutterFlowで「API Calls」セクションに移動し、「Response & Test」タブを選択します。ここで、各変数に正しい値を挿入し、「Test API Call」を押してAPI呼び出しをテストできます。

関連する質問

他にどのようなノーコードAIツールが利用可能ですか?

AI駆動のサウンドエフェクトジェネレーターを作成するのに役立つさまざまなノーコードAIツールがあります。AIサービスとAPIがノーコードプラットフォームと互換性が高まるにつれて、選択肢が拡大しています。これには、自然言語からコードを生成するツールや、AIモデル作成のためのビジュアルプログラミングツールが含まれ、特にFlutterFlowのようなUI開発プラットフォームと統合すると開発がさらにアクセスしやすくなります。

より良いサウンドエフェクトを得るためにプロンプトを最適化するには?

AIモデルから最適な結果を得るには、プロンプトは具体的、明確、簡潔である必要があります。さまざまなプロンプト、持続時間、パラメータ設定を試してください。反復的なテストとユーザーからのフィードバックは、プロンプトを時間とともに洗練するのに役立ちます。AIコミュニケーションのベストプラクティスに従うことで、高品質な結果を得られます。オーディオ作成では、特定のサウンドの種類、希望する雰囲気、使用したい楽器を含めることを検討してください。

AIサウンドエフェクトジェネレーターの制限は何ですか?

AI生成のサウンドエフェクトには、品質のバラつきや潜在的な著作権問題などの特定の制限があります。品質を向上させるには、プロンプトを最適化し、ライセンスと著作権に常に留意してください。技術が進化するにつれて、これらの制限の一部は解消される可能性がありますが、AIサウンドジェネレーターは人間のサウンドデザイナーの創造性を完全に再現することはできず、依然として一定の限界があります。

DeepSeek Code、まもなくリリースへ

AI技術の進展が加速する中、DeepSeekは今、まさに刺激的な転換点を迎えています。同社は最近、700億元を超える資金調達に成功したことを明らかにしました。経営陣は、目先の商業的利益よりも、画期的なAI研究への取り組みを重視する姿勢を強調しています。この戦略的転換は、新製品、とりわけ待望の「DeepSeek Code」の開発に全力を注ぐというDeepSeekの決意を示しています。DeepSeek

DeepSeek Code、まもなくリリースへ

AI技術の進展が加速する中、DeepSeekは今、まさに刺激的な転換点を迎えています。同社は最近、700億元を超える資金調達に成功したことを明らかにしました。経営陣は、目先の商業的利益よりも、画期的なAI研究への取り組みを重視する姿勢を強調しています。この戦略的転換は、新製品、とりわけ待望の「DeepSeek Code」の開発に全力を注ぐというDeepSeekの決意を示しています。DeepSeek

マスク氏の「Grok」:1.5兆のパラメータとカーソルコードの統合――ゲームチェンジャーか、それともブラフか?

イーロン・マスクがついに動き出した。AI開発競争において、OpenAIとAnthropicは加速している一方、xAIは出遅れているようだ。マスクはたびたび「Claude」に対抗する意向を表明してきたが、Grok4.Xシリーズへの度重なるアップデートにもかかわらず、結果は理論上は良好に見えても実用面では不十分であり、その差はほとんど縮まっていない。しかし、今回、彼には新たな切り札がある。マスクはX(

マスク氏の「Grok」:1.5兆のパラメータとカーソルコードの統合――ゲームチェンジャーか、それともブラフか?

イーロン・マスクがついに動き出した。AI開発競争において、OpenAIとAnthropicは加速している一方、xAIは出遅れているようだ。マスクはたびたび「Claude」に対抗する意向を表明してきたが、Grok4.Xシリーズへの度重なるアップデートにもかかわらず、結果は理論上は良好に見えても実用面では不十分であり、その差はほとんど縮まっていない。しかし、今回、彼には新たな切り札がある。マスクはX(

OpenAI、アルトマン氏の解任を困難にするため、密かに定款を変更

2023年のクーデターのような事態を受けて、OpenAIは定款を改定し、サム・アルトマンCEOに対する保護措置をさらに強化した。最近公開された裁判文書によると、アルトマン氏の地位は今や揺るぎないものとなっており、外部からの干渉や、取締役会による解任の動きに対する障壁が大幅に高まっている。イーロン・マスクがOpenAIを相手取った訴訟における専門家証人は、これらの変更が同社が営利モデルへ移行する過程

OpenAI、アルトマン氏の解任を困難にするため、密かに定款を変更

2023年のクーデターのような事態を受けて、OpenAIは定款を改定し、サム・アルトマンCEOに対する保護措置をさらに強化した。最近公開された裁判文書によると、アルトマン氏の地位は今や揺るぎないものとなっており、外部からの干渉や、取締役会による解任の動きに対する障壁が大幅に高まっている。イーロン・マスクがOpenAIを相手取った訴訟における専門家証人は、これらの変更が同社が営利モデルへ移行する過程

Que ideia incrível! Já imaginou como isso pode mudar o desenvolvimento de jogos independentes? Em vez de depender de bibliotecas caras ou gravações caseiras, você pode gerar efeitos sonoros sob medida em minutos. A parte mais interessante pra mim é a combinação FlutterFlow + Replicate - mostra como plataformas no-code estão ficando sofisticadas o suficiente para integrações complexas com IA. Será que em breve teremos 'produtores de som' baseados em IA substituindo algumas funções técnicas? 🎮🔊

와..플러터플로우로 AI 음향 효과 생성기 만들기라니 진짜 신기하네요! 🎵 이런 튜토리얼을 찾고 있었는데 운이 좋아요. 리플리케이트랑 연동하는 부분도 궁금했거든요. 주말에 꼭 따라해봐야겠어요 😆

This tutorial is a game-changer for indie devs! 🎮 Finally a practical way to create custom SFX without expensive tools or coding nightmares. Though I wonder if the AI-generated sounds will have that 'human touch' missing in procedural audio...

This is so cool! I had no idea you could make AI sound effects with no-code tools like FlutterFlow. Gonna try this out for my game project! 🎮

家

家