NVIDIA的新Llama-3.1 Nemotron Ultra Ultra的表现为DeepSeek R1,尺寸为一半

在Meta为其最新Llama 4模型家族面临严格审查之际,Nvidia悄然推出了一款基于Meta早期Llama-3.1-405B-Instruct模型的全新开源大型语言模型(LLM)。这款名为Llama-3.1-Nemotron-Ultra-253B-v1的模型拥有2530亿个参数,专为高级推理、指令遵循和AI助手工作流程而设计。Nvidia最早在3月的年度GPU技术大会(GTC)上暗示了这一模型。

此次发布凸显了Nvidia通过架构创新和精细的后训练流程持续提升性能的承诺。该模型于2025年4月7日宣布,其代码、权重和后训练数据现已在Hugging Face上免费提供。它设计为可根据系统提示在复杂推理任务和简单输出之间无缝切换,为开发者提供灵活的应用选择。

专为高效推理设计

基于Nvidia之前在优化LLM推理方面的努力,Llama-3.1-Nemotron-Ultra-253B采用了神经架构搜索(NAS)流程来优化其架构。这包括跳跃注意力层、融合前馈网络(FFNs)和可变FFN压缩比等创新功能。这些修改降低了模型的内存使用量和计算需求,使其可在单个8x H100 GPU节点上部署,而不影响输出质量。

Nvidia声称该模型在数据中心部署中性能强劲且成本效益高。它兼容Nvidia的B100和Hopper微架构,并在BF16和FP8精度模式下进行了测试。

后训练以增强推理和对齐

该模型经历了全面的后训练过程,包括在数学、代码生成、聊天和工具使用等多个领域进行监督微调,随后通过群体相对策略优化(GRPO)强化学习,以提升其指令遵循和推理能力。

进一步的优化包括在650亿个令牌上进行知识蒸馏,以及在额外880亿个令牌上进行持续预训练。训练数据来源包括FineWeb、Buzz-V1.2和Dolma,后训练提示和响应则来自公共语料库和合成生成方法。这种方法帮助模型区分其推理模式。

在众多领域和基准测试中的性能提升

在启用推理模式后,该模型在多个基准测试中显示出显著改进。例如,在MATH500基准测试中,其性能从标准模式的80.40%飙升至推理模式下的97.00%。同样,AIME25得分从16.67%跃升至72.50%,LiveCodeBench结果从29.03%翻倍至66.31%。

该模型在基于工具的任务和通用问答(GPQA)中也表现出色,在推理模式下得分76.01%,相比之下非推理模式为56.60%。这些基准测试的最大序列长度为32,000个令牌,每项测试重复最多16次以确保准确性。

与拥有6710亿参数的最先进的MoE模型DeepSeek R1相比,Nvidia的模型尽管参数较少,但表现依然出色。它在GPQA(76.01 vs. 71.5)、IFEval指令遵循(89.45 vs. 83.3)和LiveCodeBench编码任务(66.31 vs. 65.9)等任务中优于DeepSeek R1。然而,DeepSeek R1在某些数学评估中略占优势,特别是在AIME25(79.8 vs. 72.50)和MATH500(97.3 vs. 97.00)。

这些结果表明,Nvidia的密集模型在推理和通用指令对齐方面可匹敌或超越MoE模型,尽管在数学密集型类别中略显不足。

使用与集成

该模型与Hugging Face Transformers库(推荐版本4.48.3)无缝集成,支持最长128,000个令牌的序列。开发者可通过系统提示切换推理行为,并根据任务需求选择解码策略。对于推理任务,Nvidia建议使用温度采样(0.6)结合top-p值为0.95,而对于确定性输出则推荐使用贪婪解码。

Llama-3.1-Nemotron-Ultra-253B支持多语言应用,包括英语、德语、法语、意大利语、葡萄牙语、印地语、西班牙语和泰语。它非常适合多种LLM用例,如聊天机器人开发、AI代理工作流程、检索增强生成(RAG)和代码生成。

商业用途许可

该模型在Nvidia开放模型许可证和Llama 3.1社区许可协议下发布,适用于商业应用。Nvidia强调负责任的AI开发的重要性,敦促团队评估模型在其特定用例中的对齐性、安全性和偏见。

Nvidia的AI模型后训练总监Oleksii Kuchaiev在X上分享了此次开放发布的激动心情,强调其密集的2530亿参数设计具有可切换的推理能力,并包括开放的权重和数据。

相关文章

ElevenLabs宣布黑石集团、杰米·福克斯和伊娃·朗格利亚成为新投资者

语音人工智能公司ElevenLabs披露了其5亿美元D轮融资的更多投资者名单,该轮融资最初于2月宣布。 其中包括贝莱德(BlackRock)、威灵顿(Wellington)、D.E. Shaw和施罗德(Schroders)等机构投资者;英伟达(NVIDIA)、Salesforce、桑坦德银行(Santander)、KPN和德国电信(Deutsche Telekom)等企业;以及杰米·福克斯(Jam

ElevenLabs宣布黑石集团、杰米·福克斯和伊娃·朗格利亚成为新投资者

语音人工智能公司ElevenLabs披露了其5亿美元D轮融资的更多投资者名单,该轮融资最初于2月宣布。 其中包括贝莱德(BlackRock)、威灵顿(Wellington)、D.E. Shaw和施罗德(Schroders)等机构投资者;英伟达(NVIDIA)、Salesforce、桑坦德银行(Santander)、KPN和德国电信(Deutsche Telekom)等企业;以及杰米·福克斯(Jam

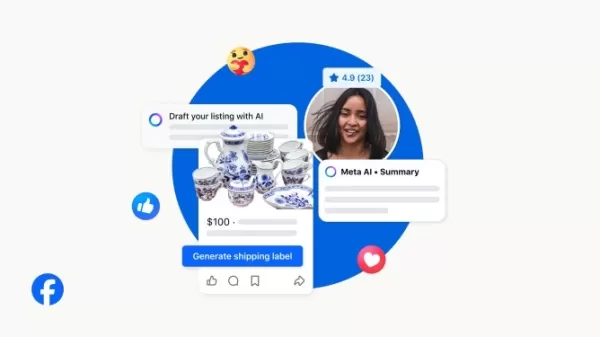

Meta AI 现已在 Facebook Marketplace 上回复买家消息

Facebook周四宣布,Facebook Marketplace推出了新的Meta AI功能,包括对买家咨询的自动回复。该平台还利用AI加速商品上架、总结卖家资料,并允许卖家在商品列表中提供配送服务。鉴于卖家通常会收到大量买家咨询,Facebook正通过由Meta AI驱动的自动回复功能简化这一流程。当买家询问商品库存情况时,卖家可利用Meta AI根据商品详情(如描述、库存、自提地点和价格)自

Meta AI 现已在 Facebook Marketplace 上回复买家消息

Facebook周四宣布,Facebook Marketplace推出了新的Meta AI功能,包括对买家咨询的自动回复。该平台还利用AI加速商品上架、总结卖家资料,并允许卖家在商品列表中提供配送服务。鉴于卖家通常会收到大量买家咨询,Facebook正通过由Meta AI驱动的自动回复功能简化这一流程。当买家询问商品库存情况时,卖家可利用Meta AI根据商品详情(如描述、库存、自提地点和价格)自

Meta签署协议,采购数百万颗亚马逊AI处理器

亚马逊已与Meta达成一项重要合作,再次依托其自主设计的芯片。亚马逊周五证实,Meta已同意部署数百万颗AWS Graviton芯片,以满足其不断增长的人工智能需求。需注意,AWS Graviton是一款基于ARM架构的CPU(中央处理器,用于通用计算),而非GPU(图形处理器)。虽然GPU仍是训练大型模型的首选芯片,但一旦模型训练完成,基于这些模型构建的AI代理正推动着所需芯片类型的转变。这些代

相关专题推荐

评论 (54)

0/500

Meta签署协议,采购数百万颗亚马逊AI处理器

亚马逊已与Meta达成一项重要合作,再次依托其自主设计的芯片。亚马逊周五证实,Meta已同意部署数百万颗AWS Graviton芯片,以满足其不断增长的人工智能需求。需注意,AWS Graviton是一款基于ARM架构的CPU(中央处理器,用于通用计算),而非GPU(图形处理器)。虽然GPU仍是训练大型模型的首选芯片,但一旦模型训练完成,基于这些模型构建的AI代理正推动着所需芯片类型的转变。这些代

相关专题推荐

评论 (54)

0/500

![JonathanNelson]()

Интересно, как Nvidia удалось упаковать все эти параметры в модель размером вдвое меньше. Выходит, вложения в архитектуру дают больше преимуществ, чем просто увеличение данных? Хотя, конечно, с учётом их вычислительных ресурсов не стоит удивляться. Что особенно ценно, так это тот факт, что модель открыта. На этом фоне заявления Meta порой звучат слишком громко и с многочисленными оговорками 🤔 Это может изменить правила игры для независимых исследователей!

![CharlesYoung]()

¿Nvidia saca otro modelo open-source más potente que DeepSeek R1? 🤔 Me pregunto si esto realmente marcará una diferencia práctica para los desarrolladores o es solo otra carrera por los números en los benchmarks. ¡253 mil millones de parámetros parece excesivo!

![DouglasMartínez]()

Nvidia's new model sounds like a beast! Half the size of DeepSeek R1 but still outperforms it? That's wild efficiency. Can't wait to see how devs play with this open-source gem! 🚀

![StephenRoberts]()

Nvidia's new model sounds like a beast! Half the size of DeepSeek R1 but still outshines it? That's some serious tech flex. Can't wait to see how devs play with this open-source gem! 😎

![AnthonyRoberts]()

Nvidia's new Llama-3.1 Nemotron Ultra is a beast! It's amazing how it outperforms DeepSeek R1 with half the size. I've been using it for my projects and the results are incredible. Just wish it was a bit faster, but overall, a solid choice! 🚀

![JohnRoberts]()

¡El Llama-3.1 Nemotron Ultra de Nvidia es impresionante! Supera al DeepSeek R1 con la mitad del tamaño, lo cual es alucinante. Lo he estado usando en mis proyectos y es súper eficiente. Lo único es que puede ser un poco complicado de configurar. Aún así, una excelente opción para quien busque un LLM potente. 🚀

在Meta为其最新Llama 4模型家族面临严格审查之际,Nvidia悄然推出了一款基于Meta早期Llama-3.1-405B-Instruct模型的全新开源大型语言模型(LLM)。这款名为Llama-3.1-Nemotron-Ultra-253B-v1的模型拥有2530亿个参数,专为高级推理、指令遵循和AI助手工作流程而设计。Nvidia最早在3月的年度GPU技术大会(GTC)上暗示了这一模型。

此次发布凸显了Nvidia通过架构创新和精细的后训练流程持续提升性能的承诺。该模型于2025年4月7日宣布,其代码、权重和后训练数据现已在Hugging Face上免费提供。它设计为可根据系统提示在复杂推理任务和简单输出之间无缝切换,为开发者提供灵活的应用选择。

专为高效推理设计

基于Nvidia之前在优化LLM推理方面的努力,Llama-3.1-Nemotron-Ultra-253B采用了神经架构搜索(NAS)流程来优化其架构。这包括跳跃注意力层、融合前馈网络(FFNs)和可变FFN压缩比等创新功能。这些修改降低了模型的内存使用量和计算需求,使其可在单个8x H100 GPU节点上部署,而不影响输出质量。

Nvidia声称该模型在数据中心部署中性能强劲且成本效益高。它兼容Nvidia的B100和Hopper微架构,并在BF16和FP8精度模式下进行了测试。

后训练以增强推理和对齐

该模型经历了全面的后训练过程,包括在数学、代码生成、聊天和工具使用等多个领域进行监督微调,随后通过群体相对策略优化(GRPO)强化学习,以提升其指令遵循和推理能力。

进一步的优化包括在650亿个令牌上进行知识蒸馏,以及在额外880亿个令牌上进行持续预训练。训练数据来源包括FineWeb、Buzz-V1.2和Dolma,后训练提示和响应则来自公共语料库和合成生成方法。这种方法帮助模型区分其推理模式。

在众多领域和基准测试中的性能提升

在启用推理模式后,该模型在多个基准测试中显示出显著改进。例如,在MATH500基准测试中,其性能从标准模式的80.40%飙升至推理模式下的97.00%。同样,AIME25得分从16.67%跃升至72.50%,LiveCodeBench结果从29.03%翻倍至66.31%。

该模型在基于工具的任务和通用问答(GPQA)中也表现出色,在推理模式下得分76.01%,相比之下非推理模式为56.60%。这些基准测试的最大序列长度为32,000个令牌,每项测试重复最多16次以确保准确性。

与拥有6710亿参数的最先进的MoE模型DeepSeek R1相比,Nvidia的模型尽管参数较少,但表现依然出色。它在GPQA(76.01 vs. 71.5)、IFEval指令遵循(89.45 vs. 83.3)和LiveCodeBench编码任务(66.31 vs. 65.9)等任务中优于DeepSeek R1。然而,DeepSeek R1在某些数学评估中略占优势,特别是在AIME25(79.8 vs. 72.50)和MATH500(97.3 vs. 97.00)。

这些结果表明,Nvidia的密集模型在推理和通用指令对齐方面可匹敌或超越MoE模型,尽管在数学密集型类别中略显不足。

使用与集成

该模型与Hugging Face Transformers库(推荐版本4.48.3)无缝集成,支持最长128,000个令牌的序列。开发者可通过系统提示切换推理行为,并根据任务需求选择解码策略。对于推理任务,Nvidia建议使用温度采样(0.6)结合top-p值为0.95,而对于确定性输出则推荐使用贪婪解码。

Llama-3.1-Nemotron-Ultra-253B支持多语言应用,包括英语、德语、法语、意大利语、葡萄牙语、印地语、西班牙语和泰语。它非常适合多种LLM用例,如聊天机器人开发、AI代理工作流程、检索增强生成(RAG)和代码生成。

商业用途许可

该模型在Nvidia开放模型许可证和Llama 3.1社区许可协议下发布,适用于商业应用。Nvidia强调负责任的AI开发的重要性,敦促团队评估模型在其特定用例中的对齐性、安全性和偏见。

Nvidia的AI模型后训练总监Oleksii Kuchaiev在X上分享了此次开放发布的激动心情,强调其密集的2530亿参数设计具有可切换的推理能力,并包括开放的权重和数据。

ElevenLabs宣布黑石集团、杰米·福克斯和伊娃·朗格利亚成为新投资者

语音人工智能公司ElevenLabs披露了其5亿美元D轮融资的更多投资者名单,该轮融资最初于2月宣布。 其中包括贝莱德(BlackRock)、威灵顿(Wellington)、D.E. Shaw和施罗德(Schroders)等机构投资者;英伟达(NVIDIA)、Salesforce、桑坦德银行(Santander)、KPN和德国电信(Deutsche Telekom)等企业;以及杰米·福克斯(Jam

ElevenLabs宣布黑石集团、杰米·福克斯和伊娃·朗格利亚成为新投资者

语音人工智能公司ElevenLabs披露了其5亿美元D轮融资的更多投资者名单,该轮融资最初于2月宣布。 其中包括贝莱德(BlackRock)、威灵顿(Wellington)、D.E. Shaw和施罗德(Schroders)等机构投资者;英伟达(NVIDIA)、Salesforce、桑坦德银行(Santander)、KPN和德国电信(Deutsche Telekom)等企业;以及杰米·福克斯(Jam

Meta AI 现已在 Facebook Marketplace 上回复买家消息

Facebook周四宣布,Facebook Marketplace推出了新的Meta AI功能,包括对买家咨询的自动回复。该平台还利用AI加速商品上架、总结卖家资料,并允许卖家在商品列表中提供配送服务。鉴于卖家通常会收到大量买家咨询,Facebook正通过由Meta AI驱动的自动回复功能简化这一流程。当买家询问商品库存情况时,卖家可利用Meta AI根据商品详情(如描述、库存、自提地点和价格)自

Meta AI 现已在 Facebook Marketplace 上回复买家消息

Facebook周四宣布,Facebook Marketplace推出了新的Meta AI功能,包括对买家咨询的自动回复。该平台还利用AI加速商品上架、总结卖家资料,并允许卖家在商品列表中提供配送服务。鉴于卖家通常会收到大量买家咨询,Facebook正通过由Meta AI驱动的自动回复功能简化这一流程。当买家询问商品库存情况时,卖家可利用Meta AI根据商品详情(如描述、库存、自提地点和价格)自

Meta签署协议,采购数百万颗亚马逊AI处理器

亚马逊已与Meta达成一项重要合作,再次依托其自主设计的芯片。亚马逊周五证实,Meta已同意部署数百万颗AWS Graviton芯片,以满足其不断增长的人工智能需求。需注意,AWS Graviton是一款基于ARM架构的CPU(中央处理器,用于通用计算),而非GPU(图形处理器)。虽然GPU仍是训练大型模型的首选芯片,但一旦模型训练完成,基于这些模型构建的AI代理正推动着所需芯片类型的转变。这些代

Meta签署协议,采购数百万颗亚马逊AI处理器

亚马逊已与Meta达成一项重要合作,再次依托其自主设计的芯片。亚马逊周五证实,Meta已同意部署数百万颗AWS Graviton芯片,以满足其不断增长的人工智能需求。需注意,AWS Graviton是一款基于ARM架构的CPU(中央处理器,用于通用计算),而非GPU(图形处理器)。虽然GPU仍是训练大型模型的首选芯片,但一旦模型训练完成,基于这些模型构建的AI代理正推动着所需芯片类型的转变。这些代

Интересно, как Nvidia удалось упаковать все эти параметры в модель размером вдвое меньше. Выходит, вложения в архитектуру дают больше преимуществ, чем просто увеличение данных? Хотя, конечно, с учётом их вычислительных ресурсов не стоит удивляться. Что особенно ценно, так это тот факт, что модель открыта. На этом фоне заявления Meta порой звучат слишком громко и с многочисленными оговорками 🤔 Это может изменить правила игры для независимых исследователей!

¿Nvidia saca otro modelo open-source más potente que DeepSeek R1? 🤔 Me pregunto si esto realmente marcará una diferencia práctica para los desarrolladores o es solo otra carrera por los números en los benchmarks. ¡253 mil millones de parámetros parece excesivo!

Nvidia's new model sounds like a beast! Half the size of DeepSeek R1 but still outperforms it? That's wild efficiency. Can't wait to see how devs play with this open-source gem! 🚀

Nvidia's new model sounds like a beast! Half the size of DeepSeek R1 but still outshines it? That's some serious tech flex. Can't wait to see how devs play with this open-source gem! 😎

Nvidia's new Llama-3.1 Nemotron Ultra is a beast! It's amazing how it outperforms DeepSeek R1 with half the size. I've been using it for my projects and the results are incredible. Just wish it was a bit faster, but overall, a solid choice! 🚀

¡El Llama-3.1 Nemotron Ultra de Nvidia es impresionante! Supera al DeepSeek R1 con la mitad del tamaño, lo cual es alucinante. Lo he estado usando en mis proyectos y es súper eficiente. Lo único es que puede ser un poco complicado de configurar. Aún así, una excelente opción para quien busque un LLM potente. 🚀

首页

首页