強化醫療自主AI的網路安全

全球醫療機構面臨數據洩露的挑戰日益加劇。近期數據顯示,全球平均數據洩露成本達445萬美元,美國醫療提供者更高達948萬美元。40%的洩露涉及多環境數據,顯著擴大攻擊面,為網路犯罪分子創造多個入口。

自主生成AI的興起帶來變革,但也引入新安全風險,隨著這些智能系統從理論走向醫療應用,應對新興威脅至關重要,以負責任地擴展AI並增強組織對網路攻擊的防禦,包括惡意軟件、數據洩露和複雜的供應鏈攻擊。

從設計到部署構建韌性

醫療機構必須採取主動、持續演進的防禦策略,以應對AI帶來的更高安全風險,特別是在患者安全和法規合規性至關重要的醫療領域。

這需要結構化方法,從AI系統設計開始,延伸至大規模部署。

- 關鍵第一步是繪製並威脅建模整個AI流程——從數據攝取到模型訓練、驗證、部署和推理。此過程精確識別漏洞,根據影響和可能性評估風險。

- 接下來,組織應開發安全架構,部署利用大型語言模型(LLMs)的系統和應用,包括Agentic AI。這包括實施容器安全、安全API設計和敏感訓練數據的安全管理等措施。

- 第三,遵循既定標準和框架至關重要。例如,遵循NIST的AI風險管理框架確保全面風險識別和緩解,而OWASP的指導則針對LLM特定漏洞,如提示注入和不安全輸出處理。

- 此外,傳統威脅建模必須演進,以應對AI驅動的獨特攻擊,如數據毒化破壞模型完整性,或生成偏見、敏感或不當AI輸出的風險。

- 最後,部署後的持續警惕至關重要。定期紅隊演練和針對偏見、穩健性和透明度的專門AI安全審計有助於識別和解決AI系統中的漏洞。

最終,醫療AI的安全取決於保護整個AI生命週期——從開發到部署——通過理解新威脅並遵循成熟的安全原則。

運營中的持續安全措施

除了安全設計和部署,維持強大的AI安全需要持續關注和全程主動防禦。這包括使用AI驅動的監控實時監測AI輸出,檢測敏感或惡意內容,同時遵循數據發布政策和用戶權限。在開發和生產中,組織必須積極掃描惡意軟件、漏洞和敵對活動,結合傳統網路安全實踐。

為建立用戶信任並增強AI決策透明度,可解釋AI(XAI)工具對於闡明AI輸出和預測背後的推理至關重要。

增強安全還依賴於自動化數據發現和動態數據分類,提供數據環境的即時視圖。這些努力支持強大的安全控制,如細粒度基於角色的訪問控制(RBAC)、端到端加密保護傳輸和靜止數據,以及有效的數據遮罩保護敏感信息。

對所有與AI系統互動的員工進行全面安全意識培訓也至關重要,打造人力防火牆以應對社會工程和其他AI相關威脅。

保護Agentic AI的未來

長期抵禦AI安全威脅的韌性需要多方面方法:持續監控、積極掃描、透明解釋、智能數據分類和嚴格安全措施。這必須與強大的安全文化和成熟的傳統網路安全控制相結合。隨著自主AI代理融入組織工作流程,對強大安全的需求加劇。公共雲數據洩露平均成本517萬美元,凸顯財務和聲譽風險。

AI的未來取決於嵌入安全、採用透明框架和執行嚴格治理。建立對這些智能系統的信任將決定其廣泛採用和持久影響,塑造AI在醫療中的變革潛力。

相關文章

OpenAI 停用 o3 和 GPT-4.5 大型模型

作為人工智慧領域的領頭羊,OpenAI 的每項技術舉措都會在業界掀起巨大波瀾。近日,該公司發布了一項重大聲明:將從其 ChatGPT 平台退役兩款經典模型——o3 和 GPT-4.5。 常被稱為「人文天才」的 GPT-4.5 將於 6 月 27 日下線,而以強大推理能力著稱的 o3 則將於 8 月 26 日隨之退役。經典模型的退役引發懷舊之情這則突如其來的消息讓許多付費長期用戶難以接受,社群平台與

OpenAI 停用 o3 和 GPT-4.5 大型模型

作為人工智慧領域的領頭羊,OpenAI 的每項技術舉措都會在業界掀起巨大波瀾。近日,該公司發布了一項重大聲明:將從其 ChatGPT 平台退役兩款經典模型——o3 和 GPT-4.5。 常被稱為「人文天才」的 GPT-4.5 將於 6 月 27 日下線,而以強大推理能力著稱的 o3 則將於 8 月 26 日隨之退役。經典模型的退役引發懷舊之情這則突如其來的消息讓許多付費長期用戶難以接受,社群平台與

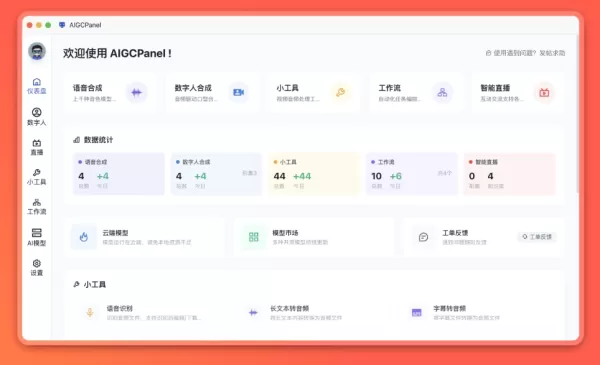

AIGCPanel 2.0.0 重大更新:工作流程引擎開啟自動化數位人偶創作的新紀元

AIGCPanel 是一款強大的本地數位人類創作工具,其 2.0.0 版本已正式上線,被譽為「迄今為止最重大的更新」。 此次核心全面升級,透過工作流程引擎與 CLI 命令列工具,將數位人合成、聲音克隆及影音處理功能整合,從手動組裝轉向自動化生產,有效解決了 AI 創作工具的分散問題。1. 核心升級:定義邏輯流程,一鍵輸出AIGCPanel 2.0.0 最引人注目的新功能是「工作流程引擎」:基於節點

AIGCPanel 2.0.0 重大更新:工作流程引擎開啟自動化數位人偶創作的新紀元

AIGCPanel 是一款強大的本地數位人類創作工具,其 2.0.0 版本已正式上線,被譽為「迄今為止最重大的更新」。 此次核心全面升級,透過工作流程引擎與 CLI 命令列工具,將數位人合成、聲音克隆及影音處理功能整合,從手動組裝轉向自動化生產,有效解決了 AI 創作工具的分散問題。1. 核心升級:定義邏輯流程,一鍵輸出AIGCPanel 2.0.0 最引人注目的新功能是「工作流程引擎」:基於節點

BuzzFeed 推出專營 AI 垃圾應用程式的子公司

在面臨重大經營危機之際,昔日的數位媒體巨頭 BuzzFeed 正啟動一項由人工智慧驅動的雄心勃勃的自救實驗。 在最近舉行的SXSW大會上,共同創辦人兼執行長喬納·佩雷蒂(Jonah Peretti)宣布成立一家名為Branch Office的子公司,旨在透過一系列由人工智慧驅動的消費者應用程式,重新定義「軟體即內容」的商業模式。核心產品組合:融合迷因與社交媒體Branch Office 已推出三款

相關專題推薦

評論 (2)

0/500

BuzzFeed 推出專營 AI 垃圾應用程式的子公司

在面臨重大經營危機之際,昔日的數位媒體巨頭 BuzzFeed 正啟動一項由人工智慧驅動的雄心勃勃的自救實驗。 在最近舉行的SXSW大會上,共同創辦人兼執行長喬納·佩雷蒂(Jonah Peretti)宣布成立一家名為Branch Office的子公司,旨在透過一系列由人工智慧驅動的消費者應用程式,重新定義「軟體即內容」的商業模式。核心產品組合:融合迷因與社交媒體Branch Office 已推出三款

相關專題推薦

評論 (2)

0/500

![AlbertGarcía]()

Cyberangriffe auf autonome KI im Gesundheitswesen sind echt gruselig 😓! Erst letzte Woche hab‘ ich gelesen, dass ein Krankenhaus nahe mir wegen Datendiebstahl völlig lahmgelegt wurde. Die Zahl von 4,45 Mio. Dollar ist krass — wer zahlt das am Ende? Wir Patienten, vermute ich. KI-Systeme sollten nicht nur schlau, sondern auch bombensicher sein, sonst vertraut ihnen keiner mehr. Irgendwie beunruhigend, dass ausgerechnet lebenswichtige Technologien so verwundbar sind. Habt ihr Tipps, wie man da als Laie drüber reden kann?

全球醫療機構面臨數據洩露的挑戰日益加劇。近期數據顯示,全球平均數據洩露成本達445萬美元,美國醫療提供者更高達948萬美元。40%的洩露涉及多環境數據,顯著擴大攻擊面,為網路犯罪分子創造多個入口。

自主生成AI的興起帶來變革,但也引入新安全風險,隨著這些智能系統從理論走向醫療應用,應對新興威脅至關重要,以負責任地擴展AI並增強組織對網路攻擊的防禦,包括惡意軟件、數據洩露和複雜的供應鏈攻擊。

從設計到部署構建韌性

醫療機構必須採取主動、持續演進的防禦策略,以應對AI帶來的更高安全風險,特別是在患者安全和法規合規性至關重要的醫療領域。

這需要結構化方法,從AI系統設計開始,延伸至大規模部署。

- 關鍵第一步是繪製並威脅建模整個AI流程——從數據攝取到模型訓練、驗證、部署和推理。此過程精確識別漏洞,根據影響和可能性評估風險。

- 接下來,組織應開發安全架構,部署利用大型語言模型(LLMs)的系統和應用,包括Agentic AI。這包括實施容器安全、安全API設計和敏感訓練數據的安全管理等措施。

- 第三,遵循既定標準和框架至關重要。例如,遵循NIST的AI風險管理框架確保全面風險識別和緩解,而OWASP的指導則針對LLM特定漏洞,如提示注入和不安全輸出處理。

- 此外,傳統威脅建模必須演進,以應對AI驅動的獨特攻擊,如數據毒化破壞模型完整性,或生成偏見、敏感或不當AI輸出的風險。

- 最後,部署後的持續警惕至關重要。定期紅隊演練和針對偏見、穩健性和透明度的專門AI安全審計有助於識別和解決AI系統中的漏洞。

最終,醫療AI的安全取決於保護整個AI生命週期——從開發到部署——通過理解新威脅並遵循成熟的安全原則。

運營中的持續安全措施

除了安全設計和部署,維持強大的AI安全需要持續關注和全程主動防禦。這包括使用AI驅動的監控實時監測AI輸出,檢測敏感或惡意內容,同時遵循數據發布政策和用戶權限。在開發和生產中,組織必須積極掃描惡意軟件、漏洞和敵對活動,結合傳統網路安全實踐。

為建立用戶信任並增強AI決策透明度,可解釋AI(XAI)工具對於闡明AI輸出和預測背後的推理至關重要。

增強安全還依賴於自動化數據發現和動態數據分類,提供數據環境的即時視圖。這些努力支持強大的安全控制,如細粒度基於角色的訪問控制(RBAC)、端到端加密保護傳輸和靜止數據,以及有效的數據遮罩保護敏感信息。

對所有與AI系統互動的員工進行全面安全意識培訓也至關重要,打造人力防火牆以應對社會工程和其他AI相關威脅。

保護Agentic AI的未來

長期抵禦AI安全威脅的韌性需要多方面方法:持續監控、積極掃描、透明解釋、智能數據分類和嚴格安全措施。這必須與強大的安全文化和成熟的傳統網路安全控制相結合。隨著自主AI代理融入組織工作流程,對強大安全的需求加劇。公共雲數據洩露平均成本517萬美元,凸顯財務和聲譽風險。

AI的未來取決於嵌入安全、採用透明框架和執行嚴格治理。建立對這些智能系統的信任將決定其廣泛採用和持久影響,塑造AI在醫療中的變革潛力。

OpenAI 停用 o3 和 GPT-4.5 大型模型

作為人工智慧領域的領頭羊,OpenAI 的每項技術舉措都會在業界掀起巨大波瀾。近日,該公司發布了一項重大聲明:將從其 ChatGPT 平台退役兩款經典模型——o3 和 GPT-4.5。 常被稱為「人文天才」的 GPT-4.5 將於 6 月 27 日下線,而以強大推理能力著稱的 o3 則將於 8 月 26 日隨之退役。經典模型的退役引發懷舊之情這則突如其來的消息讓許多付費長期用戶難以接受,社群平台與

OpenAI 停用 o3 和 GPT-4.5 大型模型

作為人工智慧領域的領頭羊,OpenAI 的每項技術舉措都會在業界掀起巨大波瀾。近日,該公司發布了一項重大聲明:將從其 ChatGPT 平台退役兩款經典模型——o3 和 GPT-4.5。 常被稱為「人文天才」的 GPT-4.5 將於 6 月 27 日下線,而以強大推理能力著稱的 o3 則將於 8 月 26 日隨之退役。經典模型的退役引發懷舊之情這則突如其來的消息讓許多付費長期用戶難以接受,社群平台與

AIGCPanel 2.0.0 重大更新:工作流程引擎開啟自動化數位人偶創作的新紀元

AIGCPanel 是一款強大的本地數位人類創作工具,其 2.0.0 版本已正式上線,被譽為「迄今為止最重大的更新」。 此次核心全面升級,透過工作流程引擎與 CLI 命令列工具,將數位人合成、聲音克隆及影音處理功能整合,從手動組裝轉向自動化生產,有效解決了 AI 創作工具的分散問題。1. 核心升級:定義邏輯流程,一鍵輸出AIGCPanel 2.0.0 最引人注目的新功能是「工作流程引擎」:基於節點

AIGCPanel 2.0.0 重大更新:工作流程引擎開啟自動化數位人偶創作的新紀元

AIGCPanel 是一款強大的本地數位人類創作工具,其 2.0.0 版本已正式上線,被譽為「迄今為止最重大的更新」。 此次核心全面升級,透過工作流程引擎與 CLI 命令列工具,將數位人合成、聲音克隆及影音處理功能整合,從手動組裝轉向自動化生產,有效解決了 AI 創作工具的分散問題。1. 核心升級:定義邏輯流程,一鍵輸出AIGCPanel 2.0.0 最引人注目的新功能是「工作流程引擎」:基於節點

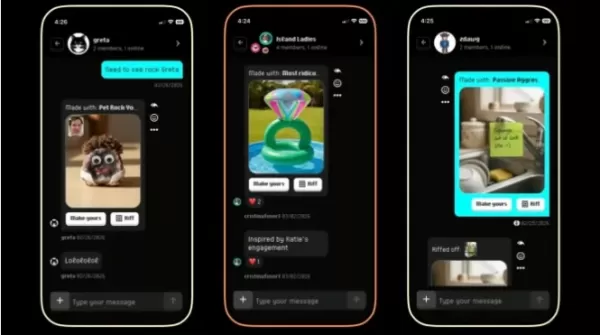

BuzzFeed 推出專營 AI 垃圾應用程式的子公司

在面臨重大經營危機之際,昔日的數位媒體巨頭 BuzzFeed 正啟動一項由人工智慧驅動的雄心勃勃的自救實驗。 在最近舉行的SXSW大會上,共同創辦人兼執行長喬納·佩雷蒂(Jonah Peretti)宣布成立一家名為Branch Office的子公司,旨在透過一系列由人工智慧驅動的消費者應用程式,重新定義「軟體即內容」的商業模式。核心產品組合:融合迷因與社交媒體Branch Office 已推出三款

BuzzFeed 推出專營 AI 垃圾應用程式的子公司

在面臨重大經營危機之際,昔日的數位媒體巨頭 BuzzFeed 正啟動一項由人工智慧驅動的雄心勃勃的自救實驗。 在最近舉行的SXSW大會上,共同創辦人兼執行長喬納·佩雷蒂(Jonah Peretti)宣布成立一家名為Branch Office的子公司,旨在透過一系列由人工智慧驅動的消費者應用程式,重新定義「軟體即內容」的商業模式。核心產品組合:融合迷因與社交媒體Branch Office 已推出三款

Cyberangriffe auf autonome KI im Gesundheitswesen sind echt gruselig 😓! Erst letzte Woche hab‘ ich gelesen, dass ein Krankenhaus nahe mir wegen Datendiebstahl völlig lahmgelegt wurde. Die Zahl von 4,45 Mio. Dollar ist krass — wer zahlt das am Ende? Wir Patienten, vermute ich. KI-Systeme sollten nicht nur schlau, sondern auch bombensicher sein, sonst vertraut ihnen keiner mehr. Irgendwie beunruhigend, dass ausgerechnet lebenswichtige Technologien so verwundbar sind. Habt ihr Tipps, wie man da als Laie drüber reden kann?

首頁

首頁