AI依賴可能削弱批判性思考:麻省理工研究揭示認知風險

在一個AI工具如ChatGPT與拼字檢查一樣普遍的時代,麻省理工一項發人深省的研究警告,我們對大型語言模型(LLMs)的日益依賴可能正悄悄地削弱我們的批判性思考與深度學習能力。這項由麻省理工媒體實驗室研究人員進行的四個月研究,提出了「認知債務」的概念,挑戰教育工作者、學生與科技愛好者重新思考對AI的依賴。

這項發現具有重大意義。隨著全球學生轉向AI尋求學術支持,我們可能正在培養一代寫作速度更快但思考深度較淺的學生。這不僅僅是另一個科技警示故事;它是一項科學基礎上的探索,研究外包認知任務給AI如何影響我們大腦進行深度思考的能力。

AI如何影響大腦功能

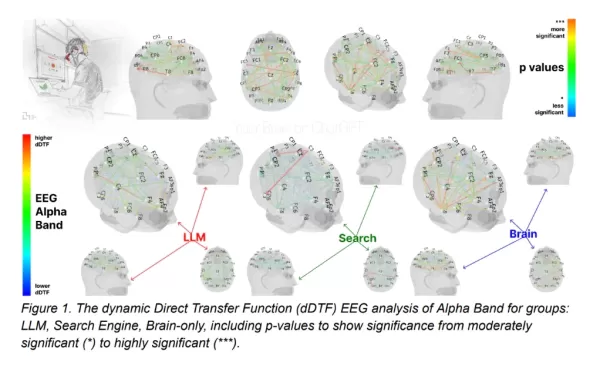

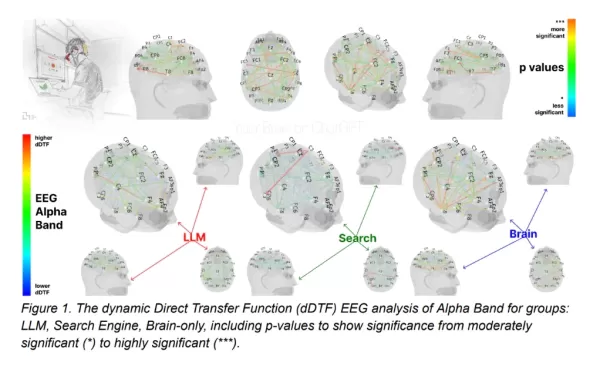

麻省理工研究追蹤了來自波士頓地區五所學校的54名大學生,將他們分為三組:一組使用OpenAI的GPT-4o,另一組依賴傳統搜尋引擎,第三組在沒有外部工具的情況下撰寫文章。研究人員使用腦電圖(EEG)監測發現,獨立撰寫文章的組別在大腦多個區域顯示出更強的神經聯繫。

值得注意的是,theta與alpha腦波的差異,這些腦波與工作記憶和執行功能相關。獨立工作的組別展現出增強的額頂alpha聯繫,反映出專注的內部處理與創意形成。相反,LLM組別顯示出較低的額葉theta聯繫,表明對工作記憶和執行控制的需求較低。

本質上,使用AI進行寫作使大腦進入低努力模式。雖然這看似高效,但會導致認知脫離。用於產生想法、批判性分析和創意合成的神經路徑未被充分利用,類似於因缺乏活動而變弱的肌肉。

AI輔助寫作中的記憶缺口

一項引人注目的發現與記憶保留有關。超過80%的LLM使用者難以準確回憶他們剛剛撰寫的文章中的引用,沒有人能完全回憶。這不是小問題。

研究顯示,AI生成的文章未被深入內化。獨立構思句子、糾結於詞彙選擇和論點,能建立強烈的記憶痕跡。但當AI生成內容時——即使使用者進行編輯——大腦將其視為外部內容,無法完全吸收。

這個問題不僅限於簡單回憶。LLM組別在寫作後不久也難以引用自己的文章,顯示出缺乏認知擁有感。如果學生無法回憶他們「寫」的內容,他們真的學到了嗎?

AI對原創性的影響

人工評分者指出,許多LLM文章感覺單調且缺乏個性,常使用重複的措辭。自然語言處理(NLP)分析支持這一點,顯示LLM輔助文章更為一致,變化較少,依賴可預測的語言模式。

這種思想同質化可能導致知識上的從眾。當無數學生使用相同的AI工具完成作業時,獨特的觀點和創意洞察會丟失,取而代之的是標準化、演算法驅動的輸出,缺乏人類思想的豐富性。

認知債務的代價

「認知債務」的概念類似於軟體中的技術債務——短期便利帶來長期挑戰。雖然AI當下簡化了寫作,但長期可能削弱批判性思考,增加被操縱的脆弱性,並扼殺創造力。

在研究的最后階段,從LLM轉向獨立寫作的學生顯示出較弱的神經聯繫,與未使用AI的組別相比,alpha和beta腦網絡的參與度較低。先前的AI依賴使他們在獨立任務中準備不足,因為他們的認知網絡未得到充分鍛煉。

這可能導致一代人難以:

- 獨立解決問題

- 批判性評估資訊

- 產生原創想法

- 進行持續的深度思考

- 對工作擁有知識上的主導權

搜尋引擎:平衡的替代方案

研究發現,使用搜尋引擎的組別介於AI和獨立組之間。他們與僅用大腦的組別相比,神經聯繫有所減少,但比LLM使用者保持更強的認知參與。搜尋引擎使用者需要主動評估和整合資訊,而不像接受AI生成內容那樣更被動。

這凸顯了一個關鍵差異:認知努力的程度很重要。搜尋引擎提供選項,要求使用者批判性思考。LLM提供答案,通常只需接受或拒絕。

重新思考教育中的AI

這些發現對教育界來說是一個關鍵時刻。隨著全球學校探索AI整合,麻省理工研究提供了謹慎的證據。過度、不加反思地使用LLM可能改變大腦處理資訊的方式,帶來意想不到的後果。

對教育工作者而言,結論是微妙的。AI工具不應被禁止——它們廣泛且對某些任務有價值。相反,研究建議優先進行獨立工作以增強認知能力。挑戰在於設計課程,平衡AI的益處與無輔助思考的機會。

策略可能包括:

- 無AI任務以培養批判性思考

- 在掌握核心概念後逐步引入AI

- 明確指導AI何時支持或阻礙學習

- 優先評估過程而非輸出的評量方式

- 定期進行無輔助的認知發展練習

麻省理工研究並未否定AI,而是呼籲其謹慎使用。正如我們平衡螢幕時間與體育活動,我們必須平衡AI輔助與認知鍛煉,以保持心智敏銳。

未來研究應專注於設計增強而非取代認知努力的AI工具。AI如何放大創造力而非標準化?這些問題將引導教育科技的未來。

為什麼思考很重要

核心訊息:使用你的大腦仍然至關重要。這不是對前AI時代的懷舊,而是認識到認知技能需要積極培養。如同肌肉,心理能力通過挑戰而成長,缺乏挑戰則會衰退。

麻省理工研究既是警示也是機遇。警示:不加控制地依賴AI寫作工具可能侵蝕定義人類智能的認知技能。機遇:通過理解這些風險,我們可以創造系統、政策和實踐,利用AI增強而非削弱人類思想。

認知債務提醒我們,便利是有代價的。在追求效率的同時,我們必須保護推動有意義學習的深度思考、創造力和知識擁有感。未來屬於那些能深思熟慮地平衡AI使用與自身心智力量的人。

作為教育工作者、學生和終身學習者,我們面臨選擇:滑向認知依賴,或塑造一個AI放大人類潛能的世界。麻省理工研究闡明了利害關係。下一步由我們決定。

相關文章

WordPress.com 現已允許 AI 代理程式撰寫並發布文章,還有更多功能

廣受歡迎的網站託管與發佈平台 WordPress.com 現正積極導入 AI 代理程式——此舉可能重塑網路的樣貌與使用體驗。該公司於週五宣布,將允許 AI 代理程式在客戶網站上起草、編輯及發佈內容,同時也能管理留言、更新與修正元資料,並透過標籤和分類來整理內容。所有這些操作皆透過一個介面進行控制,網站擁有者只需使用自然語言指令說明其需求即可。憑藉這些新功能,網站幾乎可以完全由人工指導的 AI 代理

WordPress.com 現已允許 AI 代理程式撰寫並發布文章,還有更多功能

廣受歡迎的網站託管與發佈平台 WordPress.com 現正積極導入 AI 代理程式——此舉可能重塑網路的樣貌與使用體驗。該公司於週五宣布,將允許 AI 代理程式在客戶網站上起草、編輯及發佈內容,同時也能管理留言、更新與修正元資料,並透過標籤和分類來整理內容。所有這些操作皆透過一個介面進行控制,網站擁有者只需使用自然語言指令說明其需求即可。憑藉這些新功能,網站幾乎可以完全由人工指導的 AI 代理

Kakao Mobility 概述了針對實體人工智慧的第 4 級自動駕駛路線圖

Kakao Mobility 計畫內部開發第 4 級自動駕駛技術,作為其實體人工智慧策略的一環。在首爾COEX舉行的2026年世界資訊科技展(World IT Show)會議上,Kakao Mobility副總裁兼實體AI部門負責人金鎮奎(Kim Jin-kyu)發表了該發展藍圖。他的演講聚焦於實體AI時代以移動平台為核心的自動駕駛服務。據韓聯社報導,這場名為「超越構想,付諸行動:AI 推動現

Kakao Mobility 概述了針對實體人工智慧的第 4 級自動駕駛路線圖

Kakao Mobility 計畫內部開發第 4 級自動駕駛技術,作為其實體人工智慧策略的一環。在首爾COEX舉行的2026年世界資訊科技展(World IT Show)會議上,Kakao Mobility副總裁兼實體AI部門負責人金鎮奎(Kim Jin-kyu)發表了該發展藍圖。他的演講聚焦於實體AI時代以移動平台為核心的自動駕駛服務。據韓聯社報導,這場名為「超越構想,付諸行動:AI 推動現

巴里·迪勒:隨著通用人工智慧(AGI)日益臨近,對山姆·奧特曼的信任已無關緊要

儘管近期有報導指出相反的看法,但億萬富翁媒體大亨巴里·迪勒並不認為 OpenAI 執行長山姆·奧特曼不可信。迪勒本週在《華爾街日報》的「萬物未來」會議上發言時,為奧特曼辯護;奧特曼此前曾遭到部分前同事和董事會成員指控,指稱他偶爾會採取操縱和欺騙手段。身為奧特曼好友的迪勒,當時正回應一個關於人們是否應信任奧特曼、以確保人工智慧造福人類的問題。具體而言,提問者探討了被稱為「通用人工智慧」(AGI)的理

相關專題推薦

評論 (3)

0/500

巴里·迪勒:隨著通用人工智慧(AGI)日益臨近,對山姆·奧特曼的信任已無關緊要

儘管近期有報導指出相反的看法,但億萬富翁媒體大亨巴里·迪勒並不認為 OpenAI 執行長山姆·奧特曼不可信。迪勒本週在《華爾街日報》的「萬物未來」會議上發言時,為奧特曼辯護;奧特曼此前曾遭到部分前同事和董事會成員指控,指稱他偶爾會採取操縱和欺騙手段。身為奧特曼好友的迪勒,當時正回應一個關於人們是否應信任奧特曼、以確保人工智慧造福人類的問題。具體而言,提問者探討了被稱為「通用人工智慧」(AGI)的理

相關專題推薦

評論 (3)

0/500

![JoseDavis]()

Étude intrigante ! En tant qu'utilisateur régulier de ces outils, je ressens effectivement que je m'appuie parfois trop sur l'IA pour structurer mes idées. C'est tellement pratique... mais après coup, on se demande si on n'a pas perdu une certaine profondeur d'analyse personnelle. Un peu comme un muscle qu'on arrête d'entraîner. 😅 Y a-t-il un juste milieu entre assistance et paresse cognitive ?

![ThomasMiller]()

Cette étude du MIT soulève un point crucial ! 🤔 On utilise tous ChatGPT au quotidien, mais est-ce qu'on ne devient pas trop paresseux mentalement ? Je me surprends à moins vérifier les infos moi-même... Ça fait réfléchir !

![GaryBrown]()

Исследование MIT как холодный душ после эйфории от ИИ! 😅 Всем нравится быстрый ответ от ChatGPT, но я уже заметил, что сам стал меньше анализировать сложные задачи — просто переспрашиваю нейросеть. А если она вдруг ошибётся? Мы рискуем превратиться в «пассивных потребителей знаний», даже не замечая этого. Может, стоит иногда специально отключать автозаполнение и тренировать мозг вручную, как на старых Nokia? 🤔

在一個AI工具如ChatGPT與拼字檢查一樣普遍的時代,麻省理工一項發人深省的研究警告,我們對大型語言模型(LLMs)的日益依賴可能正悄悄地削弱我們的批判性思考與深度學習能力。這項由麻省理工媒體實驗室研究人員進行的四個月研究,提出了「認知債務」的概念,挑戰教育工作者、學生與科技愛好者重新思考對AI的依賴。

這項發現具有重大意義。隨著全球學生轉向AI尋求學術支持,我們可能正在培養一代寫作速度更快但思考深度較淺的學生。這不僅僅是另一個科技警示故事;它是一項科學基礎上的探索,研究外包認知任務給AI如何影響我們大腦進行深度思考的能力。

AI如何影響大腦功能

麻省理工研究追蹤了來自波士頓地區五所學校的54名大學生,將他們分為三組:一組使用OpenAI的GPT-4o,另一組依賴傳統搜尋引擎,第三組在沒有外部工具的情況下撰寫文章。研究人員使用腦電圖(EEG)監測發現,獨立撰寫文章的組別在大腦多個區域顯示出更強的神經聯繫。

值得注意的是,theta與alpha腦波的差異,這些腦波與工作記憶和執行功能相關。獨立工作的組別展現出增強的額頂alpha聯繫,反映出專注的內部處理與創意形成。相反,LLM組別顯示出較低的額葉theta聯繫,表明對工作記憶和執行控制的需求較低。

本質上,使用AI進行寫作使大腦進入低努力模式。雖然這看似高效,但會導致認知脫離。用於產生想法、批判性分析和創意合成的神經路徑未被充分利用,類似於因缺乏活動而變弱的肌肉。

AI輔助寫作中的記憶缺口

一項引人注目的發現與記憶保留有關。超過80%的LLM使用者難以準確回憶他們剛剛撰寫的文章中的引用,沒有人能完全回憶。這不是小問題。

研究顯示,AI生成的文章未被深入內化。獨立構思句子、糾結於詞彙選擇和論點,能建立強烈的記憶痕跡。但當AI生成內容時——即使使用者進行編輯——大腦將其視為外部內容,無法完全吸收。

這個問題不僅限於簡單回憶。LLM組別在寫作後不久也難以引用自己的文章,顯示出缺乏認知擁有感。如果學生無法回憶他們「寫」的內容,他們真的學到了嗎?

AI對原創性的影響

人工評分者指出,許多LLM文章感覺單調且缺乏個性,常使用重複的措辭。自然語言處理(NLP)分析支持這一點,顯示LLM輔助文章更為一致,變化較少,依賴可預測的語言模式。

這種思想同質化可能導致知識上的從眾。當無數學生使用相同的AI工具完成作業時,獨特的觀點和創意洞察會丟失,取而代之的是標準化、演算法驅動的輸出,缺乏人類思想的豐富性。

認知債務的代價

「認知債務」的概念類似於軟體中的技術債務——短期便利帶來長期挑戰。雖然AI當下簡化了寫作,但長期可能削弱批判性思考,增加被操縱的脆弱性,並扼殺創造力。

在研究的最后階段,從LLM轉向獨立寫作的學生顯示出較弱的神經聯繫,與未使用AI的組別相比,alpha和beta腦網絡的參與度較低。先前的AI依賴使他們在獨立任務中準備不足,因為他們的認知網絡未得到充分鍛煉。

這可能導致一代人難以:

- 獨立解決問題

- 批判性評估資訊

- 產生原創想法

- 進行持續的深度思考

- 對工作擁有知識上的主導權

搜尋引擎:平衡的替代方案

研究發現,使用搜尋引擎的組別介於AI和獨立組之間。他們與僅用大腦的組別相比,神經聯繫有所減少,但比LLM使用者保持更強的認知參與。搜尋引擎使用者需要主動評估和整合資訊,而不像接受AI生成內容那樣更被動。

這凸顯了一個關鍵差異:認知努力的程度很重要。搜尋引擎提供選項,要求使用者批判性思考。LLM提供答案,通常只需接受或拒絕。

重新思考教育中的AI

這些發現對教育界來說是一個關鍵時刻。隨著全球學校探索AI整合,麻省理工研究提供了謹慎的證據。過度、不加反思地使用LLM可能改變大腦處理資訊的方式,帶來意想不到的後果。

對教育工作者而言,結論是微妙的。AI工具不應被禁止——它們廣泛且對某些任務有價值。相反,研究建議優先進行獨立工作以增強認知能力。挑戰在於設計課程,平衡AI的益處與無輔助思考的機會。

策略可能包括:

- 無AI任務以培養批判性思考

- 在掌握核心概念後逐步引入AI

- 明確指導AI何時支持或阻礙學習

- 優先評估過程而非輸出的評量方式

- 定期進行無輔助的認知發展練習

麻省理工研究並未否定AI,而是呼籲其謹慎使用。正如我們平衡螢幕時間與體育活動,我們必須平衡AI輔助與認知鍛煉,以保持心智敏銳。

未來研究應專注於設計增強而非取代認知努力的AI工具。AI如何放大創造力而非標準化?這些問題將引導教育科技的未來。

為什麼思考很重要

核心訊息:使用你的大腦仍然至關重要。這不是對前AI時代的懷舊,而是認識到認知技能需要積極培養。如同肌肉,心理能力通過挑戰而成長,缺乏挑戰則會衰退。

麻省理工研究既是警示也是機遇。警示:不加控制地依賴AI寫作工具可能侵蝕定義人類智能的認知技能。機遇:通過理解這些風險,我們可以創造系統、政策和實踐,利用AI增強而非削弱人類思想。

認知債務提醒我們,便利是有代價的。在追求效率的同時,我們必須保護推動有意義學習的深度思考、創造力和知識擁有感。未來屬於那些能深思熟慮地平衡AI使用與自身心智力量的人。

作為教育工作者、學生和終身學習者,我們面臨選擇:滑向認知依賴,或塑造一個AI放大人類潛能的世界。麻省理工研究闡明了利害關係。下一步由我們決定。

WordPress.com 現已允許 AI 代理程式撰寫並發布文章,還有更多功能

廣受歡迎的網站託管與發佈平台 WordPress.com 現正積極導入 AI 代理程式——此舉可能重塑網路的樣貌與使用體驗。該公司於週五宣布,將允許 AI 代理程式在客戶網站上起草、編輯及發佈內容,同時也能管理留言、更新與修正元資料,並透過標籤和分類來整理內容。所有這些操作皆透過一個介面進行控制,網站擁有者只需使用自然語言指令說明其需求即可。憑藉這些新功能,網站幾乎可以完全由人工指導的 AI 代理

WordPress.com 現已允許 AI 代理程式撰寫並發布文章,還有更多功能

廣受歡迎的網站託管與發佈平台 WordPress.com 現正積極導入 AI 代理程式——此舉可能重塑網路的樣貌與使用體驗。該公司於週五宣布,將允許 AI 代理程式在客戶網站上起草、編輯及發佈內容,同時也能管理留言、更新與修正元資料,並透過標籤和分類來整理內容。所有這些操作皆透過一個介面進行控制,網站擁有者只需使用自然語言指令說明其需求即可。憑藉這些新功能,網站幾乎可以完全由人工指導的 AI 代理

巴里·迪勒:隨著通用人工智慧(AGI)日益臨近,對山姆·奧特曼的信任已無關緊要

儘管近期有報導指出相反的看法,但億萬富翁媒體大亨巴里·迪勒並不認為 OpenAI 執行長山姆·奧特曼不可信。迪勒本週在《華爾街日報》的「萬物未來」會議上發言時,為奧特曼辯護;奧特曼此前曾遭到部分前同事和董事會成員指控,指稱他偶爾會採取操縱和欺騙手段。身為奧特曼好友的迪勒,當時正回應一個關於人們是否應信任奧特曼、以確保人工智慧造福人類的問題。具體而言,提問者探討了被稱為「通用人工智慧」(AGI)的理

巴里·迪勒:隨著通用人工智慧(AGI)日益臨近,對山姆·奧特曼的信任已無關緊要

儘管近期有報導指出相反的看法,但億萬富翁媒體大亨巴里·迪勒並不認為 OpenAI 執行長山姆·奧特曼不可信。迪勒本週在《華爾街日報》的「萬物未來」會議上發言時,為奧特曼辯護;奧特曼此前曾遭到部分前同事和董事會成員指控,指稱他偶爾會採取操縱和欺騙手段。身為奧特曼好友的迪勒,當時正回應一個關於人們是否應信任奧特曼、以確保人工智慧造福人類的問題。具體而言,提問者探討了被稱為「通用人工智慧」(AGI)的理

Étude intrigante ! En tant qu'utilisateur régulier de ces outils, je ressens effectivement que je m'appuie parfois trop sur l'IA pour structurer mes idées. C'est tellement pratique... mais après coup, on se demande si on n'a pas perdu une certaine profondeur d'analyse personnelle. Un peu comme un muscle qu'on arrête d'entraîner. 😅 Y a-t-il un juste milieu entre assistance et paresse cognitive ?

Cette étude du MIT soulève un point crucial ! 🤔 On utilise tous ChatGPT au quotidien, mais est-ce qu'on ne devient pas trop paresseux mentalement ? Je me surprends à moins vérifier les infos moi-même... Ça fait réfléchir !

Исследование MIT как холодный душ после эйфории от ИИ! 😅 Всем нравится быстрый ответ от ChatGPT, но я уже заметил, что сам стал меньше анализировать сложные задачи — просто переспрашиваю нейросеть. А если она вдруг ошибётся? Мы рискуем превратиться в «пассивных потребителей знаний», даже не замечая этого. Может, стоит иногда специально отключать автозаполнение и тренировать мозг вручную, как на старых Nokia? 🤔

首頁

首頁