Captum · Model Interpretability for PyTorch

Interpréter les modèles dans Pytorch

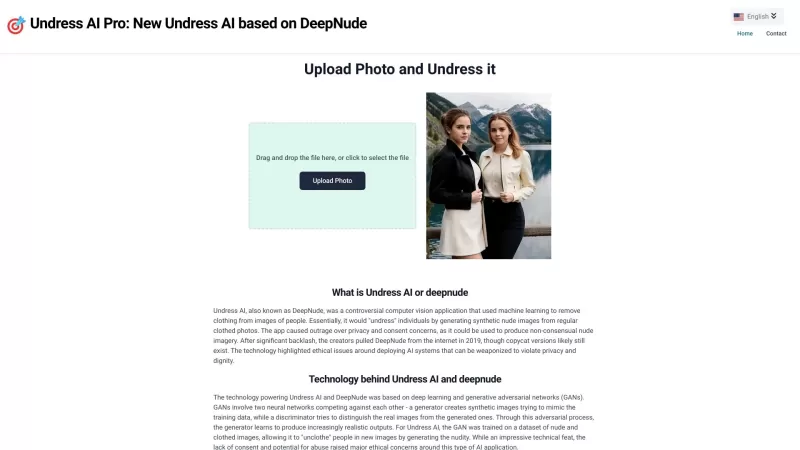

Désaction AI Pro, souvent appelée Deepnude, est un outil très controversé qui a suscité tout à fait le débat. Il utilise des algorithmes d'apprentissage automatique sophistiqués pour éliminer numériquement les vêtements des images de personnes. C'est un concept sauvage, non? Mais le

Vous êtes-vous déjà demandé ce qui fait que Deepseek Ai se démarque dans le monde bondé de l'IA Tech? Eh bien, permettez-moi de vous dire que Deepseek IA n'est pas seulement un autre joueur du jeu; C'est le principal fournisseur de modèles avancés en langue AI et de solutions d'entreprise. Ce qui les définit APA

Vous êtes-vous déjà demandé ce que ce serait de créer une version numérique de vous-même ou de quelqu'un d'autre? C'est là que Meshcapade Me entre en jeu - une plate-forme de pointe qui vous permet de créer des humains numériques 3D incroyablement réalisants. Que vous ayez quelques photos, SOM

Qu'est-ce qu'GPT OSS ? GPT OSS marque une étape décisive dans la démocratisation de l'IA avancée, introduite par OpenAI le 5 août 2025. Cette famille open source comprend deux modèles r

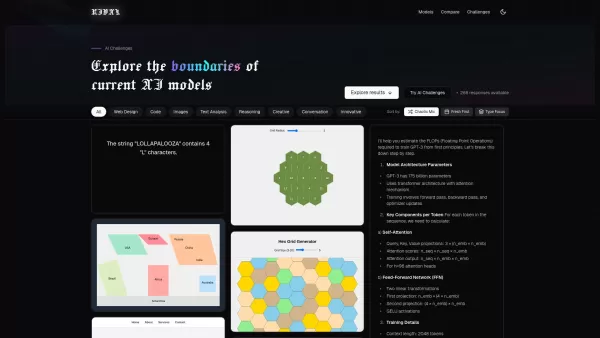

Vous êtes-vous déjà demandé comment différents modèles d'IA se comparent les uns contre les autres? Entrez Rival, une application Web élégante conçue pour vous permettre de plonger profondément dans le monde des comparaisons d'IA. C'est comme avoir un siège de première rang pour une épreuve de force entre GPT-4O, Claude 3.7 et Grok-3, où vous pouvez les voir s'attaquer à T

Captum · Model Interpretability for PyTorch Informations sur les produits

Si vous plongez dans le monde de l'apprentissage automatique et du pytorch, vous pourriez être tombé sur Captum, un outil puissant pour l'interprétabilité du modèle. Essentiellement, Captum est comme une lampe de poche dans les coins sombres de vos réseaux de neurones, vous aidant à comprendre comment et pourquoi vos modèles font leurs prédictions. Cela change la donne pour quiconque cherche à jeter un œil sous le capot de ses modèles Pytorch et à voir ce qui se passe vraiment.

Comment utiliser CAPTUM · Interprétabilité du modèle pour Pytorch?

Le début de Captum est assez simple, mais cela nécessite quelques étapes. Tout d'abord, vous devrez installer la bibliothèque Captum. Une fois cela fait, vous pouvez créer et préparer votre modèle. Ensuite, vous définissez vos tenseurs d'entrée et de base, qui sont cruciaux pour comprendre l'impact de vos entrées. Après cela, vous choisissez un algorithme d'interprétation de la suite de Captum - comme des gradients intégrés ou de la profondeur - et l'appliquez à votre modèle. C'est comme ajuster votre modèle avec une paire de lunettes pour voir son processus de prise de décision plus clairement.

Captum · Interprétabilité du modèle pour les fonctionnalités principales de Pytorch

Multi-modal

Captum ne se limite pas à un seul type de données. Il est conçu pour gérer diverses modalités, des images au texte, ce qui le rend incroyablement polyvalent pour différents types de modèles.

Construit sur pytorch

Étant donné que Captum est construit directement sur Pytorch, il s'intègre parfaitement à votre flux de travail Pytorch existant. Pas besoin d'apprendre un nouveau cadre; C'est comme une extension de ce que vous utilisez déjà.

Extensible

L'une des choses les plus cool de Captum est son extensibilité. Vous pouvez facilement ajouter de nouveaux algorithmes ou adapter ceux existants pour répondre à vos besoins spécifiques. C'est comme avoir une boîte à outils que vous pouvez personnaliser au contenu de votre cœur.

Captum · Interprétabilité du modèle pour les cas d'utilisation de Pytorch

Recherche d'interprétabilité

Pour ceux qui profondément dans les tranchées de recherche, Captum est une aubaine. Il est parfait pour explorer comment les différentes entrées affectent les sorties du modèle, vous aidant à créer des systèmes d'IA plus robustes et explicables.

FAQ de Captum · Interprétabilité du modèle pour Pytorch

- Qu'est-ce que le captum?

Captum est une bibliothèque d'interprétabilité du modèle spécialement conçu pour Pytorch. C'est votre outil de référence pour comprendre le fonctionnement interne de vos modèles, ce qui facilite l'expliquer et les améliorer.

Captum · Interprétabilité du modèle pour la société Pytorch

L'entreprise derrière Captum n'est autre que Facebook Inc. Ce sont eux qui ont apporté cet outil puissant dans le monde de la recherche et du développement de l'IA.

Captum · Interprétabilité du modèle pour Pytorch Facebook

Vous pouvez en savoir plus sur Captum sur la plate-forme open-source de Facebook à https://openseource.facebook.com/ . C'est là que la magie se produit!

Captum · Interprétabilité du modèle pour Pytorch Github

Pour les techniciens, le référentiel GitHub pour Captum est votre terrain de jeu. Vérifiez-le sur https://github.com/pytorch/captum et plongez dans le code, contribuez ou explorez simplement les possibilités.

Maison

Maison