AI倫理:科技發展中的風險與責任導航

人工智能(AI)正在重塑從醫療到物流的各行各業,帶來巨大進步潛力。然而,其快速發展帶來顯著風險,需謹慎監督。本文探討AI的倫理挑戰與潛在危險,強調負責任發展與穩健倫理框架的必要性,以確保AI服務於人類最佳利益。隨著AI日益進步,平衡其益處與潛在危害對保障未來至關重要。

關鍵要點

若未妥善管理,AI風險包括就業損失與政治干預。

倫理原則必須指導AI編程,以符合人類價值觀並防止濫用。

AI的開發者與使用者必須對其行為負責。

持續監督AI系統對保持控制至關重要。

平衡創新與謹慎是最大化AI益處並最小化風險的關鍵。

若被濫用,AI可能加劇不平等與操縱人類行為。

公平、透明且負責任的AI設計對倫理成果至關重要。

探索AI的潛在風險

就業損失與經濟轉型

AI的自動化能力威脅各行業就業,帶來經濟不穩與社會動盪風險。

解決此問題需主動推行再培訓計劃,幫助工作者適應新角色。政府與企業需合作創造機會,支持受自動化影響者。

此外,少數科技巨頭控制AI可能擴大財富差距。確保AI益處的公平獲取對實現廣泛社會收益與減少不平等至關重要。若無行動,自動化可能導致廣泛失業及相關問題,如無家可歸。

政治干預與民主風險

AI可能放大錯誤信息、製造深度偽造並操縱公眾意見,威脅民主完整性。

事實查核、媒體素養及規範AI在競選中的使用等防護措施對抵禦這些風險至關重要。透明且負責任的AI系統對維護公眾信任與民主進程至關重要。全球合作也需應對AI對選舉的跨境影響。

未受規範的AI可能助長政治衝突並動搖國家穩定。

偏見與不平等

基於偏見數據訓練的AI可能在招聘、貸款與司法系統中延續歧視。

例如,若招聘算法基於偏斜數據集,可能偏向特定人群。解決此問題需多元數據、注重公平的算法及定期審計以確保公平成果。AI決策透明度也是識別與糾正偏見、促進公平與包容的關鍵。

解決這些問題可防止AI強化社會不平等。

自主武器與意外衝突

自主武器系統(AWS)或「殺手機器人」因無人監督的生死決策帶來倫理與安全風險。

專家主張禁止AWS,因其可能引發意外衝突。需國際協議規範AI在戰爭中的使用,確保人類對關鍵決策的控制。倫理監督對防止自主系統的災難性後果至關重要。

不受控制的AI武器可能傷害無辜並引發戰爭。

隱私與監控問題

AI驅動的監控,如人臉識別與預測性警務,可能導致大規模隱私侵犯並壓制言論自由。

強大的數據保護法、監控實踐透明度及個人數據權利對遏制濫用至關重要。優先考慮隱私可防止AI促成壓迫性監控國家。若無防護措施,政府與企業可能利用AI肆意侵犯隱私。

AI對隱私的影響需強大保護措施。

減輕AI風險:策略與解決方案

建立倫理框架

根植於公平、透明與人權的明確倫理指南對負責任的AI發展至關重要。

這些框架應納入多元領域專家並隨AI進展演變。將倫理嵌入AI確保與人類價值觀一致,對抗優先利潤而非安全的商業動機。

倫理指南至關重要,因僅靠企業激勵無法確保AI安全。

提升透明度與可解釋性

透明AI系統透過揭示決策過程建立信任,特別在醫療與司法等高風險領域。

可解釋AI(XAI)技術有助澄清決策、檢測偏見並驗證功能。優先透明度解決「黑箱」問題,使AI系統更可信與負責任。

透明度對解開AI運作之謎至關重要。

確保問責與監督

明確的問責機制使AI開發者與使用者對系統結果負責。

獨立審計、監管機構與倫理審查委員會提供監督,公共教育則增強對問責的需求。這些制衡措施防止濫用並確保AI負責任地服務社會。

監督確保AI系統保持可信與安全。

負責任地導航AI

保持資訊更新

透過文章、會議與討論了解AI發展、風險與倫理問題。

支持倫理AI行動

透過捐款、志願服務或倡導公平透明政策,支持推廣負責任AI的組織。

要求開發者透明

敦促AI開發者公開系統機制、數據使用與決策過程,支持XAI進展。

推動數據保護法

倡導強大的數據隱私法,確保數據存取、更正與退出監控計劃的權利。

促進媒體素養

培養批判性思維以辨識錯誤信息,並支持教導評估資訊來源的計劃。

投資負責任AI

倫理AI培訓

組織應資助員工培訓,涵蓋數據偏見、算法公平與負責任AI實踐,以防意外後果。

資助審計與監督

為定期審計與倫理審查委員會提供資源,確保AI系統遵循倫理標準,提升信任。

評估長期影響

組織必須衡量AI對社會、經濟與環境的影響,確保可持續與公平的結果。

權衡AI的益處與風險

優勢

提升效率:AI簡化任務,增強各行業生產力。

更好決策:AI從海量數據中挖掘洞見,改善決策。

進階醫療:AI精進診斷、個性化治療並加速藥物發現。

客製化教育:AI提供個性化學習支持學生。

環境解決方案:AI監測條件並制定氣候變遷緩解策略。

劣勢

就業損失:自動化帶來廣泛失業與經濟混亂風險。

政治干預:AI可能傳播錯誤信息並破壞民主。

偏見放大:若基於偏見數據,AI可能延續歧視。

自主武器:無人監督的AWS帶來倫理與安全威脅。

隱私風險:監控技術威脅個人自由與數據安全。

倫理AI系統特徵

公平與平等

倫理AI避免偏見,使用多元數據與注重公平的算法,確保公平結果。

透明與清晰

透明AI系統讓使用者理解決策,XAI技術增強信任與問責。

問責與監督

明確責任線與審計等監督機制確保負責任的AI使用。

數據隱私

倫理AI以同意為基礎收集數據並採用強大安全措施保護個人數據。

安全與可靠性

嚴格測試確保AI系統無誤且安全,特別在關鍵應用中。

倫理AI使用案例

醫療:提升照護

AI改善診斷與治療計劃,但需公平、透明與多元數據以確保公平照護。

教育:擴展存取

AI個性化學習並提升存取,但須避免偏見以促進公平教育。

環境保護:對抗氣候變遷

AI監測與緩解氣候影響,但須避免有害政策並確保公平結果。

刑事司法:促進公平

AI簡化司法流程,但需注重公平的算法與審計以避免偏見與不平等。

關於AI風險的常見問題

AI的主要倫理挑戰是什麼?

關鍵問題包括就業流失、政治操縱、偏見、自主武器與隱私侵犯。

如何阻止AI濫用?

倫理指南、透明度、問責、公共教育與強大數據法規防止惡意使用AI。

政府與企業扮演什麼角色?

政府制定法規,企業優先考慮倫理實踐,合作確保負責任的AI發展。

個人如何免受AI風險影響?

了解AI、要求透明、倡導數據法規並培養批判性思維技能。

AI對社會的長期影響是什麼?

負責任的AI可解決重大問題,但未受控的風險可能導致壓迫與不平等。

探索AI的未來挑戰

AI如何影響人類自主性?

過度依賴AI可能削弱人類控制,需教育以維持決策主導權。

AI如何與人類價值觀對齊?

使用多元數據、公平算法與審計確保AI反映人類價值觀,教育促進倫理意識。

AI在關鍵基礎設施中的風險是什麼?

AI在能源、交通或金融中易受網路攻擊,需強大安全與備援系統。

AI如何促進社會福祉?

優先考慮公平、包容與審計,確保AI賦能社群並減少不平等。

AI如何影響創造力?

AI可自動化任務,但若不與人類創造力結合,可能抑制創新。

相關文章

以文字翻譯聞名的 DeepL,現已進軍語音翻譯領域

以文字翻譯工具聞名的翻譯公司 DeepL,今日推出了一套語音對語音翻譯解決方案,透過客製化應用程式,針對前線工作人員在會議、行動裝置與網路對話,以及群組討論等情境提供支援。 該公司同時推出了一項 API,讓外部開發者與企業能基於 DeepL 的技術,打造適用於呼叫中心等特定情境的解決方案。「在專注於文字翻譯多年後,語音翻譯對我們而言是水到渠成的下一步,」DeepL 執行長 Jarek Kutylo

以文字翻譯聞名的 DeepL,現已進軍語音翻譯領域

以文字翻譯工具聞名的翻譯公司 DeepL,今日推出了一套語音對語音翻譯解決方案,透過客製化應用程式,針對前線工作人員在會議、行動裝置與網路對話,以及群組討論等情境提供支援。 該公司同時推出了一項 API,讓外部開發者與企業能基於 DeepL 的技術,打造適用於呼叫中心等特定情境的解決方案。「在專注於文字翻譯多年後,語音翻譯對我們而言是水到渠成的下一步,」DeepL 執行長 Jarek Kutylo

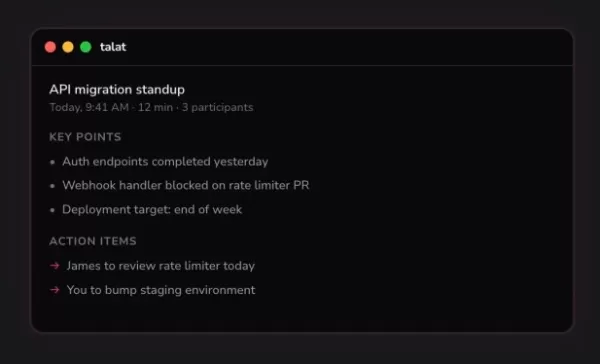

Talat 的人工智慧會議筆記儲存在您的裝置上,而非雲端

估值達 2.5 億美元的人工智慧筆記應用程式 Granola,已在科技創辦人和風險投資人之間引起熱烈迴響。但有位開發者認為,市場需要一款更注重隱私、完全在本地運行的替代方案,且僅需支付一次費用,無需訂閱。這項願景催生了一款名為 Talat 的新 Mac 應用程式。來自英國約克郡、自稱電腦宅男的尼克·佩恩(Nick Payne)表示,開發這款本地化 AI 筆記應用程式的靈感,很大程度上源自一連串幸運

Talat 的人工智慧會議筆記儲存在您的裝置上,而非雲端

估值達 2.5 億美元的人工智慧筆記應用程式 Granola,已在科技創辦人和風險投資人之間引起熱烈迴響。但有位開發者認為,市場需要一款更注重隱私、完全在本地運行的替代方案,且僅需支付一次費用,無需訂閱。這項願景催生了一款名為 Talat 的新 Mac 應用程式。來自英國約克郡、自稱電腦宅男的尼克·佩恩(Nick Payne)表示,開發這款本地化 AI 筆記應用程式的靈感,很大程度上源自一連串幸運

全新榮威i6以65.9萬人民幣上市,搭載高通驍龍8155處理器與「斗寶」大模型

上汽榮威今日推出全新榮威i6,這款緊湊型轎車全面採用了榮威D7的設計語言。其獨特的大型直立式水箱護罩與橫向環形燈帶貫穿車頭,營造出強烈的科技感與視覺寬度。 車尾部分,上翹的鴨尾式尾翼與全寬尾燈相得益彰,賦予整車更顯活力的年輕氣息。全新榮威i6車身長4767毫米、寬1828毫米、高1498毫米,軸距為2755毫米。 得益於寬敞的車內空間,它躋身A+級轎車之列,在後排頭部空間與膝部空間方面具備顯著優

相關專題推薦

評論 (1)

0/500

全新榮威i6以65.9萬人民幣上市,搭載高通驍龍8155處理器與「斗寶」大模型

上汽榮威今日推出全新榮威i6,這款緊湊型轎車全面採用了榮威D7的設計語言。其獨特的大型直立式水箱護罩與橫向環形燈帶貫穿車頭,營造出強烈的科技感與視覺寬度。 車尾部分,上翹的鴨尾式尾翼與全寬尾燈相得益彰,賦予整車更顯活力的年輕氣息。全新榮威i6車身長4767毫米、寬1828毫米、高1498毫米,軸距為2755毫米。 得益於寬敞的車內空間,它躋身A+級轎車之列,在後排頭部空間與膝部空間方面具備顯著優

相關專題推薦

評論 (1)

0/500

人工智能(AI)正在重塑從醫療到物流的各行各業,帶來巨大進步潛力。然而,其快速發展帶來顯著風險,需謹慎監督。本文探討AI的倫理挑戰與潛在危險,強調負責任發展與穩健倫理框架的必要性,以確保AI服務於人類最佳利益。隨著AI日益進步,平衡其益處與潛在危害對保障未來至關重要。

關鍵要點

若未妥善管理,AI風險包括就業損失與政治干預。

倫理原則必須指導AI編程,以符合人類價值觀並防止濫用。

AI的開發者與使用者必須對其行為負責。

持續監督AI系統對保持控制至關重要。

平衡創新與謹慎是最大化AI益處並最小化風險的關鍵。

若被濫用,AI可能加劇不平等與操縱人類行為。

公平、透明且負責任的AI設計對倫理成果至關重要。

探索AI的潛在風險

就業損失與經濟轉型

AI的自動化能力威脅各行業就業,帶來經濟不穩與社會動盪風險。

解決此問題需主動推行再培訓計劃,幫助工作者適應新角色。政府與企業需合作創造機會,支持受自動化影響者。

此外,少數科技巨頭控制AI可能擴大財富差距。確保AI益處的公平獲取對實現廣泛社會收益與減少不平等至關重要。若無行動,自動化可能導致廣泛失業及相關問題,如無家可歸。

政治干預與民主風險

AI可能放大錯誤信息、製造深度偽造並操縱公眾意見,威脅民主完整性。

事實查核、媒體素養及規範AI在競選中的使用等防護措施對抵禦這些風險至關重要。透明且負責任的AI系統對維護公眾信任與民主進程至關重要。全球合作也需應對AI對選舉的跨境影響。

未受規範的AI可能助長政治衝突並動搖國家穩定。

偏見與不平等

基於偏見數據訓練的AI可能在招聘、貸款與司法系統中延續歧視。

例如,若招聘算法基於偏斜數據集,可能偏向特定人群。解決此問題需多元數據、注重公平的算法及定期審計以確保公平成果。AI決策透明度也是識別與糾正偏見、促進公平與包容的關鍵。

解決這些問題可防止AI強化社會不平等。

自主武器與意外衝突

自主武器系統(AWS)或「殺手機器人」因無人監督的生死決策帶來倫理與安全風險。

專家主張禁止AWS,因其可能引發意外衝突。需國際協議規範AI在戰爭中的使用,確保人類對關鍵決策的控制。倫理監督對防止自主系統的災難性後果至關重要。

不受控制的AI武器可能傷害無辜並引發戰爭。

隱私與監控問題

AI驅動的監控,如人臉識別與預測性警務,可能導致大規模隱私侵犯並壓制言論自由。

強大的數據保護法、監控實踐透明度及個人數據權利對遏制濫用至關重要。優先考慮隱私可防止AI促成壓迫性監控國家。若無防護措施,政府與企業可能利用AI肆意侵犯隱私。

AI對隱私的影響需強大保護措施。

減輕AI風險:策略與解決方案

建立倫理框架

根植於公平、透明與人權的明確倫理指南對負責任的AI發展至關重要。

這些框架應納入多元領域專家並隨AI進展演變。將倫理嵌入AI確保與人類價值觀一致,對抗優先利潤而非安全的商業動機。

倫理指南至關重要,因僅靠企業激勵無法確保AI安全。

提升透明度與可解釋性

透明AI系統透過揭示決策過程建立信任,特別在醫療與司法等高風險領域。

可解釋AI(XAI)技術有助澄清決策、檢測偏見並驗證功能。優先透明度解決「黑箱」問題,使AI系統更可信與負責任。

透明度對解開AI運作之謎至關重要。

確保問責與監督

明確的問責機制使AI開發者與使用者對系統結果負責。

獨立審計、監管機構與倫理審查委員會提供監督,公共教育則增強對問責的需求。這些制衡措施防止濫用並確保AI負責任地服務社會。

監督確保AI系統保持可信與安全。

負責任地導航AI

保持資訊更新

透過文章、會議與討論了解AI發展、風險與倫理問題。

支持倫理AI行動

透過捐款、志願服務或倡導公平透明政策,支持推廣負責任AI的組織。

要求開發者透明

敦促AI開發者公開系統機制、數據使用與決策過程,支持XAI進展。

推動數據保護法

倡導強大的數據隱私法,確保數據存取、更正與退出監控計劃的權利。

促進媒體素養

培養批判性思維以辨識錯誤信息,並支持教導評估資訊來源的計劃。

投資負責任AI

倫理AI培訓

組織應資助員工培訓,涵蓋數據偏見、算法公平與負責任AI實踐,以防意外後果。

資助審計與監督

為定期審計與倫理審查委員會提供資源,確保AI系統遵循倫理標準,提升信任。

評估長期影響

組織必須衡量AI對社會、經濟與環境的影響,確保可持續與公平的結果。

權衡AI的益處與風險

優勢

提升效率:AI簡化任務,增強各行業生產力。

更好決策:AI從海量數據中挖掘洞見,改善決策。

進階醫療:AI精進診斷、個性化治療並加速藥物發現。

客製化教育:AI提供個性化學習支持學生。

環境解決方案:AI監測條件並制定氣候變遷緩解策略。

劣勢

就業損失:自動化帶來廣泛失業與經濟混亂風險。

政治干預:AI可能傳播錯誤信息並破壞民主。

偏見放大:若基於偏見數據,AI可能延續歧視。

自主武器:無人監督的AWS帶來倫理與安全威脅。

隱私風險:監控技術威脅個人自由與數據安全。

倫理AI系統特徵

公平與平等

倫理AI避免偏見,使用多元數據與注重公平的算法,確保公平結果。

透明與清晰

透明AI系統讓使用者理解決策,XAI技術增強信任與問責。

問責與監督

明確責任線與審計等監督機制確保負責任的AI使用。

數據隱私

倫理AI以同意為基礎收集數據並採用強大安全措施保護個人數據。

安全與可靠性

嚴格測試確保AI系統無誤且安全,特別在關鍵應用中。

倫理AI使用案例

醫療:提升照護

AI改善診斷與治療計劃,但需公平、透明與多元數據以確保公平照護。

教育:擴展存取

AI個性化學習並提升存取,但須避免偏見以促進公平教育。

環境保護:對抗氣候變遷

AI監測與緩解氣候影響,但須避免有害政策並確保公平結果。

刑事司法:促進公平

AI簡化司法流程,但需注重公平的算法與審計以避免偏見與不平等。

關於AI風險的常見問題

AI的主要倫理挑戰是什麼?

關鍵問題包括就業流失、政治操縱、偏見、自主武器與隱私侵犯。

如何阻止AI濫用?

倫理指南、透明度、問責、公共教育與強大數據法規防止惡意使用AI。

政府與企業扮演什麼角色?

政府制定法規,企業優先考慮倫理實踐,合作確保負責任的AI發展。

個人如何免受AI風險影響?

了解AI、要求透明、倡導數據法規並培養批判性思維技能。

AI對社會的長期影響是什麼?

負責任的AI可解決重大問題,但未受控的風險可能導致壓迫與不平等。

探索AI的未來挑戰

AI如何影響人類自主性?

過度依賴AI可能削弱人類控制,需教育以維持決策主導權。

AI如何與人類價值觀對齊?

使用多元數據、公平算法與審計確保AI反映人類價值觀,教育促進倫理意識。

AI在關鍵基礎設施中的風險是什麼?

AI在能源、交通或金融中易受網路攻擊,需強大安全與備援系統。

AI如何促進社會福祉?

優先考慮公平、包容與審計,確保AI賦能社群並減少不平等。

AI如何影響創造力?

AI可自動化任務,但若不與人類創造力結合,可能抑制創新。

以文字翻譯聞名的 DeepL,現已進軍語音翻譯領域

以文字翻譯工具聞名的翻譯公司 DeepL,今日推出了一套語音對語音翻譯解決方案,透過客製化應用程式,針對前線工作人員在會議、行動裝置與網路對話,以及群組討論等情境提供支援。 該公司同時推出了一項 API,讓外部開發者與企業能基於 DeepL 的技術,打造適用於呼叫中心等特定情境的解決方案。「在專注於文字翻譯多年後,語音翻譯對我們而言是水到渠成的下一步,」DeepL 執行長 Jarek Kutylo

以文字翻譯聞名的 DeepL,現已進軍語音翻譯領域

以文字翻譯工具聞名的翻譯公司 DeepL,今日推出了一套語音對語音翻譯解決方案,透過客製化應用程式,針對前線工作人員在會議、行動裝置與網路對話,以及群組討論等情境提供支援。 該公司同時推出了一項 API,讓外部開發者與企業能基於 DeepL 的技術,打造適用於呼叫中心等特定情境的解決方案。「在專注於文字翻譯多年後,語音翻譯對我們而言是水到渠成的下一步,」DeepL 執行長 Jarek Kutylo

Talat 的人工智慧會議筆記儲存在您的裝置上,而非雲端

估值達 2.5 億美元的人工智慧筆記應用程式 Granola,已在科技創辦人和風險投資人之間引起熱烈迴響。但有位開發者認為,市場需要一款更注重隱私、完全在本地運行的替代方案,且僅需支付一次費用,無需訂閱。這項願景催生了一款名為 Talat 的新 Mac 應用程式。來自英國約克郡、自稱電腦宅男的尼克·佩恩(Nick Payne)表示,開發這款本地化 AI 筆記應用程式的靈感,很大程度上源自一連串幸運

Talat 的人工智慧會議筆記儲存在您的裝置上,而非雲端

估值達 2.5 億美元的人工智慧筆記應用程式 Granola,已在科技創辦人和風險投資人之間引起熱烈迴響。但有位開發者認為,市場需要一款更注重隱私、完全在本地運行的替代方案,且僅需支付一次費用,無需訂閱。這項願景催生了一款名為 Talat 的新 Mac 應用程式。來自英國約克郡、自稱電腦宅男的尼克·佩恩(Nick Payne)表示,開發這款本地化 AI 筆記應用程式的靈感,很大程度上源自一連串幸運

全新榮威i6以65.9萬人民幣上市,搭載高通驍龍8155處理器與「斗寶」大模型

上汽榮威今日推出全新榮威i6,這款緊湊型轎車全面採用了榮威D7的設計語言。其獨特的大型直立式水箱護罩與橫向環形燈帶貫穿車頭,營造出強烈的科技感與視覺寬度。 車尾部分,上翹的鴨尾式尾翼與全寬尾燈相得益彰,賦予整車更顯活力的年輕氣息。全新榮威i6車身長4767毫米、寬1828毫米、高1498毫米,軸距為2755毫米。 得益於寬敞的車內空間,它躋身A+級轎車之列,在後排頭部空間與膝部空間方面具備顯著優

全新榮威i6以65.9萬人民幣上市,搭載高通驍龍8155處理器與「斗寶」大模型

上汽榮威今日推出全新榮威i6,這款緊湊型轎車全面採用了榮威D7的設計語言。其獨特的大型直立式水箱護罩與橫向環形燈帶貫穿車頭,營造出強烈的科技感與視覺寬度。 車尾部分,上翹的鴨尾式尾翼與全寬尾燈相得益彰,賦予整車更顯活力的年輕氣息。全新榮威i6車身長4767毫米、寬1828毫米、高1498毫米,軸距為2755毫米。 得益於寬敞的車內空間,它躋身A+級轎車之列,在後排頭部空間與膝部空間方面具備顯著優

首頁

首頁